3D Gaussian Splatting for Fine-Detailed Surface Reconstruction in Large-Scale Scene

作者: Shihan Chen, Zhaojin Li, Zeyu Chen, Qingsong Yan, Gaoyang Shen, Ran Duan

分类: cs.GR, cs.CV, eess.IV

发布日期: 2025-06-21

备注: IROS 2025

💡 一句话要点

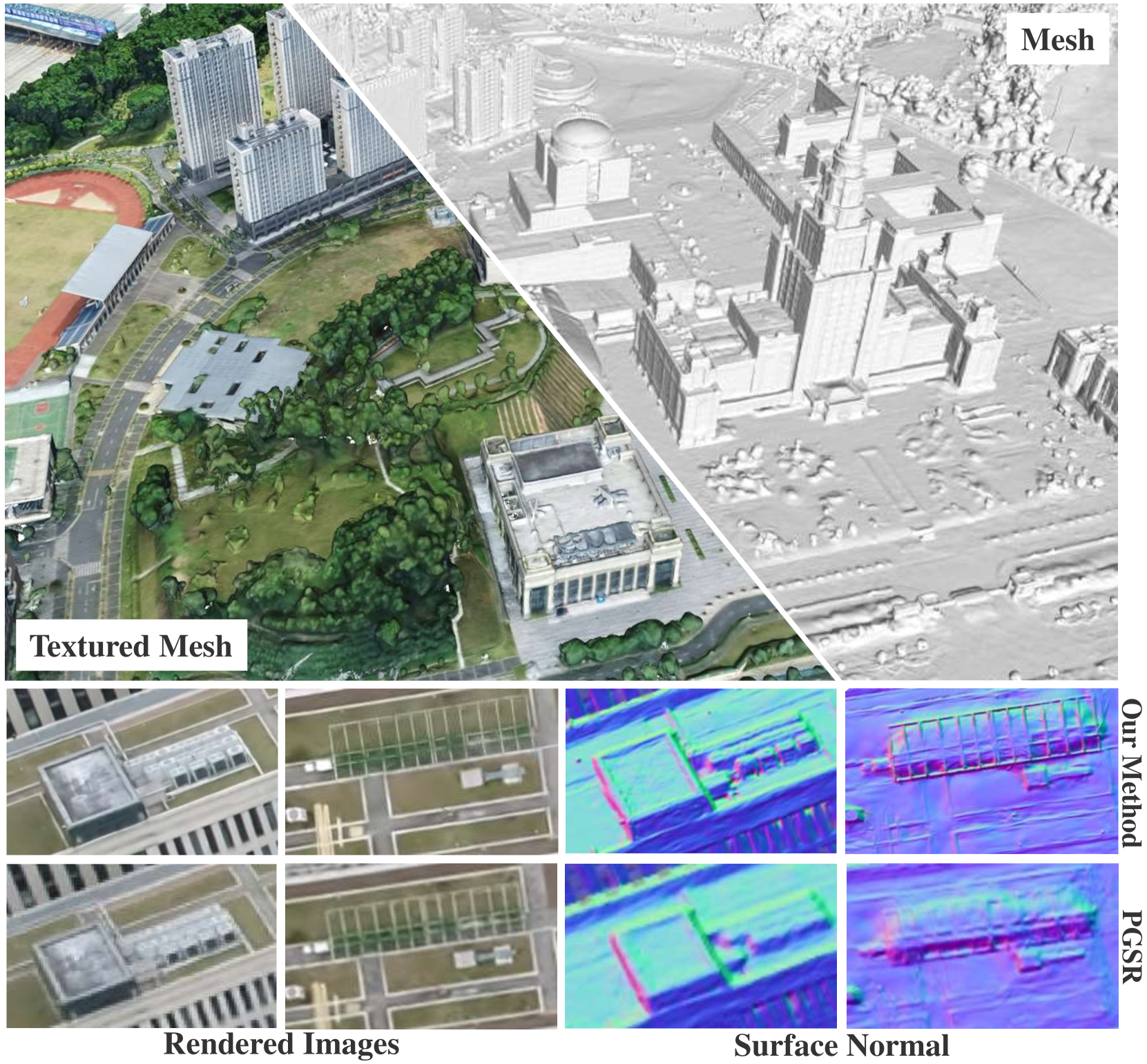

提出基于3D高斯溅射的粗细结合方法,用于大规模场景的精细表面重建。

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 3D高斯溅射 大规模场景重建 表面重建 由粗到精 外观解耦 瞬态物体掩码 单视图正则化

📋 核心要点

- 现有3D高斯溅射方法在大规模场景重建中面临计算量大和动态外观复杂等挑战,限制了其在航测和自动驾驶中的应用。

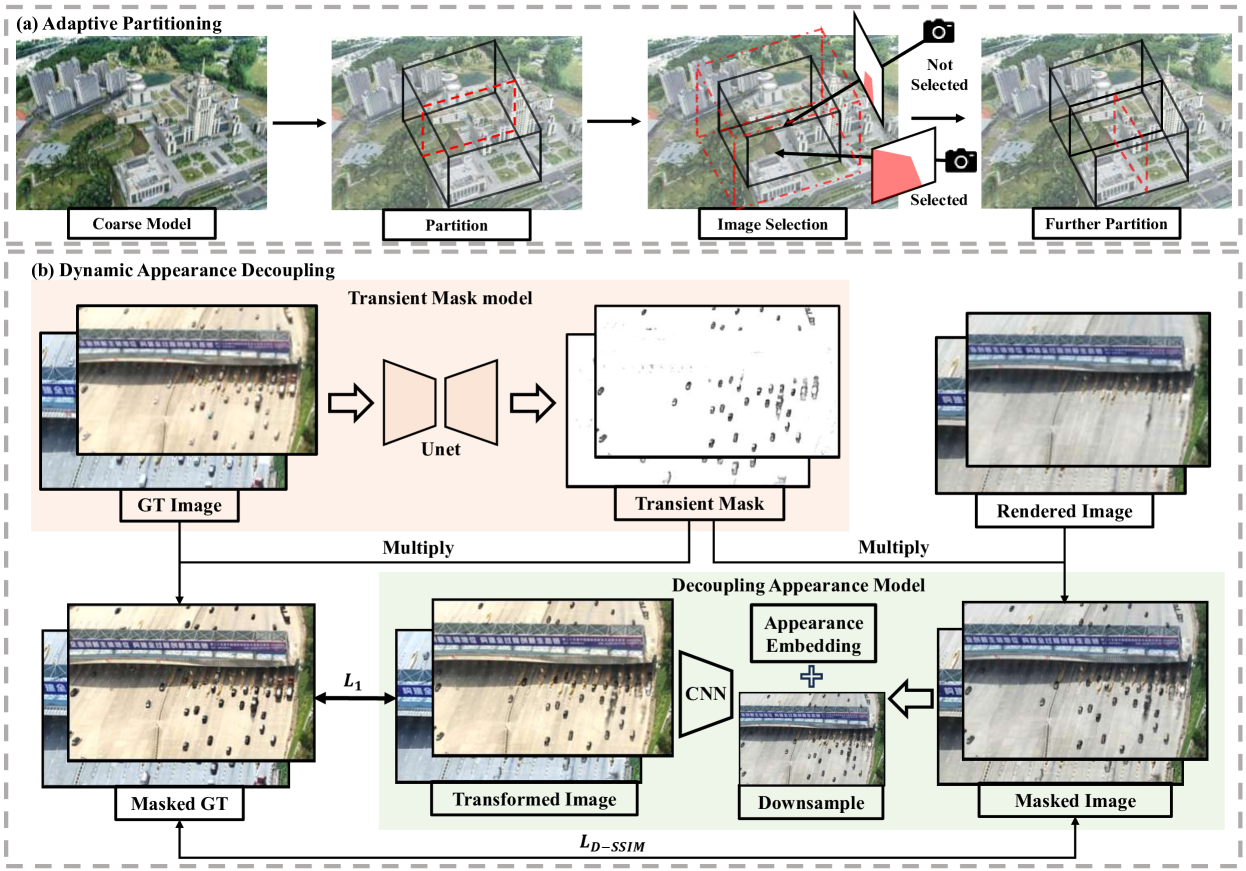

- 论文提出一种由粗到精的重建策略,结合自适应场景分割和子场景细化,并引入解耦外观模型和瞬态掩码模型来提升重建质量。

- 实验结果表明,该方法在GauU-Scene V2数据集上优于现有NeRF和高斯方法,实现了高保真视觉效果和精确的表面重建。

📝 摘要(中文)

本文提出了一种新颖的解决方案,用于重建具有精细细节的大规模表面,并由全尺寸图像监督。首先,我们引入了一种由粗到精的策略来高效地重建粗略模型,然后从图像片段中进行自适应场景分割和子场景细化。此外,我们集成了一个解耦外观模型来捕获全局外观变化,以及一个瞬态掩码模型来减轻移动物体的干扰。最后,我们扩展了多视图约束,并为无纹理区域引入了单视图正则化。我们的实验在公开可用的 GauU-Scene V2 数据集上进行,该数据集是使用无人机捕获的。据我们所知,我们的方法优于现有的基于 NeRF 和基于高斯的方法,通过全尺寸图像优化实现了高保真视觉效果和精确的表面重建。开源代码将在 GitHub 上提供。

🔬 方法详解

问题定义:现有基于3D高斯溅射的方法在处理大规模场景时,计算资源消耗巨大,难以有效应对室外环境复杂的动态外观变化(如光照变化、移动物体等)。这限制了其在航测、自动驾驶等领域的应用,因为这些应用场景通常需要处理大规模、高动态的场景数据,并对重建精度和效率有较高要求。

核心思路:论文的核心思路是采用一种由粗到精的策略,先快速构建一个粗略的场景模型,然后逐步细化模型,同时引入外观解耦和瞬态物体掩码来提高重建质量。这种方法旨在平衡重建精度和计算效率,使其能够处理大规模场景。

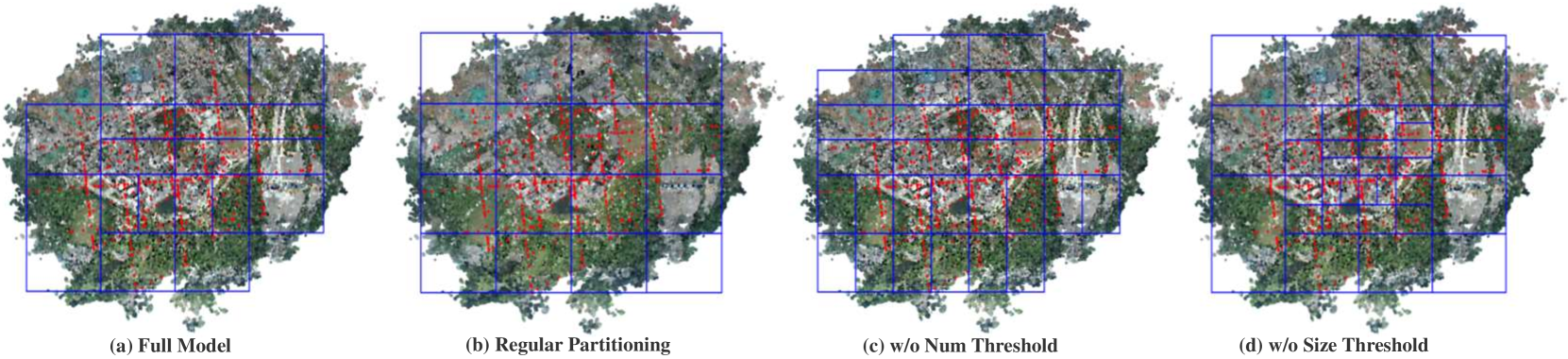

技术框架:整体框架包含以下几个主要阶段:1) 粗略模型重建:使用一种高效的方法快速构建场景的初始粗略模型。2) 自适应场景分割:将场景分割成多个子场景,以便并行处理和优化。3) 子场景细化:对每个子场景进行精细化重建,提高局部细节的精度。4) 外观解耦:使用解耦的外观模型来捕获全局光照变化,提高模型对光照变化的鲁棒性。5) 瞬态物体掩码:使用瞬态物体掩码来过滤掉移动物体的影响,避免其干扰场景重建。

关键创新:论文的关键创新点在于:1) 粗细结合的重建策略:通过先粗后精的方式,有效降低了计算复杂度,使其能够处理大规模场景。2) 解耦外观模型:能够更好地处理光照变化,提高重建质量。3) 瞬态物体掩码:能够有效去除移动物体的影响,提高重建的鲁棒性。4) 单视图正则化:针对纹理缺失区域,引入单视图正则化约束,提升重建效果。

关键设计:论文中一些关键的设计细节包括:1) 自适应场景分割策略:具体如何根据场景内容进行分割,分割的粒度如何确定。2) 解耦外观模型的具体实现:如何将外观信息从几何信息中分离出来,以及如何建模外观变化。3) 瞬态物体掩码的生成方法:如何检测和分割移动物体。4) 损失函数的设计:如何平衡重建精度、光照一致性和几何约束。这些细节决定了方法的最终性能。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法在GauU-Scene V2数据集上取得了显著的性能提升,优于现有的基于NeRF和基于高斯的方法。通过全尺寸图像优化,实现了高保真视觉效果和精确的表面重建。具体性能数据(如PSNR、SSIM等指标)以及与具体基线方法的对比结果将在开源代码中提供。

🎯 应用场景

该研究成果可广泛应用于航测建模、自动驾驶环境感知、城市三维重建、虚拟现实内容生成等领域。通过高精度、高效率地重建大规模场景,可以为自动驾驶车辆提供更准确的环境信息,为城市规划提供更真实的三维模型,并为虚拟现实应用创造更逼真的体验。未来,该技术有望进一步拓展到文物保护、灾害评估等领域。

📄 摘要(原文)

Recent developments in 3D Gaussian Splatting have made significant advances in surface reconstruction. However, scaling these methods to large-scale scenes remains challenging due to high computational demands and the complex dynamic appearances typical of outdoor environments. These challenges hinder the application in aerial surveying and autonomous driving. This paper proposes a novel solution to reconstruct large-scale surfaces with fine details, supervised by full-sized images. Firstly, we introduce a coarse-to-fine strategy to reconstruct a coarse model efficiently, followed by adaptive scene partitioning and sub-scene refining from image segments. Additionally, we integrate a decoupling appearance model to capture global appearance variations and a transient mask model to mitigate interference from moving objects. Finally, we expand the multi-view constraint and introduce a single-view regularization for texture-less areas. Our experiments were conducted on the publicly available dataset GauU-Scene V2, which was captured using unmanned aerial vehicles. To the best of our knowledge, our method outperforms existing NeRF-based and Gaussian-based methods, achieving high-fidelity visual results and accurate surface from full-size image optimization. Open-source code will be available on GitHub.