WIR3D: Visually-Informed and Geometry-Aware 3D Shape Abstraction

作者: Richard Liu, Daniel Fu, Noah Tan, Itai Lang, Rana Hanocka

分类: cs.GR, cs.CV

发布日期: 2025-05-07 (更新: 2025-08-18)

备注: ICCV 2025 Oral Project page: https://threedle.github.io/wir3d/

💡 一句话要点

WIR3D:通过视觉信息与几何感知的三维形状抽象

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 三维形状抽象 视觉信息 几何感知 贝塞尔曲线 CLIP模型 神经SDF 形状变形

📋 核心要点

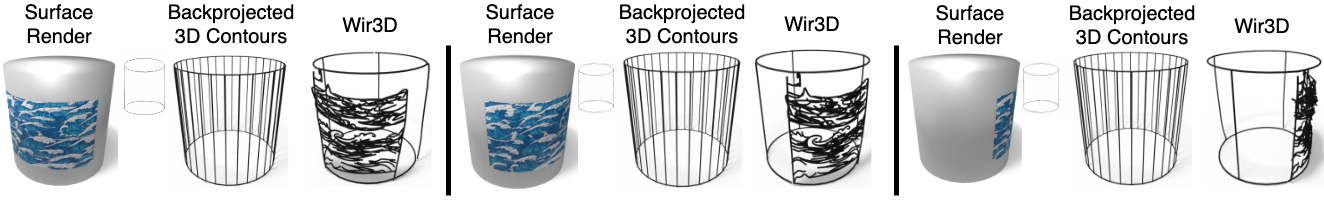

- 现有三维形状抽象方法难以兼顾几何保真度和视觉显著性,尤其是在纹理丰富的模型上。

- WIR3D利用预训练CLIP模型的视觉知识,通过优化贝塞尔曲线来同时捕捉几何结构和视觉特征。

- 实验表明,WIR3D在各种复杂形状上都能生成高质量的抽象结果,并支持特征控制和形状变形等应用。

📝 摘要(中文)

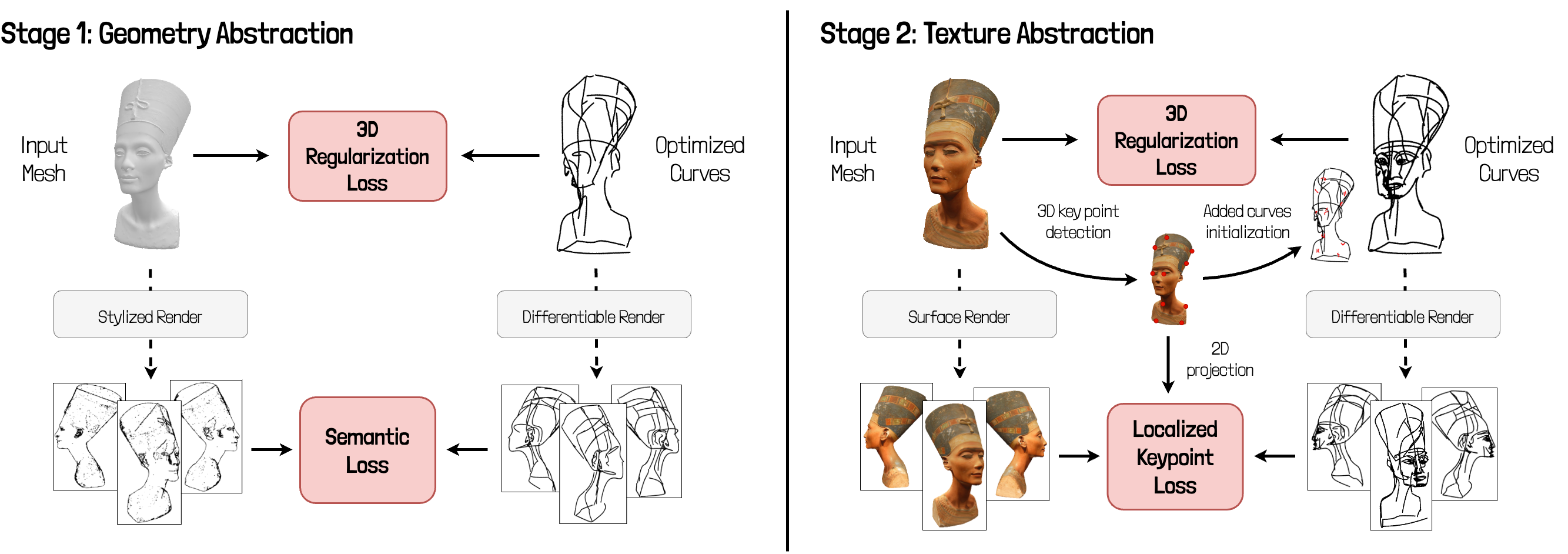

本文提出了一种名为WIR3D的技术,用于通过一组稀疏的、具有视觉意义的三维曲线来抽象三维形状。我们优化贝塞尔曲线的参数,使其能够忠实地表示形状的几何结构和显著的视觉特征(例如纹理),并从任意视角进行观察。我们利用预训练的基础模型(CLIP)的中间激活来指导我们的优化过程。我们将优化过程分为两个阶段:一个阶段用于捕获形状的粗略几何结构,另一个阶段用于表示精细的特征。我们第二阶段的监督由一种新颖的局部关键点损失进行空间引导。这种空间引导使得用户能够控制抽象的特征。我们通过神经SDF损失来确保对原始表面的保真度,这使得曲线能够被用作直观的变形控制柄。我们成功地将我们的方法应用于具有不同复杂度、几何结构和纹理的广泛形状数据集,并展示了特征控制和形状变形的下游应用。

🔬 方法详解

问题定义:现有的三维形状抽象方法通常侧重于几何结构的简化,忽略了视觉特征的重要性,导致抽象结果在视觉上不够显著或无法保留关键的纹理信息。此外,用户难以对抽象结果进行精细的控制,例如指定需要保留的特定视觉特征。

核心思路:WIR3D的核心思路是利用预训练的CLIP模型所学习到的丰富的视觉知识,指导贝塞尔曲线的优化过程,使其能够同时捕捉三维形状的几何结构和视觉特征。通过将视觉信息融入到优化目标中,WIR3D能够生成更具视觉意义的抽象结果,并允许用户通过空间引导的方式控制抽象的特征。

技术框架:WIR3D的整体框架包含两个主要的优化阶段。第一阶段,通过优化贝塞尔曲线的参数,捕获三维形状的粗略几何结构。第二阶段,利用局部关键点损失,对曲线进行精细调整,以更好地表示形状的视觉特征。神经SDF损失用于确保抽象结果与原始表面的保真度。整个流程以预训练的CLIP模型作为视觉信息的来源,并利用其中间激活来指导优化过程。

关键创新:WIR3D最重要的技术创新点在于将预训练的视觉模型(CLIP)的知识融入到三维形状抽象的过程中。通过利用CLIP模型的中间激活,WIR3D能够有效地捕捉形状的视觉特征,并将其融入到抽象结果中。此外,局部关键点损失的设计使得用户能够通过空间引导的方式控制抽象的特征,从而实现更灵活的形状抽象。

关键设计:WIR3D的关键设计包括:1) 使用贝塞尔曲线作为形状抽象的基本元素,因为贝塞尔曲线具有良好的可控性和表达能力;2) 利用预训练CLIP模型的中间激活作为视觉信息的来源,通过计算曲线渲染图像与原始图像之间的CLIP特征差异来指导优化;3) 设计局部关键点损失,通过指定关键点的位置,引导曲线更好地表示形状的视觉特征;4) 使用神经SDF损失,确保抽象结果与原始表面的保真度。

🖼️ 关键图片

📊 实验亮点

WIR3D在各种复杂形状上都取得了良好的抽象效果,能够有效地捕捉形状的几何结构和视觉特征。通过用户指定的关键点,WIR3D能够灵活地控制抽象的特征,并生成具有视觉意义的抽象结果。实验结果表明,WIR3D在形状变形等下游应用中也表现出色,能够实现对三维模型的直观编辑。

🎯 应用场景

WIR3D技术可应用于三维模型的简化、编辑和变形。例如,在游戏开发中,可以使用WIR3D快速生成低多边形模型,同时保留关键的视觉特征。在动画制作中,可以将抽象曲线作为变形控制柄,实现对三维模型的直观编辑。此外,WIR3D还可以用于三维模型的风格化和艺术创作,为用户提供更丰富的创作工具。

📄 摘要(原文)

In this work we present WIR3D, a technique for abstracting 3D shapes through a sparse set of visually meaningful curves in 3D. We optimize the parameters of Bezier curves such that they faithfully represent both the geometry and salient visual features (e.g. texture) of the shape from arbitrary viewpoints. We leverage the intermediate activations of a pre-trained foundation model (CLIP) to guide our optimization process. We divide our optimization into two phases: one for capturing the coarse geometry of the shape, and the other for representing fine-grained features. Our second phase supervision is spatially guided by a novel localized keypoint loss. This spatial guidance enables user control over abstracted features. We ensure fidelity to the original surface through a neural SDF loss, which allows the curves to be used as intuitive deformation handles. We successfully apply our method for shape abstraction over a broad dataset of shapes with varying complexity, geometric structure, and texture, and demonstrate downstream applications for feature control and shape deformation.