Sketch2Anim: Towards Transferring Sketch Storyboards into 3D Animation

作者: Lei Zhong, Chuan Guo, Yiming Xie, Jiawei Wang, Changjian Li

分类: cs.GR, cs.CV

发布日期: 2025-04-27

备注: Project page: https://zhongleilz.github.io/Sketch2Anim/

💡 一句话要点

Sketch2Anim:提出一种将草图故事板转化为3D动画的框架。

🎯 匹配领域: 支柱四:生成式动作 (Generative Motion)

关键词: 3D动画生成 草图动画 条件运动合成 神经映射 运动扩散模型

📋 核心要点

- 传统3D动画制作依赖人工,耗时且需要专业技能,缺乏自动化的2D草图到3D动画转换方法。

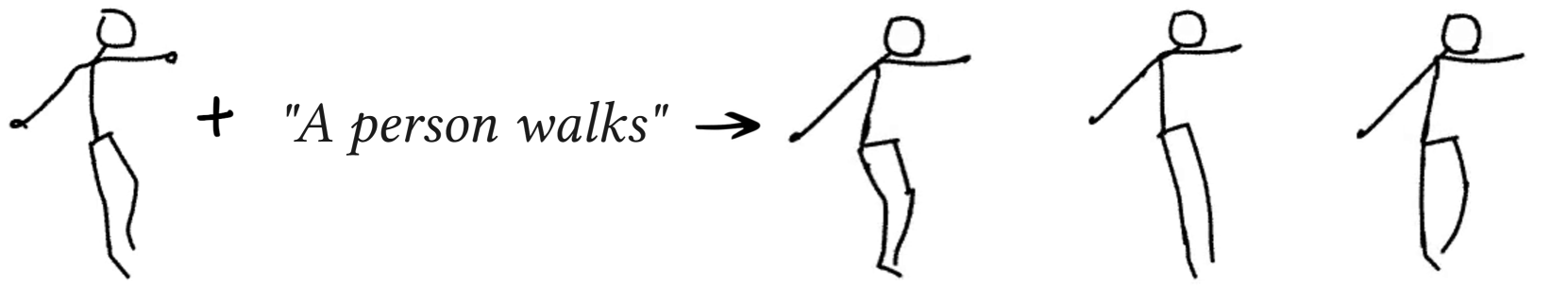

- Sketch2Anim通过条件运动合成,利用3D关键姿势、关节轨迹和动作词实现精确的运动控制。

- 该方法通过神经映射器对齐2D草图和3D运动,实现直接的2D草图控制3D动画生成,实验证明有效。

📝 摘要(中文)

故事板被广泛应用于创建3D动画。动画师通常以故事板中的2D草图作为参考,通过反复试验来制作所需的3D动画。传统方法需要专业的技能,并且耗时耗力。因此,迫切需要能够直接将2D故事板草图转化为3D动画的自动化方法。目前对该任务的研究尚不充分。受到运动扩散模型显著进展的启发,我们从条件运动合成的角度来解决这个问题。我们提出了Sketch2Anim,它由草图约束理解和运动生成两个关键模块组成。具体来说,由于2D草图和3D运动之间存在较大的领域差距,我们没有直接以2D输入为条件,而是设计了一个3D条件运动生成器,它同时利用3D关键姿势、关节轨迹和动作词,以实现精确和细粒度的运动控制。然后,我们发明了一个神经映射器,专门用于将用户提供的2D草图与其对应的3D关键姿势和轨迹在共享嵌入空间中对齐,从而首次实现了对运动生成的直接2D控制。我们的方法成功地将故事板转化为高质量的3D运动,并且由于我们的多条件运动生成器的灵活性,它本身就支持直接的3D动画编辑。全面的实验和评估以及用户感知研究证明了我们方法的有效性。

🔬 方法详解

问题定义:论文旨在解决将2D草图故事板自动转化为3D动画的问题。现有方法依赖于动画师手动制作,过程繁琐耗时,且需要专业技能。缺乏一种能够直接利用2D草图生成高质量3D动画的自动化方法。

核心思路:论文的核心思路是将2D草图到3D动画的转换视为一个条件运动合成问题。通过学习2D草图与3D运动之间的映射关系,实现利用2D草图控制3D动画的生成。这种方法避免了直接从2D输入生成3D运动的困难,而是通过中间表示(3D关键姿势、关节轨迹和动作词)来实现更精确的控制。

技术框架:Sketch2Anim框架包含两个主要模块:草图约束理解模块和运动生成模块。首先,草图约束理解模块负责将2D草图映射到3D关键姿势和轨迹的嵌入空间。然后,运动生成模块利用这些3D信息以及动作词作为条件,生成最终的3D动画。整体流程是从2D草图到3D关键姿势和轨迹,再到3D动画的生成。

关键创新:该论文的关键创新在于提出了一个神经映射器,用于对齐2D草图和3D关键姿势/轨迹。这使得可以直接利用2D草图来控制3D动画的生成,而无需手动指定3D关键帧。此外,多条件运动生成器的设计也允许灵活地编辑3D动画。

关键设计:神经映射器可能采用了对比学习或度量学习的方法,以学习2D草图和3D关键姿势/轨迹之间的相似性。运动生成器可能基于扩散模型或生成对抗网络(GAN),并使用3D关键姿势、关节轨迹和动作词作为条件输入。损失函数可能包括重构损失、对抗损失和条件损失等。

🖼️ 关键图片

📊 实验亮点

论文通过实验验证了Sketch2Anim的有效性,能够将2D草图转化为高质量的3D动画。用户感知研究表明,生成的3D动画在视觉质量和动作自然度方面表现良好。具体的性能数据和对比基线(如果论文中提供)未知,但摘要强调了该方法在3D动画编辑方面的灵活性。

🎯 应用场景

该研究成果可应用于游戏开发、动画制作、虚拟现实等领域,降低3D动画制作的门槛,提高生产效率。动画师可以直接通过草图故事板快速生成3D动画原型,并进行编辑和修改。未来,该技术有望实现更智能化的动画创作,例如根据用户提供的草图自动生成完整的3D动画场景。

📄 摘要(原文)

Storyboarding is widely used for creating 3D animations. Animators use the 2D sketches in storyboards as references to craft the desired 3D animations through a trial-and-error process. The traditional approach requires exceptional expertise and is both labor-intensive and time-consuming. Consequently, there is a high demand for automated methods that can directly translate 2D storyboard sketches into 3D animations. This task is under-explored to date and inspired by the significant advancements of motion diffusion models, we propose to address it from the perspective of conditional motion synthesis. We thus present Sketch2Anim, composed of two key modules for sketch constraint understanding and motion generation. Specifically, due to the large domain gap between the 2D sketch and 3D motion, instead of directly conditioning on 2D inputs, we design a 3D conditional motion generator that simultaneously leverages 3D keyposes, joint trajectories, and action words, to achieve precise and fine-grained motion control. Then, we invent a neural mapper dedicated to aligning user-provided 2D sketches with their corresponding 3D keyposes and trajectories in a shared embedding space, enabling, for the first time, direct 2D control of motion generation. Our approach successfully transfers storyboards into high-quality 3D motions and inherently supports direct 3D animation editing, thanks to the flexibility of our multi-conditional motion generator. Comprehensive experiments and evaluations, and a user perceptual study demonstrate the effectiveness of our approach.