GSAC: Leveraging Gaussian Splatting for Photorealistic Avatar Creation with Unity Integration

作者: Rendong Zhang, Alexandra Watkins, Nilanjan Sarkar

分类: cs.GR, cs.CV

发布日期: 2025-04-17

💡 一句话要点

GSAC:利用高斯溅射和Unity集成创建逼真化身

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 高斯溅射 化身创建 单目视频 Unity集成 虚拟现实 增强现实 实时渲染 面部表情重建

📋 核心要点

- 现有化身创建方法成本高、耗时长,且在虚拟应用中效果有限,难以满足实时性和高保真需求。

- 提出一种端到端的3D高斯溅射(3DGS)化身创建流程,利用单目视频输入,直接与Unity游戏引擎兼容。

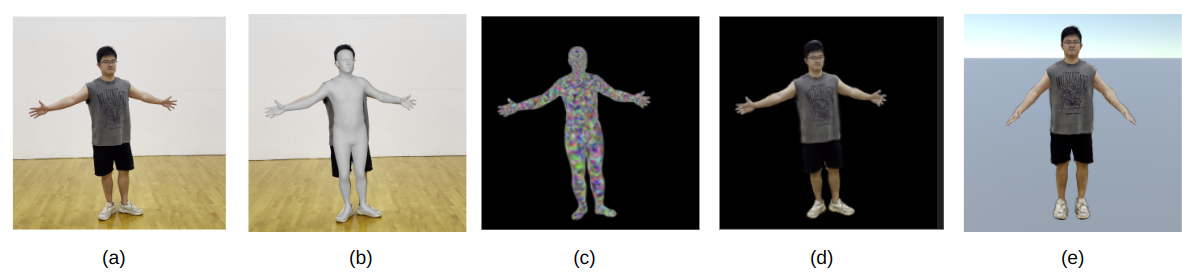

- 实验验证了预处理流程在标准化自定义数据以进行3DGS训练方面的有效性,并展示了高斯化身在Unity中的多功能性。

📝 摘要(中文)

逼真化身在虚拟现实(VR)和增强现实(AR)等沉浸式应用中至关重要,可在培训模拟、远程医疗和虚拟协作等领域实现栩栩如生的交互。这些化身弥合了物理世界和数字世界之间的差距,通过逼真的人类表现改善用户体验。然而,现有的化身创建技术面临着高成本、长创建时间和在虚拟应用中效用有限等重大挑战。手动方法(如MetaHuman)需要大量时间和专业知识,而基于NeRF的自动方法通常缺乏效率、详细的面部表情保真度,并且无法以足够的速度渲染以用于实时应用。我们引入了一个端到端的3D高斯溅射(3DGS)化身创建流程,该流程利用单目视频输入来创建可扩展且高效的逼真化身,并直接与Unity游戏引擎兼容。我们的流程结合了一种新颖的高斯溅射技术,通过定制的预处理,可以使用“野外”单目视频捕获,详细的面部表情重建,并嵌入到完全绑定的化身模型中。此外,我们还提出了一个Unity集成的Gaussian Splatting Avatar Editor,为VR/AR应用程序开发提供了一个用户友好的环境。实验结果验证了我们的预处理流程在标准化自定义数据以进行3DGS训练方面的有效性,并展示了高斯化身在Unity中的多功能性,突出了我们方法的可扩展性和实用性。

🔬 方法详解

问题定义:论文旨在解决现有化身创建技术成本高昂、耗时过长,以及在虚拟现实/增强现实(VR/AR)应用中难以实现实时渲染和高保真度面部表情的问题。现有方法,如MetaHuman需要大量人工干预,而基于NeRF的方法则在效率和细节保真度方面存在不足。

核心思路:论文的核心思路是利用3D高斯溅射(3DGS)技术,结合定制的预处理流程,从单目视频中高效地创建逼真且可实时渲染的化身。通过将化身表示为3D高斯分布的集合,可以实现快速渲染和可扩展性,同时保留细节丰富的面部表情。

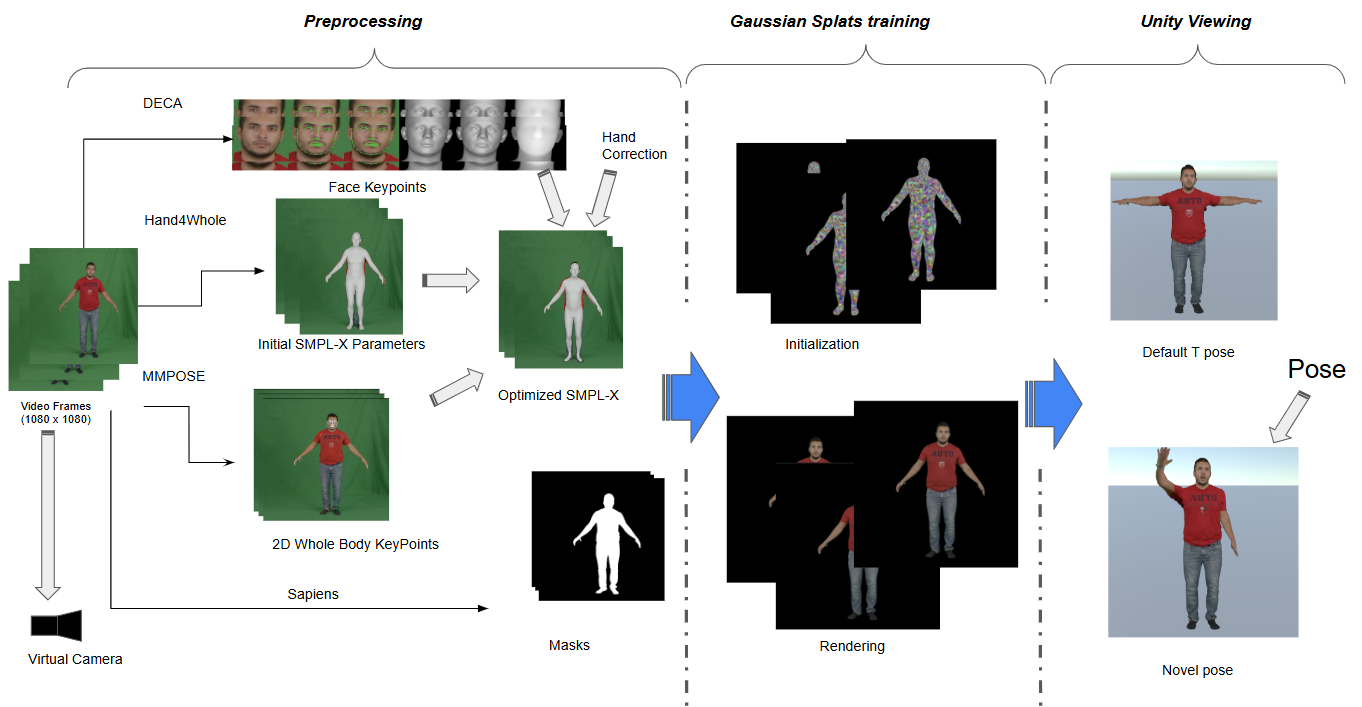

技术框架:该流程包含以下主要阶段:1) 单目视频捕获和预处理,用于标准化输入数据;2) 基于高斯溅射的化身重建,将视频数据转换为3D高斯分布;3) 化身绑定,将高斯溅射表示嵌入到完全绑定的化身模型中;4) Unity集成,提供用户友好的编辑器,用于在VR/AR应用中编辑和使用化身。

关键创新:论文的关键创新在于将高斯溅射技术应用于化身创建,并设计了一个定制的预处理流程,使其能够处理“野外”单目视频输入。此外,论文还提出了一个Unity集成的Gaussian Splatting Avatar Editor,简化了化身在VR/AR应用中的使用。与现有方法相比,该方法在效率、面部表情保真度和易用性方面具有优势。

关键设计:预处理流程可能包含图像校正、人脸检测和跟踪等步骤,以确保输入数据的质量和一致性。高斯溅射的训练可能涉及优化高斯分布的参数(如位置、协方差和颜色),以最小化重建误差。化身绑定可能使用现有的骨骼绑定技术,将高斯溅射表示与骨骼结构对齐。损失函数可能包括重建损失、正则化项等,以提高重建质量和模型的泛化能力。具体的参数设置和网络结构细节在论文中可能有所描述,但此处未知。

🖼️ 关键图片

📊 实验亮点

论文验证了所提出的预处理流程在标准化自定义数据以进行3DGS训练方面的有效性,并展示了高斯化身在Unity中的多功能性。实验结果表明,该方法能够从单目视频中创建逼真且可实时渲染的化身,并在Unity环境中实现高效的编辑和使用。具体的性能数据和对比基线未知,但论文强调了该方法的可扩展性和实用性。

🎯 应用场景

该研究成果可广泛应用于虚拟现实(VR)、增强现实(AR)、远程医疗、培训模拟、虚拟协作等领域。逼真化身能够提升用户在虚拟环境中的沉浸感和交互体验,促进更自然、高效的人机交互。未来,该技术有望应用于个性化教育、虚拟社交、数字娱乐等更多领域。

📄 摘要(原文)

Photorealistic avatars have become essential for immersive applications in virtual reality (VR) and augmented reality (AR), enabling lifelike interactions in areas such as training simulations, telemedicine, and virtual collaboration. These avatars bridge the gap between the physical and digital worlds, improving the user experience through realistic human representation. However, existing avatar creation techniques face significant challenges, including high costs, long creation times, and limited utility in virtual applications. Manual methods, such as MetaHuman, require extensive time and expertise, while automatic approaches, such as NeRF-based pipelines often lack efficiency, detailed facial expression fidelity, and are unable to be rendered at a speed sufficent for real-time applications. By involving several cutting-edge modern techniques, we introduce an end-to-end 3D Gaussian Splatting (3DGS) avatar creation pipeline that leverages monocular video input to create a scalable and efficient photorealistic avatar directly compatible with the Unity game engine. Our pipeline incorporates a novel Gaussian splatting technique with customized preprocessing that enables the user of "in the wild" monocular video capture, detailed facial expression reconstruction and embedding within a fully rigged avatar model. Additionally, we present a Unity-integrated Gaussian Splatting Avatar Editor, offering a user-friendly environment for VR/AR application development. Experimental results validate the effectiveness of our preprocessing pipeline in standardizing custom data for 3DGS training and demonstrate the versatility of Gaussian avatars in Unity, highlighting the scalability and practicality of our approach.