SOPHY: Learning to Generate Simulation-Ready Objects with Physical Materials

作者: Junyi Cao, Evangelos Kalogerakis

分类: cs.GR, cs.CV

发布日期: 2025-04-17 (更新: 2025-08-11)

备注: Project page: https://xjay18.github.io/SOPHY_page

💡 一句话要点

SOPHY:学习生成具有物理材质的、可用于仿真的3D物体

🎯 匹配领域: 支柱四:生成式动作 (Generative Motion)

关键词: 3D生成模型 物理材质 形状合成 物理仿真 交互式环境

📋 核心要点

- 现有3D生成模型主要关注静态几何或生成与物理无关的动画,缺乏对物理属性的建模,限制了其在动态环境中的应用。

- SOPHY通过联合生成形状、纹理和物理材质属性,使得生成的3D对象可以直接用于物理仿真和交互式环境。

- 论文构建了带有详细物理材质属性标注的3D对象数据集,并通过实验验证了联合建模形状和材质属性的有效性。

📝 摘要(中文)

SOPHY是一个用于3D物理感知形状合成的生成模型。与仅关注静态几何体的现有3D生成模型或生成与物理无关动画的4D模型不同,SOPHY联合合成形状、纹理和与物理相关的材质属性,使生成的对象可用于仿真和交互式动态环境。为了训练模型,论文引入了一个带有详细物理材质属性标注的3D对象数据集,以及一个高效的材质标注流程。SOPHY支持文本驱动的交互式、物理感知3D对象生成,以及物理上合理的形状的单图像重建等应用。实验表明,联合建模形状和材质属性可以增强生成形状的真实性和保真度,从而提高生成几何体和物理合理性的性能。

🔬 方法详解

问题定义:现有3D生成模型主要关注静态几何形状,或者生成与物理无关的动画。这些模型无法生成可以直接用于物理仿真和交互式动态环境的3D对象。因此,需要一种能够同时生成形状和物理材质属性的模型,使得生成的对象具有物理合理性。

核心思路:SOPHY的核心思路是联合建模3D对象的形状、纹理和物理材质属性。通过学习形状和材质之间的关联,SOPHY可以生成具有物理合理性的3D对象,从而可以直接用于物理仿真和交互式环境。这种联合建模的方式能够提升生成对象的真实感和保真度。

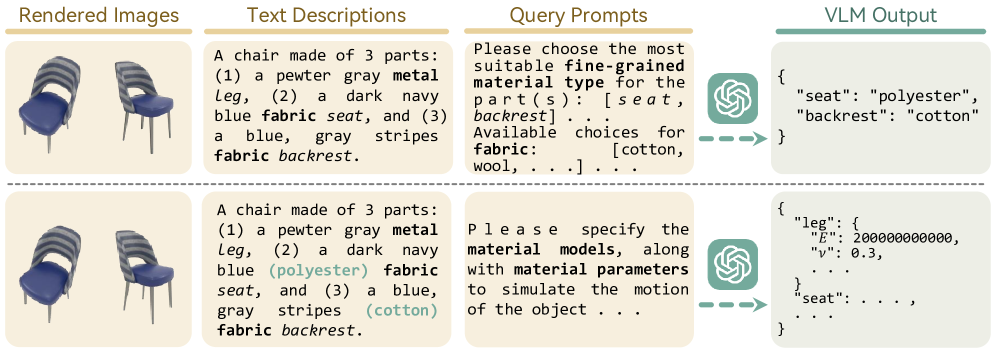

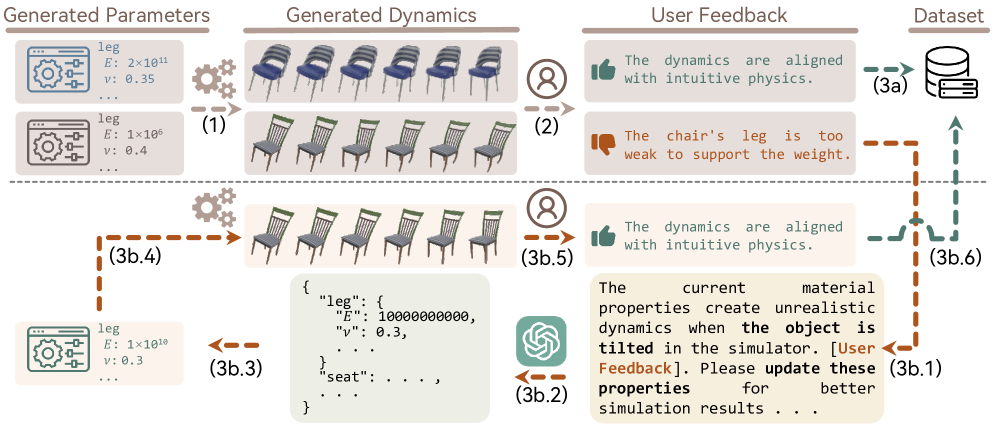

技术框架:SOPHY的整体框架包含一个生成器网络和一个判别器网络。生成器网络负责生成3D对象的形状、纹理和物理材质属性,判别器网络负责判断生成的对象是否真实。训练过程中,生成器和判别器相互对抗,不断提升生成对象的质量。此外,论文还提出了一个高效的材质标注流程,用于构建训练数据集。

关键创新:SOPHY的关键创新在于联合建模形状和物理材质属性。与以往只关注几何形状的生成模型不同,SOPHY同时考虑了形状和材质对物理行为的影响,从而生成更真实的3D对象。此外,论文提出的材质标注流程也为构建大规模的物理感知3D对象数据集提供了可能。

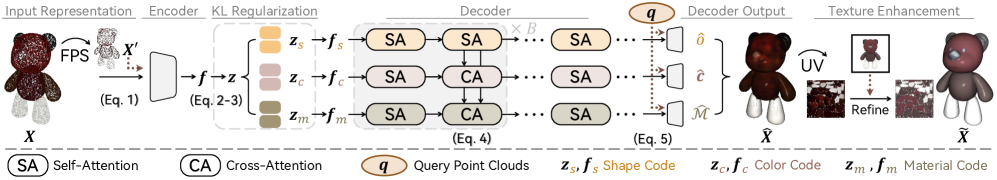

关键设计:SOPHY使用了变分自编码器(VAE)作为生成器网络,用于学习形状、纹理和材质属性的潜在空间表示。判别器网络则采用卷积神经网络(CNN)来判断生成对象的真实性。损失函数包括对抗损失、重构损失和物理合理性损失。物理合理性损失用于约束生成的材质属性,使其符合物理规律。具体的网络结构和参数设置在论文中有详细描述。

🖼️ 关键图片

📊 实验亮点

实验结果表明,SOPHY能够生成具有物理合理性的3D对象,并且在生成几何体和物理合理性方面都优于现有方法。例如,SOPHY生成的对象在物理仿真中表现出更真实的动态行为。此外,SOPHY在文本驱动的3D对象生成和单图像三维重建等任务中也取得了良好的效果,证明了其泛化能力。

🎯 应用场景

SOPHY的应用场景广泛,包括游戏开发、机器人仿真、虚拟现实和增强现实等领域。它可以用于生成具有物理交互能力的3D对象,例如可用于游戏中的可破坏物体、可用于机器人仿真的物理模型,以及可用于VR/AR环境中的交互式对象。SOPHY还可以用于单图像三维重建,生成具有物理合理性的三维模型,提升重建结果的真实感。

📄 摘要(原文)

We present SOPHY, a generative model for 3D physics-aware shape synthesis. Unlike existing 3D generative models that focus solely on static geometry or 4D models that produce physics-agnostic animations, our method jointly synthesizes shape, texture, and material properties related to physics-grounded dynamics, making the generated objects ready for simulations and interactive, dynamic environments. To train our model, we introduce a dataset of 3D objects annotated with detailed physical material attributes, along with an efficient pipeline for material annotation. Our method enables applications such as text-driven generation of interactive, physics-aware 3D objects and single-image reconstruction of physically plausible shapes. Furthermore, our experiments show that jointly modeling shape and material properties enhances the realism and fidelity of the generated shapes, improving performance on both generative geometry and physical plausibility.