Let it Snow! Animating 3D Gaussian Scenes with Dynamic Weather Effects via Physics-Guided Score Distillation

作者: Gal Fiebelman, Hadar Averbuch-Elor, Sagie Benaim

分类: cs.GR, cs.CV

发布日期: 2025-04-07 (更新: 2025-11-27)

备注: Project webpage: https://galfiebelman.github.io/let-it-snow/

💡 一句话要点

提出基于物理引导的分数蒸馏方法,实现3D高斯场景中动态天气特效的逼真动画

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱三:空间感知与语义 (Perception & Semantics) 支柱四:生成式动作 (Generative Motion)

关键词: 3D高斯溅射 动态场景编辑 物理模拟 分数蒸馏采样 神经动力学 天气特效 运动先验

📋 核心要点

- 现有3D高斯场景编辑方法难以实现逼真的动态效果,尤其是在复杂多粒子天气场景中,缺乏有效的运动先验。

- 论文提出物理引导的分数蒸馏方法,利用物理模拟提供运动先验,并结合分数蒸馏采样优化外观,实现逼真动态效果。

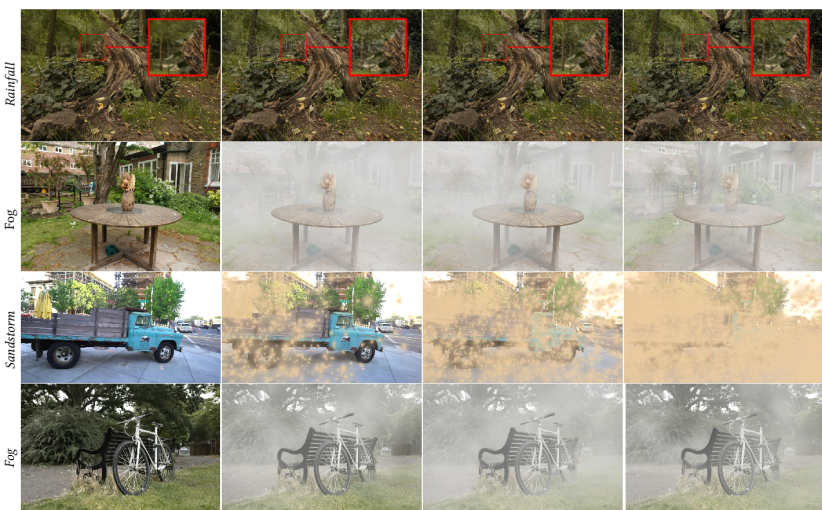

- 实验结果表明,该方法在生成连贯、高保真动态天气效果方面显著优于现有方法,证明了联合优化的有效性。

📝 摘要(中文)

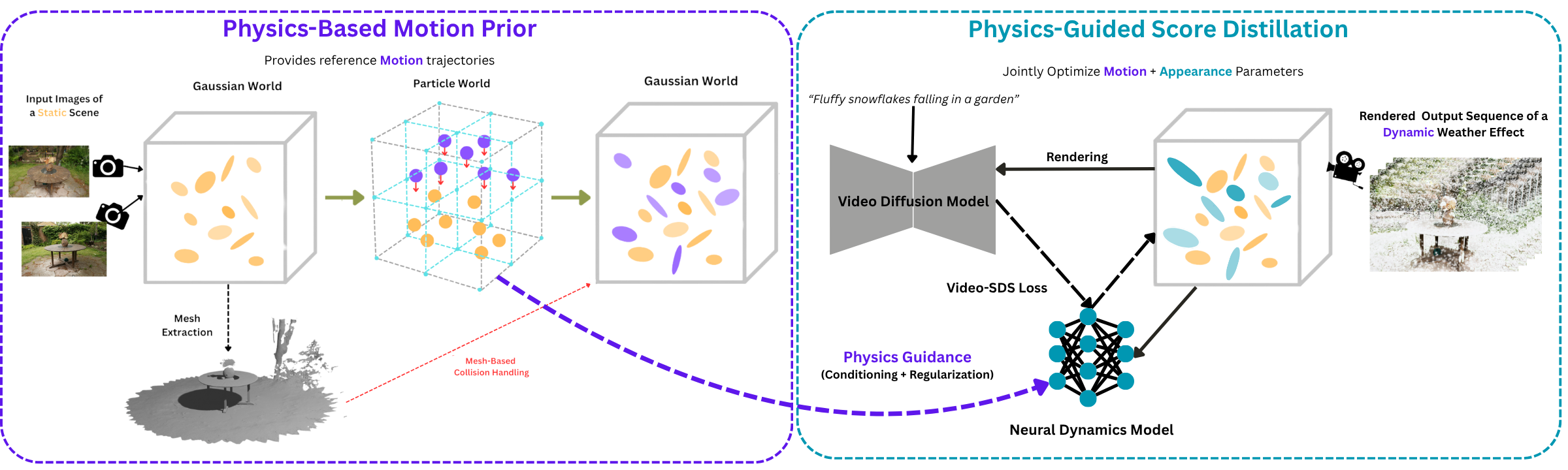

本文提出了一种新的框架,即物理引导的分数蒸馏(Physics-Guided Score Distillation),用于解决3D高斯溅射场景的动态编辑问题。该方法旨在解决物理模拟提供的强运动先验不足以实现照片级真实感,而单独使用基于视频的分数蒸馏采样(SDS)又无法为复杂的多粒子场景生成连贯运动的矛盾。通过统一的优化框架,物理模拟引导分数蒸馏,从而联合优化运动先验以实现照片级真实感,同时优化外观。具体而言,本文学习了一个神经动力学模型,该模型预测粒子运动和外观,并通过结合视频SDS损失和物理引导先验的联合损失进行端到端优化。这使得在确保动力学合理性的同时,实现照片级真实感的改进。该框架能够实现场景范围内的动态天气效果,包括降雪、降雨、雾和沙尘暴,并具有物理上合理的运动。实验表明,本文的物理引导方法明显优于基线方法,消融实验证实了这种联合改进对于生成连贯、高保真动力学至关重要。

🔬 方法详解

问题定义:现有的3D高斯溅射技术能够快速且逼真地重建静态3D场景,但如何对这些场景进行动态编辑仍然是一个巨大的挑战。尤其是在模拟复杂的多粒子系统,如降雪、降雨等天气效果时,仅仅依赖视觉信息难以保证运动的连贯性和真实性。物理模拟虽然可以提供合理的运动先验,但其渲染效果往往不够逼真,无法达到照片级的真实感。

核心思路:本文的核心思路是将物理模拟和基于视频的分数蒸馏采样(Score Distillation Sampling, SDS)相结合,利用物理模拟提供运动的先验知识,并使用SDS来优化场景的外观,从而在保证运动合理性的同时,实现照片级的渲染效果。通过联合优化,使得物理模拟引导SDS,从而生成连贯且高保真的动态效果。

技术框架:该框架包含两个主要组成部分:神经动力学模型和分数蒸馏采样。神经动力学模型用于预测粒子的运动和外观变化,该模型基于物理模拟的结果进行训练。分数蒸馏采样则用于优化场景的渲染效果,使其更加逼真。整个框架通过一个联合损失函数进行端到端优化,该损失函数结合了视频SDS损失和物理引导先验。

关键创新:该方法最重要的创新点在于将物理模拟和分数蒸馏采样相结合,从而解决了在动态场景编辑中运动连贯性和渲染真实性之间的矛盾。通过物理模拟提供运动先验,并使用分数蒸馏采样优化外观,实现了照片级真实感的动态天气效果。

关键设计:在技术细节上,该方法学习了一个神经动力学模型,用于预测粒子的运动和外观。该模型通过结合视频SDS损失和物理引导先验的联合损失进行端到端优化。具体而言,物理引导先验可能涉及到对粒子运动轨迹的约束,例如,限制粒子的速度和加速度,使其符合物理规律。此外,损失函数的设计也至关重要,需要平衡物理模拟和分数蒸馏采样之间的权重,以获得最佳的渲染效果。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法在生成动态天气效果方面显著优于基线方法。通过消融实验验证了物理引导和分数蒸馏采样的联合优化对于生成连贯、高保真动态效果至关重要。具体性能数据未知,但论文强调了视觉效果上的显著提升。

🎯 应用场景

该研究成果可广泛应用于电影特效制作、游戏开发、虚拟现实和增强现实等领域。例如,可以用于创建逼真的动态天气效果,提升虚拟环境的沉浸感。此外,该技术还可以应用于机器人仿真和自动驾驶等领域,用于生成更加真实的训练数据。

📄 摘要(原文)

3D Gaussian Splatting has recently enabled fast and photorealistic reconstruction of static 3D scenes. However, dynamic editing of such scenes remains a significant challenge. We introduce a novel framework, Physics-Guided Score Distillation, to address a fundamental conflict: physics simulation provides a strong motion prior that is insufficient for photorealism , while video-based Score Distillation Sampling (SDS) alone cannot generate coherent motion for complex, multi-particle scenarios. We resolve this through a unified optimization framework where physics simulation guides Score Distillation to jointly refine the motion prior for photorealism while simultaneously optimizing appearance. Specifically, we learn a neural dynamics model that predicts particle motion and appearance, optimized end-to-end via a combined loss integrating Video-SDS for photorealism with our physics-guidance prior. This allows for photorealistic refinements while ensuring the dynamics remain plausible. Our framework enables scene-wide dynamic weather effects, including snowfall, rainfall, fog, and sandstorms, with physically plausible motion. Experiments demonstrate our physics-guided approach significantly outperforms baselines, with ablations confirming this joint refinement is essential for generating coherent, high-fidelity dynamics.