GarmageNet: A Multimodal Generative Framework for Sewing Pattern Design and Generic Garment Modeling

作者: Siran Li, Ruiyang Liu, Chen Liu, Zhendong Wang, Gaofeng He, Yong-Lu Li, Xiaogang Jin, Huamin Wang

分类: cs.GR, cs.CV

发布日期: 2025-04-02 (更新: 2025-10-14)

备注: 23 pages,20 figures

期刊: ACM Trans. Graph. 44, 6, Article 216 (2025)

DOI: 10.1145/3763271

🔗 代码/项目: PROJECT_PAGE

💡 一句话要点

GarmageNet:用于缝纫图案设计和通用服装建模的多模态生成框架

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 服装建模 生成模型 几何图像 扩散模型 缝纫图案 多模态学习 虚拟试衣 数字时尚

📋 核心要点

- 现有方法难以高效地将2D缝纫图案转化为高保真、可用于仿真的3D服装模型,这是一个劳动密集型任务。

- GarmageNet通过引入Garmage表示,将2D裁片编码为几何图像,并结合扩散Transformer和缝纫关系预测模块,实现了端到端的服装生成。

- GarmageNet在多模态服装生成、自动建模、图案恢复和服装编辑等任务上表现出优异的性能,并构建了大规模数据集GarmageSet。

📝 摘要(中文)

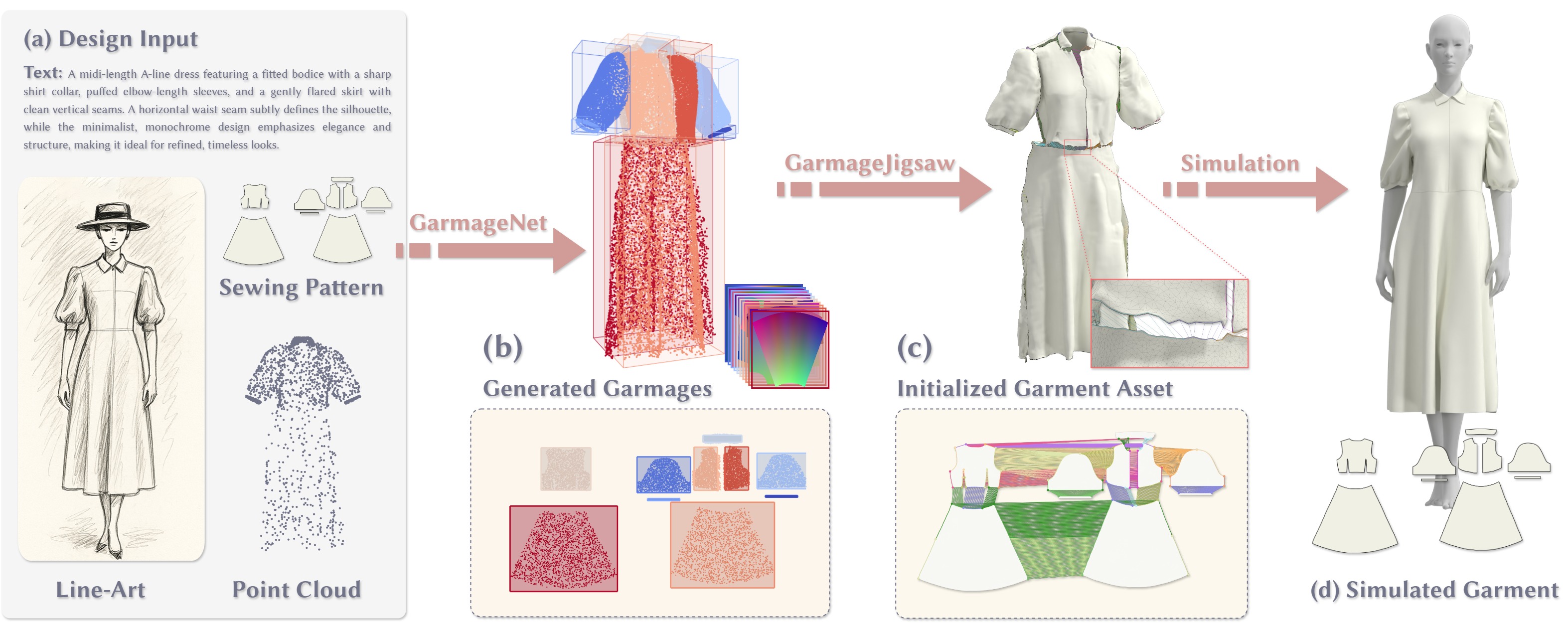

本文提出GarmageNet,一个统一的生成框架,旨在自动创建2D缝纫图案、构建缝纫关系,并合成与物理模拟兼容的3D服装初始化。核心在于Garmage,一种新颖的服装表示方法,将每个裁片编码为结构化的几何图像,有效弥合了2D结构图案和3D服装几何体之间的语义和几何差距。GarmageNet利用潜在扩散Transformer合成裁片级别的几何图像,并使用GarmageJigsaw神经模块预测裁片轮廓上的点对点缝纫连接。为了支持训练和评估,构建了GarmageSet,一个包含14,801件专业设计的服装的大规模数据集,具有详细的结构和风格注释。该方法在多种应用场景中展示了通用性和有效性,包括从多模态设计概念(文本提示、草图、照片)进行可扩展的服装生成,从原始平面缝纫图案进行自动建模,从非结构化点云恢复图案,以及使用常规指令进行渐进式服装编辑,为数字时尚中完全自动化的、可用于生产的流程奠定了基础。

🔬 方法详解

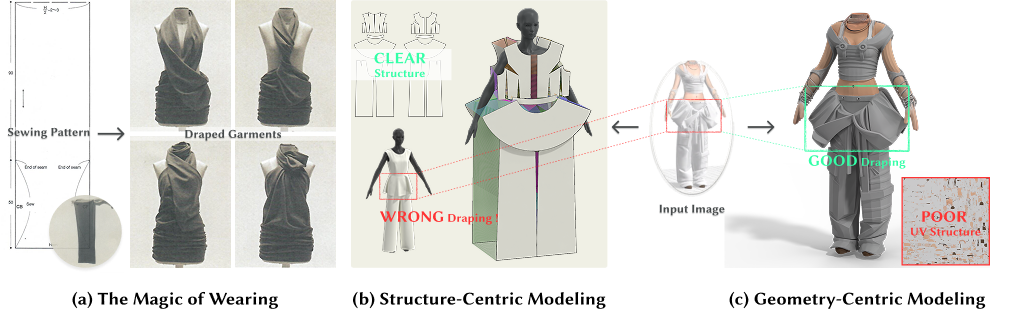

问题定义:论文旨在解决从2D缝纫图案到3D服装建模的自动化问题。现有方法通常需要大量人工干预,且难以处理复杂的服装结构和风格。痛点在于2D结构化图案和3D非结构化几何体之间的语义鸿沟,以及缝纫关系的自动推断。

核心思路:论文的核心思路是将2D缝纫图案表示为结构化的几何图像(Garmage),从而将2D图案的结构信息编码到图像中,方便后续的生成和处理。通过学习几何图像的生成和缝纫关系的预测,实现从2D到3D的自动转换。这种设计旨在弥合2D和3D之间的语义和几何差距,并简化服装建模流程。

技术框架:GarmageNet包含三个主要模块:Garmage表示、潜在扩散Transformer和GarmageJigsaw。首先,Garmage将每个裁片编码为几何图像。然后,潜在扩散Transformer用于生成裁片级别的几何图像。最后,GarmageJigsaw预测裁片轮廓上的点对点缝纫连接。整个流程实现了从设计概念到3D服装的自动生成。

关键创新:最重要的技术创新点是Garmage表示,它将2D缝纫图案转化为结构化的几何图像,从而将2D图案的结构信息编码到图像中,方便后续的生成和处理。与现有方法相比,Garmage能够更好地捕捉服装的结构信息,并简化了2D到3D的转换过程。

关键设计:Garmage使用UV参数化将2D裁片映射到图像空间,并使用深度学习模型学习几何图像的生成。潜在扩散Transformer采用U-Net结构,并结合Transformer的注意力机制,以生成高质量的几何图像。GarmageJigsaw使用图神经网络预测裁片轮廓上的点对点缝纫连接。损失函数包括几何损失、缝纫损失和对抗损失,以保证生成服装的质量和真实性。

🖼️ 关键图片

📊 实验亮点

实验结果表明,GarmageNet在服装生成质量和效率方面均优于现有方法。通过与多种基线方法进行比较,GarmageNet在FID(Fréchet Inception Distance)和IS(Inception Score)等指标上取得了显著提升。此外,GarmageNet还展示了在多模态服装生成、自动建模、图案恢复和服装编辑等任务上的优异性能。

🎯 应用场景

GarmageNet具有广泛的应用前景,包括虚拟试衣、游戏角色定制、数字服装设计和生产等领域。它可以帮助设计师快速创建和修改服装模型,降低服装设计的成本和时间。此外,该方法还可以用于服装的自动建模和图案恢复,为数字时尚产业带来革命性的变革。

📄 摘要(原文)

Realistic digital garment modeling remains a labor-intensive task due to the intricate process of translating 2D sewing patterns into high-fidelity, simulation-ready 3D garments. We introduce GarmageNet, a unified generative framework that automates the creation of 2D sewing patterns, the construction of sewing relationships, and the synthesis of 3D garment initializations compatible with physics-based simulation. Central to our approach is Garmage, a novel garment representation that encodes each panel as a structured geometry image, effectively bridging the semantic and geometric gap between 2D structural patterns and 3D garment geometries. Followed by GarmageNet, a latent diffusion transformer to synthesize panel-wise geometry images and GarmageJigsaw, a neural module for predicting point-to-point sewing connections along panel contours. To support training and evaluation, we build GarmageSet, a large-scale dataset comprising 14,801 professionally designed garments with detailed structural and style annotations. Our method demonstrates versatility and efficacy across multiple application scenarios, including scalable garment generation from multi-modal design concepts (text prompts, sketches, photographs), automatic modeling from raw flat sewing patterns, pattern recovery from unstructured point clouds, and progressive garment editing using conventional instructions, laying the foundation for fully automated, production-ready pipelines in digital fashion. Project page: https://style3d.github.io/garmagenet/.