Gaussian Blending Unit: An Edge GPU Plug-in for Real-Time Gaussian-Based Rendering in AR/VR

作者: Zhifan Ye, Yonggan Fu, Jingqun Zhang, Leshu Li, Yongan Zhang, Sixu Li, Cheng Wan, Chenxi Wan, Chaojian Li, Sreemanth Prathipati, Yingyan Celine Lin

分类: cs.GR, cs.AR

发布日期: 2025-03-30

备注: Accepted by HPCA 2025

💡 一句话要点

提出高斯混合单元GBU,加速边缘GPU上AR/VR高斯渲染

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 高斯溅射 实时渲染 边缘计算 AR/VR GPU加速

📋 核心要点

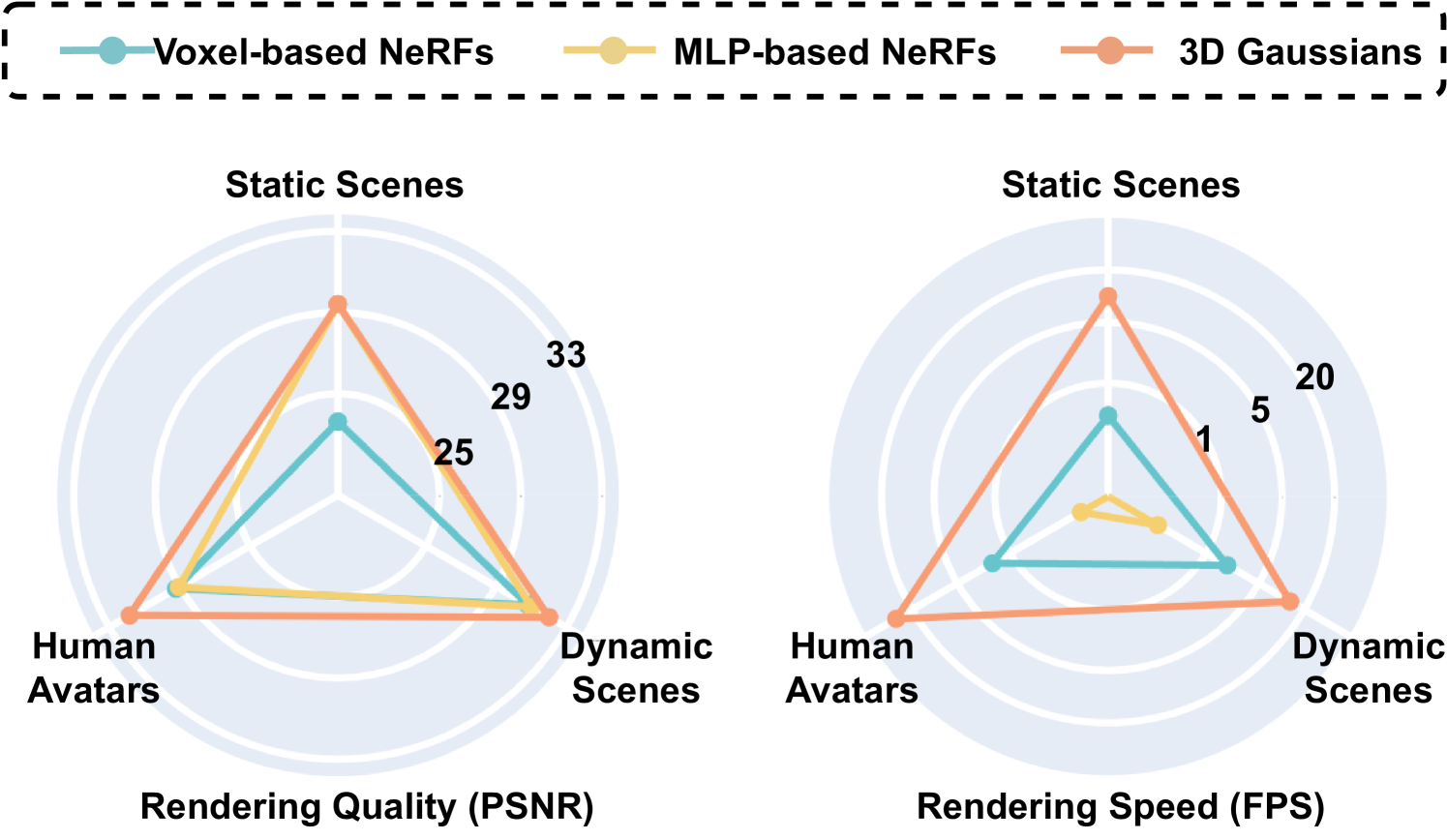

- 现有3D高斯溅射渲染在高端GPU上表现出色,但在边缘设备上帧率不足,无法满足AR/VR实时性需求。

- 论文提出高斯混合单元(GBU),作为边缘GPU插件,通过行内顺序着色和专用渲染引擎加速高斯混合阶段。

- 实验表明,GBU能有效提升边缘设备上的渲染速度,在保持SOTA渲染质量的同时,实现AR/VR应用的实时渲染。

📝 摘要(中文)

增强现实和虚拟现实(AR/VR)领域的快速发展需要在资源受限的平台上实现实时的、照片般逼真的渲染。3D高斯溅射在渲染效率和质量方面提供了最先进的(SOTA)性能,已成为AR/VR应用领域一个很有前途的解决方案。然而,尽管它在高端GPU上表现出色,但在Jetson Orin NX Edge GPU等边缘系统上却表现不佳,只能达到7-17 FPS,远低于真正沉浸式AR/VR体验所需的60 FPS以上的标准。为了解决这个挑战,我们对基于高斯的AR/VR应用进行了全面的分析,并将高斯混合阶段确定为主要瓶颈,该阶段密集地计算每个高斯在每个像素上的贡献。为此,我们提出了一种高斯混合单元(GBU),这是一种边缘GPU插件模块,用于AR/VR应用中的实时渲染。值得注意的是,我们的GBU可以无缝集成到传统的边缘GPU中,并协同支持各种AR/VR应用。具体来说,GBU包含一个行内顺序着色(IRSS)数据流,该数据流从左到右依次对每一行像素进行着色,并利用两步坐标变换。当直接部署在GPU上时,所提出的数据流在真实静态场景中实现了1.72倍的加速,但仍然达不到实时渲染性能。由于认识到基于GPU的实现中计算利用率有限,GBU通过一个专用的渲染引擎来提高渲染速度,该引擎通过聚合来自多个高斯的计算来平衡各行之间的工作负载。在具有代表性的AR/VR应用中进行的实验表明,我们的GBU为设备上的实时渲染提供了一个统一的解决方案,同时保持了SOTA渲染质量。

🔬 方法详解

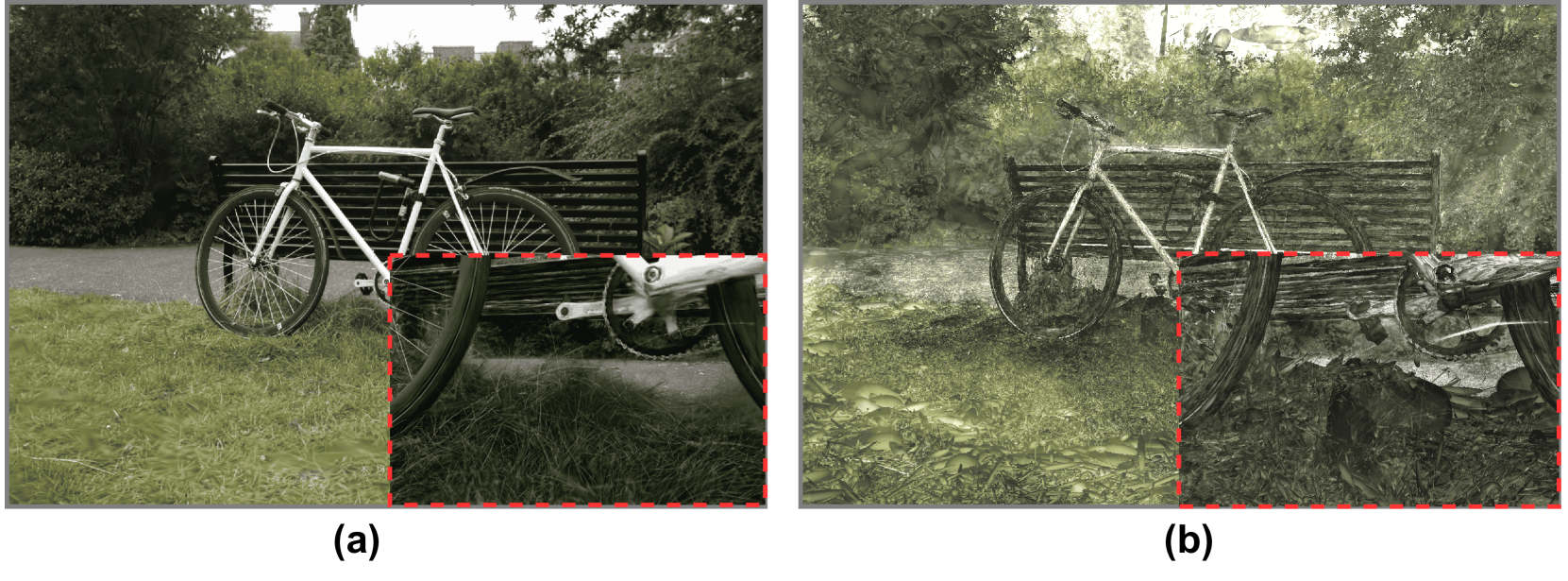

问题定义:论文旨在解决在资源受限的边缘设备上,3D高斯溅射渲染无法达到AR/VR应用所需的实时帧率的问题。现有方法在高斯混合阶段计算量大,成为性能瓶颈。

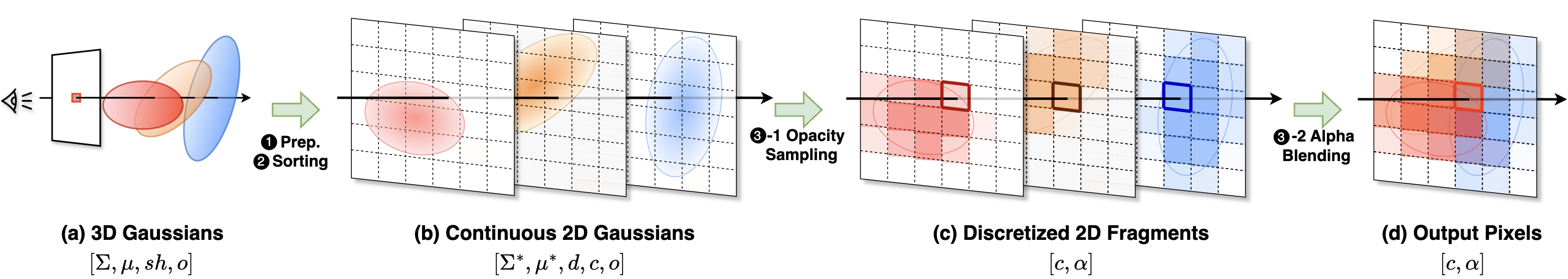

核心思路:论文的核心思路是设计一个专门的高斯混合单元(GBU),通过硬件加速的方式优化高斯混合阶段的计算。GBU通过特定的数据流和渲染引擎,提高计算效率和资源利用率,从而实现实时渲染。

技术框架:GBU作为边缘GPU的插件模块,与现有GPU协同工作。其主要流程包括:1) 行内顺序着色(IRSS)数据流,从左到右依次对每一行像素进行着色,利用两步坐标变换;2) 专用渲染引擎,通过聚合来自多个高斯的计算来平衡各行之间的工作负载。

关键创新:论文的关键创新在于GBU的硬件加速设计,以及IRSS数据流和专用渲染引擎的结合。与传统的GPU实现相比,GBU能够更有效地利用硬件资源,减少计算冗余,从而显著提高渲染速度。

关键设计:IRSS数据流采用两步坐标变换,优化了像素着色的顺序,减少了数据依赖。专用渲染引擎通过负载均衡策略,将计算任务分配到不同的处理单元,提高了并行度和资源利用率。具体的参数设置和网络结构等细节未在摘要中详细说明,属于未知信息。

🖼️ 关键图片

📊 实验亮点

实验结果表明,直接在GPU上部署IRSS数据流,在真实静态场景中实现了1.72倍的加速。通过GBU的专用渲染引擎,进一步提升了渲染速度,实现了在边缘设备上的实时渲染,同时保持了SOTA渲染质量。具体的帧率提升数据未在摘要中详细说明,属于未知信息。

🎯 应用场景

该研究成果可广泛应用于AR/VR领域,尤其是在移动设备、智能眼镜等资源受限的边缘设备上。通过GBU的加速,可以实现更流畅、更逼真的AR/VR体验,提升用户沉浸感。未来,该技术有望推动AR/VR在游戏、教育、医疗等领域的应用。

📄 摘要(原文)

The rapidly advancing field of Augmented and Virtual Reality (AR/VR) demands real-time, photorealistic rendering on resource-constrained platforms. 3D Gaussian Splatting, delivering state-of-the-art (SOTA) performance in rendering efficiency and quality, has emerged as a promising solution across a broad spectrum of AR/VR applications. However, despite its effectiveness on high-end GPUs, it struggles on edge systems like the Jetson Orin NX Edge GPU, achieving only 7-17 FPS -- well below the over 60 FPS standard required for truly immersive AR/VR experiences. Addressing this challenge, we perform a comprehensive analysis of Gaussian-based AR/VR applications and identify the Gaussian Blending Stage, which intensively calculates each Gaussian's contribution at every pixel, as the primary bottleneck. In response, we propose a Gaussian Blending Unit (GBU), an edge GPU plug-in module for real-time rendering in AR/VR applications. Notably, our GBU can be seamlessly integrated into conventional edge GPUs and collaboratively supports a wide range of AR/VR applications. Specifically, GBU incorporates an intra-row sequential shading (IRSS) dataflow that shades each row of pixels sequentially from left to right, utilizing a two-step coordinate transformation. When directly deployed on a GPU, the proposed dataflow achieved a non-trivial 1.72x speedup on real-world static scenes, though still falls short of real-time rendering performance. Recognizing the limited compute utilization in the GPU-based implementation, GBU enhances rendering speed with a dedicated rendering engine that balances the workload across rows by aggregating computations from multiple Gaussians. Experiments across representative AR/VR applications demonstrate that our GBU provides a unified solution for on-device real-time rendering while maintaining SOTA rendering quality.