RainyGS: Efficient Rain Synthesis with Physically-Based Gaussian Splatting

作者: Qiyu Dai, Xingyu Ni, Qianfan Shen, Wenzheng Chen, Baoquan Chen, Mengyu Chu

分类: cs.GR, cs.CV

发布日期: 2025-03-27 (更新: 2025-04-01)

备注: CVPR 2025

🔗 代码/项目: PROJECT_PAGE

💡 一句话要点

RainyGS:基于物理的3D高斯溅射高效合成动态雨效

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 雨效合成 3D高斯溅射 物理模拟 场景编辑 动态场景 novel view synthesis

📋 核心要点

- 现有NeRF和3DGS方法难以在场景编辑中模拟逼真的雨效,传统物理模拟方法则依赖人工设置,缺乏灵活性和可扩展性。

- RainyGS将基于物理的雨滴和浅水模拟集成到3DGS渲染框架中,实现逼真且高效的动态雨效模拟。

- RainyGS在真实场景和驾驶场景中表现出色,能以超过30fps的速度合成雨效,并提供雨强度的灵活控制。

📝 摘要(中文)

本文研究了如何以物理上正确的方式,将动态雨效添加到真实场景中。 近年来,场景建模取得了显著进展,NeRF和3DGS技术已成为重建复杂场景的强大工具。 然而,虽然这些方法在novel view synthesis方面有效,但通常难以应对具有挑战性的场景编辑任务,例如基于物理的雨水模拟。 相比之下,传统的基于物理的模拟可以生成逼真的雨效,例如雨滴和飞溅,但它们通常依赖于熟练的美术师来仔细设置高保真场景。 这种过程缺乏灵活性和可扩展性,限制了其在更广泛的开放世界环境中的适用性。 在这项工作中,我们介绍了RainyGS,这是一种新颖的方法,它利用了基于物理的建模和3DGS的优势,在具有物理精度的开放世界场景中生成逼真的动态雨效。 我们的方法的核心是将基于物理的雨滴和浅水模拟技术集成到快速3DGS渲染框架中,从而实现对雨滴行为、飞溅和反射的逼真而高效的模拟。 我们的方法支持以超过30 fps的速度合成雨效,为用户提供对雨强度的灵活控制——从毛毛细雨到倾盆大雨。 我们证明了RainyGS在真实世界的室外场景和大规模驾驶场景中都能有效地工作,与最先进的方法相比,提供了更逼真和物理上更准确的雨效。

🔬 方法详解

问题定义:论文旨在解决在开放世界场景中高效且逼真地合成动态雨效的问题。现有方法,如NeRF和3DGS,虽然擅长novel view synthesis,但在场景编辑(特别是物理模拟)方面存在不足。传统的基于物理的模拟方法虽然可以生成逼真的雨效,但需要人工精细设置场景,缺乏灵活性和可扩展性。

核心思路:RainyGS的核心思路是将基于物理的雨滴和浅水模拟技术与3DGS渲染框架相结合。3DGS提供高效的渲染能力,而物理模拟保证了雨效的真实性。通过将两者结合,RainyGS能够在开放世界场景中生成逼真且动态的雨效,同时保持较高的渲染效率。

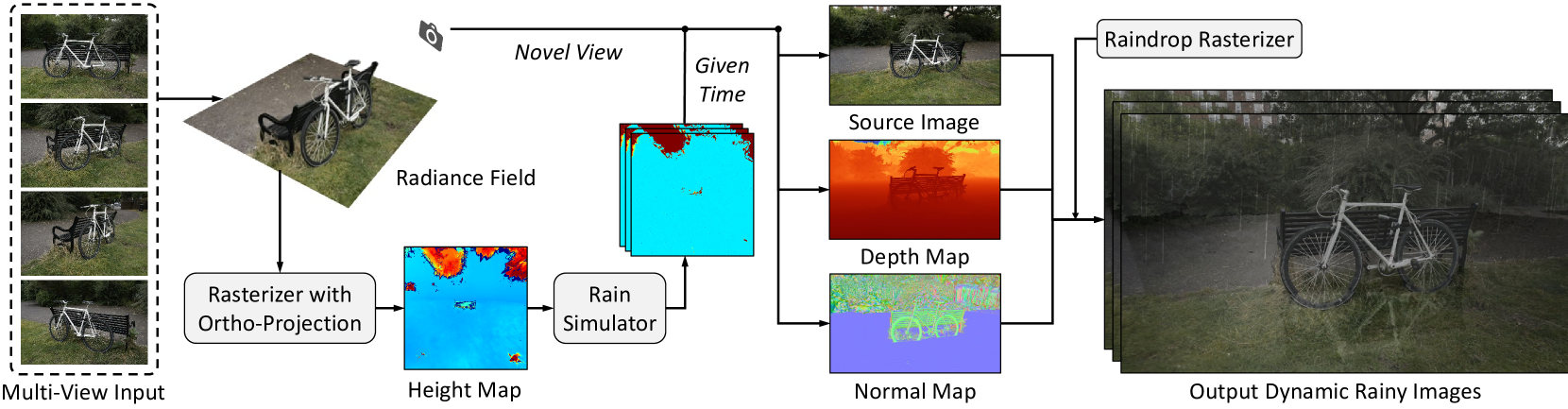

技术框架:RainyGS的技术框架主要包含以下几个模块:1) 场景重建:使用3DGS重建场景的几何和外观信息。2) 雨滴模拟:基于物理模型模拟雨滴的运动轨迹和与场景的交互。3) 浅水模拟:模拟雨水在物体表面形成的浅水效果,包括飞溅和反射。4) 渲染:将模拟的雨滴和浅水效果集成到3DGS渲染框架中,生成最终的雨景图像。

关键创新:RainyGS的关键创新在于将基于物理的雨滴和浅水模拟无缝集成到3DGS渲染框架中。这使得RainyGS能够在保持高渲染效率的同时,生成逼真且物理上准确的雨效。与现有方法相比,RainyGS无需人工干预即可在开放世界场景中生成动态雨效,具有更高的灵活性和可扩展性。

关键设计:RainyGS的关键设计包括:1) 使用基于物理的雨滴运动模型,考虑重力、空气阻力等因素。2) 采用浅水方程模拟雨水在物体表面的流动和飞溅。3) 设计高效的渲染算法,将模拟的雨滴和浅水效果集成到3DGS渲染框架中,避免额外的渲染开销。4) 提供雨强度的控制参数,允许用户灵活调整雨效的强度。

🖼️ 关键图片

📊 实验亮点

RainyGS在真实世界的室外场景和大规模驾驶场景中进行了实验,结果表明,与最先进的方法相比,RainyGS能够生成更逼真和物理上更准确的雨效。该方法能够以超过30fps的速度合成雨效,并提供雨强度的灵活控制。实验结果验证了RainyGS的有效性和优越性。

🎯 应用场景

RainyGS具有广泛的应用前景,包括:1) 游戏和电影制作:可以用于生成逼真的雨景,提高视觉效果。2) 自动驾驶模拟:可以用于模拟各种雨天驾驶场景,提高自动驾驶系统的鲁棒性。3) 虚拟现实和增强现实:可以用于创建沉浸式的雨天体验。该研究的实际价值在于提供了一种高效且逼真的雨效合成方法,未来可能推动相关领域的发展。

📄 摘要(原文)

We consider the problem of adding dynamic rain effects to in-the-wild scenes in a physically-correct manner. Recent advances in scene modeling have made significant progress, with NeRF and 3DGS techniques emerging as powerful tools for reconstructing complex scenes. However, while effective for novel view synthesis, these methods typically struggle with challenging scene editing tasks, such as physics-based rain simulation. In contrast, traditional physics-based simulations can generate realistic rain effects, such as raindrops and splashes, but they often rely on skilled artists to carefully set up high-fidelity scenes. This process lacks flexibility and scalability, limiting its applicability to broader, open-world environments. In this work, we introduce RainyGS, a novel approach that leverages the strengths of both physics-based modeling and 3DGS to generate photorealistic, dynamic rain effects in open-world scenes with physical accuracy. At the core of our method is the integration of physically-based raindrop and shallow water simulation techniques within the fast 3DGS rendering framework, enabling realistic and efficient simulations of raindrop behavior, splashes, and reflections. Our method supports synthesizing rain effects at over 30 fps, offering users flexible control over rain intensity -- from light drizzles to heavy downpours. We demonstrate that RainyGS performs effectively for both real-world outdoor scenes and large-scale driving scenarios, delivering more photorealistic and physically-accurate rain effects compared to state-of-the-art methods. Project page can be found at https://pku-vcl-geometry.github.io/RainyGS/