Optimized 3D Gaussian Splatting using Coarse-to-Fine Image Frequency Modulation

作者: Umar Farooq, Jean-Yves Guillemaut, Adrian Hilton, Marco Volino

分类: cs.GR, cs.CV

发布日期: 2025-03-18 (更新: 2025-10-22)

💡 一句话要点

Opti3DGS:基于频率调制的3D高斯溅射优化,减少内存占用和存储需求。

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 3D高斯溅射 新视角合成 频率调制 场景重建 内存优化

📋 核心要点

- 3D高斯溅射虽然实现了高质量的场景重建和实时渲染,但其高GPU内存和磁盘存储需求限制了其在消费级设备上的应用。

- Opti3DGS通过频率调制,由粗到精地优化场景表示,减少高斯基元的数量,从而降低内存和存储需求。

- 实验表明,Opti3DGS在不牺牲视觉质量的前提下,显著减少了高斯数量、GPU内存需求和优化时间,并能与其他3DGS技术集成。

📝 摘要(中文)

本文提出Opti3DGS,一种新颖的频率调制由粗到精的优化框架,旨在最小化用于表示场景的3D高斯基元的数量,从而降低内存和存储需求。Opti3DGS利用图像频率调制,首先强制执行粗略的场景表示,然后通过调制训练图像中的频率细节逐步细化它。在基线3DGS上,我们证明了高斯数量平均减少62%,训练GPU内存需求减少40%,优化时间减少20%,而没有牺牲视觉质量。此外,我们表明我们的方法可以与许多基于3DGS的技术无缝集成,始终如一地减少高斯基元的数量,同时保持甚至提高视觉质量。此外,Opti3DGS固有地产生细节层次的场景表示,而无需额外的成本,这是优化流程的自然副产品。结果和代码将公开发布。

🔬 方法详解

问题定义:现有基于3D高斯溅射(3DGS)的新视角合成方法,虽然能实现高质量的场景重建和实时渲染,但其对GPU内存和磁盘存储的需求非常高,这限制了它们在资源受限设备上的实际应用。因此,如何减少3DGS的资源占用,同时保持甚至提升视觉质量,是一个亟待解决的问题。

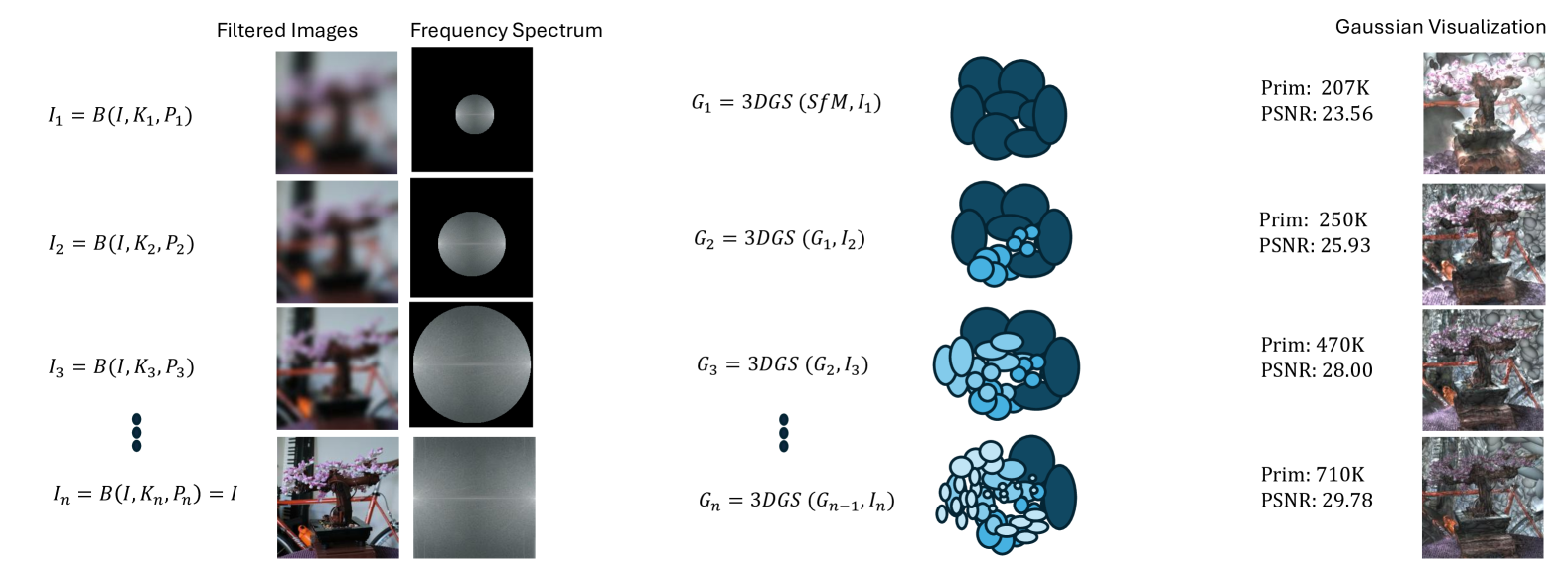

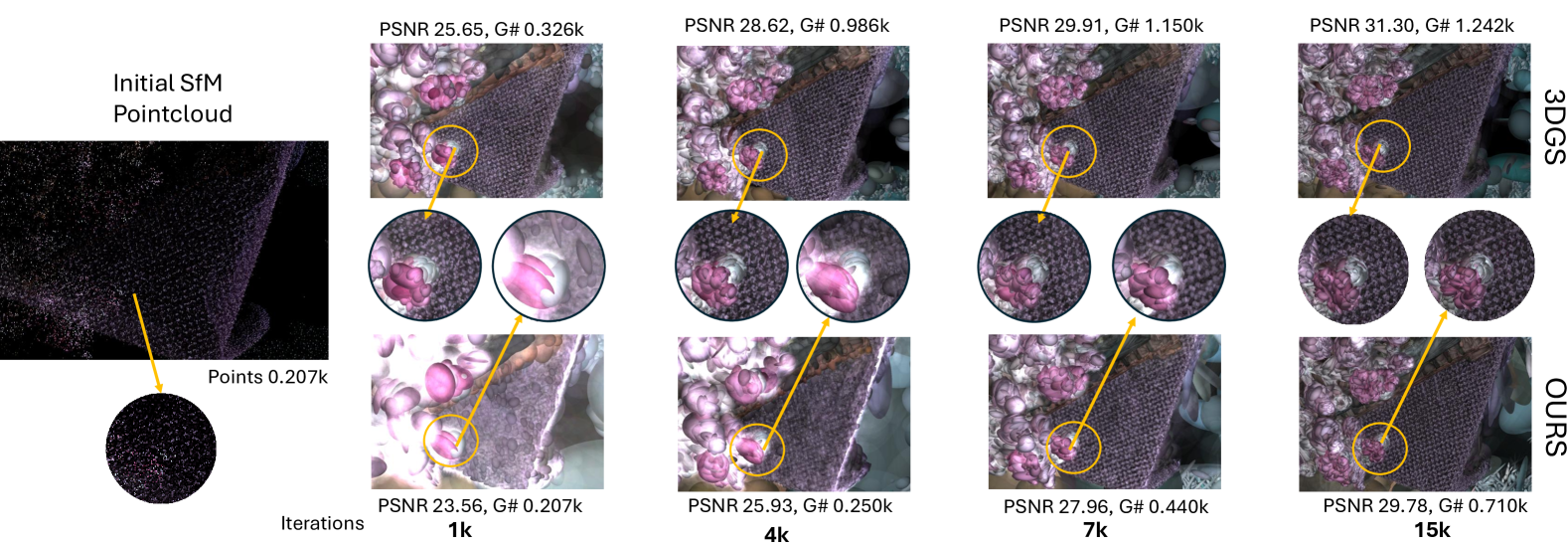

核心思路:Opti3DGS的核心思路是利用图像频率调制,从粗到精地优化场景表示。具体来说,首先使用低频信息构建一个粗略的场景表示,然后逐步引入高频细节,从而避免一开始就使用大量高斯基元来拟合高频信息,减少冗余的高斯基元数量。

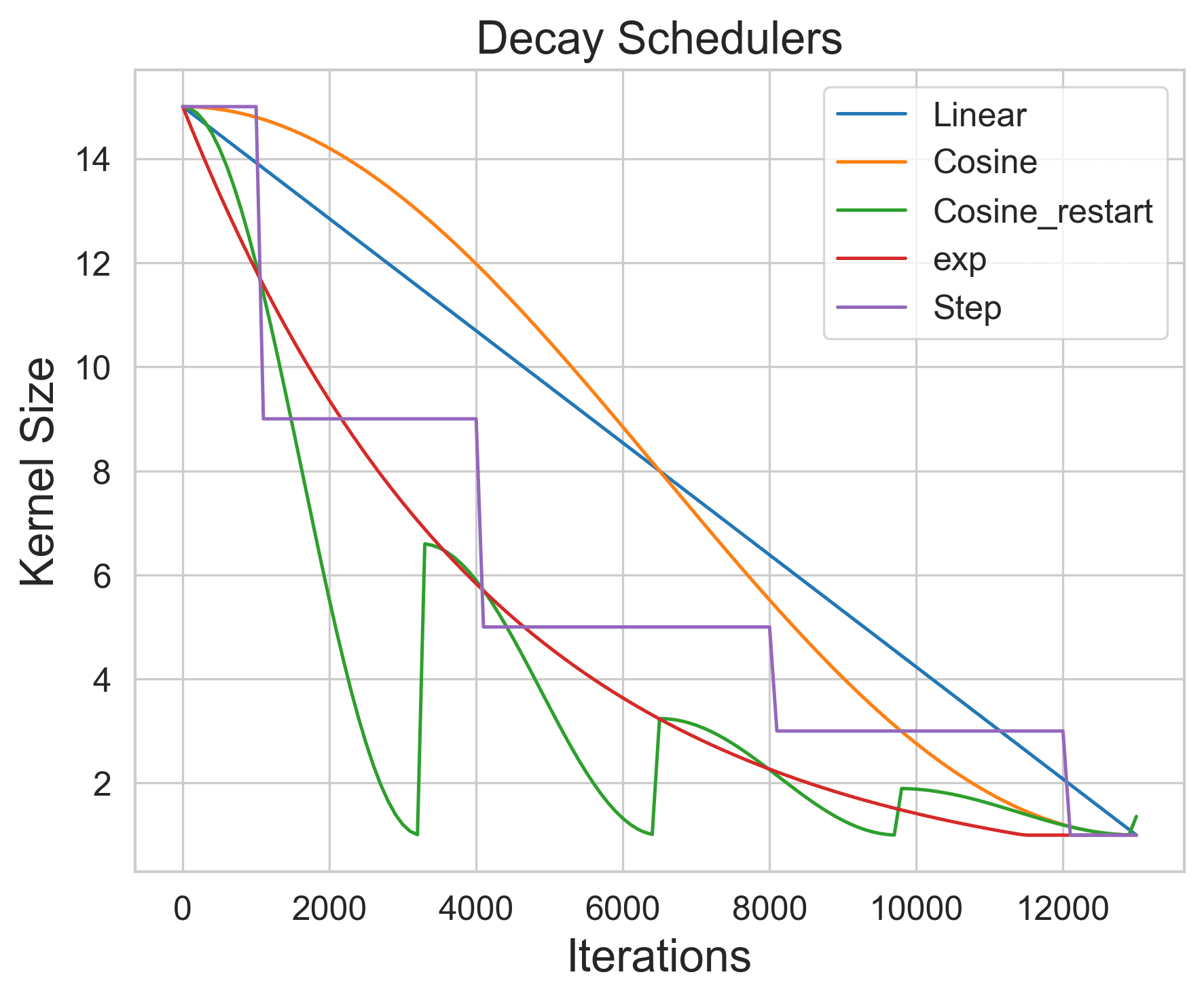

技术框架:Opti3DGS的整体框架包含以下几个主要阶段:1) 初始化:使用少量高斯基元初始化场景表示。2) 频率调制:通过调整输入图像的频率成分,控制优化过程的细节程度。3) 优化:基于频率调制的图像,优化高斯基元的参数(位置、旋转、缩放、颜色等)。4) 迭代:重复频率调制和优化过程,逐步细化场景表示。

关键创新:Opti3DGS的关键创新在于引入了图像频率调制的概念,并将其应用于3DGS的优化过程中。通过控制输入图像的频率成分,可以有效地控制优化过程的细节程度,从而避免了过度拟合和冗余的高斯基元。这与传统的3DGS方法直接使用原始图像进行优化有本质的区别。

关键设计:Opti3DGS的关键设计包括:1) 频率调制策略:如何选择合适的频率成分,以及如何逐步增加频率细节。2) 损失函数:如何设计损失函数,以保证优化过程的稳定性和视觉质量。3) 高斯基元初始化策略:如何初始化高斯基元的参数,以加速优化过程。

🖼️ 关键图片

📊 实验亮点

Opti3DGS在基线3DGS上实现了显著的性能提升。实验结果表明,Opti3DGS平均减少了62%的高斯基元数量,降低了40%的训练GPU内存需求,并缩短了20%的优化时间,同时保持了视觉质量。此外,Opti3DGS能够与其他3DGS技术无缝集成,并能进一步提升视觉质量。

🎯 应用场景

Opti3DGS可应用于各种需要新视角合成的场景,例如虚拟现实(VR)、增强现实(AR)、机器人导航、自动驾驶等。通过降低内存和存储需求,Opti3DGS使得3DGS技术能够在移动设备和嵌入式系统上部署,从而拓展了其应用范围。此外,Opti3DGS产生的细节层次场景表示,可以用于实现自适应渲染,进一步提高渲染效率。

📄 摘要(原文)

The field of Novel View Synthesis has been revolutionized by 3D Gaussian Splatting (3DGS), which enables high-quality scene reconstruction that can be rendered in real-time. 3DGS-based techniques typically suffer from high GPU memory and disk storage requirements which limits their practical application on consumer-grade devices. We propose Opti3DGS, a novel frequency-modulated coarse-to-fine optimization framework that aims to minimize the number of Gaussian primitives used to represent a scene, thus reducing memory and storage demands. Opti3DGS leverages image frequency modulation, initially enforcing a coarse scene representation and progressively refining it by modulating frequency details in the training images. On the baseline 3DGS, we demonstrate an average reduction of 62% in Gaussians, a 40% reduction in the training GPU memory requirements and a 20% reduction in optimization time without sacrificing the visual quality. Furthermore, we show that our method integrates seamlessly with many 3DGS-based techniques, consistently reducing the number of Gaussian primitives while maintaining, and often improving, visual quality. Additionally, Opti3DGS inherently produces a level-of-detail scene representation at no extra cost, a natural byproduct of the optimization pipeline. Results and code will be made publicly available.