Drag Your Gaussian: Effective Drag-Based Editing with Score Distillation for 3D Gaussian Splatting

作者: Yansong Qu, Dian Chen, Xinyang Li, Xiaofan Li, Shengchuan Zhang, Liujuan Cao, Rongrong Ji

分类: cs.GR, cs.CV

发布日期: 2025-01-30 (更新: 2025-05-25)

备注: Visit our project page at https://quyans.github.io/Drag-Your-Gaussian

🔗 代码/项目: PROJECT_PAGE

💡 一句话要点

DYG:基于拖拽和分数蒸馏的3D高斯溅射编辑方法

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 3D高斯溅射 拖拽式编辑 几何编辑 隐式三平面 分数蒸馏 潜在扩散模型 3D场景编辑

📋 核心要点

- 现有3D场景编辑方法依赖文本引导,难以精确控制几何形变和编辑位置。

- DYG通过3D掩码和控制点实现精确的拖拽式编辑,并结合隐式三平面表示增强几何结构。

- 实验证明DYG在编辑效果和质量上超越现有方法,实现了更精细的控制。

📝 摘要(中文)

本文提出了一种有效的3D拖拽式编辑方法DYG,用于3D高斯溅射(3DGS)。现有方法通常利用生成模型对3D表示进行文本引导编辑,但仅限于纹理修改,难以处理几何变化,且缺乏对编辑结果空间位置的精确控制。DYG通过输入3D掩码和控制点对,方便地指定编辑区域和拖拽方向,从而实现对编辑范围的精确控制。DYG集成了隐式三平面表示的优势,建立编辑结果的几何支架,有效克服了3DGS在目标编辑区域的稀疏性导致的次优编辑结果。此外,通过提出的Drag-SDS损失函数,将基于拖拽的潜在扩散模型融入该方法,实现灵活、多视角一致和细粒度的编辑。大量实验表明,DYG在控制点提示的引导下进行有效的拖拽式编辑,在编辑效果和质量方面均优于其他基线。

🔬 方法详解

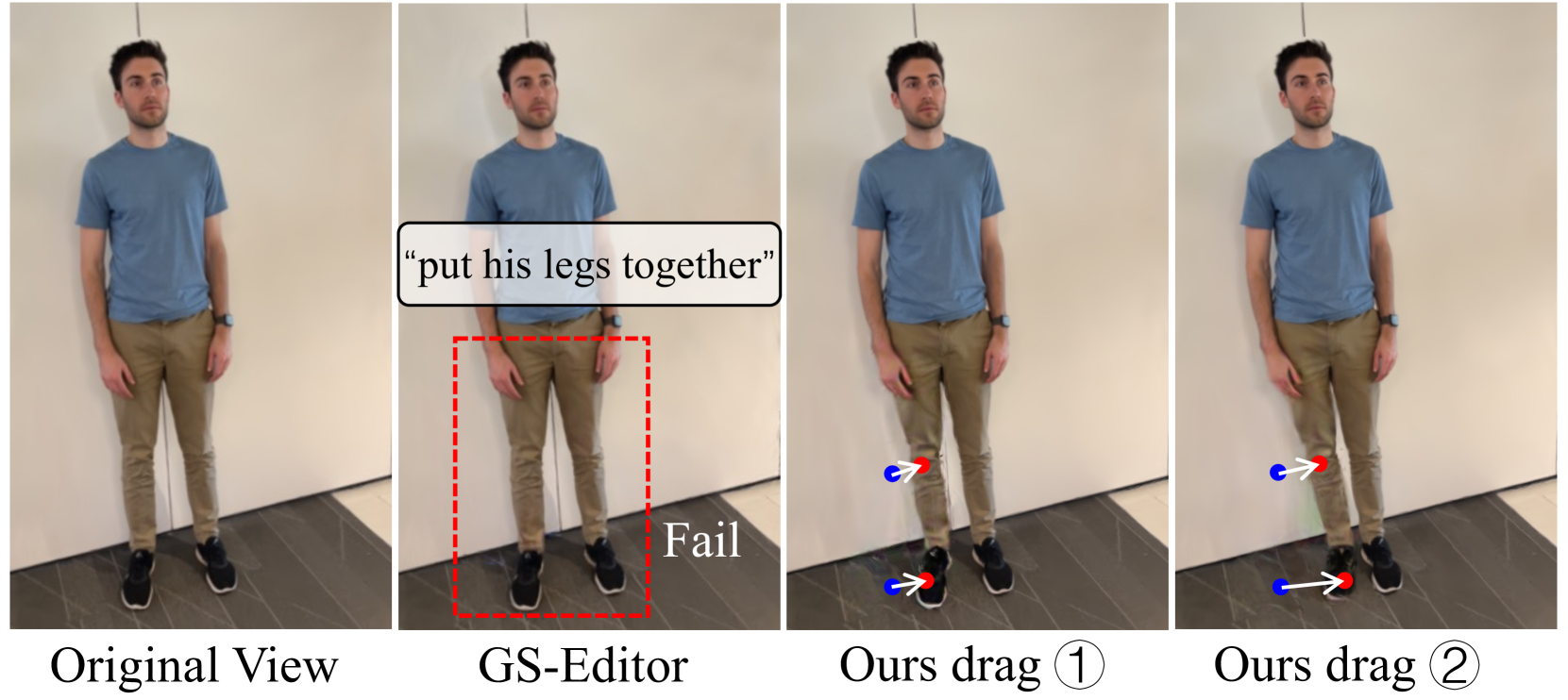

问题定义:现有基于文本引导的3D场景编辑方法,尤其是在3D高斯溅射上的应用,主要存在两个痛点。一是难以进行复杂的几何编辑,例如改变物体的朝向或形状,通常只能修改纹理。二是缺乏对编辑结果空间位置的精确控制,文本描述难以准确指定编辑范围和方向。

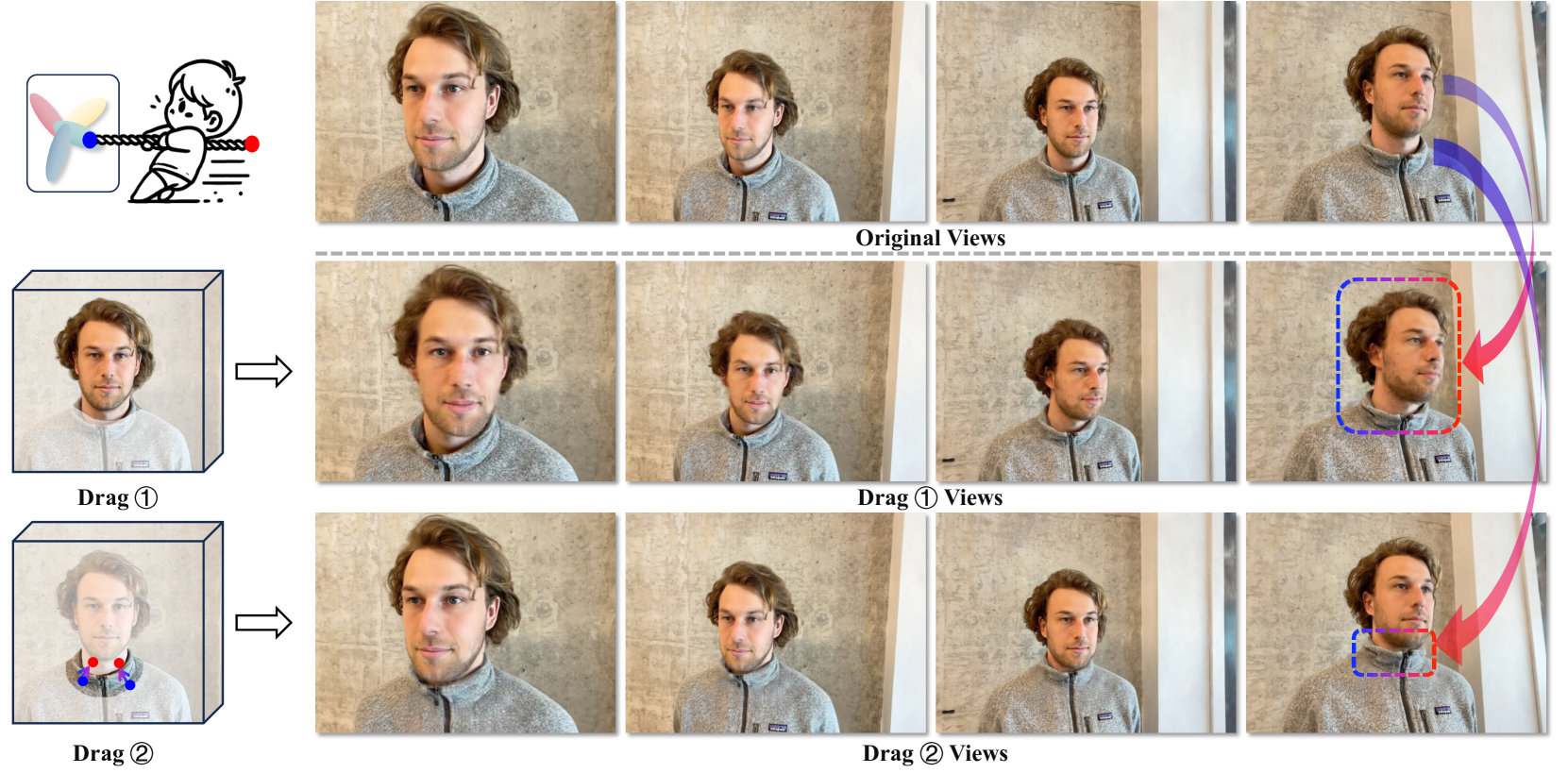

核心思路:DYG的核心思路是利用用户提供的3D掩码和控制点对,直接指定需要编辑的区域和拖拽方向,从而实现对编辑过程的精确控制。同时,为了克服3DGS在编辑区域可能存在的稀疏性问题,引入隐式三平面表示作为几何支架,增强编辑区域的几何结构。此外,利用Drag-SDS损失函数将拖拽式编辑融入到潜在扩散模型中,保证编辑结果的多视角一致性和高质量。

技术框架:DYG的整体框架包含以下几个主要模块:1) 控制点和掩码输入:用户指定3D掩码和控制点对,定义编辑区域和拖拽方向。2) 隐式三平面表示:利用三平面表示构建编辑区域的几何支架,增强几何结构。3) Drag-SDS损失函数:将拖拽式编辑融入潜在扩散模型,优化3DGS参数。4) 3DGS渲染:渲染编辑后的3D场景。

关键创新:DYG的关键创新在于:1) 提出了基于拖拽的3DGS编辑方法,通过控制点对实现精确的几何编辑。2) 引入隐式三平面表示,克服了3DGS的稀疏性问题,提高了编辑质量。3) 设计了Drag-SDS损失函数,将拖拽式编辑与潜在扩散模型相结合,保证了编辑结果的多视角一致性。

关键设计:Drag-SDS损失函数是关键设计之一。它基于Score Distillation Sampling (SDS) 的思想,将拖拽约束融入到扩散模型的训练过程中。具体来说,该损失函数鼓励编辑后的3D场景渲染出的图像,在控制点附近具有与拖拽方向一致的梯度。此外,三平面表示的具体实现方式,以及如何将其与3DGS进行融合,也是重要的技术细节。论文中可能还涉及了控制点选择策略、掩码生成方法等方面的设计。

🖼️ 关键图片

📊 实验亮点

实验结果表明,DYG在3D高斯溅射的拖拽式编辑任务中,显著优于现有的基于文本引导的编辑方法。定性结果展示了DYG在复杂几何编辑方面的优势,例如改变人物头部朝向。定量评估指标(具体指标未知,论文中应有详细数据)也表明,DYG在编辑质量和多视角一致性方面取得了显著提升。

🎯 应用场景

DYG具有广泛的应用前景,例如:3D内容创作,允许用户通过直观的拖拽操作编辑3D模型;虚拟现实/增强现实,用户可以交互式地修改虚拟环境;游戏开发,美术设计师可以快速调整游戏场景中的物体形状和位置。该研究有望推动3D编辑技术的普及,降低3D内容创作的门槛。

📄 摘要(原文)

Recent advancements in 3D scene editing have been propelled by the rapid development of generative models. Existing methods typically utilize generative models to perform text-guided editing on 3D representations, such as 3D Gaussian Splatting (3DGS). However, these methods are often limited to texture modifications and fail when addressing geometric changes, such as editing a character's head to turn around. Moreover, such methods lack accurate control over the spatial position of editing results, as language struggles to precisely describe the extent of edits. To overcome these limitations, we introduce DYG, an effective 3D drag-based editing method for 3D Gaussian Splatting. It enables users to conveniently specify the desired editing region and the desired dragging direction through the input of 3D masks and pairs of control points, thereby enabling precise control over the extent of editing. DYG integrates the strengths of the implicit triplane representation to establish the geometric scaffold of the editing results, effectively overcoming suboptimal editing outcomes caused by the sparsity of 3DGS in the desired editing regions. Additionally, we incorporate a drag-based Latent Diffusion Model into our method through the proposed Drag-SDS loss function, enabling flexible, multi-view consistent, and fine-grained editing. Extensive experiments demonstrate that DYG conducts effective drag-based editing guided by control point prompts, surpassing other baselines in terms of editing effect and quality, both qualitatively and quantitatively. Visit our project page at https://quyans.github.io/Drag-Your-Gaussian.