3DGS-to-PC: Convert a 3D Gaussian Splatting Scene into a Dense Point Cloud or Mesh

作者: Lewis A G Stuart, Michael P Pound

分类: cs.GR, cs.CV

发布日期: 2025-01-13

💡 一句话要点

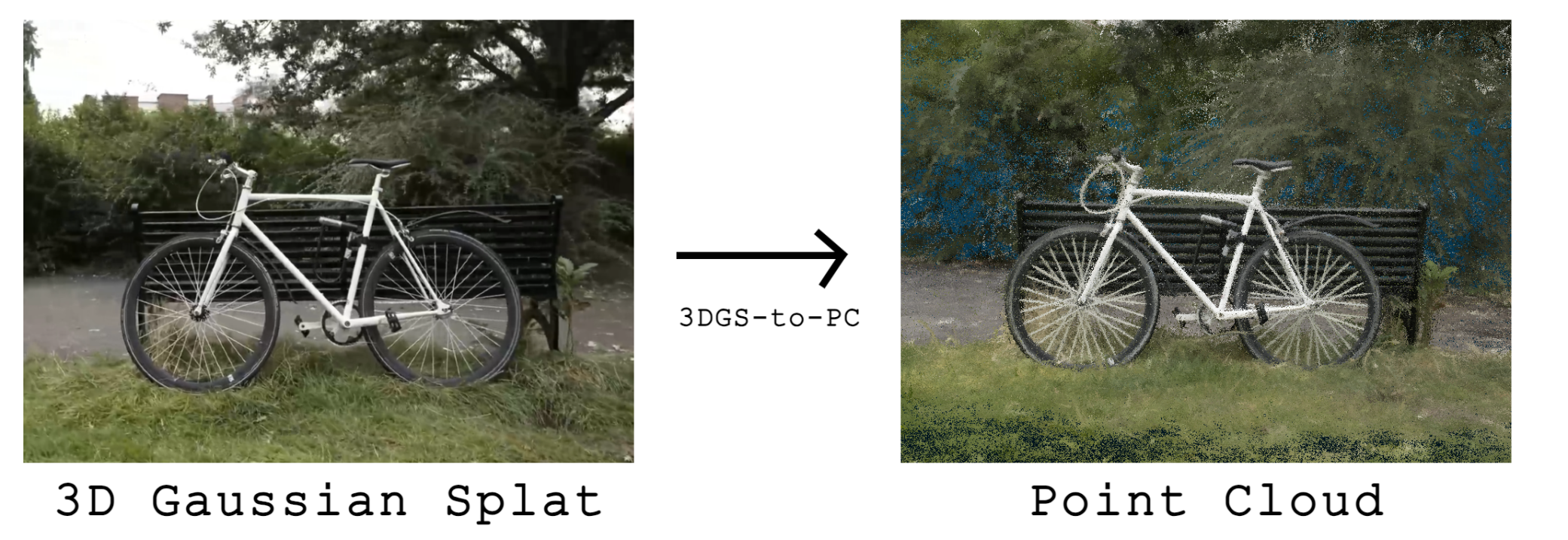

提出3DGS-to-PC框架,将3D高斯溅射场景转换为高精度点云或网格模型。

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 3D高斯溅射 点云转换 网格生成 概率采样 马氏距离

📋 核心要点

- 3DGS场景通常需要专门的渲染器才能有效可视化,而点云应用广泛,但将3DGS转换为点云极具挑战。

- 3DGS-to-PC框架通过概率采样和马氏距离阈值处理,将3D高斯分布转换为高精度点云,并重新计算颜色。

- 该方法支持从点云生成网格,无需重新训练,并易于集成到现有3DGS流程中,具有高度可定制性。

📝 摘要(中文)

本文介绍了一种灵活且高度可定制的框架3DGS-to-PC,用于将3D高斯溅射(3DGS)场景转换为密集、高精度的点云。该方法将每个高斯分布视为3D密度函数,并从中概率性地采样点。此外,使用马氏距离对新点进行阈值处理,以防止极端异常值。由此产生的点云能够精确地表示3D高斯场景中编码的形状。针对3DGS中高斯颜色依赖视角的问题,本文通过定制的图像渲染方法重新计算高斯颜色,为每个高斯分配其在所有视角中贡献最大的像素颜色。3DGS-to-PC还支持通过泊松表面重建从预测的表面高斯采样点来生成网格。这使得无需重新训练即可从3DGS场景生成彩色网格。该软件包具有高度可定制性,并且可以简单地集成到现有的3DGS流程中。3DGS-to-PC为将3DGS数据转换为点云和基于表面的格式提供了一个强大的工具。

🔬 方法详解

问题定义:现有3D高斯溅射(3DGS)技术虽然能生成高细节的3D重建,但其场景通常需要专门的渲染器进行可视化。而点云作为一种通用的3D表示形式,被广泛应用于各种3D处理软件中。因此,如何将3DGS场景高效、准确地转换为点云是一个重要的研究问题。现有方法可能存在精度不足、效率低下或颜色信息丢失等问题。

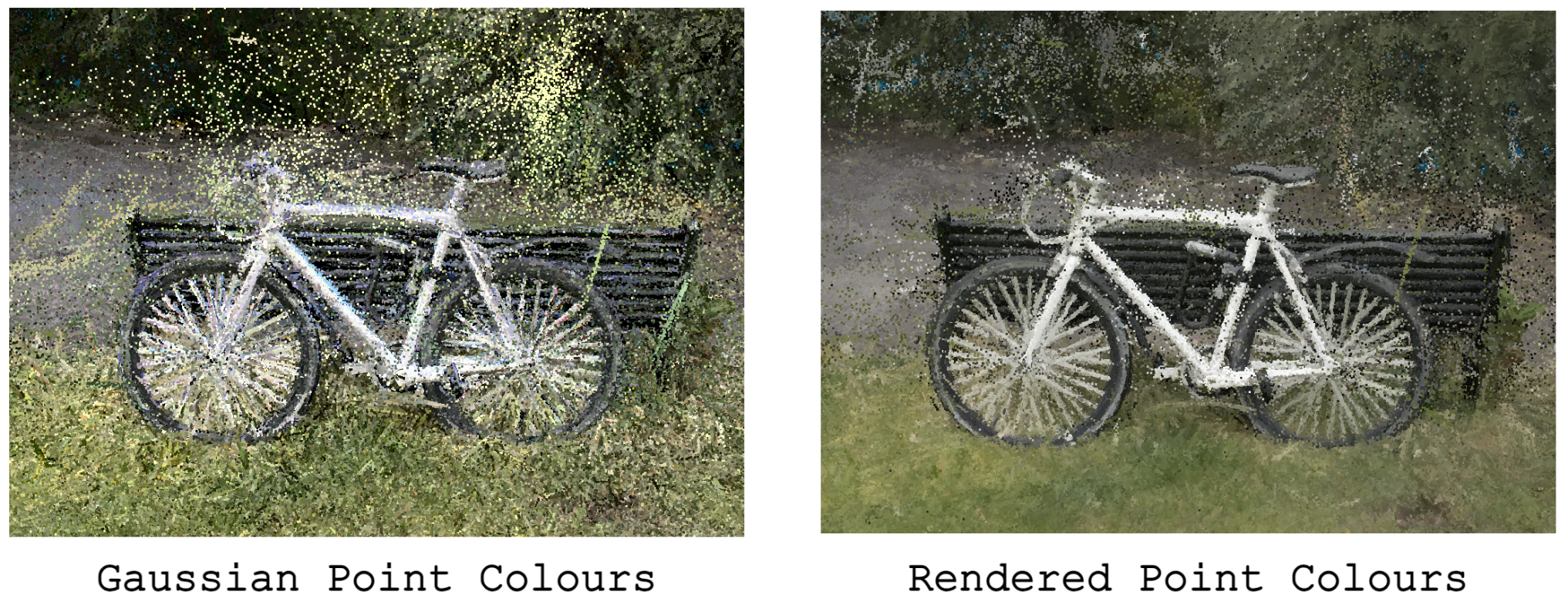

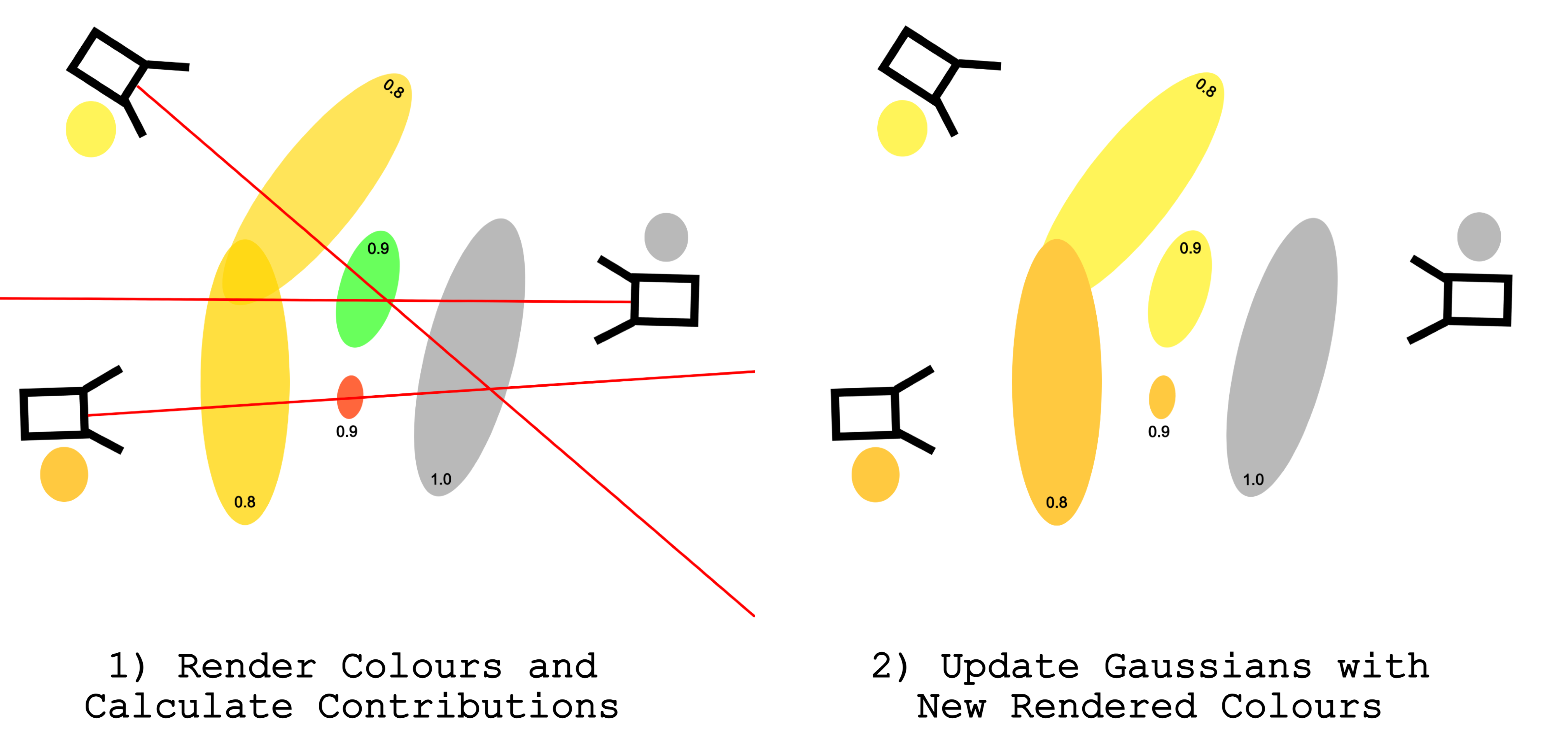

核心思路:本文的核心思路是将每个3DGS场景中的高斯分布视为一个3D密度函数,并从中概率性地采样点。通过这种方式,可以保留3DGS场景中的几何信息。此外,为了避免生成异常值,采用马氏距离对采样点进行过滤。为了解决3DGS中颜色信息依赖视角的问题,本文提出了一种定制的图像渲染方法,重新计算每个高斯的颜色。

技术框架:3DGS-to-PC框架主要包含以下几个阶段:1) 高斯分布采样:从每个高斯分布中概率性地采样点。2) 异常值过滤:使用马氏距离对采样点进行阈值处理,去除异常值。3) 颜色重计算:通过定制的图像渲染方法,为每个高斯重新计算颜色。4) 网格生成(可选):使用泊松表面重建算法,从点云生成网格模型。

关键创新:该方法的主要创新点在于:1) 提出了一种基于概率采样和马氏距离过滤的3DGS到点云转换方法,能够生成高精度、低噪声的点云。2) 提出了一种定制的图像渲染方法,能够有效地解决3DGS中颜色信息依赖视角的问题,保证转换后的点云颜色信息的准确性。

关键设计:在概率采样过程中,采样点的数量可以根据高斯分布的密度进行调整。马氏距离阈值的设置需要根据具体场景进行调整,以平衡点云的精度和噪声水平。定制的图像渲染方法需要考虑所有视角的贡献,以保证颜色信息的准确性。泊松表面重建算法的参数设置也会影响最终网格模型的质量。

🖼️ 关键图片

📊 实验亮点

3DGS-to-PC框架能够将3DGS场景转换为高精度、低噪声的点云,并有效地解决颜色信息依赖视角的问题。通过泊松表面重建,可以生成高质量的网格模型,无需重新训练。该框架具有高度可定制性,可以简单地集成到现有的3DGS流程中,为3DGS数据的处理和应用提供了强大的工具。

🎯 应用场景

该研究成果可广泛应用于三维重建、虚拟现实、增强现实、机器人导航、文物数字化等领域。例如,可以将复杂的3DGS场景转换为易于处理的点云或网格模型,方便在各种3D软件中进行编辑、分析和可视化。此外,该方法还可以用于生成高质量的3D模型,用于游戏开发、电影制作等领域。

📄 摘要(原文)

3D Gaussian Splatting (3DGS) excels at producing highly detailed 3D reconstructions, but these scenes often require specialised renderers for effective visualisation. In contrast, point clouds are a widely used 3D representation and are compatible with most popular 3D processing software, yet converting 3DGS scenes into point clouds is a complex challenge. In this work we introduce 3DGS-to-PC, a flexible and highly customisable framework that is capable of transforming 3DGS scenes into dense, high-accuracy point clouds. We sample points probabilistically from each Gaussian as a 3D density function. We additionally threshold new points using the Mahalanobis distance to the Gaussian centre, preventing extreme outliers. The result is a point cloud that closely represents the shape encoded into the 3D Gaussian scene. Individual Gaussians use spherical harmonics to adapt colours depending on view, and each point may contribute only subtle colour hints to the resulting rendered scene. To avoid spurious or incorrect colours that do not fit with the final point cloud, we recalculate Gaussian colours via a customised image rendering approach, assigning each Gaussian the colour of the pixel to which it contributes most across all views. 3DGS-to-PC also supports mesh generation through Poisson Surface Reconstruction, applied to points sampled from predicted surface Gaussians. This allows coloured meshes to be generated from 3DGS scenes without the need for re-training. This package is highly customisable and capability of simple integration into existing 3DGS pipelines. 3DGS-to-PC provides a powerful tool for converting 3DGS data into point cloud and surface-based formats.