SyncViolinist: Music-Oriented Violin Motion Generation Based on Bowing and Fingering

作者: Hiroki Nishizawa, Keitaro Tanaka, Asuka Hirata, Shugo Yamaguchi, Qi Feng, Masatoshi Hamanaka, Shigeo Morishima

分类: cs.GR, cs.SD, eess.AS

发布日期: 2024-12-11

备注: 10 pages, 7 figures, 6 tables, WACV 2025

🔗 代码/项目: GITHUB

💡 一句话要点

SyncViolinist:提出一种基于弓法和指法的音乐导向小提琴动作生成框架

🎯 匹配领域: 支柱四:生成式动作 (Generative Motion)

关键词: 小提琴动作生成 音乐导向 弓法指法 音频驱动 动作捕捉

📋 核心要点

- 现有方法在捕捉音乐表演中复杂的身体、手和手指动作方面存在不足,通常需要乐谱或MIDI数据等额外输入。

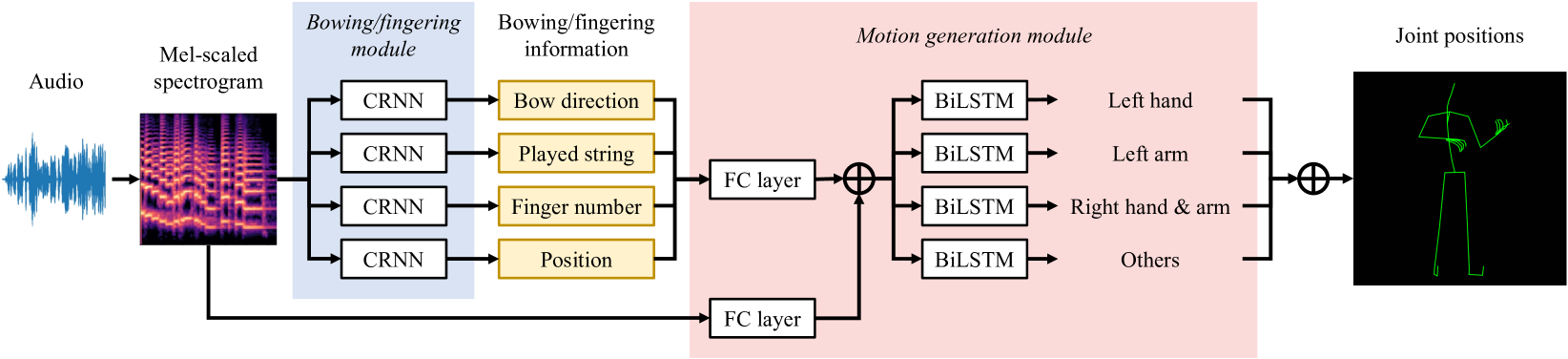

- SyncViolinist通过弓法/指法模块提取音频中的演奏信息,并利用这些信息驱动动作生成模块,从而实现仅从音频生成小提琴演奏动作。

- 实验结果表明,SyncViolinist在生成质量和定量指标上均优于现有方法,并得到了专业小提琴家的主观认可。

📝 摘要(中文)

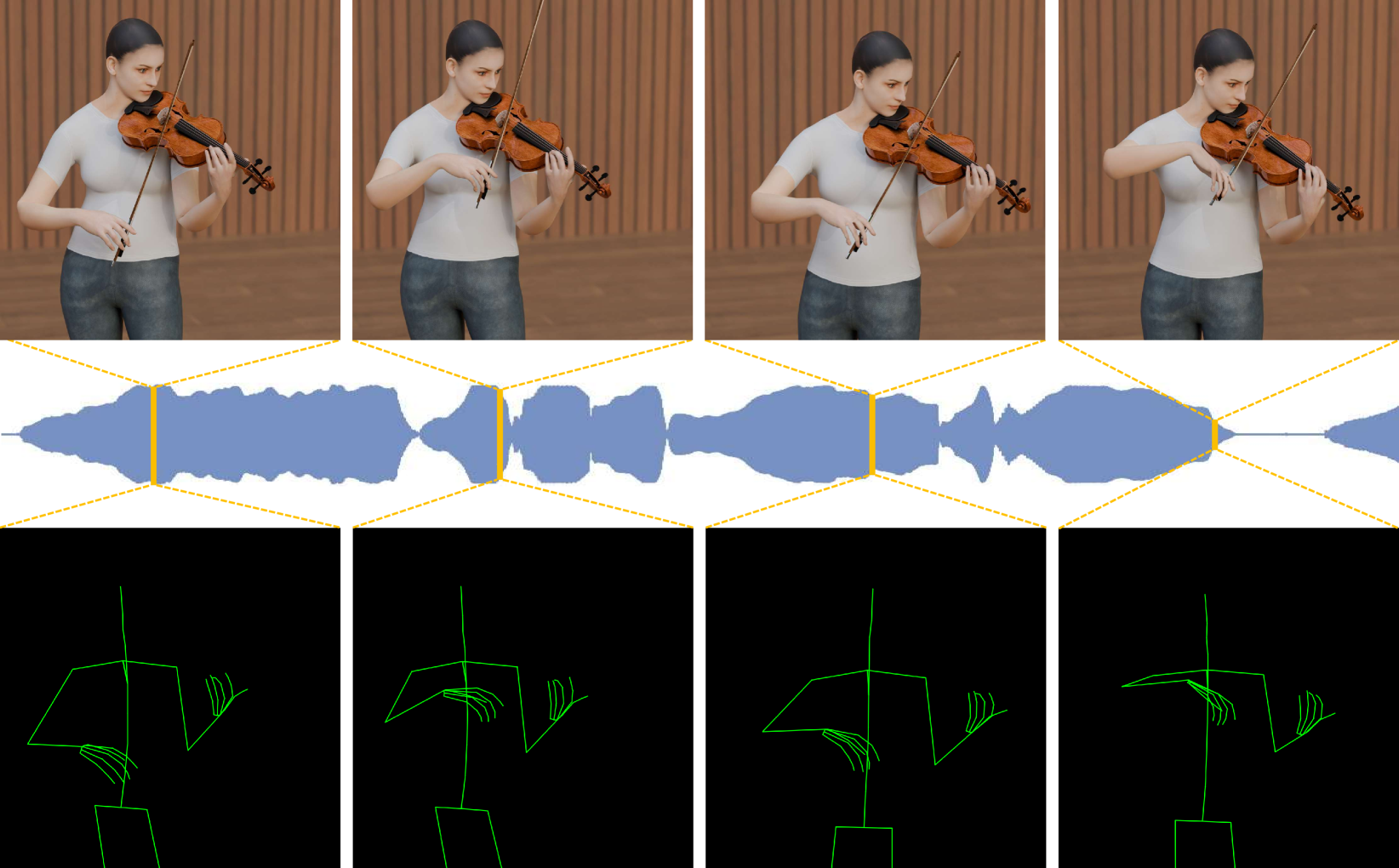

本文提出SyncViolinist,一个多阶段端到端框架,仅从音频输入生成同步的小提琴演奏动作。该方法通过两个关键模块克服了捕捉全局和精细演奏特征的挑战:弓法/指法模块和动作生成模块。弓法/指法模块从音频中提取详细的演奏信息,然后动作生成模块利用这些信息创建精确、协调的身体动作,反映小提琴演奏的时间粒度和性质。实验结果表明,SyncViolinist在未见过的小提琴演奏音频上取得了显著改进的定性和定量结果,优于现有技术水平的方法。专业小提琴家的主观评估进一步验证了该方法的有效性。代码和数据集已公开。

🔬 方法详解

问题定义:现有方法在生成小提琴演奏动作时,通常需要额外的乐谱或MIDI数据作为输入,并且难以捕捉到细粒度的演奏特征,例如弓法和指法。这限制了其在实际应用中的灵活性和真实性。因此,该论文旨在解决仅从音频输入生成逼真且同步的小提琴演奏动作的问题。

核心思路:该论文的核心思路是将小提琴演奏动作生成问题分解为两个阶段:首先,从音频中提取弓法和指法等关键演奏信息;然后,利用这些信息驱动动作生成模型,从而实现从音频到动作的映射。这种分解能够更好地捕捉到演奏的全局和局部特征,提高生成动作的真实性和同步性。

技术框架:SyncViolinist框架包含两个主要模块:弓法/指法模块和动作生成模块。弓法/指法模块负责从音频中提取详细的演奏信息,例如弓的方向、速度和指法位置。该模块可能采用深度学习模型,例如卷积神经网络或循环神经网络,来学习音频特征与演奏信息之间的映射关系。动作生成模块则利用弓法/指法模块的输出,生成小提琴演奏者的身体动作。该模块也可能采用深度学习模型,例如生成对抗网络或变分自编码器,来学习演奏信息与动作之间的映射关系。

关键创新:该论文的关键创新在于提出了一种多阶段端到端框架,能够仅从音频输入生成同步的小提琴演奏动作。与现有方法相比,该方法无需额外的乐谱或MIDI数据,并且能够更好地捕捉到细粒度的演奏特征。此外,该论文还提出了一个弓法/指法模块,能够有效地从音频中提取演奏信息,为动作生成提供了有力的支持。

关键设计:具体的网络结构和损失函数等技术细节在论文中可能有所不同。例如,弓法/指法模块可能采用多任务学习的方式,同时预测弓的方向、速度和指法位置。动作生成模块可能采用对抗训练的方式,提高生成动作的真实性。此外,论文可能还采用了数据增强等技术,提高模型的泛化能力。具体的参数设置需要参考论文原文。

🖼️ 关键图片

📊 实验亮点

实验结果表明,SyncViolinist在未见过的小提琴演奏音频上取得了显著改进的定性和定量结果,优于现有技术水平的方法。具体而言,SyncViolinist在动作生成的准确性和同步性方面均取得了显著提升。此外,专业小提琴家的主观评估也表明,SyncViolinist生成的动作更加逼真和自然。

🎯 应用场景

SyncViolinist具有广泛的应用前景,例如在数字媒体制作中,可以自动生成逼真的小提琴演奏动画,提高制作效率和质量。在音乐教育领域,可以用于辅助教学,帮助学生更好地理解和学习小提琴演奏技巧。此外,该技术还可以应用于虚拟现实和增强现实等领域,为用户提供更加沉浸式的音乐体验。

📄 摘要(原文)

Automatically generating realistic musical performance motion can greatly enhance digital media production, often involving collaboration between professionals and musicians. However, capturing the intricate body, hand, and finger movements required for accurate musical performances is challenging. Existing methods often fall short due to the complex mapping between audio and motion, typically requiring additional inputs like scores or MIDI data. In this work, we present SyncViolinist, a multi-stage end-to-end framework that generates synchronized violin performance motion solely from audio input. Our method overcomes the challenge of capturing both global and fine-grained performance features through two key modules: a bowing/fingering module and a motion generation module. The bowing/fingering module extracts detailed playing information from the audio, which the motion generation module uses to create precise, coordinated body motions reflecting the temporal granularity and nature of the violin performance. We demonstrate the effectiveness of SyncViolinist with significantly improved qualitative and quantitative results from unseen violin performance audio, outperforming state-of-the-art methods. Extensive subjective evaluations involving professional violinists further validate our approach. The code and dataset are available at https://github.com/Kakanat/SyncViolinist.