Make-It-Animatable: An Efficient Framework for Authoring Animation-Ready 3D Characters

作者: Zhiyang Guo, Jinxu Xiang, Kai Ma, Wengang Zhou, Houqiang Li, Ran Zhang

分类: cs.GR, cs.CV

发布日期: 2024-11-27 (更新: 2025-03-11)

备注: CVPR 2025. Project page: https://jasongzy.github.io/Make-It-Animatable/

🔗 代码/项目: PROJECT_PAGE

💡 一句话要点

提出Make-It-Animatable框架,高效生成可动画3D角色模型

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱八:物理动画 (Physics-based Animation)

关键词: 3D角色动画 自动绑定 数据驱动 形状自动编码器 结构感知建模

📋 核心要点

- 现有自动绑定方法需要手动标注,骨骼拓扑结构固定,且泛化性不足,难以处理多样化的角色形状和姿势。

- Make-It-Animatable通过数据驱动的方式,统一生成高质量的混合权重、骨骼和姿势变换,实现快速角色动画绑定。

- 实验表明,该框架在质量和速度上均优于现有方法,能够处理具有非标准骨骼结构的角色。

📝 摘要(中文)

3D角色在现代创意产业中至关重要,但使其可动画通常需要在绑定和蒙皮等任务中进行大量手动工作。现有的自动绑定工具面临一些限制,包括需要手动注释、刚性骨骼拓扑以及在不同形状和姿势上的泛化能力有限。另一种方法是生成预先绑定到已绑定模板网格的可动画化身,但这种方法通常缺乏灵活性,并且通常仅限于逼真的人体形状。为了解决这些问题,我们提出Make-It-Animatable,这是一种新颖的数据驱动方法,可以在不到一秒的时间内使任何3D人形模型准备好进行角色动画制作,而与其形状和姿势无关。我们的统一框架生成高质量的混合权重、骨骼和姿势变换。通过结合基于粒子的形状自动编码器,我们的方法支持各种3D表示形式,包括网格和3D高斯溅射。此外,我们采用由粗到精的表示形式和结构感知建模策略,以确保即使对于具有非标准骨骼结构的角色,也能保证准确性和鲁棒性。我们进行了广泛的实验来验证我们框架的有效性。与现有方法相比,我们的方法在质量和速度方面均表现出显着提高。更多演示和代码可在https://jasongzy.github.io/Make-It-Animatable/上找到。

🔬 方法详解

问题定义:现有3D角色动画绑定方法,如自动绑定工具,存在需要手动标注、骨骼拓扑结构固定、泛化能力差等问题。另一种预绑定模板网格的方法缺乏灵活性,且仅限于逼真的人体形状。这些方法难以高效地处理各种形状和姿势的3D角色模型,使其快速应用于动画制作。

核心思路:论文的核心思路是利用数据驱动的方法,学习从3D角色形状到动画绑定参数(混合权重、骨骼、姿势变换)的映射关系。通过训练一个能够理解角色结构和形状的神经网络,实现对任意3D人形模型的快速自动绑定。这种方法避免了手动标注和固定骨骼拓扑的限制,提高了泛化能力和灵活性。

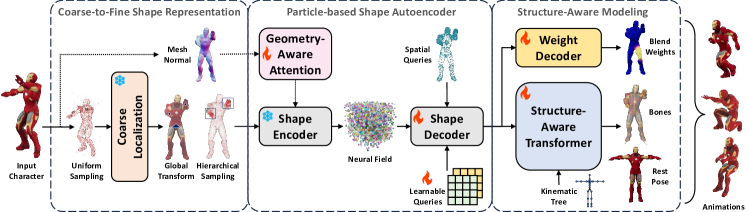

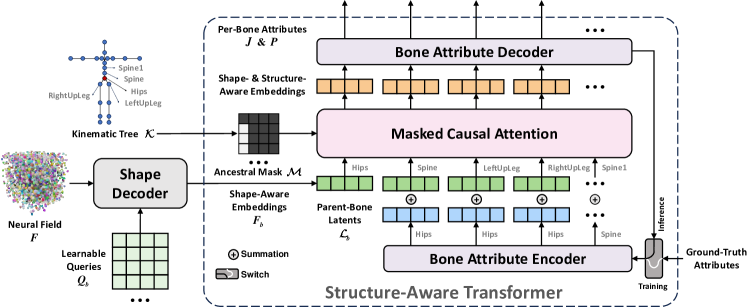

技术框架:Make-It-Animatable框架包含以下主要模块:1)粒子形状自动编码器:用于提取3D角色形状的特征表示,支持网格和3D高斯溅射等多种3D表示形式。2)粗到精的表示:首先生成粗略的绑定结果,然后逐步细化,提高准确性和鲁棒性。3)结构感知建模:利用角色结构的先验知识,指导网络学习,确保生成的绑定结果符合人体结构。整个流程无需人工干预,即可自动生成可动画的3D角色模型。

关键创新:该方法的主要创新点在于:1)统一的框架,能够同时生成混合权重、骨骼和姿势变换。2)基于粒子的形状自动编码器,支持多种3D表示形式。3)粗到精的表示和结构感知建模,提高了准确性和鲁棒性,尤其是在处理非标准骨骼结构的角色时。与现有方法相比,该方法更加高效、灵活和通用。

关键设计:粒子形状自动编码器使用多层感知机(MLP)进行编码和解码。粗到精的表示通过逐步增加网络的深度和分辨率来实现。结构感知建模通过引入骨骼结构的先验知识作为约束,例如骨骼长度和角度的范围。损失函数包括形状重建损失、混合权重损失和骨骼姿势损失,用于优化网络的参数。

🖼️ 关键图片

📊 实验亮点

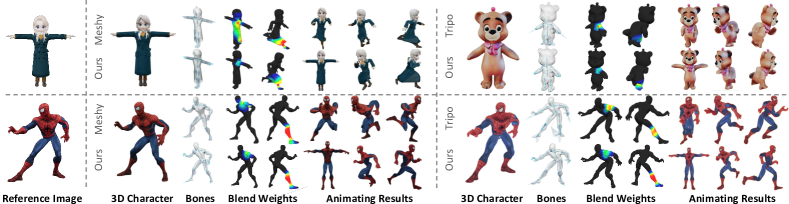

实验结果表明,Make-It-Animatable框架能够在不到一秒的时间内生成高质量的动画绑定结果。与现有方法相比,该方法在混合权重质量、骨骼姿势准确性和动画效果方面均有显著提升。尤其是在处理具有非标准骨骼结构的角色时,该方法的鲁棒性更强,能够生成更加自然的动画效果。

🎯 应用场景

该研究成果可广泛应用于游戏开发、电影制作、虚拟现实、增强现实等领域,能够大幅降低3D角色动画制作的成本和时间。通过自动生成可动画的3D角色模型,可以加速内容创作流程,并为用户提供更加个性化和多样化的角色选择。未来,该技术有望进一步扩展到其他类型的3D模型,例如动物和机械设备。

📄 摘要(原文)

3D characters are essential to modern creative industries, but making them animatable often demands extensive manual work in tasks like rigging and skinning. Existing automatic rigging tools face several limitations, including the necessity for manual annotations, rigid skeleton topologies, and limited generalization across diverse shapes and poses. An alternative approach is to generate animatable avatars pre-bound to a rigged template mesh. However, this method often lacks flexibility and is typically limited to realistic human shapes. To address these issues, we present Make-It-Animatable, a novel data-driven method to make any 3D humanoid model ready for character animation in less than one second, regardless of its shapes and poses. Our unified framework generates high-quality blend weights, bones, and pose transformations. By incorporating a particle-based shape autoencoder, our approach supports various 3D representations, including meshes and 3D Gaussian splats. Additionally, we employ a coarse-to-fine representation and a structure-aware modeling strategy to ensure both accuracy and robustness, even for characters with non-standard skeleton structures. We conducted extensive experiments to validate our framework's effectiveness. Compared to existing methods, our approach demonstrates significant improvements in both quality and speed. More demos and code are available at https://jasongzy.github.io/Make-It-Animatable/.