Real-time Diverse Motion In-betweening with Space-time Control

作者: Yuchen Chu, Zeshi Yang

分类: cs.GR, cs.LG

发布日期: 2024-09-30

备注: Presented at The 16th ACM SIGGRAPH Conference on Motion, Interaction, and Games (MIG '24)

💡 一句话要点

提出时空控制的运动中间帧生成框架,实现多样化实时动画

🎯 匹配领域: 支柱一:机器人控制 (Robot Control)

关键词: 运动中间帧生成 时空控制 骨骼动画 数据驱动 运动合成

📋 核心要点

- 现有运动中间帧生成方法缺乏对时空信息的精细控制,难以满足动画制作中对运动多样性和可控性的需求。

- 该论文提出一种数据驱动框架,通过注入动态条件和显式运动控制,实现对运动中间帧的时空控制,从而生成多样化的运动。

- 实验结果表明,该方法能够合成步行动作和非结构化动作,生成高质量的动画,验证了其在运动生成方面的有效性。

📝 摘要(中文)

本文提出了一种数据驱动的框架,用于为骨骼动画角色生成多样化的中间帧运动。该方法将动态条件和显式的运动控制注入到运动过渡的过程中。值得注意的是,这种集成通过允许用户将诸如持续时间、路径、风格等附加条件加入到中间帧生成过程中,实现了更精细的时空控制。实验证明,我们的中间帧生成方法可以合成包括步行动作和非结构化动作在内的多种运动,从而实现丰富、通用和高质量的动画生成。

🔬 方法详解

问题定义:论文旨在解决骨骼动画中运动中间帧生成的问题。现有方法通常难以在生成中间帧时,对运动的时长、路径、风格等进行精确控制,导致生成结果缺乏多样性和可控性。这限制了动画制作的灵活性和效率。

核心思路:论文的核心思路是将动态条件和显式的运动控制融入到运动过渡的过程中。通过允许用户指定诸如持续时间、路径、风格等附加条件,模型能够生成满足特定时空约束的中间帧运动。这种方法使得用户可以更精细地控制动画的生成过程,从而实现多样化和高质量的动画效果。

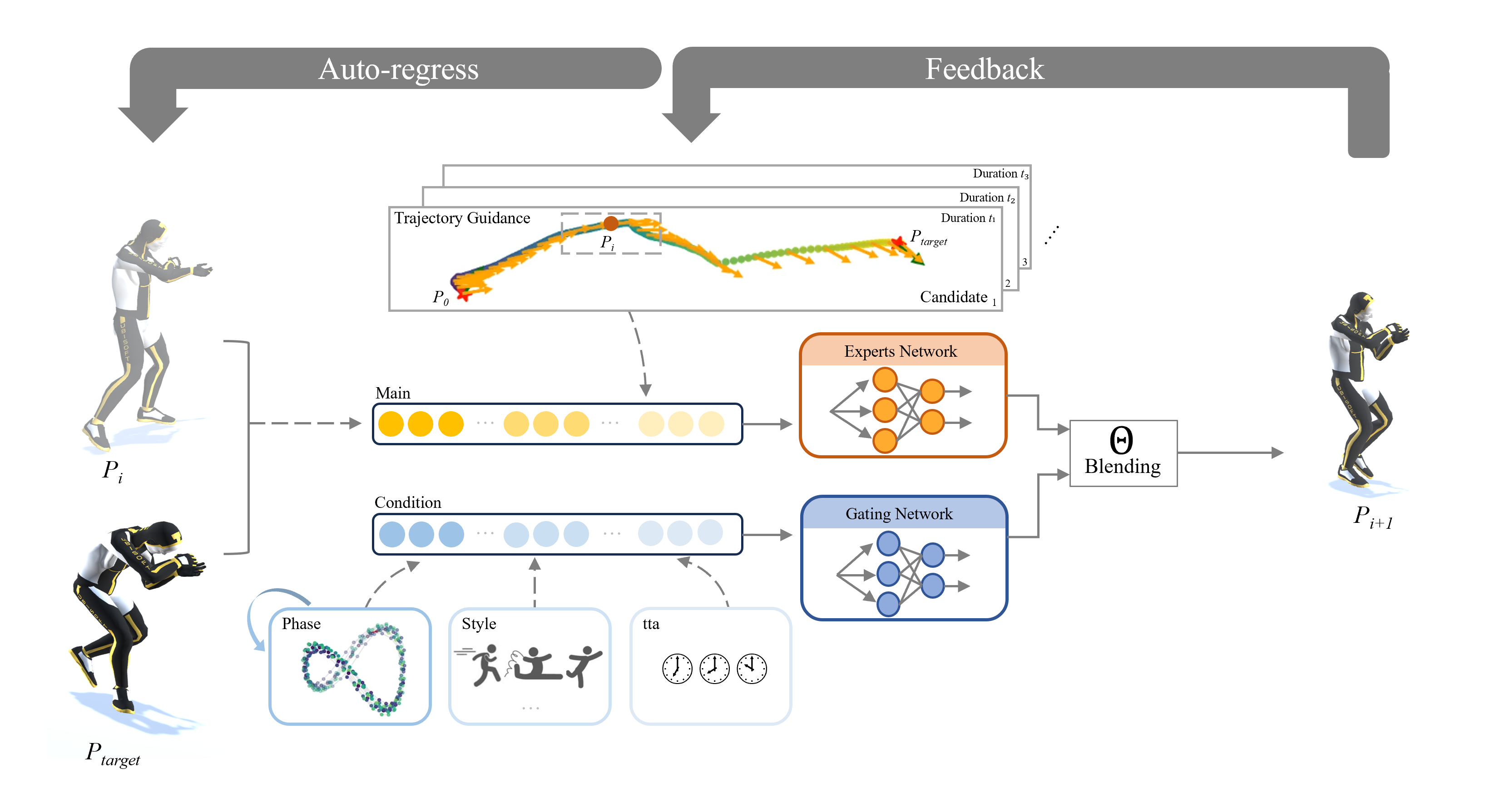

技术框架:该框架主要包含以下几个模块:首先,输入起始帧和结束帧的运动数据。然后,用户可以输入额外的时空控制条件,例如期望的运动持续时间、路径或风格。接下来,模型利用这些信息生成中间帧运动。具体的生成过程可能涉及神经网络模型,例如循环神经网络(RNN)或Transformer,用于学习运动数据中的时序关系和风格特征。最后,输出生成的中间帧序列,形成完整的动画片段。

关键创新:该方法最重要的创新在于将动态条件和显式的运动控制集成到中间帧生成过程中。与以往方法相比,该方法允许用户在生成过程中直接干预运动的时空特性,从而实现更精细的控制和更丰富的运动多样性。这种集成使得动画制作人员可以更灵活地调整动画效果,满足不同的创作需求。

关键设计:具体的网络结构和损失函数等技术细节在摘要中没有明确说明,属于未知信息。但可以推测,损失函数可能包含运动平滑性损失、时空约束损失(例如,确保生成的运动符合指定的持续时间和路径)以及风格一致性损失(例如,确保生成的运动风格与指定的风格一致)。网络结构可能采用编码器-解码器结构,其中编码器用于提取起始帧和结束帧的运动特征,解码器用于生成中间帧运动。

🖼️ 关键图片

📊 实验亮点

论文展示了该方法能够生成包括步行动作和非结构化动作在内的多种运动,并且能够根据用户指定的时空约束生成符合要求的中间帧。虽然摘要中没有给出具体的性能数据,但强调了生成动画的丰富性、通用性和高质量,表明该方法在运动生成方面具有显著优势。

🎯 应用场景

该研究成果可广泛应用于游戏开发、电影动画制作、虚拟现实等领域。通过该技术,动画师可以更高效地生成高质量的动画内容,降低制作成本。此外,该技术还可以应用于人机交互领域,例如,根据用户的指令实时生成虚拟角色的运动。

📄 摘要(原文)

In this work, we present a data-driven framework for generating diverse in-betweening motions for kinematic characters. Our approach injects dynamic conditions and explicit motion controls into the procedure of motion transitions. Notably, this integration enables a finer-grained spatial-temporal control by allowing users to impart additional conditions, such as duration, path, style, etc., into the in-betweening process. We demonstrate that our in-betweening approach can synthesize both locomotion and unstructured motions, enabling rich, versatile, and high-quality animation generation.