Deep Neural Implicit Representation of Accessibility for Multi-Axis Manufacturing

作者: George P. Harabin, Amir Mirzendehdel, Morad Behandish

分类: cs.GR, cs.CE, cs.LG, cs.RO

发布日期: 2024-08-30 (更新: 2024-09-05)

备注: Special Issue on symposium on Solid and Physical Modeling (SPM 2023)

期刊: Journal of Computer-Aided Design, 2023

DOI: 10.1016/j.cad.2023.103556

💡 一句话要点

提出基于深度隐式表示的碰撞检测方法,加速多轴增材/减材制造中的可达性分析。

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 碰撞检测 深度学习 隐式表示 多轴制造 可达性分析

📋 核心要点

- 多轴制造中,刀具与工件的碰撞检测是关键问题,传统方法计算量大,效率低。

- 利用深度神经网络学习碰撞度量场的隐式表达,实现高效的碰撞检测和可达性分析。

- 该方法能从稀疏数据中准确插值,内存占用小,并能通过微调适应几何变化。

📝 摘要(中文)

本文针对多轴增材和减材制造中的设计与工艺规划问题,提出了一种基于深度神经网络(DNNs)的碰撞检测隐式表示方法。该方法旨在解决移动物体(如刀具组件)与固定物体(如零件与夹具的组合体)之间的碰撞避免问题。碰撞度量可以被视为6D非欧几里得构型空间上的紧支撑标量场。传统方法对该场的显式表示和计算在时间和空间上都非常昂贵。本文方法通过DNNs对碰撞度量场进行隐式表示,能够从稀疏采样的旋转中准确插值碰撞度量,并以较小的内存占用表示碰撞度量场。此外,该表示可以通过微调进行高效更新,从而更有效地训练多分辨率数据,并适应几何体的增量变化(例如,在受CNC刀具可达性约束的零件拓扑优化等迭代过程中)。

🔬 方法详解

问题定义:多轴增材和减材制造中,刀具轨迹规划需要避免刀具与工件、夹具等发生碰撞。传统的碰撞检测方法,例如基于体素化的快速傅里叶变换(FFT),在计算和存储上都面临巨大的挑战,尤其是在高分辨率和复杂几何形状的情况下。现有方法的时间复杂度为O(mn^3 log n),空间复杂度为O(mn^3),其中m是旋转采样数,n^3是体素分辨率。这种显式表示方法难以满足实际应用的需求。

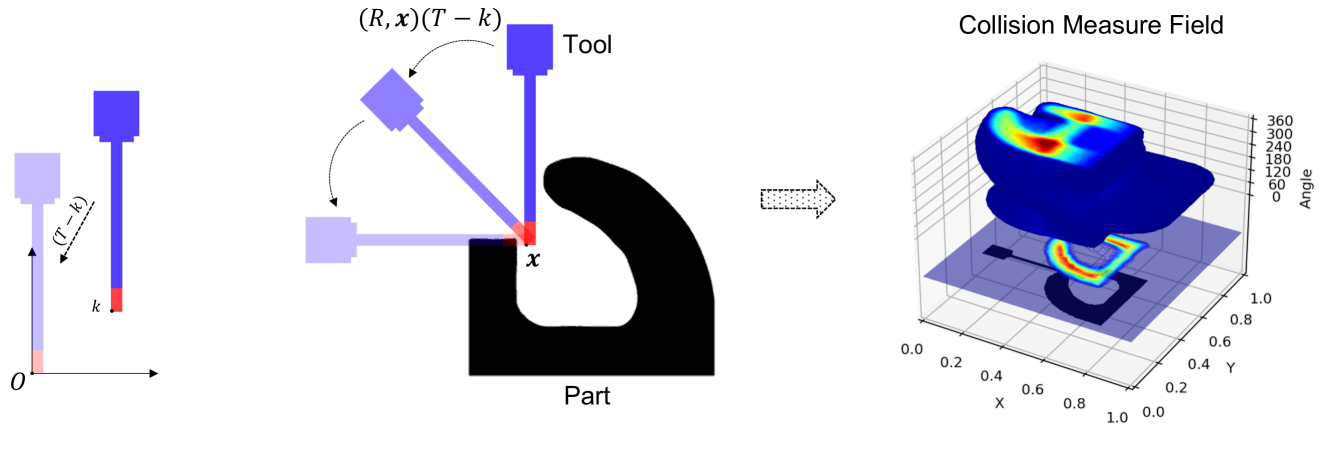

核心思路:本文的核心思路是利用深度神经网络学习一个隐式的碰撞度量场。该场将刀具的位姿(包括位置和姿态)映射到一个标量值,该值表示在该位姿下发生碰撞的程度。通过训练神经网络来逼近这个隐式场,可以避免显式地计算和存储整个碰撞度量场,从而大大降低了计算复杂度和内存占用。

技术框架:该方法主要包含以下几个阶段:1)数据生成:对刀具的位姿进行稀疏采样,并使用传统的碰撞检测方法(例如基于体素化的方法)计算每个位姿下的碰撞度量值。2)网络训练:使用采样得到的位姿和碰撞度量值作为训练数据,训练一个深度神经网络来逼近碰撞度量场。3)碰撞检测:在刀具轨迹规划过程中,使用训练好的神经网络来预测每个位姿下的碰撞度量值,从而判断是否发生碰撞。

关键创新:该方法最重要的技术创新点在于使用深度神经网络来隐式地表示碰撞度量场。与传统的显式表示方法相比,隐式表示方法具有以下优势:1)内存占用小:神经网络只需要存储网络的参数,而不需要存储整个碰撞度量场。2)计算效率高:神经网络的预测速度快,可以实时地进行碰撞检测。3)可微性:神经网络是可微的,可以方便地进行梯度优化。

关键设计:论文中没有明确给出网络结构的具体细节,但可以推断其为一个多层感知机(MLP)或类似的结构,输入是刀具的6D位姿(3D位置和3D旋转),输出是碰撞度量值。损失函数可以选择均方误差(MSE)或类似的回归损失函数,用于衡量神经网络预测的碰撞度量值与真实值之间的差异。此外,论文还提到了使用多分辨率数据进行训练,以及通过微调来适应几何变化,这些都是重要的训练技巧。

🖼️ 关键图片

📊 实验亮点

论文提出了一种基于深度隐式表示的碰撞检测方法,能够从稀疏采样的旋转中准确插值碰撞度量,并以较小的内存占用表示碰撞度量场。该方法可以通过微调进行高效更新,从而更有效地训练多分辨率数据,并适应几何体的增量变化。具体的性能数据和对比基线在摘要中没有明确给出,属于未知信息。

🎯 应用场景

该研究成果可广泛应用于多轴增材制造、减材制造、混合制造等领域。通过高效的碰撞检测,可以优化刀具路径规划,提高加工效率和质量,降低生产成本。此外,该方法还可应用于机器人运动规划、虚拟装配等领域,具有重要的实际应用价值和广阔的应用前景。

📄 摘要(原文)

One of the main concerns in design and process planning for multi-axis additive and subtractive manufacturing is collision avoidance between moving objects (e.g., tool assemblies) and stationary objects (e.g., a part unified with fixtures). The collision measure for various pairs of relative rigid translations and rotations between the two pointsets can be conceptualized by a compactly supported scalar field over the 6D non-Euclidean configuration space. Explicit representation and computation of this field is costly in both time and space. If we fix $O(m)$ sparsely sampled rotations (e.g., tool orientations), computation of the collision measure field as a convolution of indicator functions of the 3D pointsets over a uniform grid (i.e., voxelized geometry) of resolution $O(n^3)$ via fast Fourier transforms (FFTs) scales as in $O(mn^3 \log n)$ in time and $O(mn^3)$ in space. In this paper, we develop an implicit representation of the collision measure field via deep neural networks (DNNs). We show that our approach is able to accurately interpolate the collision measure from a sparse sampling of rotations, and can represent the collision measure field with a small memory footprint. Moreover, we show that this representation can be efficiently updated through fine-tuning to more efficiently train the network on multi-resolution data, as well as accommodate incremental changes to the geometry (such as might occur in iterative processes such as topology optimization of the part subject to CNC tool accessibility constraints).