ContourCraft: Learning to Resolve Intersections in Neural Multi-Garment Simulations

作者: Artur Grigorev, Giorgio Becherini, Michael J. Black, Otmar Hilliges, Bernhard Thomaszewski

分类: cs.GR, cs.LG

发布日期: 2024-05-15 (更新: 2024-05-24)

备注: Accepted for publication by SIGGRAPH 2024, conference track

💡 一句话要点

ContourCraft:学习解决神经多层服装模拟中的自相交问题

🎯 匹配领域: 支柱四:生成式动作 (Generative Motion) 支柱七:动作重定向 (Motion Retargeting) 支柱八:物理动画 (Physics-based Animation)

关键词: 神经服装模拟 自相交处理 图神经网络 碰撞检测 深度学习

📋 核心要点

- 现有神经服装模拟方法难以有效处理碰撞和自相交,尤其是在复杂的多层服装场景中。

- ContourCraft通过引入相交轮廓损失,惩罚自相交并鼓励快速解决,从而实现鲁棒的自相交恢复。

- 实验表明,ContourCraft显著改善了学习模拟的碰撞处理,并在动态人体运动下的多层服装模拟中取得了优异的视觉效果。

📝 摘要(中文)

近年来,基于学习的服装模拟方法开始展现其潜力。然而,在神经模拟中处理碰撞和自相交问题仍然是一个尚未解决的难题。本文提出了ContourCraft,一种基于学习的解决方案,用于处理神经服装模拟中的自相交问题。与严重依赖无自相交输入的传统方法不同,ContourCraft能够鲁棒地从因碰撞遗漏、身体自穿透或手动设计的多层服装错误而引入的自相交中恢复。ContourCraft的技术核心是一种新颖的相交轮廓损失,它惩罚相互穿透并鼓励快速解决。我们将相交损失与基于图神经网络(GNN)的神经服装模拟方法中的避碰排斥目标相结合。我们通过一系列具有挑战性的、多样化的动态人体运动下的多层服装展示了该方法的能力。广泛的分析表明,ContourCraft显著改善了学习模拟的碰撞处理,并产生了视觉上引人注目的结果。

🔬 方法详解

问题定义:现有的神经服装模拟方法在处理复杂场景下的碰撞和自相交问题时面临挑战。传统方法通常依赖于无自相交的输入,一旦出现自相交,性能会显著下降。尤其是在多层服装模拟中,手动设计难以避免自相交,而学习方法也难以有效处理。

核心思路:ContourCraft的核心思路是通过学习的方式,直接从包含自相交的模拟状态中恢复。它不依赖于完美的初始状态,而是通过优化一个专门设计的损失函数,来惩罚自相交并引导模拟朝着无自相交的状态演进。这种方法使得模拟器能够更鲁棒地处理各种复杂的服装和运动。

技术框架:ContourCraft将相交轮廓损失集成到基于图神经网络(GNN)的神经服装模拟方法中。整体流程包括:1)输入服装的网格表示和人体运动数据;2)使用GNN预测下一帧的服装状态;3)计算相交轮廓损失和避碰排斥损失;4)使用梯度下降优化GNN的参数,从而提高模拟的准确性和鲁棒性。

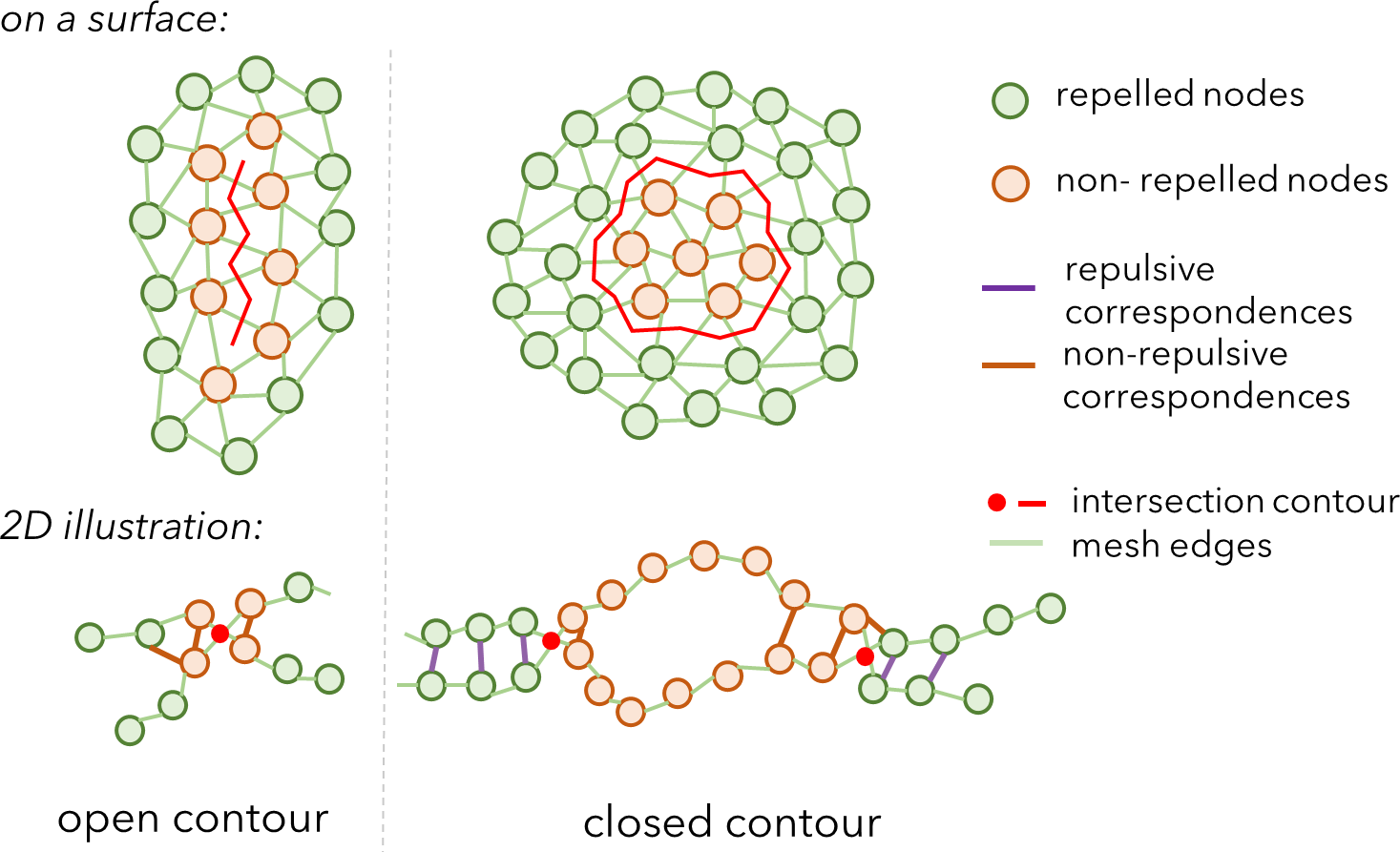

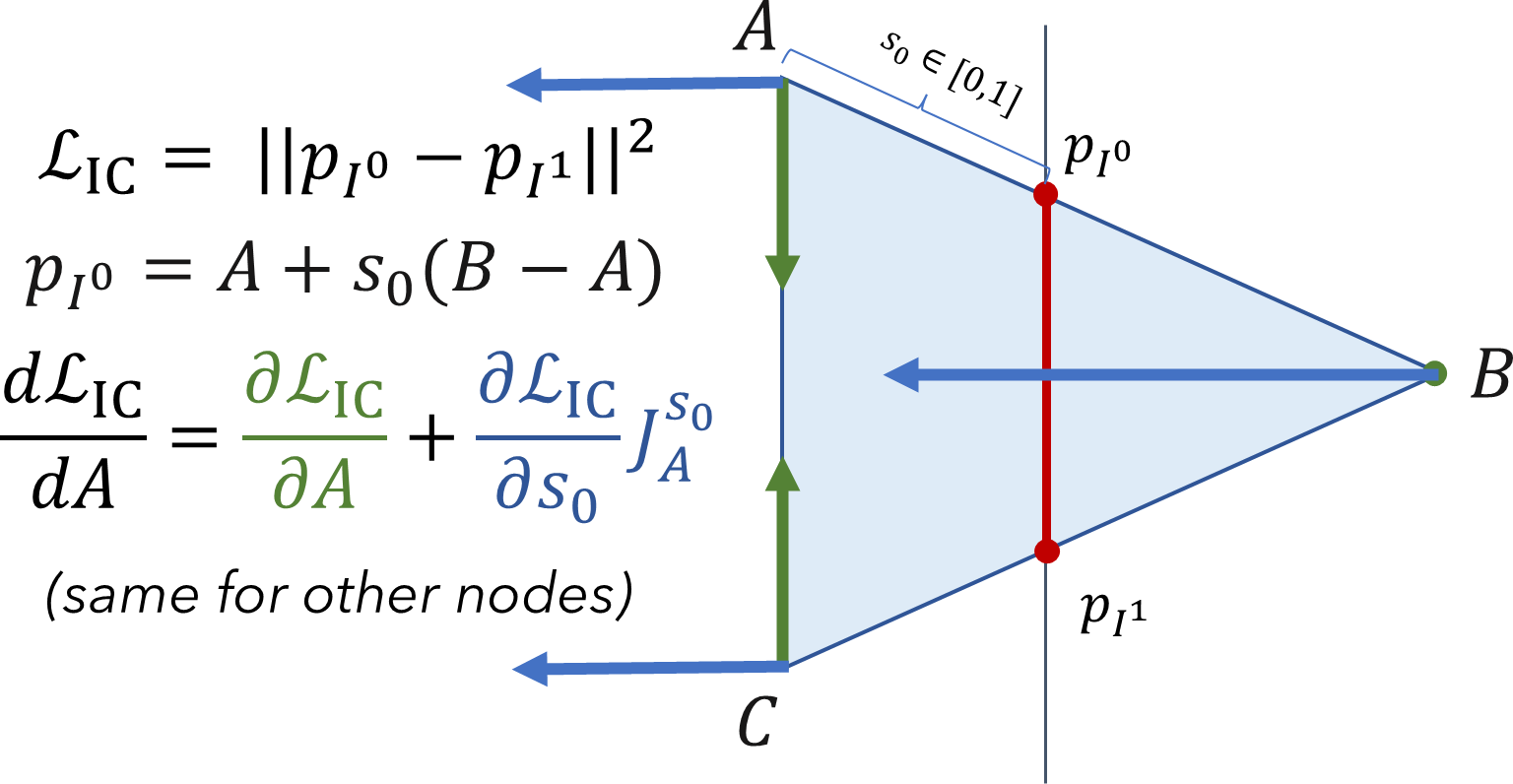

关键创新:ContourCraft最重要的技术创新点是相交轮廓损失。该损失函数的设计目标是惩罚服装网格中的自相交,并鼓励快速消除这些自相交。与传统的碰撞检测和响应方法不同,相交轮廓损失直接作用于模拟状态,无需显式地计算碰撞力。

关键设计:相交轮廓损失的关键设计在于如何有效地检测和量化自相交。论文中具体采用了基于网格面片的相交检测方法,并设计了一个惩罚函数,该函数与相交区域的大小成正比。此外,避碰排斥损失用于防止服装与人体或其他物体发生穿透。GNN的具体结构和参数设置对模拟的性能也有重要影响,论文中采用了多层GCN结构,并经过了仔细的调参。

🖼️ 关键图片

📊 实验亮点

实验结果表明,ContourCraft在处理多层服装模拟中的自相交问题方面取得了显著的改进。与现有的基于学习的模拟方法相比,ContourCraft能够更有效地消除自相交,并产生更逼真的视觉效果。在定量评估方面,ContourCraft在碰撞指标上取得了显著的提升,证明了其在碰撞处理方面的优越性。

🎯 应用场景

ContourCraft在虚拟试衣、游戏角色动画、电影特效等领域具有广泛的应用前景。它可以用于创建更逼真、更自然的服装模拟效果,提高虚拟角色的真实感和互动性。此外,该方法还可以用于服装设计和制造,帮助设计师快速评估服装的穿着效果和避免设计缺陷。

📄 摘要(原文)

Learning-based approaches to cloth simulation have started to show their potential in recent years. However, handling collisions and intersections in neural simulations remains a largely unsolved problem. In this work, we present \moniker{}, a learning-based solution for handling intersections in neural cloth simulations. Unlike conventional approaches that critically rely on intersection-free inputs, \moniker{} robustly recovers from intersections introduced through missed collisions, self-penetrating bodies, or errors in manually designed multi-layer outfits. The technical core of \moniker{} is a novel intersection contour loss that penalizes interpenetrations and encourages rapid resolution thereof. We integrate our intersection loss with a collision-avoiding repulsion objective into a neural cloth simulation method based on graph neural networks (GNNs). We demonstrate our method's ability across a challenging set of diverse multi-layer outfits under dynamic human motions. Our extensive analysis indicates that \moniker{} significantly improves collision handling for learned simulation and produces visually compelling results.