HandMCM: Multi-modal Point Cloud-based Correspondence State Space Model for 3D Hand Pose Estimation

作者: Wencan Cheng, Gim Hee Lee

分类: cs.CV

发布日期: 2026-04-07

💡 一句话要点

提出HandMCM,利用多模态点云和Correspondence Mamba解决3D手部姿态估计中的遮挡问题

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 3D手部姿态估计 点云 多模态融合 状态空间模型 Mamba 遮挡处理 人机交互

📋 核心要点

- 3D手部姿态估计面临手部自遮挡和与物体交互遮挡的挑战,现有方法难以准确估计关键点位置。

- HandMCM基于Mamba模型,通过局部信息注入和对应关系建模,学习关键点动态拓扑,提升遮挡场景下的鲁棒性。

- 实验结果表明,HandMCM在三个基准数据集上显著优于现有方法,尤其在严重遮挡场景下性能提升明显。

📝 摘要(中文)

本文提出了一种名为HandMCM的新方法,用于解决3D手部姿态估计中因手部自遮挡和与物体交互造成的遮挡问题。HandMCM基于强大的状态空间模型(Mamba),通过引入局部信息注入/过滤模块和对应关系建模模块,有效地学习了关键点在各种遮挡场景下的高度动态的运动学拓扑结构。此外,通过整合多模态图像特征,增强了输入的鲁棒性和表征能力,从而实现了更准确的手部姿态估计。在三个基准数据集上的实验评估表明,我们的模型显著优于当前最先进的方法,尤其是在涉及严重遮挡的具有挑战性的场景中。这些结果突出了我们的方法在提高实际应用中3D手部姿态估计的准确性和可靠性方面的潜力。

🔬 方法详解

问题定义:论文旨在解决3D手部姿态估计问题,尤其关注手部自遮挡以及与物体交互时产生的遮挡。现有方法在处理这些遮挡情况时,往往难以准确估计手部关键点的位置,导致姿态估计精度下降。

核心思路:论文的核心思路是利用状态空间模型(Mamba)强大的序列建模能力,结合局部信息处理和对应关系建模,学习手部关键点在不同遮挡情况下的动态拓扑结构。同时,融合多模态图像特征,增强模型的鲁棒性和表征能力。

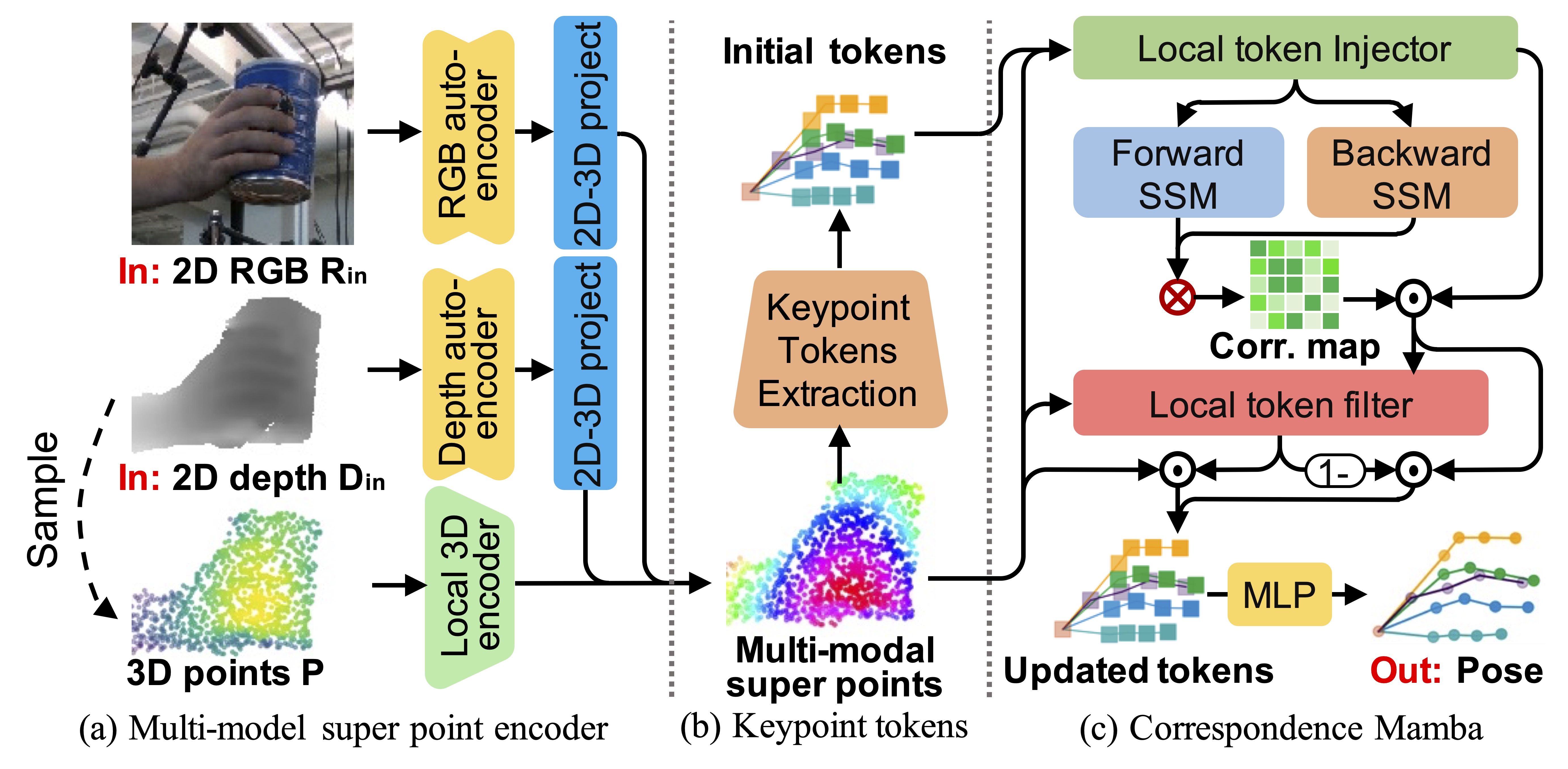

技术框架:HandMCM的整体框架包含以下几个主要模块:1) 多模态特征提取模块,用于提取点云和图像的特征;2) 局部信息注入/过滤模块,用于增强局部信息的表达和过滤噪声;3) Correspondence Mamba模块,用于建模关键点之间的对应关系和动态拓扑结构;4) 姿态估计模块,用于根据学习到的特征和对应关系,估计手部关键点的3D位置。

关键创新:论文的关键创新在于提出了Correspondence Mamba模块,该模块能够有效地学习手部关键点在各种遮挡场景下的动态拓扑结构。与传统的基于图卷积网络的方法相比,Correspondence Mamba能够更好地捕捉关键点之间的长程依赖关系,并对遮挡具有更强的鲁棒性。此外,多模态特征融合也增强了模型的表征能力。

关键设计:Correspondence Mamba模块采用了Mamba架构,并针对手部姿态估计任务进行了优化。具体来说,该模块使用了选择性状态空间模型(Selective State Space Model),能够根据输入动态地调整状态转移矩阵。此外,论文还设计了一种新的损失函数,用于约束关键点之间的对应关系,并鼓励模型学习更准确的姿态估计。

🖼️ 关键图片

📊 实验亮点

HandMCM在三个公开数据集上取得了显著的性能提升,尤其是在包含严重遮挡的挑战性场景中。实验结果表明,HandMCM显著优于当前最先进的方法,验证了Correspondence Mamba模块和多模态特征融合的有效性。具体性能数据在论文中有详细展示,证明了该方法在3D手部姿态估计领域的领先地位。

🎯 应用场景

该研究成果可广泛应用于人机交互、增强现实、虚拟现实、机器人控制等领域。准确的手部姿态估计是实现自然、流畅人机交互的关键,有助于提升用户体验。在医疗康复领域,该技术可用于评估患者的手部功能,辅助康复训练。未来,该技术有望应用于远程操控、智能辅助等更多场景。

📄 摘要(原文)

3D hand pose estimation that involves accurate estimation of 3D human hand keypoint locations is crucial for many human-computer interaction applications such as augmented reality. However, this task poses significant challenges due to self-occlusion of the hands and occlusions caused by interactions with objects. In this paper, we propose HandMCM to address these challenges. Our HandMCM is a novel method based on the powerful state space model (Mamba). By incorporating modules for local information injection/filtering and correspondence modeling, the proposed correspondence Mamba effectively learns the highly dynamic kinematic topology of keypoints across various occlusion scenarios. Moreover, by integrating multi-modal image features, we enhance the robustness and representational capacity of the input, leading to more accurate hand pose estimation. Empirical evaluations on three benchmark datasets demonstrate that our model significantly outperforms current state-of-the-art methods, particularly in challenging scenarios involving severe occlusions. These results highlight the potential of our approach to advance the accuracy and reliability of 3D hand pose estimation in practical applications.