SPHINX: A Synthetic Environment for Visual Perception and Reasoning

作者: Md Tanvirul Alam, Saksham Aggarwal, Justin Yang Chae, Nidhi Rastogi

分类: cs.CV, cs.AI, cs.LG

发布日期: 2026-04-07

💡 一句话要点

SPHINX:用于视觉感知与推理的合成环境,解决认知基元任务。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 视觉推理 合成环境 程序化生成 强化学习 认知基元 视觉语言模型 多模态学习

📋 核心要点

- 现有视觉推理模型在复杂认知任务上表现不足,缺乏高质量、可控的训练数据和评估基准。

- Sphinx 通过程序化生成包含多种视觉元素的谜题,并提供可验证的ground-truth,实现精确评估和大规模数据集构建。

- 实验表明,即使是GPT-5在Sphinx上的表现也远低于人类,而使用可验证奖励的强化学习能显著提升模型性能。

📝 摘要(中文)

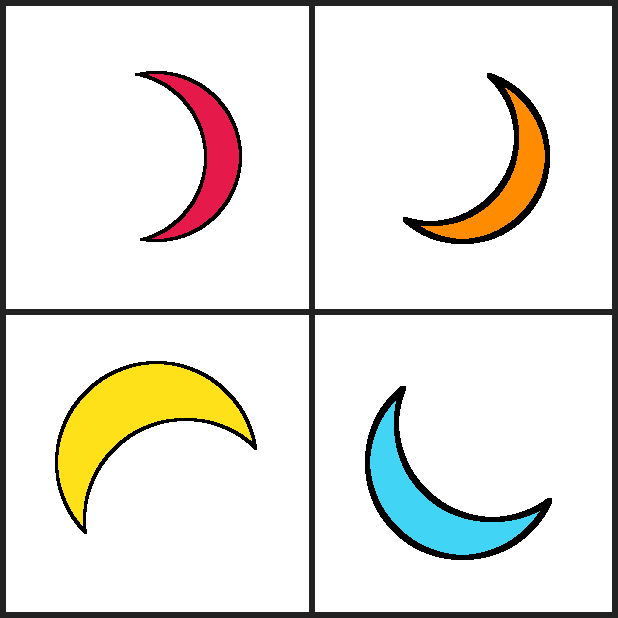

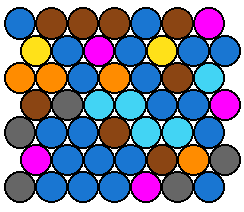

本文提出了一个名为 Sphinx 的合成环境,用于视觉感知和推理,其目标是核心认知基元。Sphinx 使用主题、瓦片、图表、图标和几何基元程序化地生成谜题,每个谜题都配有可验证的真实解,从而能够进行精确评估和大规模数据集构建。该基准测试涵盖了 25 种任务类型,包括对称性检测、几何变换、空间推理、图表解释和序列预测。对最近的大型视觉语言模型 (LVLM) 的评估表明,即使是最先进的 GPT-5 也仅达到 51.1% 的准确率,远低于人类的表现。最后,我们证明了使用可验证奖励的强化学习 (RLVR) 能够显著提高模型在这些任务上的准确性,并在外部视觉推理基准测试中产生增益,突显了其在推进多模态推理方面的潜力。

🔬 方法详解

问题定义:现有视觉语言模型在处理需要复杂推理的视觉任务时,性能仍然有限。缺乏一个能够系统地评估和训练模型在核心认知基元(例如,空间推理、几何变换、图表理解等)上的能力的合成环境。现有的数据集通常规模有限,或者缺乏精确的ground-truth,难以进行有效的模型训练和评估。

核心思路:Sphinx 的核心思路是利用程序化生成技术,创建一个可控、可扩展的合成环境,用于生成各种视觉推理谜题。通过程序化生成,可以精确控制谜题的难度、类型和ground-truth,从而能够系统地评估模型在不同认知基元上的表现。此外,程序化生成还能够生成大规模的数据集,用于训练模型。

技术框架:Sphinx 的整体框架包括以下几个主要模块:1) 谜题生成器:使用程序化生成技术,根据预定义的规则和参数,生成各种类型的视觉推理谜题。2) Ground-truth 生成器:为每个谜题生成可验证的ground-truth解决方案。3) 评估模块:使用ground-truth评估模型在谜题上的表现。4) 强化学习模块:使用可验证的奖励信号,训练模型以提高其在视觉推理任务上的性能。

关键创新:Sphinx 的关键创新在于其程序化生成方法和可验证的ground-truth。程序化生成允许创建无限数量的具有精确控制的谜题,而可验证的ground-truth使得能够进行精确的评估和有效的强化学习。与现有方法相比,Sphinx 能够更系统地评估和训练模型在核心认知基元上的能力。

关键设计:Sphinx 的关键设计包括:1) 谜题类型的选择:选择了25种涵盖不同认知基元的任务类型,例如对称性检测、几何变换、空间推理、图表解释和序列预测。2) 程序化生成规则的设计:设计了精细的程序化生成规则,以确保生成的谜题具有多样性和挑战性。3) 奖励函数的设计:设计了可验证的奖励函数,以指导强化学习代理的学习。奖励函数基于模型预测与ground-truth之间的差异进行计算。

🖼️ 关键图片

📊 实验亮点

实验结果表明,即使是最先进的 GPT-5 模型在 SPHINX 基准测试中也仅达到 51.1% 的准确率,远低于人类水平。通过使用可验证奖励的强化学习 (RLVR) 在 SPHINX 上训练模型,可以显著提高模型在这些任务上的准确性,并在外部视觉推理基准测试中获得性能提升。

🎯 应用场景

SPHINX 有潜力应用于机器人导航、自动驾驶、智能助手等领域。通过在 SPHINX 中训练模型,可以提高其在真实世界场景中的视觉感知和推理能力。此外,SPHINX 还可以用于评估和比较不同视觉语言模型的性能,推动多模态人工智能的发展。

📄 摘要(原文)

We present Sphinx, a synthetic environment for visual perception and reasoning that targets core cognitive primitives. Sphinx procedurally generates puzzles using motifs, tiles, charts, icons, and geometric primitives, each paired with verifiable ground-truth solutions, enabling both precise evaluation and large-scale dataset construction. The benchmark covers 25 task types spanning symmetry detection, geometric transformations, spatial reasoning, chart interpretation, and sequence prediction. Evaluating recent large vision-language models (LVLMs) shows that even state-of-the-art GPT-5 attains only 51.1% accuracy, well below human performance. Finally, we demonstrate that reinforcement learning with verifiable rewards (RLVR) substantially improves model accuracy on these tasks and yields gains on external visual reasoning benchmarks, highlighting its promise for advancing multimodal reasoning.