SAGA: Source Attribution of Generative AI Videos

作者: Rohit Kundu, Vishal Mohanty, Hao Xiong, Shan Jia, Athula Balachandran, Amit K. Roy-Chowdhury

分类: cs.CV, cs.AI

发布日期: 2026-04-06

💡 一句话要点

SAGA:首个生成式AI视频溯源框架,实现多粒度模型溯源与可解释性分析。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 生成式AI 视频溯源 多粒度分类 视频Transformer 可解释性

📋 核心要点

- 现有方法难以应对生成式AI视频滥用风险,缺乏对生成模型的细粒度溯源能力。

- SAGA框架通过视频Transformer架构和数据高效的预训练策略,实现多粒度生成模型溯源。

- 实验表明,SAGA仅使用少量数据即可达到SOTA溯源性能,并提供可解释的时间注意力签名。

📝 摘要(中文)

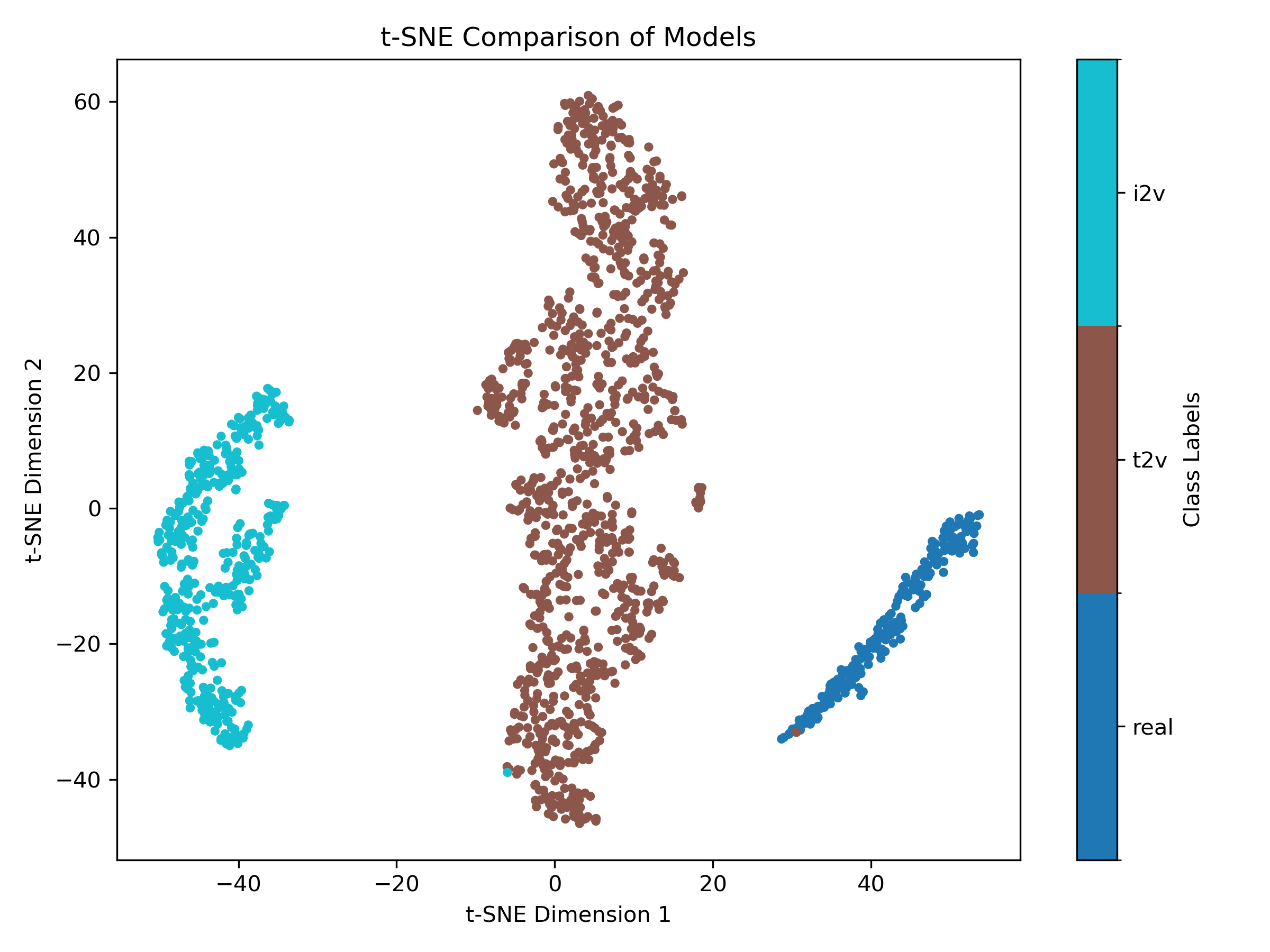

生成式AI的快速发展导致了超逼真的合成视频的出现,加剧了滥用风险,并超越了二元真/假检测器的能力。我们提出了SAGA(生成式AI视频溯源),这是第一个全面的框架,旨在解决大规模AI生成视频来源溯源的迫切需求。与传统的检测不同,SAGA可以识别所使用的特定生成模型。它独特地提供了跨五个级别的多粒度溯源:真实性、生成任务(例如,T2V/I2V)、模型版本、开发团队和精确的生成器,从而提供更丰富的取证洞察力。我们新颖的视频Transformer架构,利用了来自强大的视觉基础模型的特征,有效地捕获了时空伪影。至关重要的是,我们引入了一种数据高效的预训练和溯源策略,使SAGA能够仅使用每个类别0.5%的源标记数据即可实现最先进的溯源,与完全监督的性能相匹配。此外,我们提出了一种新颖的可解释性方法,即时间注意力签名(T-Sigs),它可以可视化学习到的时间差异,从而为不同视频生成器可区分的原因提供了第一个解释。在公共数据集(包括跨域场景)上进行的大量实验表明,SAGA为合成视频来源设定了新的基准,为取证和监管应用提供了关键的、可解释的见解。

🔬 方法详解

问题定义:当前AI生成视频检测方法主要集中于真伪二元分类,无法提供生成模型的具体信息,例如模型版本、开发团队等。这使得溯源和监管变得困难,也难以应对日益复杂的生成模型带来的挑战。现有方法在数据效率和可解释性方面也存在不足。

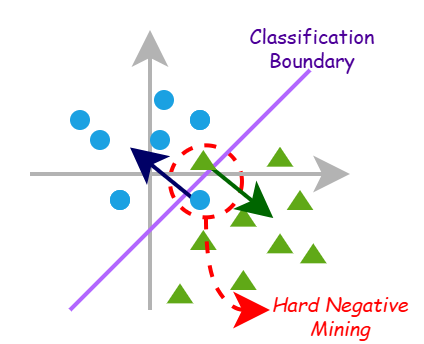

核心思路:SAGA的核心思路是构建一个多粒度的溯源框架,能够从真实性、生成任务、模型版本、开发团队和精确生成器五个层次进行溯源。通过学习视频中的时空伪影,区分不同生成模型。采用数据高效的预训练和溯源策略,减少对大量标注数据的依赖。同时,引入时间注意力签名(T-Sigs)来解释模型的可区分性。

技术框架:SAGA框架主要包含以下几个模块:1) 视频Transformer架构,用于提取视频的时空特征;2) 视觉基础模型,提供鲁棒的特征表示;3) 多粒度分类器,用于预测视频的来源信息;4) 数据高效的预训练和溯源策略,减少对标注数据的需求;5) 时间注意力签名(T-Sigs),用于可视化模型学习到的时间差异。整体流程是:首先利用视觉基础模型提取视频帧的特征,然后通过视频Transformer学习时空特征,最后利用多粒度分类器进行溯源。

关键创新:SAGA的关键创新在于:1) 提出了多粒度的溯源框架,能够提供更丰富的取证信息;2) 引入了数据高效的预训练和溯源策略,显著减少了对标注数据的需求;3) 提出了时间注意力签名(T-Sigs),为模型的可解释性提供了新的视角。与现有方法相比,SAGA能够提供更细粒度的溯源信息,并且具有更好的数据效率和可解释性。

关键设计:SAGA使用了视频Transformer架构来捕获视频的时空伪影。具体来说,使用了Transformer Encoder结构,输入是视觉基础模型提取的帧特征序列。在训练过程中,使用了交叉熵损失函数来优化多粒度分类器的性能。数据高效的预训练和溯源策略包括两个阶段:首先,使用大量的无标签数据进行预训练,学习通用的视频表示;然后,使用少量的标注数据进行微调,优化溯源性能。T-Sigs通过可视化Transformer Encoder中注意力权重随时间的变化,来解释模型学习到的时间差异。

🖼️ 关键图片

📊 实验亮点

SAGA在多个公共数据集上取得了SOTA性能,仅使用0.5%的源标记数据即可达到完全监督的性能。在跨域场景下,SAGA仍然表现出良好的泛化能力。时间注意力签名(T-Sigs)成功可视化了不同生成模型之间的时间差异,为模型的可解释性提供了有力证据。

🎯 应用场景

SAGA可应用于数字取证、内容监管、版权保护等领域。它可以帮助识别和追踪AI生成视频的来源,从而打击虚假信息传播、侵权行为和恶意攻击。该研究对于维护网络安全、促进AI技术的健康发展具有重要意义,并为未来的监管政策制定提供技术支撑。

📄 摘要(原文)

The proliferation of generative AI has led to hyper-realistic synthetic videos, escalating misuse risks and outstripping binary real/fake detectors. We introduce SAGA (Source Attribution of Generative AI videos), the first comprehensive framework to address the urgent need for AI-generated video source attribution at a large scale. Unlike traditional detection, SAGA identifies the specific generative model used. It uniquely provides multi-granular attribution across five levels: authenticity, generation task (e.g., T2V/I2V), model version, development team, and the precise generator, offering far richer forensic insights. Our novel video transformer architecture, leveraging features from a robust vision foundation model, effectively captures spatio-temporal artifacts. Critically, we introduce a data-efficient pretrain-and-attribute strategy, enabling SAGA to achieve state-of-the-art attribution using only 0.5\% of source-labeled data per class, matching fully supervised performance. Furthermore, we propose Temporal Attention Signatures (T-Sigs), a novel interpretability method that visualizes learned temporal differences, offering the first explanation for why different video generators are distinguishable. Extensive experiments on public datasets, including cross-domain scenarios, demonstrate that SAGA sets a new benchmark for synthetic video provenance, providing crucial, interpretable insights for forensic and regulatory applications.