Perceive What Matters: Relevance-Driven Scheduling for Multimodal Streaming Perception

作者: Dingcheng Huang, Xiaotong Zhang, Kamal Youcef-Toumi

分类: cs.CV

发布日期: 2026-03-13

备注: Accepted to ICRA 2026

💡 一句话要点

提出基于相关性的多模态流式感知调度框架,提升人机协作效率。

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 人机协作 多模态感知 流式感知 感知调度 相关性驱动

📋 核心要点

- 现有并行执行多感知模块的方法在流式场景中延迟高,影响人机协作效率。

- 提出基于相关性的感知调度框架,利用先前帧信息,根据场景上下文动态调度感知模块。

- 实验表明,该框架降低了计算延迟,提高了MMPose激活召回率和关键帧精度。

📝 摘要(中文)

在现代人机协作(HRC)应用中,多个感知模块协同提取视觉、听觉和上下文线索,以实现全面的场景理解,从而使机器人能够智能地为人类提供适当的帮助。虽然逐帧执行多个感知模块可以提高离线环境中的感知质量,但它不可避免地会累积延迟,从而导致流式感知场景中系统性能的显著下降。场景理解中的相关性(Relevance)概念为HRC中高效方法的发展奠定了坚实的基础。然而,现代感知管道仍然面临着信息冗余和计算资源分配不佳的挑战。受相关性概念和HRC事件中信息稀疏性的启发,我们提出了一种新颖的轻量级感知调度框架,该框架有效地利用先前帧的输出来实时估计和调度必要的感知模块,其依据是场景上下文。实验结果表明,与传统的并行感知管道相比,所提出的感知调度框架有效地降低了高达27.52%的计算延迟,同时MMPose激活召回率提高了72.73%。此外,该框架还表现出较高的关键帧精度,达到了高达98%的速率。结果验证了该框架在不显著降低准确性的前提下,增强实时感知效率的能力。该框架显示出作为HRC中多模态流式感知系统的可扩展和系统化解决方案的潜力。

🔬 方法详解

问题定义:论文旨在解决人机协作(HRC)场景中,多模态流式感知系统因并行执行多个感知模块而导致的计算延迟问题。现有方法在离线环境下表现良好,但在实时流式感知中,信息冗余和计算资源分配不佳导致系统性能显著下降。

核心思路:论文的核心思路是借鉴“相关性”概念,即并非所有感知模块在每一帧都同等重要。通过分析场景上下文,预测哪些感知模块是必要的,并动态调度这些模块,从而减少不必要的计算,降低延迟。这种方法利用了HRC事件中信息稀疏性的特点。

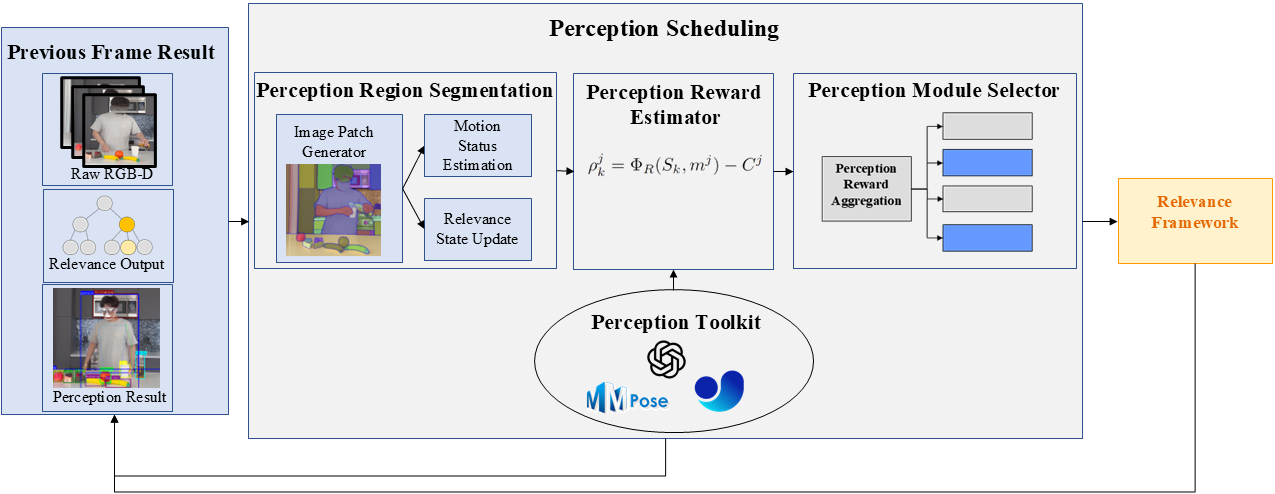

技术框架:该框架主要包含以下几个模块:1) 上下文分析模块:分析当前场景的上下文信息,例如,人的姿态、动作、交互对象等。2) 感知模块重要性评估模块:基于上下文信息,评估各个感知模块(例如,视觉、听觉、触觉)对于当前场景理解的重要性。3) 调度模块:根据重要性评估结果,动态地选择和执行必要的感知模块。4) 融合模块:将各个感知模块的输出进行融合,得到最终的场景理解结果。整个流程是循环进行的,每一帧的输出都会影响下一帧的调度决策。

关键创新:该论文的关键创新在于提出了一个基于相关性的动态感知调度框架。与传统的并行执行所有感知模块的方法不同,该框架能够根据场景上下文自适应地选择和执行必要的感知模块,从而显著降低计算延迟。这种方法充分利用了HRC事件中信息稀疏性的特点,提高了计算效率。

关键设计:论文中可能涉及的关键设计包括:1) 上下文分析模块的具体实现方式,例如,使用深度学习模型进行场景理解。2) 感知模块重要性评估模块的设计,例如,使用规则引擎或机器学习模型来预测各个感知模块的重要性。3) 调度策略的设计,例如,使用阈值来决定是否执行某个感知模块。4) 融合策略的设计,例如,使用加权平均或深度学习模型来融合各个感知模块的输出。具体的参数设置、损失函数、网络结构等技术细节未知。

🖼️ 关键图片

📊 实验亮点

实验结果表明,所提出的感知调度框架与传统的并行感知管道相比,计算延迟降低了高达27.52%,MMPose激活召回率提高了72.73%,关键帧精度达到了高达98%。这些数据表明,该框架能够在不显著降低准确性的前提下,显著提高实时感知效率。

🎯 应用场景

该研究成果可应用于各种人机协作场景,例如:辅助机器人、康复机器人、智能家居等。通过降低感知延迟,提高机器人对环境的实时理解能力,从而使机器人能够更有效地与人类进行交互和协作。该框架具有可扩展性,可以方便地集成新的感知模块,适应不同的应用需求。未来,该技术有望推动人机协作向更智能、更高效的方向发展。

📄 摘要(原文)

In modern human-robot collaboration (HRC) applications, multiple perception modules jointly extract visual, auditory, and contextual cues to achieve comprehensive scene understanding, enabling the robot to provide appropriate assistance to human agents intelligently. While executing multiple perception modules on a frame-by-frame basis enhances perception quality in offline settings, it inevitably accumulates latency, leading to a substantial decline in system performance in streaming perception scenarios. Recent work in scene understanding, termed Relevance, has established a solid foundation for developing efficient methodologies in HRC. However, modern perception pipelines still face challenges related to information redundancy and suboptimal allocation of computational resources. Drawing inspiration from the Relevance concept and the information sparsity in HRC events, we propose a novel lightweight perception scheduling framework that efficiently leverages output from previous frames to estimate and schedule necessary perception modules in real-time based on scene context. The experimental results demonstrate that the proposed perception scheduling framework effectively reduces computational latency by up to 27.52% compared to conventional parallel perception pipelines, while also achieving a 72.73% improvement in MMPose activation recall. Additionally, the framework demonstrates high keyframe accuracy, achieving rates of up to 98%. The results validate the framework's capability to enhance real-time perception efficiency without significantly compromising accuracy. The framework shows potential as a scalable and systematic solution for multimodal streaming perception systems in HRC.