Spatio-Temporal Token Pruning for Efficient High-Resolution GUI Agents

作者: Zhou Xu, Bowen Zhou, Qi Wang, Shuwen Feng, Jingyu Xiao

分类: cs.CV, cs.AI

发布日期: 2026-02-28

💡 一句话要点

GUIPruner:针对高分辨率GUI代理的时空Token剪枝,提升效率并保持性能。

🎯 匹配领域: 支柱八:物理动画 (Physics-based Animation)

关键词: GUI代理 时空剪枝 高分辨率 效率优化 免训练 视觉导航 结构感知 时间自适应

📋 核心要点

- 高分辨率GUI代理面临时空冗余带来的效率瓶颈,现有压缩方法存在时间注意力和空间拓扑结构的错位问题。

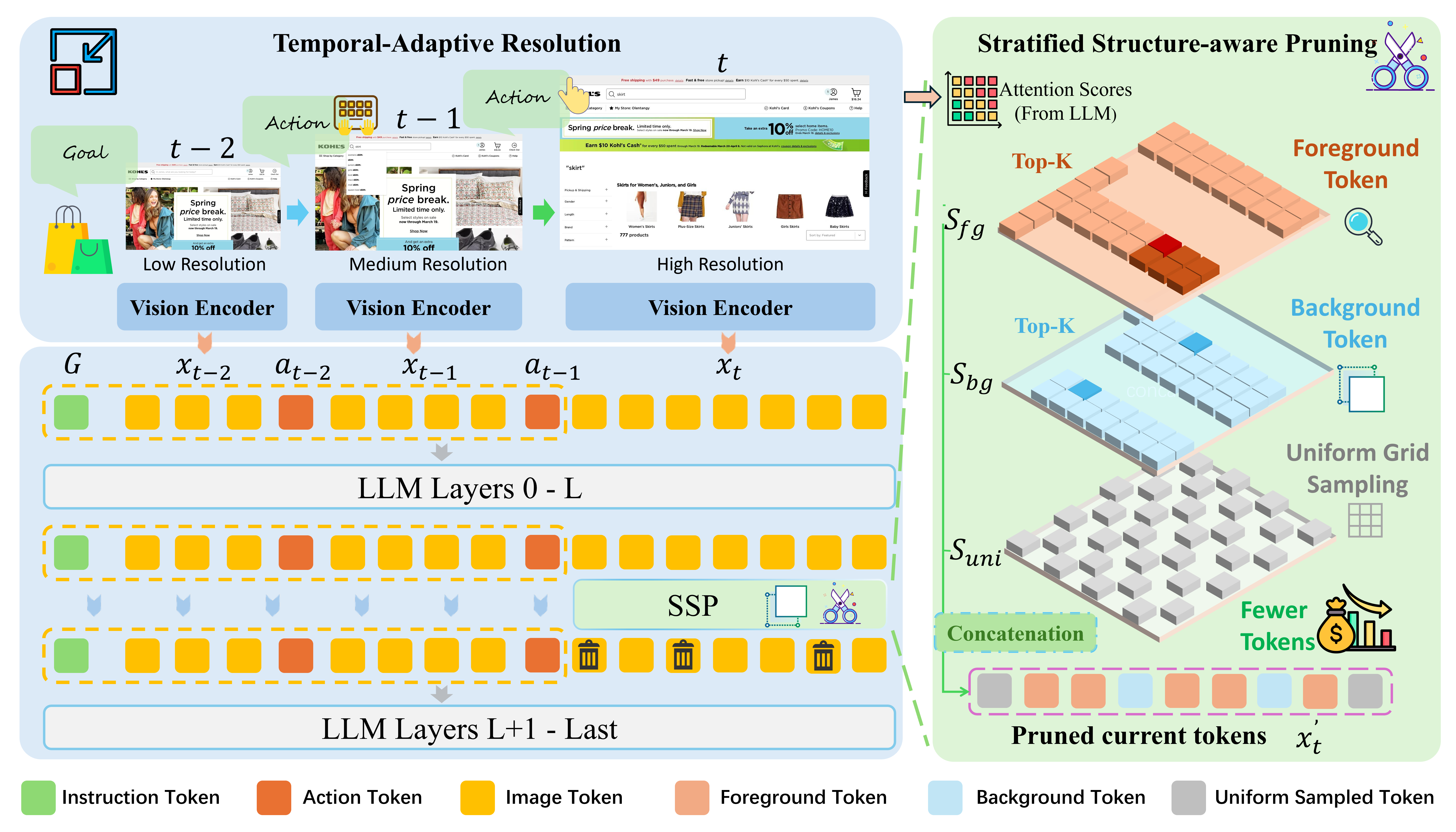

- GUIPruner通过时间自适应分辨率(TAR)消除历史冗余,并利用分层结构感知剪枝(SSP)保护全局布局。

- 实验表明,GUIPruner在Qwen2-VL-2B上实现了显著的FLOPs减少和速度提升,同时保持了较高的性能。

📝 摘要(中文)

纯视觉GUI代理提供了通用的交互能力,但由于高分辨率截图和历史轨迹中存在大量的时空冗余,导致效率严重受限。现有压缩范式存在两个关键错位:时间上的不匹配,即统一的历史编码与代理的“衰退记忆”注意模式不符;空间拓扑冲突,即非结构化剪枝损害了精确坐标定位所需的网格完整性,导致空间幻觉。为了解决这些挑战,我们引入了GUIPruner,这是一个为高分辨率GUI导航量身定制的免训练框架。它协同了时间自适应分辨率(TAR),通过基于衰减的调整大小来消除历史冗余,以及分层结构感知剪枝(SSP),优先考虑交互式前景和语义锚点,同时保护全局布局。在各种基准上的广泛评估表明,GUIPruner始终如一地实现了最先进的性能,有效地防止了大规模模型在高压缩下的崩溃。值得注意的是,在Qwen2-VL-2B上,我们的方法实现了3.4倍的FLOPs减少和3.3倍的视觉编码延迟加速,同时保留了超过94%的原始性能,从而以最小的资源消耗实现实时、高精度的导航。

🔬 方法详解

问题定义:现有纯视觉GUI代理在高分辨率场景下,由于截图和历史轨迹包含大量冗余信息,导致计算效率低下。现有的压缩方法,如均匀历史编码,与代理的“衰退记忆”注意力模式不符,并且非结构化剪枝破坏了空间拓扑结构,影响坐标定位的准确性,容易产生空间幻觉。

核心思路:GUIPruner的核心思路是针对GUI代理的时空冗余进行高效剪枝,同时避免破坏重要的时空信息。通过时间自适应分辨率(TAR)来减少历史信息的冗余,并使用分层结构感知剪枝(SSP)来保留重要的空间信息,从而在保证性能的同时提高效率。

技术框架:GUIPruner是一个免训练框架,主要包含两个模块:时间自适应分辨率(TAR)和分层结构感知剪枝(SSP)。TAR模块通过基于衰减的策略调整历史帧的分辨率,从而减少历史信息的冗余。SSP模块则根据GUI元素的交互重要性和语义信息,分层地进行剪枝,优先保留交互式前景和语义锚点,同时维护全局布局。整个框架无需额外的训练,可以直接应用于现有的GUI代理模型。

关键创新:GUIPruner的关键创新在于其针对GUI代理的特性,提出了时间自适应分辨率和分层结构感知剪枝两种策略。TAR模块模拟了人类的“衰退记忆”特性,更符合GUI代理的实际需求。SSP模块则避免了传统剪枝方法破坏空间拓扑结构的问题,从而保证了坐标定位的准确性。

关键设计:TAR模块的关键设计在于衰减函数的选择,论文中使用了基于时间的衰减函数,使得越久远的历史帧分辨率越低。SSP模块的关键设计在于如何定义GUI元素的交互重要性和语义信息,以及如何根据这些信息进行分层剪枝。具体的参数设置和网络结构细节在论文中进行了详细描述,例如衰减函数的具体形式,以及分层剪枝的阈值等。

🖼️ 关键图片

📊 实验亮点

GUIPruner在多个GUI导航基准测试中取得了最先进的性能。特别是在Qwen2-VL-2B模型上,GUIPruner实现了3.4倍的FLOPs减少和3.3倍的视觉编码延迟加速,同时保留了超过94%的原始性能。这表明GUIPruner能够在显著提高效率的同时,保持较高的导航精度。

🎯 应用场景

GUIPruner可应用于各种需要高效GUI交互的场景,例如移动设备上的自动化测试、资源受限环境下的智能助手、以及需要实时响应的高精度机器人控制。通过降低计算资源消耗,GUIPruner能够使这些应用在更广泛的平台上部署,并提升用户体验。

📄 摘要(原文)

Pure-vision GUI agents provide universal interaction capabilities but suffer from severe efficiency bottlenecks due to the massive spatiotemporal redundancy inherent in high-resolution screenshots and historical trajectories. We identify two critical misalignments in existing compression paradigms: the temporal mismatch, where uniform history encoding diverges from the agent's "fading memory" attention pattern, and the spatial topology conflict, where unstructured pruning compromises the grid integrity required for precise coordinate grounding, inducing spatial hallucinations. To address these challenges, we introduce GUIPruner, a training-free framework tailored for high-resolution GUI navigation. It synergizes Temporal-Adaptive Resolution (TAR), which eliminates historical redundancy via decay-based resizing, and Stratified Structure-aware Pruning (SSP), which prioritizes interactive foregrounds and semantic anchors while safeguarding global layout. Extensive evaluations across diverse benchmarks demonstrate that GUIPruner consistently achieves state-of-the-art performance, effectively preventing the collapse observed in large-scale models under high compression. Notably, on Qwen2-VL-2B, our method delivers a 3.4x reduction in FLOPs and a 3.3x speedup in vision encoding latency while retaining over 94% of the original performance, enabling real-time, high-precision navigation with minimal resource consumption.