FUSAR-GPT : A Spatiotemporal Feature-Embedded and Two-Stage Decoupled Visual Language Model for SAR Imagery

作者: Xiaokun Zhang, Yi Yang, Ziqi Ye, Baiyun, Xiaorong Guo, Qingchen Fang, Ruyi Zhang, Xinpeng Zhou, Haipeng Wang

分类: cs.CV, cs.AI

发布日期: 2026-02-28

💡 一句话要点

FUSAR-GPT:面向SAR影像,时空特征嵌入与解耦的两阶段视觉语言模型

🎯 匹配领域: 支柱八:物理动画 (Physics-based Animation)

关键词: SAR图像解译 视觉语言模型 时空特征嵌入 两阶段训练 遥感应用

📋 核心要点

- 现有VLM直接应用于SAR图像解译时,因SAR成像复杂性和数据稀缺性而性能受限。

- FUSAR-GPT通过嵌入地理空间知识和时序特征,增强SAR图像表征,弥补信息缺失。

- 提出的两阶段训练策略解耦知识注入和任务执行,显著提升了模型性能,超越现有方法。

📝 摘要(中文)

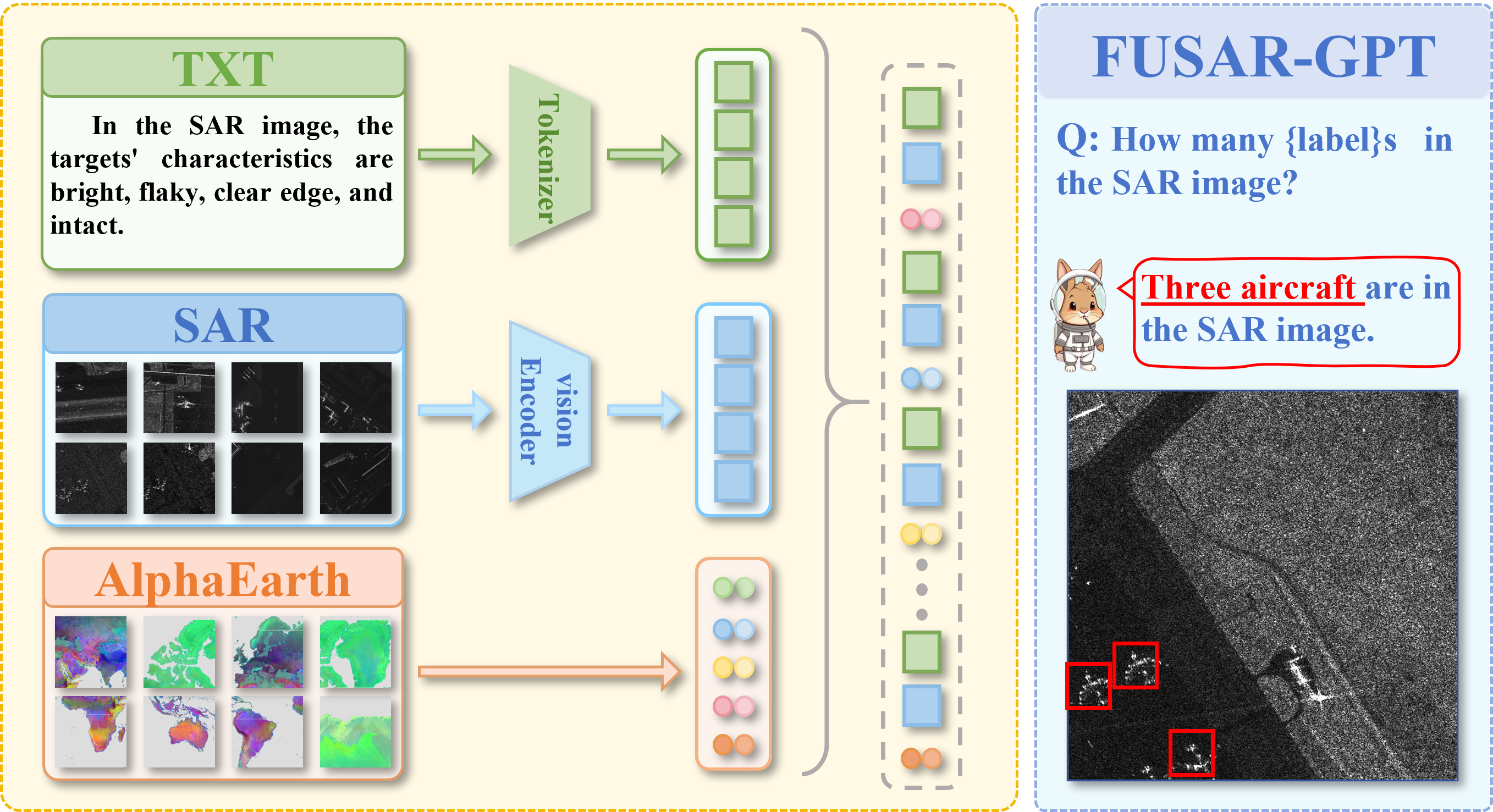

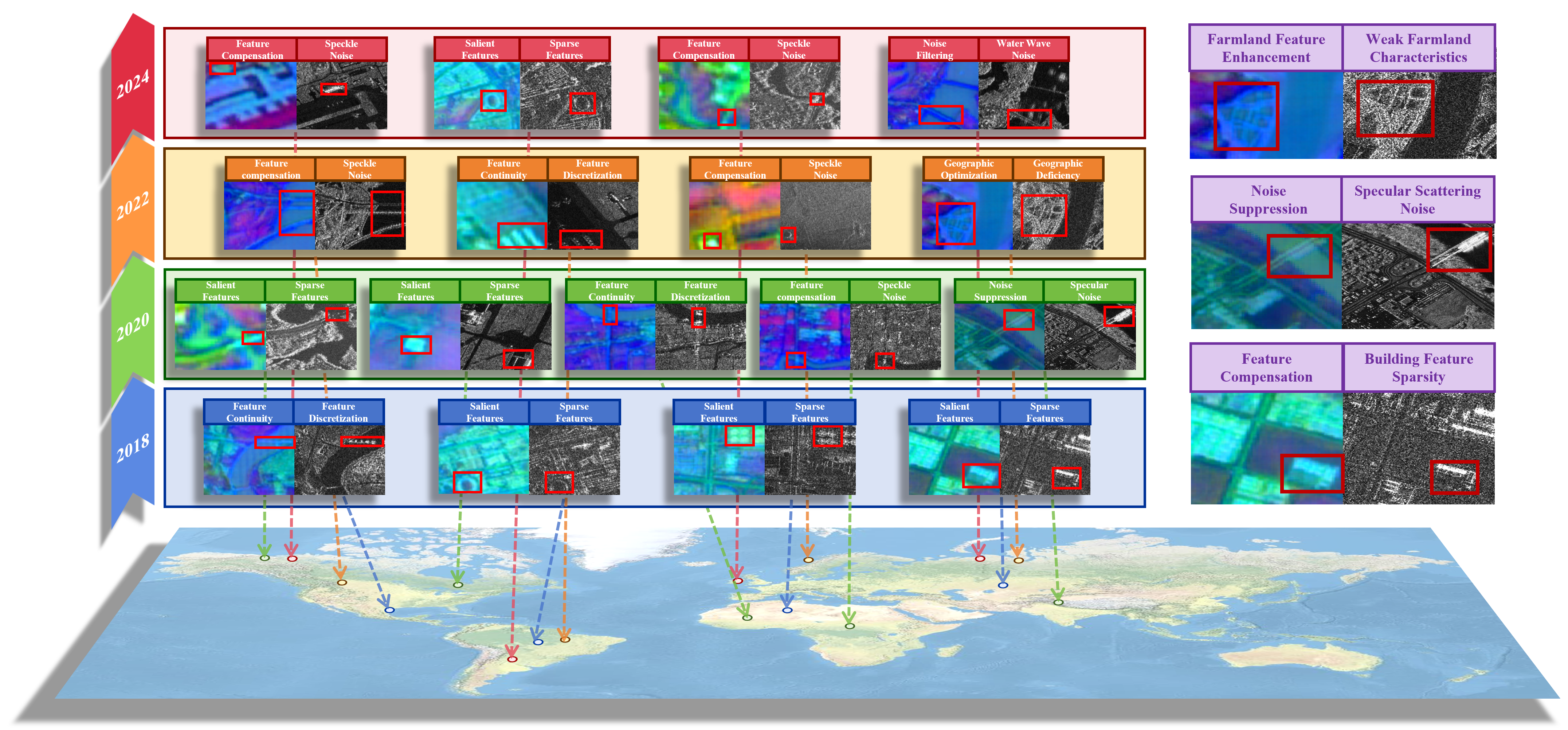

针对合成孔径雷达(SAR)影像智能解译在遥感应用中的重要性,以及现有视觉语言模型(VLM)在SAR领域因成像机制复杂、对散射特征敏感和高质量文本语料稀缺而表现受限的问题,本文构建了首个SAR图像-文本-AlphaEarth特征三元组数据集,并开发了专门用于SAR的VLM——FUSAR-GPT。FUSAR-GPT创新性地引入了地理空间基线模型作为“世界知识”先验,并通过“时空锚点”将多源遥感时间特征嵌入到模型的视觉骨干中,从而动态补偿SAR图像中目标的稀疏表示。此外,设计了两阶段SFT策略来解耦大型模型的知识注入和任务执行。时空特征嵌入和两阶段解耦范式使FUSAR-GPT在多个典型的遥感视觉语言基准测试中实现了最先进的性能,显著优于主流基线模型超过12%。

🔬 方法详解

问题定义:现有视觉语言模型(VLM)在RGB图像上表现出色,但直接应用于SAR图像时性能显著下降。主要痛点在于SAR图像成像机制复杂,对散射特征敏感,且缺乏高质量的SAR图像-文本数据集。此外,SAR图像信息稀疏,目标表征不足,难以有效利用现有VLM。

核心思路:FUSAR-GPT的核心思路是通过引入地理空间知识和时序特征来增强SAR图像的表征能力,并利用两阶段训练策略来解耦知识注入和任务执行。地理空间知识作为先验信息,帮助模型理解SAR图像中的目标;时序特征则弥补了SAR图像在时间维度上的信息缺失。两阶段训练则分别侧重于知识学习和任务适应。

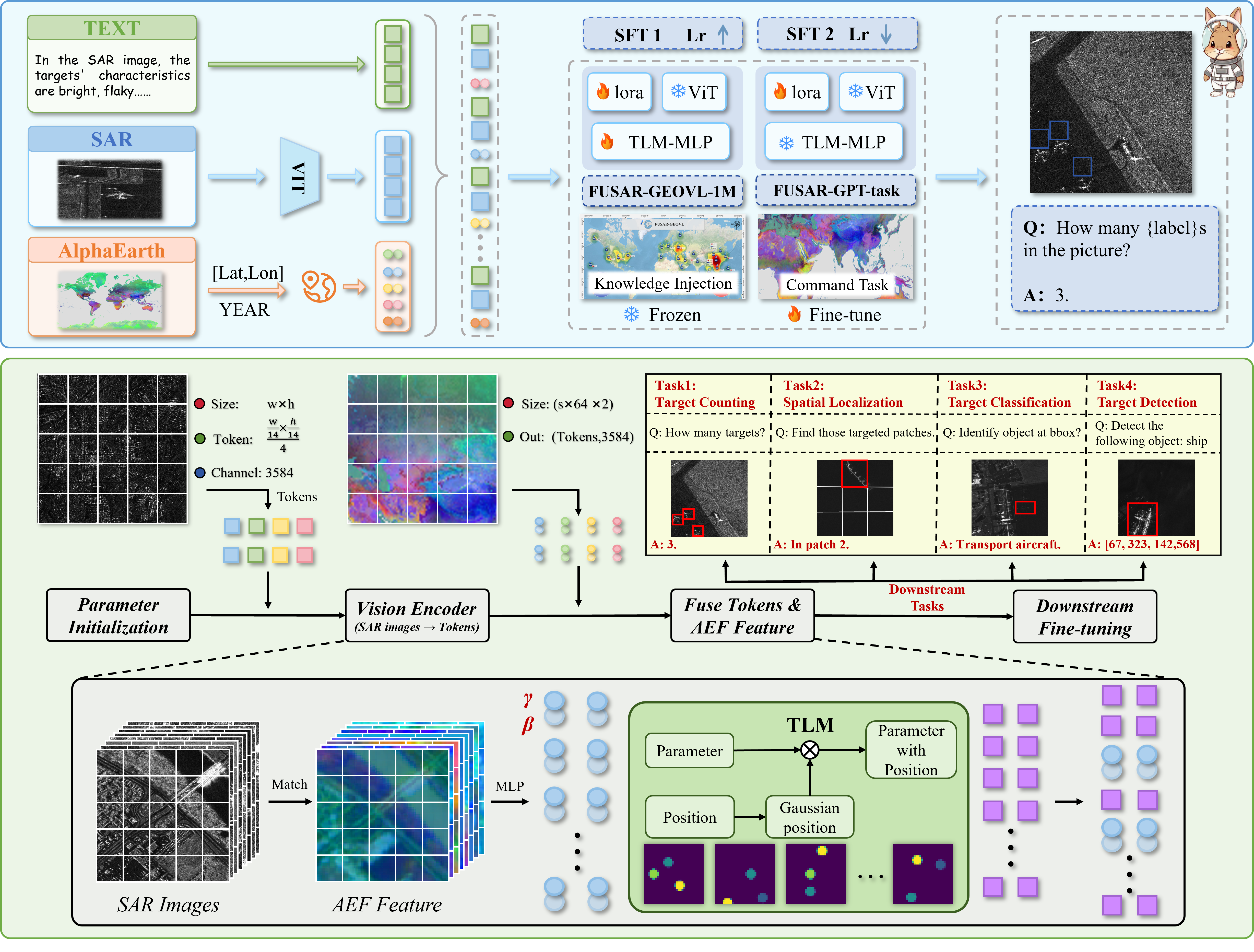

技术框架:FUSAR-GPT的整体框架包含以下几个主要模块:1) 地理空间基线模型:提供“世界知识”先验。2) 时空特征嵌入模块:将多源遥感时间特征通过“时空锚点”嵌入到视觉骨干网络中。3) 视觉语言模型:基于Transformer架构,用于SAR图像和文本的联合表示学习。4) 两阶段SFT策略:第一阶段进行知识注入,第二阶段进行任务执行。

关键创新:FUSAR-GPT的关键创新在于:1) 构建了首个SAR图像-文本-AlphaEarth特征三元组数据集。2) 提出了时空特征嵌入方法,有效融合了地理空间知识和时序特征。3) 设计了两阶段SFT策略,解耦了知识注入和任务执行。与现有方法相比,FUSAR-GPT更有效地利用了多源遥感数据,并针对SAR图像的特点进行了优化。

关键设计:时空特征嵌入模块使用“时空锚点”将时间特征嵌入到视觉骨干网络中,具体实现方式未知。两阶段SFT策略中,第一阶段可能使用对比学习或掩码语言模型等方法进行预训练,第二阶段则使用特定任务的数据进行微调。损失函数可能包括图像-文本对比损失、语言模型损失等。具体参数设置和网络结构细节未知。

🖼️ 关键图片

📊 实验亮点

FUSAR-GPT在多个遥感视觉语言基准测试中取得了state-of-the-art的性能,显著优于主流基线模型超过12%。这一结果表明,该模型提出的时空特征嵌入和两阶段解耦范式能够有效提升SAR图像的解译能力,具有重要的研究价值和应用潜力。具体提升的指标和对比的基线模型未知。

🎯 应用场景

FUSAR-GPT可应用于全天候、全天时的遥感监测任务,例如灾害评估、城市规划、农业监测、环境监测等。该模型能够有效利用SAR图像的优势,克服光学遥感在云雾天气下的局限性,为相关领域提供更可靠、更及时的信息支持,具有重要的实际应用价值和广阔的发展前景。

📄 摘要(原文)

Research on the intelligent interpretation of all-weather, all-time Synthetic Aperture Radar (SAR) is crucial for advancing remote sensing applications. In recent years, although Visual Language Models (VLMs) have demonstrated strong open-world understanding capabilities on RGB images, their performance is severely limited when directly applied to the SAR field due to the complexity of the imaging mechanism, sensitivity to scattering features, and the scarcity of high-quality text corpora. To systematically address this issue, we constructed the inaugural SAR Image-Text-AlphaEarth feature triplet dataset and developed FUSAR-GPT, a VLM specifically for SAR. FUSAR-GPT innovatively introduces a geospatial baseline model as a 'world knowledge' prior and embeds multi-source remote-sensing temporal features into the model's visual backbone via 'spatiotemporal anchors', enabling dynamic compensation for the sparse representation of targets in SAR images. Furthermore, we designed a two-stage SFT strategy to decouple the knowledge injection and task execution of large models. The spatiotemporal feature embedding and the two-stage decoupling paradigm enable FUSAR-GPT to achieve state-of-the-art performance across several typical remote sensing visual-language benchmark tests, significantly outperforming mainstream baseline models by over 12%.