G4Splat: Geometry-Guided Gaussian Splatting with Generative Prior

作者: Junfeng Ni, Yixin Chen, Zhifei Yang, Yu Liu, Ruijie Lu, Song-Chun Zhu, Siyuan Huang

分类: cs.CV

发布日期: 2026-02-28

💡 一句话要点

G4Splat:利用生成先验和几何引导的高斯溅射,提升三维场景重建质量。

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 三维场景重建 生成先验 高斯溅射 几何引导 深度估计

📋 核心要点

- 现有方法利用生成先验进行3D重建时,缺乏可靠的几何监督,导致重建质量受限,尤其在未观测区域。

- G4Splat利用平面结构推导精确深度图,提供几何引导,并将其融入生成流程,提升多视角一致性。

- 实验表明,G4Splat在多个数据集上优于现有方法,尤其在未观测区域,且支持单视角输入和无位姿视频。

📝 摘要(中文)

本文提出了一种名为G4Splat的方法,旨在利用预训练扩散模型的生成先验来提升3D场景重建效果。现有方法在利用生成先验时面临两个关键限制:缺乏可靠的几何监督,导致重建质量不高,尤其是在未观测区域;缺乏有效机制来缓解多视角不一致性,导致形状和外观模糊,场景几何退化。本文认为精确的几何信息是有效利用生成模型增强3D场景重建的基本前提。首先,利用平面结构的普遍性来导出精确的度量尺度深度图,为观测和未观测区域提供可靠的监督。其次,将几何引导融入生成流程,改进可见性掩码估计,引导新视角选择,并增强视频扩散模型修复时的多视角一致性,从而实现精确和一致的场景补全。在Replica、ScanNet++、DeepBlending和Mip-NeRF 360上的大量实验表明,该方法在几何和外观重建方面始终优于现有基线,尤其是在未观测区域。此外,该方法自然支持单视角输入和无位姿视频,在室内和室外场景中具有很强的泛化能力和实际应用价值。

🔬 方法详解

问题定义:现有基于生成先验的3D场景重建方法,在缺乏精确几何监督的情况下,难以在已观测和未观测区域生成高质量的重建结果。同时,多视角不一致性导致形状和外观模糊,降低了场景几何的准确性。

核心思路:论文的核心思路是利用精确的几何信息作为先验,指导生成模型的训练和推理过程,从而提升3D场景重建的质量和一致性。具体来说,通过提取场景中的平面结构来获得精确的深度信息,并将其融入到生成流程中,以改善可见性估计、视角选择和多视角一致性。

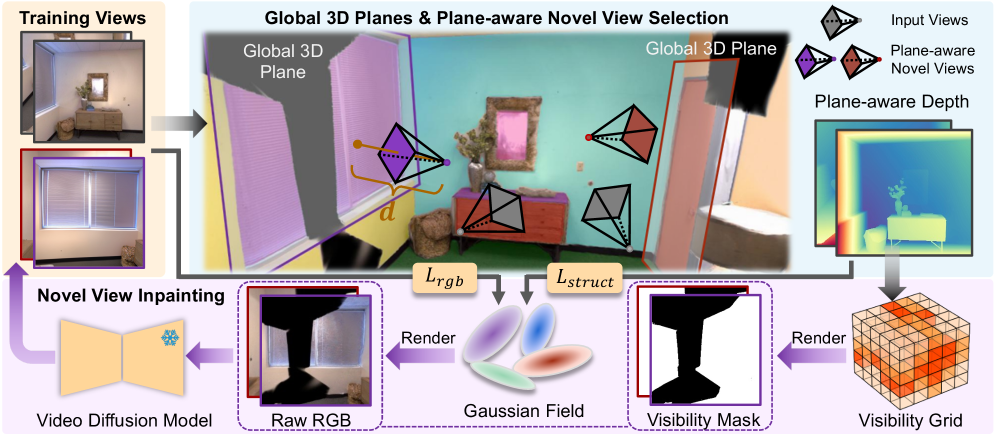

技术框架:G4Splat的整体框架包含以下几个主要阶段:1) 利用平面结构提取精确的深度图;2) 利用深度图进行几何引导,包括改进可见性掩码估计和引导新视角选择;3) 使用视频扩散模型进行场景补全,并利用几何引导增强多视角一致性。整个流程旨在利用几何信息来约束生成过程,从而获得更准确和一致的3D场景重建结果。

关键创新:该方法最重要的创新点在于将精确的几何信息(通过平面结构提取的深度图)作为先验,融入到基于生成模型的3D场景重建流程中。与现有方法相比,G4Splat能够更有效地利用生成模型的先验知识,同时避免了多视角不一致性带来的问题。

关键设计:论文的关键设计包括:1) 利用RANSAC等算法从图像中提取平面结构,并估计其深度信息;2) 设计损失函数,鼓励生成的图像与观测到的图像保持一致,同时与估计的深度信息保持一致;3) 使用视频扩散模型进行场景补全,并利用几何信息来约束生成过程,保证多视角一致性。具体的参数设置和网络结构细节在论文中有详细描述。

🖼️ 关键图片

📊 实验亮点

实验结果表明,G4Splat在Replica、ScanNet++、DeepBlending和Mip-NeRF 360等数据集上,在几何和外观重建方面均优于现有基线方法。尤其是在未观测区域,G4Splat的重建质量提升显著,能够生成更完整、更逼真的场景模型。此外,该方法还支持单视角输入和无位姿视频,具有更强的泛化能力。

🎯 应用场景

G4Splat在三维场景重建领域具有广泛的应用前景,可用于虚拟现实、增强现实、机器人导航、自动驾驶等领域。该方法能够利用单视角图像或无位姿视频进行高质量的场景重建,降低了对输入数据的要求,提高了重建效率,具有重要的实际应用价值。

📄 摘要(原文)

Despite recent advances in leveraging generative prior from pre-trained diffusion models for 3D scene reconstruction, existing methods still face two critical limitations. First, due to the lack of reliable geometric supervision, they struggle to produce high-quality reconstructions even in observed regions, let alone in unobserved areas. Second, they lack effective mechanisms to mitigate multi-view inconsistencies in the generated images, leading to severe shape-appearance ambiguities and degraded scene geometry. In this paper, we identify accurate geometry as the fundamental prerequisite for effectively exploiting generative models to enhance 3D scene reconstruction. We first propose to leverage the prevalence of planar structures to derive accurate metric-scale depth maps, providing reliable supervision in both observed and unobserved regions. Furthermore, we incorporate this geometry guidance throughout the generative pipeline to improve visibility mask estimation, guide novel view selection, and enhance multi-view consistency when inpainting with video diffusion models, resulting in accurate and consistent scene completion. Extensive experiments on Replica, ScanNet++, DeepBlending and Mip-NeRF 360 show that our method consistently outperforms existing baselines in both geometry and appearance reconstruction, particularly for unobserved regions. Moreover, our method naturally supports single-view inputs and unposed videos, with strong generalizability in both indoor and outdoor scenarios with practical real-world applicability. The project page is available atthis https URL.