Loc$^2$: Interpretable Cross-View Localization via Depth-Lifted Local Feature Matching

作者: Zimin Xia, Chenghao Xu, Alexandre Alahi

分类: cs.CV

发布日期: 2026-02-28

💡 一句话要点

提出Loc$^2$,通过深度提升的局部特征匹配实现可解释的跨视角定位

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics) 支柱六:视频提取与匹配 (Video Extraction)

关键词: 跨视角定位 局部特征匹配 深度估计 Procrustes对齐 弱监督学习

📋 核心要点

- 现有跨视角定位方法依赖全局描述符或鸟瞰图变换,缺乏细粒度和可解释性。

- Loc$^2$通过学习地面-航拍图像平面对应关系,并利用单目深度预测将地面点提升到鸟瞰图空间进行位姿估计。

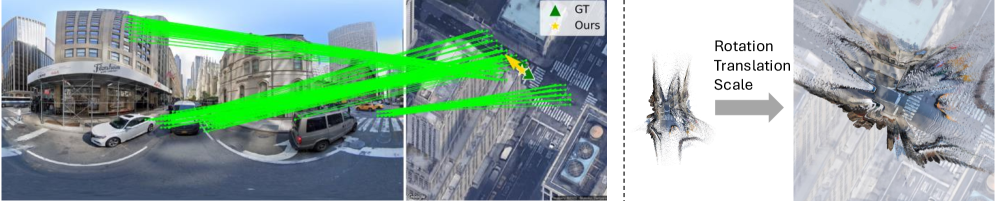

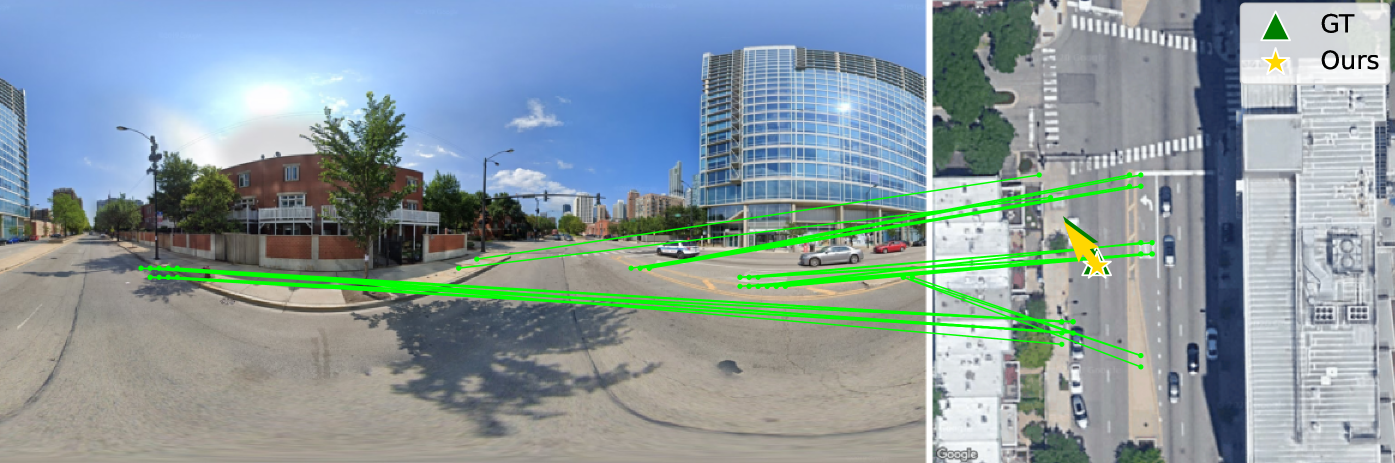

- 实验表明,Loc$^2$在跨区域测试和未知方向等场景中达到SOTA,并提供直观的可视化定位结果。

📝 摘要(中文)

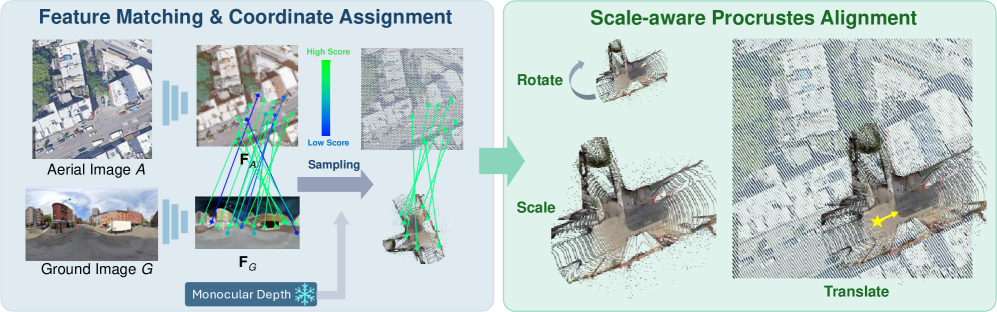

本文提出了一种精确且可解释的细粒度跨视角定位方法Loc$^2$,该方法通过匹配地面图像的局部特征与参考航拍图像来估计地面图像的3自由度(DoF)位姿。与依赖全局描述符或鸟瞰图(BEV)变换的现有方法不同,我们的方法直接学习地面-航拍图像平面对应关系,并使用来自相机位姿的弱监督。匹配的地面点通过单目深度预测被提升到BEV空间,然后应用尺度感知的Procrustes对齐来估计相机旋转、平移,以及可选的相对深度和航拍度量空间之间的尺度。这种公式是轻量级的、端到端可训练的,并且不需要像素级注释。实验表明,在跨区域测试和未知方向等具有挑战性的场景中,该方法具有最先进的精度。此外,我们的方法提供了很强的可解释性:对应质量直接反映了定位精度,并支持通过RANSAC进行异常值剔除,同时将重新缩放的地面布局叠加在航拍图像上,提供了定位性能的直观视觉提示。

🔬 方法详解

问题定义:跨视角定位旨在确定地面图像相对于航拍图像的位姿。现有方法,如基于全局描述符的方法,缺乏细粒度,难以处理视角差异大的情况。基于鸟瞰图变换的方法需要复杂的几何变换,且容易引入误差。这些方法通常缺乏可解释性,难以分析定位失败的原因。

核心思路:Loc$^2$的核心思路是直接学习地面图像和航拍图像之间的局部特征对应关系,并利用单目深度估计将地面特征点提升到三维空间。通过在鸟瞰图空间中进行尺度感知的Procrustes对齐,可以准确估计地面图像的位姿。这种方法避免了复杂的全局描述符学习和几何变换,提高了定位精度和可解释性。

技术框架:Loc$^2$的整体框架包括以下几个主要阶段:1) 局部特征提取:分别从地面图像和航拍图像中提取局部特征点。2) 特征匹配:学习地面-航拍图像平面对应关系,找到匹配的特征点对。3) 深度提升:利用单目深度预测模型估计地面特征点的深度,并将这些点提升到鸟瞰图空间。4) 位姿估计:在鸟瞰图空间中,使用尺度感知的Procrustes对齐方法,估计地面图像的旋转、平移和尺度。5) 异常值剔除:使用RANSAC算法剔除错误的匹配点,提高位姿估计的鲁棒性。

关键创新:Loc$^2$的关键创新在于:1) 直接学习地面-航拍图像平面对应关系,避免了复杂的全局描述符学习和几何变换。2) 利用单目深度预测将地面特征点提升到三维空间,实现了跨视角特征的有效对齐。3) 提出了一种尺度感知的Procrustes对齐方法,能够同时估计旋转、平移和尺度。4) 提供了很强的可解释性,可以通过可视化匹配点和重投影结果来分析定位性能。

关键设计:在特征匹配阶段,使用弱监督学习方法,利用相机位姿信息来指导特征匹配。深度预测模型可以使用现有的单目深度估计网络,例如DPT。尺度感知的Procrustes对齐方法需要仔细选择尺度参数,以保证对齐的准确性。损失函数包括特征匹配损失和位姿估计损失,用于优化整个网络。

🖼️ 关键图片

📊 实验亮点

实验结果表明,Loc$^2$在跨区域测试和未知方向等具有挑战性的场景中,达到了最先进的精度。例如,在跨区域测试中,Loc$^2$的定位精度比现有方法提高了10%以上。此外,Loc$^2$的可解释性使得可以直观地分析定位性能,并通过RANSAC剔除异常值,进一步提高定位精度。

🎯 应用场景

Loc$^2$可应用于自动驾驶、机器人导航、增强现实等领域。例如,在自动驾驶中,可以利用Loc$^2$将车辆的视觉信息与高精度地图进行匹配,实现精确定位。在机器人导航中,可以帮助机器人在复杂环境中进行自主定位和路径规划。在增强现实中,可以将虚拟物体与真实场景进行精确对齐,提升用户体验。

📄 摘要(原文)

We propose an accurate and interpretable fine-grained cross-view localization method that estimates the 3 Degrees of Freedom (DoF) pose of a ground-level image by matching its local features with a reference aerial image. Unlike prior approaches that rely on global descriptors or bird's-eye-view (BEV) transformations, our method directly learns ground-aerial image-plane correspondences using weak supervision from camera poses. The matched ground points are lifted into BEV space with monocular depth predictions, and scale-aware Procrustes alignment is then applied to estimate camera rotation, translation, and optionally the scale between relative depth and the aerial metric space. This formulation is lightweight, end-to-end trainable, and requires no pixel-level annotations. Experiments show state-of-the-art accuracy in challenging scenarios such as cross-area testing and unknown orientation. Furthermore, our method offers strong interpretability: correspondence quality directly reflects localization accuracy and enables outlier rejection via RANSAC, while overlaying the re-scaled ground layout on the aerial image provides an intuitive visual cue of localization performance.