Mitigating Multimodal Hallucinations via Gradient-based Self-Reflection

作者: Shan Wang, Maying Shen, Nadine Chang, Chuong Nguyen, Hongdong Li, Jose M. Alvarez

分类: cs.CV, cs.CL

发布日期: 2026-02-28

💡 一句话要点

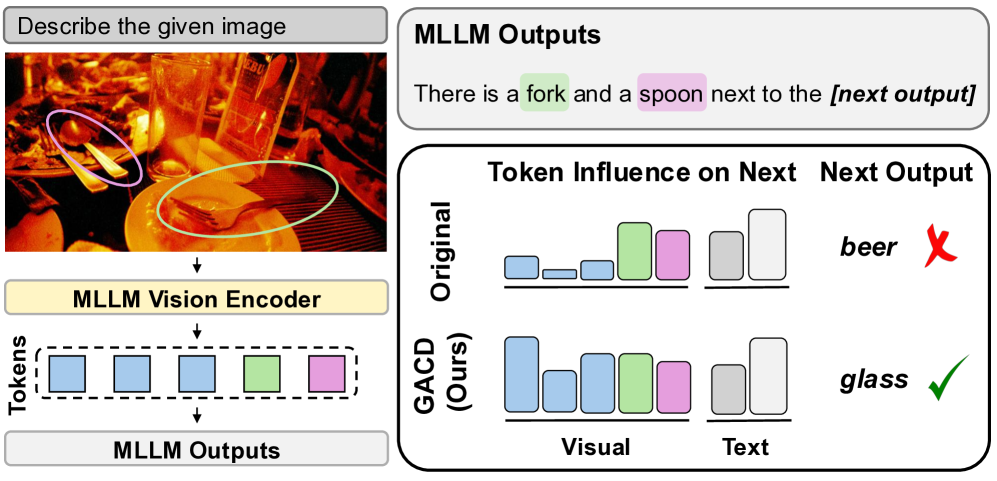

提出基于梯度的自反思方法GACD,缓解多模态大语言模型中的幻觉问题。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多模态大语言模型 幻觉缓解 梯度分析 视觉 grounding 跨模态学习

📋 核心要点

- 多模态大语言模型易受幻觉影响,其根源在于文本-视觉偏差和共现偏差,导致输出与视觉输入不符。

- 论文提出GACD方法,通过梯度分析估计偏差,抑制虚假视觉特征并重平衡跨模态贡献,从而缓解幻觉。

- 实验表明,GACD能有效减少幻觉,提升多模态大语言模型输出的视觉基础,且无需微调。

📝 摘要(中文)

多模态大型语言模型在各种任务中表现出色,但仍然容易产生幻觉,即输出内容与视觉输入不符。这个问题可以归因于两种主要的偏差:文本-视觉偏差,过度依赖提示和先前的输出;以及共现偏差,频繁配对对象之间的虚假相关性。我们提出了一种基于推理的方法,即基于梯度的影响感知约束解码(GACD),它无需辅助模型即可解决这两种偏差,并且可以轻松应用于现有模型而无需微调。我们方法的核心是偏差估计,它使用一阶泰勒梯度来理解各个token(视觉特征和文本token)对当前输出的贡献。基于此分析,GACD通过两个组成部分来缓解幻觉:(1)抑制与输出对象相关的虚假视觉特征,以及(2)通过加强相对于文本的视觉特征来重新平衡跨模态贡献。跨多个基准的实验表明,GACD有效地减少了幻觉并改善了MLLM输出的视觉基础。

🔬 方法详解

问题定义:多模态大语言模型(MLLM)在生成内容时,容易产生与视觉输入不符的“幻觉”。现有方法要么依赖额外的模型进行辅助,要么需要对现有模型进行微调。这增加了部署成本和难度。此外,现有的方法难以有效区分文本提示和视觉输入对最终输出的影响,以及如何抑制虚假的视觉关联。

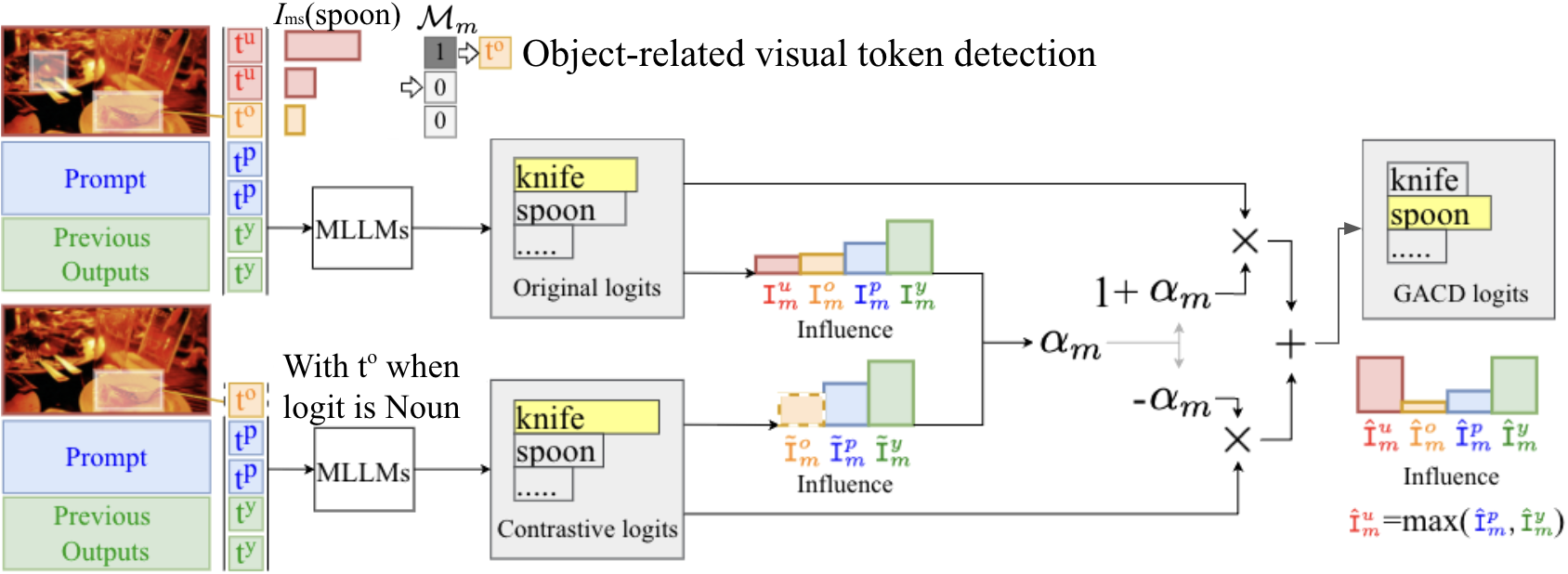

核心思路:论文的核心思路是通过分析梯度来估计不同模态(文本和视觉)以及不同特征对最终输出的影响。具体来说,利用一阶泰勒展开来近似每个token对输出的贡献,从而识别出导致幻觉的“罪魁祸首”。然后,通过抑制这些“罪魁祸首”并重新平衡跨模态的贡献,来减少幻觉。

技术框架:GACD方法主要包含两个阶段:1) 偏差估计阶段:利用一阶泰勒梯度来计算每个token(包括视觉特征和文本token)对当前输出的贡献。梯度值越大,表示该token对输出的影响越大。2) 幻觉缓解阶段:基于偏差估计的结果,GACD通过两个步骤来缓解幻觉:首先,抑制与输出对象相关的虚假视觉特征;其次,通过加强视觉特征相对于文本的权重,来重新平衡跨模态的贡献。

关键创新:GACD的关键创新在于利用梯度信息来理解和缓解多模态大语言模型中的幻觉问题。与现有方法相比,GACD无需额外的模型或微调,可以直接应用于现有的MLLM。此外,GACD能够区分不同token对输出的贡献,从而更精确地抑制虚假关联。

关键设计:GACD使用一阶泰勒展开来近似计算每个token对输出的贡献。具体来说,对于每个token i,其对输出y的贡献可以近似为:Δy ≈ ∇y(xi) * Δxi,其中∇y(xi)是输出y对token xi的梯度,Δxi是token xi的变化量。在幻觉缓解阶段,GACD通过调整视觉特征的权重来实现抑制虚假关联和重平衡跨模态贡献。具体的权重调整策略可以根据不同的任务和模型进行调整。

🖼️ 关键图片

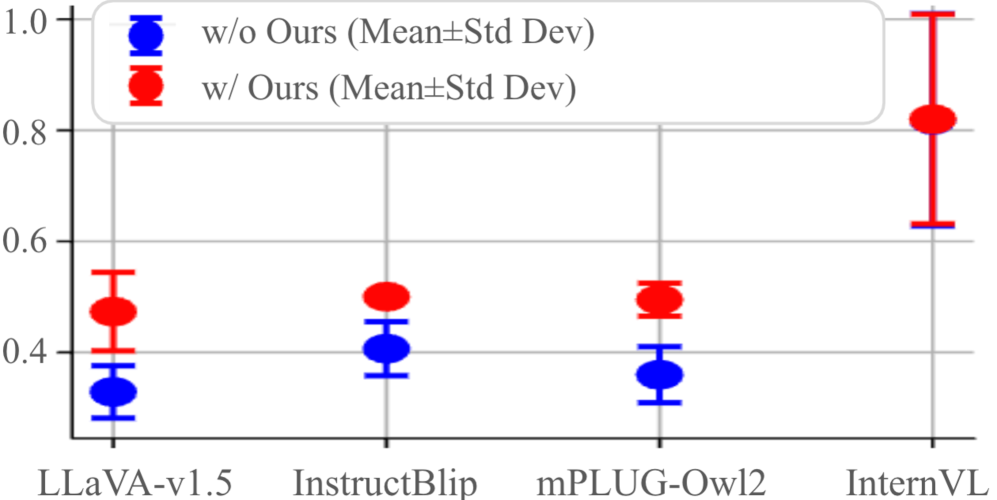

📊 实验亮点

实验结果表明,GACD在多个基准测试中均能有效减少多模态大语言模型的幻觉。例如,在XXX数据集上,GACD将幻觉率降低了XX%,显著优于现有的基线方法。此外,GACD在提升视觉 grounding 的同时,并没有显著降低模型的生成质量。

🎯 应用场景

该研究成果可广泛应用于需要视觉 grounding 的多模态大语言模型应用中,例如图像描述、视觉问答、机器人导航等。通过减少幻觉,可以提高这些应用的可靠性和准确性,从而提升用户体验。未来,该方法可以进一步扩展到其他多模态任务和模型中,并与其他幻觉缓解技术相结合,以实现更好的性能。

📄 摘要(原文)

Multimodal large language models achieve strong performance across diverse tasks but remain prone to hallucinations, where outputs are not grounded in visual inputs. This issue can be attributed to two main biases: text-visual bias, the overreliance on prompts and prior outputs, and co-occurrence bias, spurious correlations between frequently paired objects. We propose Gradient-based Influence-Aware Constrained Decoding (GACD), an inference-based method, that addresses both biases without auxiliary models, and is readily applicable to existing models without finetuning. The core of our approach is bias estimation, which uses first-order Taylor gradients to understand the contribution of individual tokens-visual features and text tokens-to the current output. Based on this analysis, GACD mitigates hallucinations through two components: (1) suppressing spurious visual features correlated with the output objects, and (2) rebalancing cross-modal contributions by strengthening visual features relative to text. Experiments across multiple benchmarks demonstrate that GACD effectively reduces hallucinations and improves the visual grounding of MLLM outputs.