Cytoarchitecture in Words: Weakly Supervised Vision-Language Modeling for Human Brain Microscopy

作者: Matthew Sutton, Katrin Amunts, Timo Dickscheid, Christian Schiffer

分类: cs.CV

发布日期: 2026-02-26

备注: 8 pages, 3 figures, submitted for inclusion at a conference

💡 一句话要点

提出一种弱监督视觉-语言建模方法,用于人脑显微图像的细胞结构分析。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 视觉-语言建模 弱监督学习 细胞结构分析 人脑显微图像 自然语言描述

📋 核心要点

- 现有方法在细胞结构分析中缺乏配对图像-文本数据,难以实现视觉-语言耦合。

- 提出一种标签介导的弱监督方法,利用标签连接图像和文本,生成自然语言描述。

- 实验结果表明,该方法能够生成合理的区域描述,并在开放集设置下表现良好。

📝 摘要(中文)

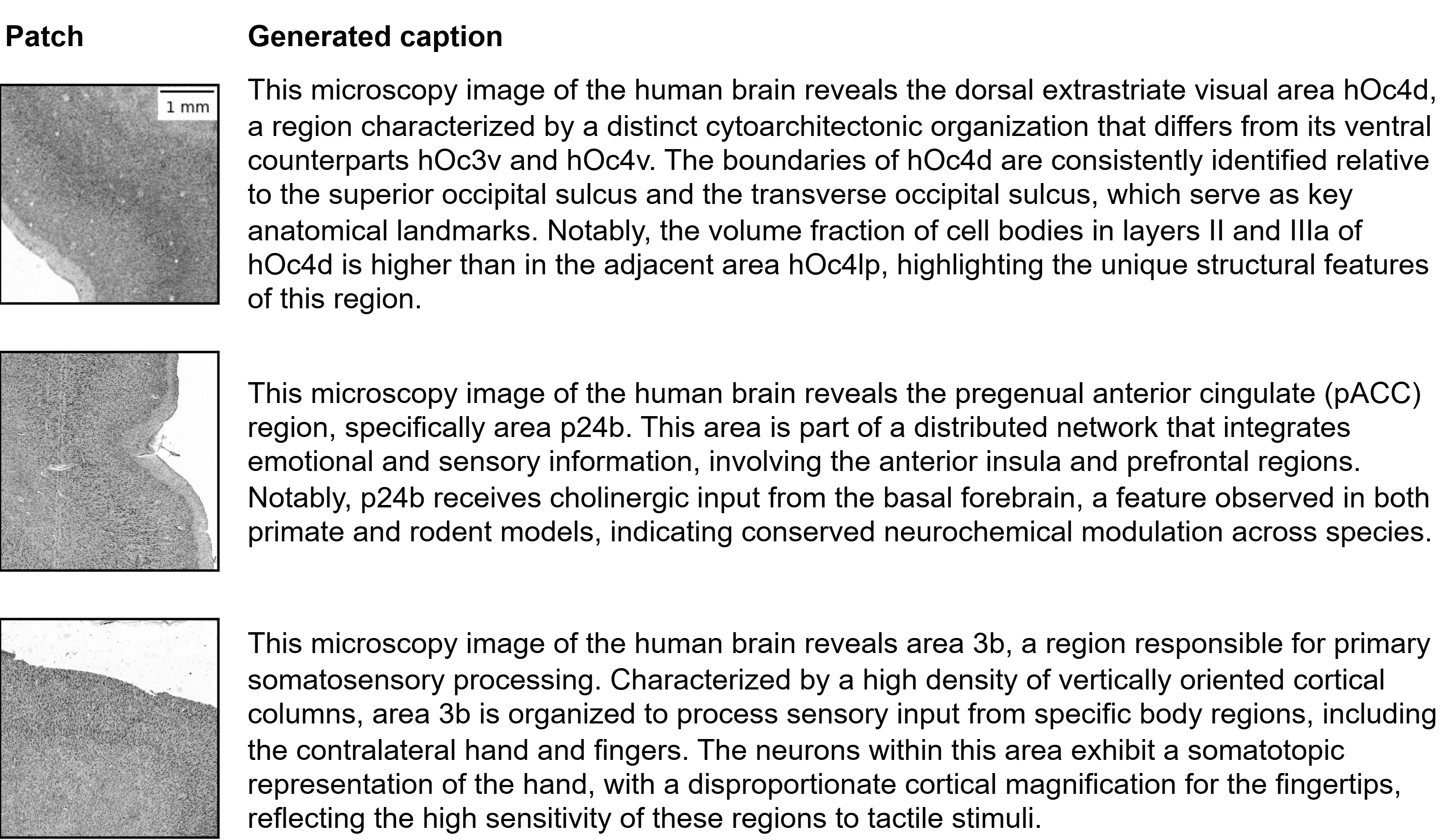

本文提出了一种标签介导的方法,通过仅使用标签连接图像和文本,无需配对的图像-文本数据,即可从图像生成有意义的描述。该方法从相关文献中自动挖掘区域描述,并将其用作反映典型细胞结构属性的合成描述。通过图像到文本的训练目标,将现有的细胞结构视觉基础模型(CytoNet)与大型语言模型耦合,从而可以用自然语言描述显微镜区域。在57个大脑区域上,该方法生成了合理的区域级描述,并通过显式拒绝未见区域来支持开放集使用。对于范围内的图像块,该方法以90.6%的准确率匹配细胞结构参考标签;在区域标签被掩盖的情况下,其描述仍然具有足够的区分性,可以在8路测试中以68.6%的准确率恢复该区域。这些结果表明,弱标签介导的配对足以将现有的生物医学视觉基础模型与语言连接起来,为在缺乏细粒度配对注释的领域中集成自然语言提供了一种实用的方法。

🔬 方法详解

问题定义:论文旨在解决人脑细胞结构显微图像分析中,缺乏配对图像-文本数据导致难以利用视觉-语言模型进行自然语言描述的问题。现有方法依赖于大量人工标注的图像-文本对,成本高昂且难以获取,限制了视觉-语言模型在生物医学领域的应用。

核心思路:论文的核心思路是利用弱监督学习,通过标签作为桥梁,将图像和文本联系起来。具体来说,利用已有的细胞结构区域标签,从相关文献中自动挖掘区域描述,作为合成的图像描述。这样,无需人工标注的图像-文本对,即可训练视觉-语言模型。

技术框架:该方法主要包含以下几个阶段:1) 数据准备:收集细胞结构显微图像和对应的区域标签;2) 文本挖掘:从相关文献中自动挖掘与区域标签相关的描述文本;3) 模型训练:将现有的细胞结构视觉基础模型(CytoNet)与大型语言模型通过图像到文本的训练目标进行耦合,利用合成的图像描述进行训练;4) 模型评估:评估模型生成描述的质量和准确性。

关键创新:该方法最重要的技术创新点在于利用弱监督学习,通过标签介导的方式,实现了视觉-语言模型的训练,无需人工标注的图像-文本对。这大大降低了数据标注的成本,提高了模型的可扩展性。与现有方法相比,该方法更加实用,可以在缺乏细粒度配对注释的领域中应用。

关键设计:在模型训练阶段,使用了图像到文本的训练目标,即给定图像,模型需要生成对应的描述文本。损失函数可以使用交叉熵损失或类似的文本生成损失函数。在文本挖掘阶段,需要设计合适的算法,从文献中提取与区域标签相关的描述文本,例如可以使用关键词匹配、语义相似度计算等方法。

🖼️ 关键图片

📊 实验亮点

该方法在57个大脑区域上进行了评估,结果表明,该方法能够生成合理的区域级描述,并在开放集设置下表现良好。对于范围内的图像块,该方法以90.6%的准确率匹配细胞结构参考标签;在区域标签被掩盖的情况下,其描述仍然具有足够的区分性,可以在8路测试中以68.6%的准确率恢复该区域。

🎯 应用场景

该研究成果可应用于人脑细胞结构分析、疾病诊断、药物研发等领域。通过自然语言描述细胞结构,可以帮助研究人员更好地理解大脑的组织结构和功能,为疾病的诊断和治疗提供新的思路。此外,该方法还可以推广到其他生物医学图像分析领域,例如病理切片分析、基因表达分析等。

📄 摘要(原文)

Foundation models increasingly offer potential to support interactive, agentic workflows that assist researchers during analysis and interpretation of image data. Such workflows often require coupling vision to language to provide a natural-language interface. However, paired image-text data needed to learn this coupling are scarce and difficult to obtain in many research and clinical settings. One such setting is microscopic analysis of cell-body-stained histological human brain sections, which enables the study of cytoarchitecture: cell density and morphology and their laminar and areal organization. Here, we propose a label-mediated method that generates meaningful captions from images by linking images and text only through a label, without requiring curated paired image-text data. Given the label, we automatically mine area descriptions from related literature and use them as synthetic captions reflecting canonical cytoarchitectonic attributes. An existing cytoarchitectonic vision foundation model (CytoNet) is then coupled to a large language model via an image-to-text training objective, enabling microscopy regions to be described in natural language. Across 57 brain areas, the resulting method produces plausible area-level descriptions and supports open-set use through explicit rejection of unseen areas. It matches the cytoarchitectonic reference label for in-scope patches with 90.6% accuracy and, with the area label masked, its descriptions remain discriminative enough to recover the area in an 8-way test with 68.6% accuracy. These results suggest that weak, label-mediated pairing can suffice to connect existing biomedical vision foundation models to language, providing a practical recipe for integrating natural-language in domains where fine-grained paired annotations are scarce.