PanoEnv: Exploring 3D Spatial Intelligence in Panoramic Environments with Reinforcement Learning

作者: Zekai Lin, Xu Zheng

分类: cs.CV

发布日期: 2026-02-25

💡 一句话要点

PanoEnv:利用强化学习探索全景环境中3D空间智能

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 全景图像 3D空间推理 视觉-语言模型 强化学习 群体相对策略优化

📋 核心要点

- 现有的视觉-语言模型在全景图像上进行3D空间推理时,由于几何失真和3D监督的不足,表现不佳。

- 提出了一种基于强化学习的后训练框架,利用群体相对策略优化和几何感知奖励,提升模型对3D空间的理解能力。

- 通过PanoEnv基准测试和两阶段课程训练,7B模型在3D空间推理任务上取得了显著提升,甚至超越了32B模型。

📝 摘要(中文)

360度全景图像在虚拟现实、自动驾驶和机器人技术中被广泛应用,以实现整体场景理解。然而,由于几何失真和有限的3D监督,当前的视觉-语言模型(VLMs)在等距柱状投影(ERP)图像上的3D空间推理方面表现不佳。我们引入PanoEnv,这是一个基于合成3D环境的大规模VQA基准,包含14.8K个问题,涵盖五个类别(例如,相对位置、体积比较),并以精确的3D标注为基础,包括深度、分割和边界框。对14个最先进的VLMs进行基准测试表明,其3D理解能力有限,总体准确率仅为49.34%,开放式(OE)问题的准确率仅为8.36%。为了增强3D推理能力,我们提出了一种基于群体相对策略优化(GRPO)的强化学习后训练框架,该框架具有以真实标签为指导的奖励,并结合了五个几何感知策略,如距离容忍和空间一致性。一个两阶段课程进一步缓解了灾难性遗忘:第一阶段训练结构化任务(真/假和多项选择),第二阶段微调混合开放式数据,以提高泛化能力。我们的7B模型实现了新的最先进的性能,将总体准确率提高到52.93%(+3.59%),开放式准确率提高到14.83%,同时保持了结构化任务的性能。它还实现了最高的语义评估分数(Q-Score 6.24, P-Score 5.95),超过了32B模型。这些结果表明,PanoEnv-QA和我们的基于课程的RL框架有效地将3D空间智能注入到VLMs中,以实现全向感知。

🔬 方法详解

问题定义:论文旨在解决视觉-语言模型(VLMs)在全景图像上进行3D空间推理能力不足的问题。现有方法在处理等距柱状投影(ERP)图像时,由于几何失真和缺乏充分的3D监督信息,难以准确理解场景中的空间关系。这限制了VLMs在虚拟现实、自动驾驶和机器人等领域的应用。

核心思路:论文的核心思路是利用强化学习(RL)对VLMs进行后训练,通过设计合适的奖励函数和训练策略,引导模型学习3D空间推理能力。具体来说,采用群体相对策略优化(GRPO)算法,并结合几何感知策略,使模型能够更好地理解全景图像中的空间信息。

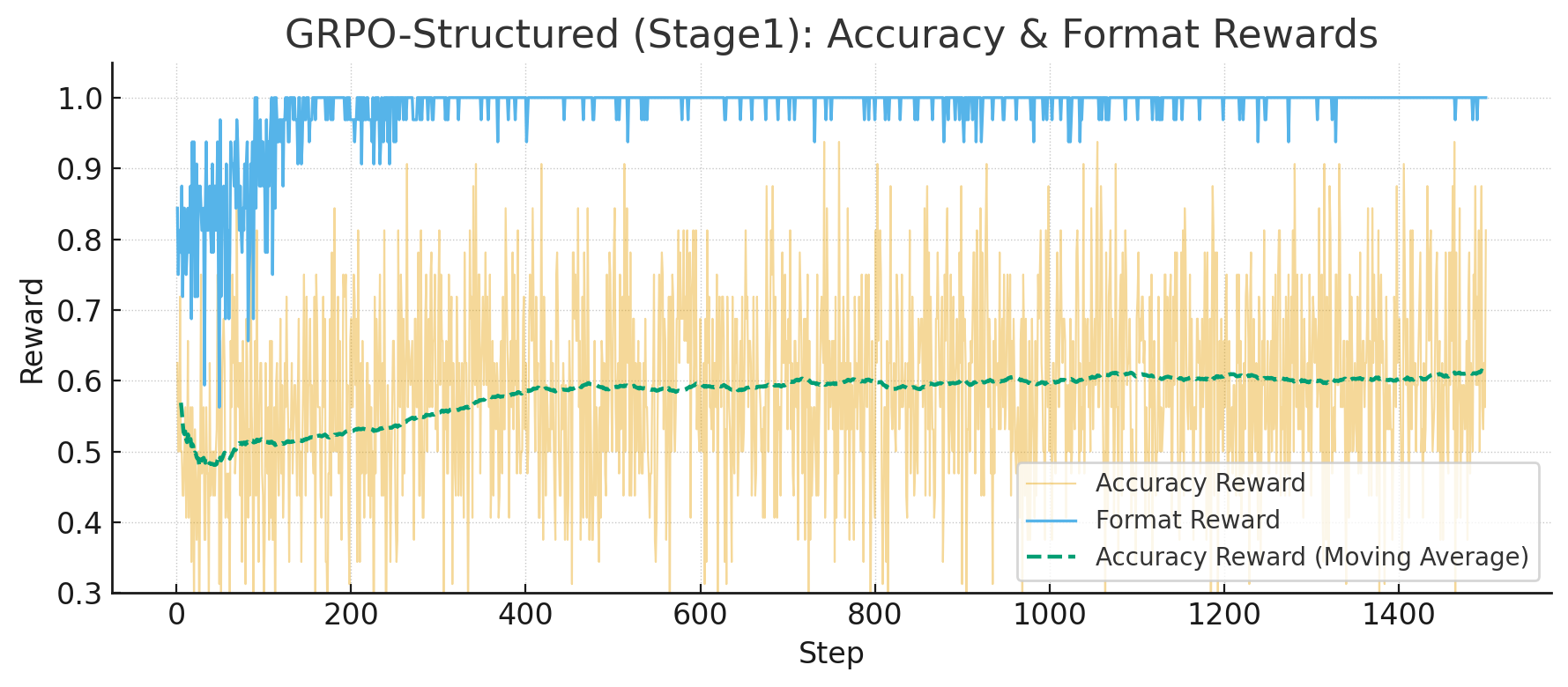

技术框架:整体框架包含以下几个主要步骤:1)构建大规模的VQA基准数据集PanoEnv,包含丰富的3D标注信息;2)使用PanoEnv对预训练的VLMs进行强化学习后训练;3)设计基于GRPO的强化学习算法,并引入几何感知奖励函数;4)采用两阶段课程学习策略,缓解灾难性遗忘问题。第一阶段训练结构化任务,第二阶段微调开放式数据。

关键创新:论文的关键创新在于:1)提出了PanoEnv数据集,为全景图像3D空间推理提供了基准;2)设计了基于GRPO的强化学习框架,有效提升了VLMs的3D空间理解能力;3)引入了几何感知奖励函数,鼓励模型学习空间一致性和距离容忍性;4)采用了两阶段课程学习策略,缓解了灾难性遗忘问题。

关键设计:几何感知奖励函数包含五个策略:距离容忍(允许一定范围内的距离误差)、空间一致性(鼓励预测的空间关系与真实标签一致)、深度信息利用(利用深度信息辅助推理)、分割信息利用(利用分割信息区分不同对象)、边界框信息利用(利用边界框信息定位对象)。两阶段课程学习中,第一阶段使用真/假和多项选择题进行训练,第二阶段使用混合的开放式问题进行微调。GRPO算法中的群体大小和学习率等参数也经过了仔细调整。

🖼️ 关键图片

📊 实验亮点

实验结果表明,提出的方法在PanoEnv数据集上取得了显著的性能提升。7B模型在总体准确率上提升了3.59%,达到52.93%,在开放式问题上的准确率提升了6.47%,达到14.83%。同时,该模型在语义评估指标Q-Score和P-Score上均超过了32B模型,证明了该方法在提升3D空间推理能力方面的有效性。

🎯 应用场景

该研究成果可应用于虚拟现实、自动驾驶、机器人等领域。例如,在自动驾驶中,增强的3D空间理解能力可以帮助车辆更好地感知周围环境,提高行驶安全性。在机器人领域,可以使机器人更好地理解和操作3D空间中的物体。此外,该研究也为视觉-语言模型的3D空间推理能力提升提供了新的思路。

📄 摘要(原文)

360 panoramic images are increasingly used in virtual reality, autonomous driving, and robotics for holistic scene understanding. However, current Vision-Language Models (VLMs) struggle with 3D spatial reasoning on Equirectangular Projection (ERP) images due to geometric distortion and limited 3D supervision. We introduce PanoEnv, a large-scale VQA benchmark built from synthetic 3D environments, containing 14.8K questions across five categories (e.g., relative position, volume comparison) grounded in accurate 3D annotations including depth, segmentation, and bounding boxes. Benchmarking 14 state-of-the-art VLMs reveals limited 3D understanding, achieving only 49.34% overall accuracy and 8.36% on open-ended (OE) questions. To enhance 3D reasoning, we propose a reinforcement learning post-training framework based on Group Relative Policy Optimization (GRPO) with a ground-truth-guided reward that incorporates five geometry-aware strategies such as distance tolerance and spatial consistency. A two-stage curriculum further mitigates catastrophic forgetting: Stage 1 trains on structured tasks (true/false and multiple choice), and Stage 2 fine-tunes on mixed open-ended data to improve generalization. Our 7B model achieves new state-of-the-art performance, improving overall accuracy to 52.93% (+3.59%) and open-ended accuracy to 14.83% while maintaining structured-task performance. It also achieves top semantic evaluation scores (Q-Score 6.24, P-Score 5.95), surpassing 32B models. These results demonstrate that PanoEnv-QA and our curriculum-based RL framework effectively instill 3D spatial intelligence in VLMs for omnidirectional perception.