StoryMovie: A Dataset for Semantic Alignment of Visual Stories with Movie Scripts and Subtitles

作者: Daniel Oliveira, David Martins de Matos

分类: cs.CV, cs.AI

发布日期: 2026-02-25

备注: 15 pages, submitted to Journal of Visual Communication and Image Representation

💡 一句话要点

StoryMovie数据集通过电影剧本和字幕对齐,提升视觉故事中语义关系的准确性。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 视觉故事生成 语义对齐 电影剧本 字幕对齐 多模态学习

📋 核心要点

- 现有视觉故事模型在语义关系上存在幻觉问题,导致对话归属等错误。

- StoryMovie数据集通过LCS匹配将故事与电影剧本和字幕对齐,实现更准确的语义关系。

- 在StoryMovie上微调的Storyteller3模型,在对话归属方面显著优于基线模型。

📝 摘要(中文)

视觉故事叙述模型即使能够正确地将实体与图像关联,仍然可能产生语义关系的幻觉,导致错误的对话归属、角色互动或情感状态。我们引入了StoryMovie,一个包含1,757个故事的数据集,通过LCS匹配与电影剧本和字幕对齐。我们的对齐流程将剧本对话与字幕时间戳同步,通过将剧本中的角色名称链接到字幕中的时间位置来实现对话归属。利用这种对齐的内容,我们生成了保持视觉基础标签的故事,同时结合了真实的角色名称、对话和关系动态。我们在此数据集上微调了Qwen Storyteller3,建立在视觉基础和实体重新识别的先前工作之上。使用DeepSeek V3作为评判,评估表明Storyteller3在字幕对齐方面相对于基础Qwen2.5-VL 7B取得了89.9%的胜率。与未进行剧本基础训练的Storyteller相比,Storyteller3的胜率从38.0%提升至48.5%,证实了语义对齐能够逐步提高对话归属,而不仅仅依赖于视觉基础。

🔬 方法详解

问题定义:现有视觉故事生成模型,即使能将图像中的实体正确关联,仍然会在语义关系上产生幻觉,例如错误的对话归属、角色互动和情感状态。现有方法缺乏对剧本等外部知识的有效利用,难以保证故事的语义一致性和真实性。

核心思路:论文的核心思路是通过将视觉故事与电影剧本和字幕进行对齐,从而引入外部知识,约束模型的生成过程,减少语义幻觉。通过对齐,模型可以学习到更准确的角色关系、对话内容和情感表达。

技术框架:该方法主要包含以下几个阶段:1) 数据收集:构建包含1757个故事的StoryMovie数据集。2) 数据对齐:使用LCS(最长公共子序列)匹配算法,将故事与电影剧本和字幕进行对齐,建立角色、对话和时间戳之间的对应关系。3) 模型训练:在对齐后的StoryMovie数据集上微调Qwen Storyteller3模型。4) 模型评估:使用DeepSeek V3作为评判,评估模型在字幕对齐和对话归属方面的性能。

关键创新:该论文的关键创新在于构建了StoryMovie数据集,并提出了一种基于LCS匹配的剧本和字幕对齐方法。通过将视觉故事与电影剧本和字幕对齐,引入了外部知识,从而提高了视觉故事生成模型的语义一致性和真实性。

关键设计:对齐过程的关键在于使用LCS匹配算法,找到剧本对话和字幕之间的最佳对应关系。通过将剧本中的角色名称链接到字幕中的时间位置,实现了对话归属。在模型训练方面,使用了Qwen Storyteller3模型,并在StoryMovie数据集上进行了微调。评估指标包括字幕对齐的胜率和对话归属的准确率。

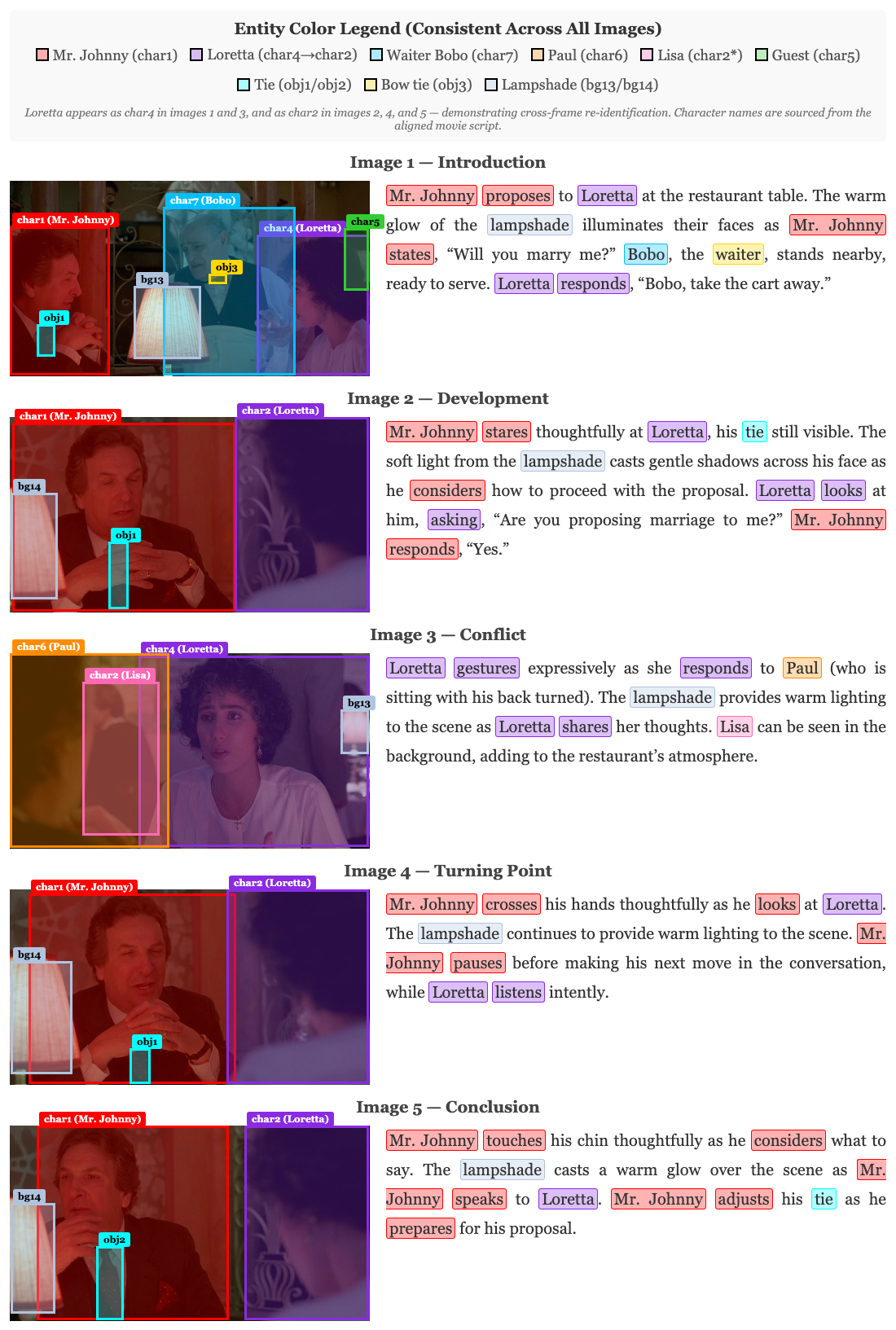

🖼️ 关键图片

📊 实验亮点

实验结果表明,在StoryMovie数据集上微调的Storyteller3模型,在字幕对齐方面相对于基础Qwen2.5-VL 7B取得了89.9%的胜率。与未进行剧本基础训练的Storyteller相比,Storyteller3的胜率从38.0%提升至48.5%,证实了语义对齐能够有效提高对话归属的准确性。

🎯 应用场景

该研究成果可应用于视觉故事生成、电影理解、对话系统等领域。通过引入外部知识,可以生成更真实、更具语义一致性的视觉故事。此外,该方法还可以用于提高对话系统的对话质量,使其能够更好地理解和回应用户的提问。

📄 摘要(原文)

Visual storytelling models that correctly ground entities in images may still hallucinate semantic relationships, generating incorrect dialogue attribution, character interactions, or emotional states. We introduce StoryMovie, a dataset of 1,757 stories aligned with movie scripts and subtitles through LCS matching. Our alignment pipeline synchronizes screenplay dialogue with subtitle timestamps, enabling dialogue attribution by linking character names from scripts to temporal positions from subtitles. Using this aligned content, we generate stories that maintain visual grounding tags while incorporating authentic character names, dialogue, and relationship dynamics. We fine-tune Qwen Storyteller3 on this dataset, building on prior work in visual grounding and entity re-identification. Evaluation using DeepSeek V3 as judge shows that Storyteller3 achieves an 89.9% win rate against base Qwen2.5-VL 7B on subtitle alignment. Compared to Storyteller, trained without script grounding, Storyteller3 achieves 48.5% versus 38.0%, confirming that semantic alignment progressively improves dialogue attribution beyond visual grounding alone.