BrepGaussian: CAD reconstruction from Multi-View Images with Gaussian Splatting

作者: Jiaxing Yu, Dongyang Ren, Hangyu Xu, Zhouyuxiao Yang, Yuanqi Li, Jie Guo, Zhengkang Zhou, Yanwen Guo

分类: cs.CV

发布日期: 2026-02-24

备注: Accepted to CVPR 2026

💡 一句话要点

提出BrepGaussian,利用高斯溅射从多视角图像重建CAD模型

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: CAD模型重建 高斯溅射 边界表示 多视角图像 参数化表示

📋 核心要点

- 现有方法依赖于稠密且干净的点云,难以推广到新的形状,这是从非结构化数据恢复B-rep表示的挑战。

- BrepGaussian采用高斯溅射渲染器和可学习特征,通过特定的拟合策略,从2D图像中学习3D参数化表示。

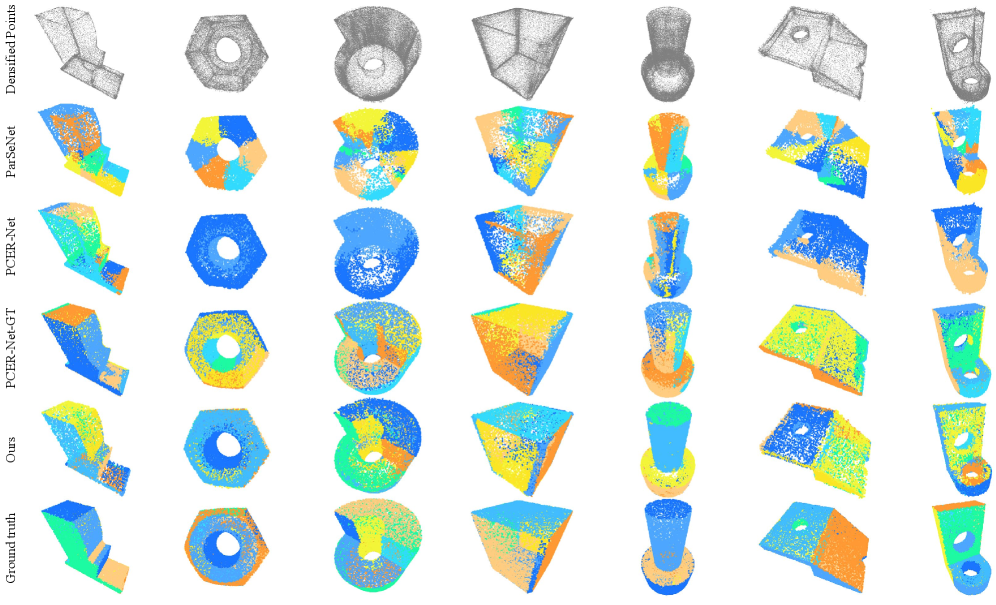

- 实验结果表明,BrepGaussian在CAD模型重建任务上优于现有方法,能够生成更干净的几何形状和连贯的实例表示。

📝 摘要(中文)

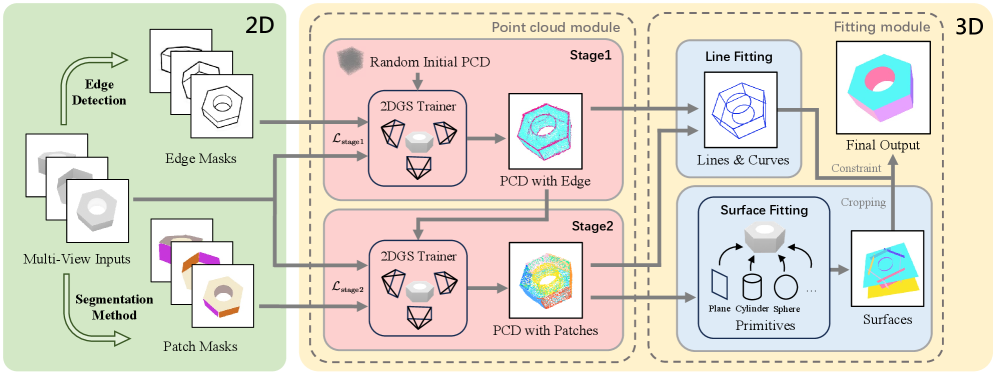

本文提出了一种名为B-rep Gaussian Splatting (BrepGaussian) 的新框架,用于从2D图像中学习3D参数化表示,从而实现从多视角图像重建CAD模型。该方法利用可学习特征的高斯溅射渲染器,并结合特定的拟合策略。为了解耦几何重建和特征学习,引入了一个两阶段学习框架,首先捕获几何形状和边缘,然后细化patch特征,以获得干净的几何形状和连贯的实例表示。大量实验表明,该方法优于目前最先进的方法。代码和数据集将在接收后发布。

🔬 方法详解

问题定义:论文旨在解决从多视角图像重建CAD模型的问题,特别是边界表示(B-rep)模型。现有方法依赖于高质量的点云数据,难以处理噪声和稀疏数据,并且泛化能力有限。

核心思路:论文的核心思路是利用高斯溅射(Gaussian Splatting)技术,结合可学习的特征,直接从2D图像中学习3D参数化表示。通过两阶段的学习框架,解耦几何重建和特征学习,从而提高重建质量和泛化能力。

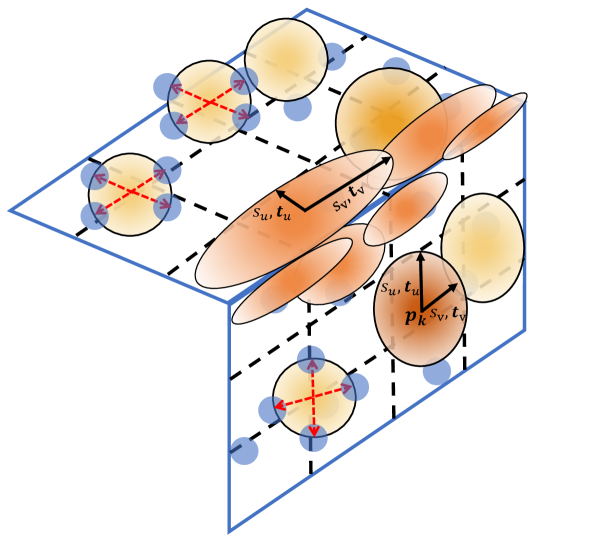

技术框架:BrepGaussian框架主要包含以下几个模块:1) 高斯溅射渲染器:使用3D高斯分布来表示场景,并利用可微分渲染技术将3D高斯投影到2D图像上。2) 可学习特征:为每个高斯分布关联一个可学习的特征向量,用于表示表面的材质和纹理信息。3) 两阶段学习框架:第一阶段,学习几何形状和边缘信息;第二阶段,细化patch特征,以获得更干净的几何形状和连贯的实例表示。4) 拟合策略:使用特定的损失函数和优化算法,将高斯分布拟合到目标形状。

关键创新:该方法的主要创新在于:1) 将高斯溅射技术应用于CAD模型重建任务。2) 提出了两阶段学习框架,解耦了几何重建和特征学习。3) 设计了特定的拟合策略,以提高重建质量和泛化能力。

关键设计:在两阶段学习框架中,第一阶段主要关注几何形状的重建,使用的损失函数包括图像重建损失和边缘损失。第二阶段主要关注特征的细化,使用的损失函数包括特征一致性损失和实例分割损失。高斯溅射渲染器使用了可微分的渲染技术,可以有效地将3D高斯投影到2D图像上,并计算梯度。具体的网络结构和参数设置在论文中有详细描述。

🖼️ 关键图片

📊 实验亮点

实验结果表明,BrepGaussian在CAD模型重建任务上取得了显著的性能提升,优于现有的最先进方法。具体而言,该方法能够生成更干净的几何形状和连贯的实例表示,并且具有更好的泛化能力。论文中提供了详细的定量和定性比较结果。

🎯 应用场景

该研究成果可应用于逆向工程、CAD模型重建、3D内容生成等领域。例如,可以利用该方法从扫描数据或照片中自动生成CAD模型,从而加速产品设计和制造过程。此外,该方法还可以用于虚拟现实和增强现实应用中,生成逼真的3D场景。

📄 摘要(原文)

The boundary representation (B-rep) models a 3D solid as its explicit boundaries: trimmed corners, edges, and faces. Recovering B-rep representation from unstructured data is a challenging and valuable task of computer vision and graphics. Recent advances in deep learning have greatly improved the recovery of 3D shape geometry, but still depend on dense and clean point clouds and struggle to generalize to novel shapes. We propose B-rep Gaussian Splatting (BrepGaussian), a novel framework that learns 3D parametric representations from 2D images. We employ a Gaussian Splatting renderer with learnable features, followed by a specific fitting strategy. To disentangle geometry reconstruction and feature learning, we introduce a two-stage learning framework that first captures geometry and edges and then refines patch features to achieve clean geometry and coherent instance representations. Extensive experiments demonstrate the superior performance of our approach to state-of-the-art methods. We will release our code and datasets upon acceptance.