Cycle-Consistent Tuning for Layered Image Decomposition

作者: Zheng Gu, Min Lu, Zhida Sun, Dani Lischinski, Daniel Cohen-O, Hui Huang

分类: cs.CV

发布日期: 2026-02-24

备注: Accepted to CVPR 2026. Project page: https://vcc.tech/research/2026/ImgDecom

💡 一句话要点

提出循环一致性微调方法,用于基于扩散模型的图像分层解耦

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 图像分解 扩散模型 循环一致性 LoRA微调 自监督学习

📋 核心要点

- 现有图像分层解耦方法难以处理阴影、反射等复杂非线性交互,鲁棒性不足。

- 提出循环一致性微调策略,联合训练分解和组合模型,保证重建一致性,提升鲁棒性。

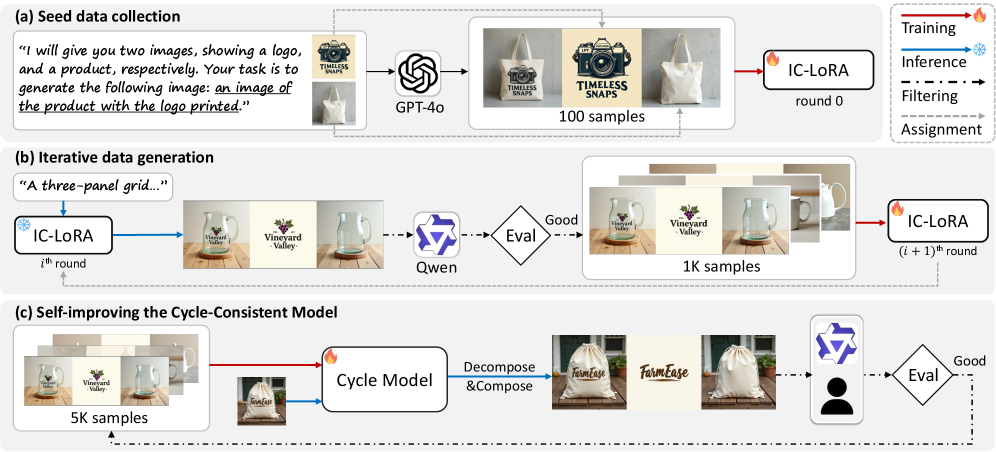

- 引入渐进式自改进过程,利用模型生成的高质量样本迭代增强训练集,提升性能。

📝 摘要(中文)

在真实世界图像中解耦视觉层是一个持续存在的挑战,因为这些层通常涉及非线性且全局耦合的交互,包括阴影、反射和透视畸变。本文提出了一种上下文图像分解框架,该框架利用大型扩散基础模型进行分层分离。我们专注于具有挑战性的logo-object分解,其目标是将logo从其出现的表面上解耦,同时忠实地保留两个层。我们的方法通过轻量级LoRA适配微调预训练的扩散模型,并引入循环一致性微调策略,该策略联合训练分解和组合模型,从而在分解图像和重组图像之间强制执行重建一致性。这种双向监督显著增强了层表现出复杂交互情况下的鲁棒性。此外,我们引入了一个渐进式自改进过程,该过程通过迭代地用高质量的模型生成示例来扩充训练集,以提高性能。大量的实验表明,我们的方法实现了准确和连贯的分解,并且可以有效地推广到其他分解类型,表明其作为分层图像分解的统一框架的潜力。

🔬 方法详解

问题定义:论文旨在解决真实图像中视觉层解耦的难题,特别是logo-object分解。现有方法难以处理层间复杂的非线性交互(如阴影、反射、透视畸变),导致分解效果不佳,鲁棒性不足。

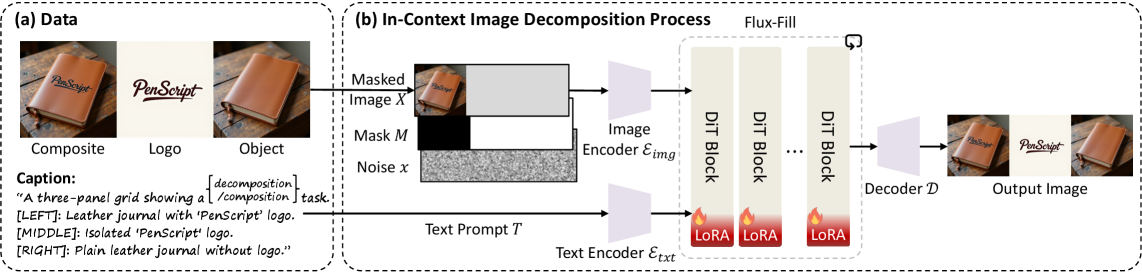

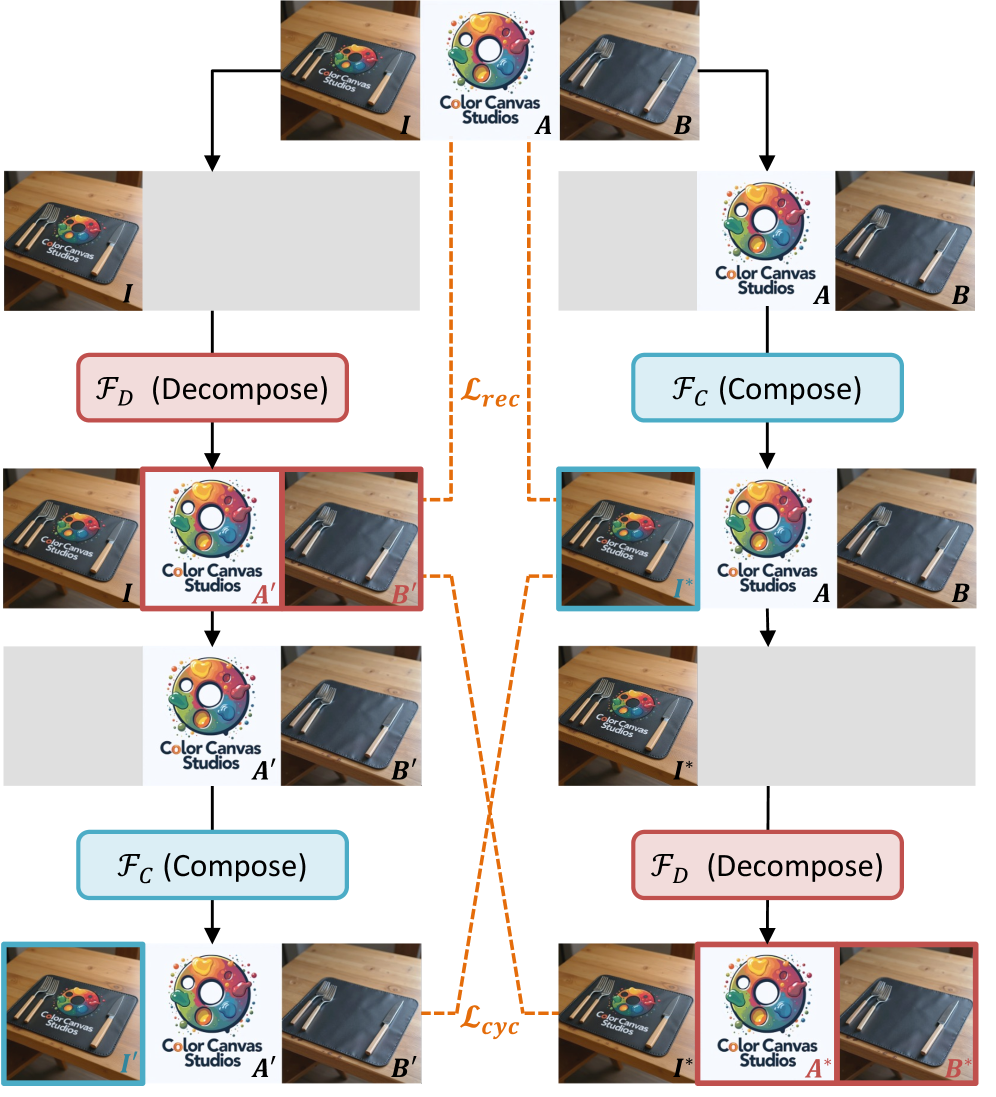

核心思路:核心思路是利用预训练的扩散模型作为基础,通过微调使其适应图像分解任务。关键在于引入循环一致性约束,即分解后的层重新组合后应尽可能还原原始图像。这种循环约束提供了额外的监督信号,增强了模型的鲁棒性和分解质量。

技术框架:整体框架包含两个主要部分:分解模型和组合模型。分解模型负责将输入图像分解为不同的层(例如,logo层和背景层)。组合模型则将分解后的层重新组合成图像。这两个模型通过循环一致性损失进行联合训练。此外,还采用了渐进式自改进过程,迭代地利用模型生成的高质量样本扩充训练集。

关键创新:最重要的创新点在于循环一致性微调策略。与传统的单向分解方法不同,该方法同时训练分解和组合模型,并强制执行分解-组合-重建的循环一致性。这种双向监督能够更好地学习层之间的复杂关系,提高分解的准确性和鲁棒性。

关键设计:论文使用LoRA(Low-Rank Adaptation)进行轻量级微调,降低了计算成本。循环一致性损失函数用于衡量重建图像与原始图像之间的差异。渐进式自改进过程通过设定阈值筛选模型生成的高质量样本,并将其添加到训练集中。具体参数设置和网络结构细节在论文中有详细描述。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法在logo-object分解任务上取得了显著的性能提升。与现有方法相比,该方法能够更准确地分离logo和背景,并保持分解结果的连贯性。此外,该方法还表现出良好的泛化能力,可以有效地应用于其他类型的图像分解任务。

🎯 应用场景

该研究成果可应用于图像编辑、目标移除、增强现实等领域。例如,可以用于将图像中的logo与背景分离,方便进行logo替换或编辑。此外,该方法还可以推广到其他类型的图像分解任务,如反射去除、阴影去除等,具有广泛的应用前景。

📄 摘要(原文)

Disentangling visual layers in real-world images is a persistent challenge in vision and graphics, as such layers often involve non-linear and globally coupled interactions, including shading, reflection, and perspective distortion. In this work, we present an in-context image decomposition framework that leverages large diffusion foundation models for layered separation. We focus on the challenging case of logo-object decomposition, where the goal is to disentangle a logo from the surface on which it appears while faithfully preserving both layers. Our method fine-tunes a pretrained diffusion model via lightweight LoRA adaptation and introduces a cycle-consistent tuning strategy that jointly trains decomposition and composition models, enforcing reconstruction consistency between decomposed and recomposed images. This bidirectional supervision substantially enhances robustness in cases where the layers exhibit complex interactions. Furthermore, we introduce a progressive self-improving process, which iteratively augments the training set with high-quality model-generated examples to refine performance. Extensive experiments demonstrate that our approach achieves accurate and coherent decompositions and also generalizes effectively across other decomposition types, suggesting its potential as a unified framework for layered image decomposition.