RU4D-SLAM: Reweighting Uncertainty in Gaussian Splatting SLAM for 4D Scene Reconstruction

作者: Yangfan Zhao, Hanwei Zhang, Ke Huang, Qiufeng Wang, Zhenzhou Shao, Dengyu Wu

分类: cs.CV, cs.RO

发布日期: 2026-02-24

💡 一句话要点

RU4D-SLAM:通过重加权不确定性实现动态场景的4D高斯溅射SLAM重建

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: SLAM 4D重建 高斯溅射 动态场景 不确定性建模

📋 核心要点

- 现有SLAM方法在动态环境中表现不佳,移动物体干扰了3D重建和可靠跟踪。

- RU4D-SLAM通过引入时间因素和不确定性感知,实现了动态场景的鲁棒4D重建。

- 实验表明,该方法在动态场景中显著优于现有方法,提高了轨迹精度和重建质量。

📝 摘要(中文)

本文提出了一种名为RU4D-SLAM的鲁棒高效框架,用于4D场景重建,该框架将时间因素引入空间3D表示,同时结合了对场景变化的、模糊图像合成和动态场景重建的不确定性感知。通过集成运动模糊渲染来增强动态场景表示,并通过扩展专为静态场景设计的每像素不确定性建模来处理模糊图像,从而改进了不确定性感知跟踪。此外,还提出了一种语义引导的重加权机制,用于动态场景中的每像素不确定性估计,并引入可学习的不透明度权重以支持自适应4D映射。在标准基准上的大量实验表明,该方法在轨迹精度和4D场景重建方面均显著优于最先进的方法,尤其是在具有移动对象和低质量输入的动态环境中。

🔬 方法详解

问题定义:现有基于3D高斯溅射的SLAM方法在动态环境中面临挑战,移动物体导致重建质量下降,进而影响跟踪的准确性。现有的方法难以有效地处理运动模糊和场景变化带来的不确定性,导致重建结果不准确和不稳定。

核心思路:RU4D-SLAM的核心思路是将时间信息融入到3D高斯溅射的表示中,构建4D高斯溅射。同时,通过引入不确定性感知机制,对场景变化和运动模糊进行建模,从而提高SLAM在动态环境中的鲁棒性和准确性。该方法还利用语义信息来指导不确定性的重加权,进一步提升了动态场景的处理能力。

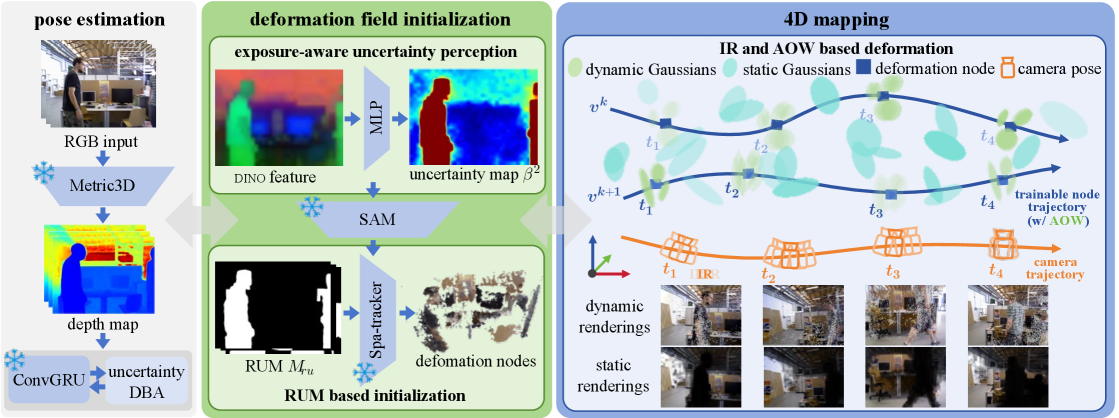

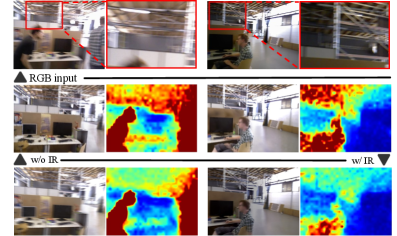

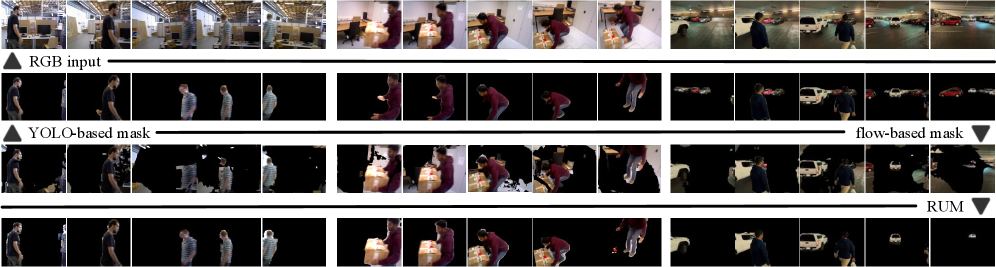

技术框架:RU4D-SLAM框架主要包含以下几个模块:1) 4D高斯溅射表示:将时间信息融入到3D高斯溅射中,构建4D场景表示。2) 运动模糊渲染:通过模拟运动模糊来提高渲染质量,并为不确定性估计提供信息。3) 不确定性感知跟踪:扩展了每像素不确定性建模,使其能够处理模糊图像,并利用语义信息进行不确定性重加权。4) 自适应4D映射:引入可学习的不透明度权重,以支持自适应的4D场景重建。

关键创新:RU4D-SLAM的关键创新在于:1) 将时间信息融入到高斯溅射中,实现了4D场景的表示。2) 提出了语义引导的不确定性重加权机制,能够有效地处理动态场景中的不确定性。3) 引入了运动模糊渲染,提高了渲染质量和不确定性估计的准确性。

关键设计:该方法使用可学习的不透明度权重来控制4D高斯溅射的融合。语义引导的不确定性重加权机制利用语义分割结果来调整每像素的不确定性估计。损失函数包括渲染损失、深度损失和语义一致性损失等,用于优化4D高斯溅射的参数。

🖼️ 关键图片

📊 实验亮点

RU4D-SLAM在多个标准数据集上进行了评估,实验结果表明,该方法在轨迹精度和4D场景重建质量方面均优于现有方法。尤其是在具有移动物体和低质量输入的动态环境中,RU4D-SLAM的性能提升更为显著。具体数据需要在论文中查找。

🎯 应用场景

RU4D-SLAM在机器人导航、自动驾驶、增强现实等领域具有广泛的应用前景。它可以用于构建动态环境的精确地图,提高机器人在复杂环境中的定位和导航能力。此外,该方法还可以用于创建逼真的虚拟现实体验,以及进行动态场景的分析和理解。

📄 摘要(原文)

Combining 3D Gaussian splatting with Simultaneous Localization and Mapping (SLAM) has gained popularity as it enables continuous 3D environment reconstruction during motion. However, existing methods struggle in dynamic environments, particularly moving objects complicate 3D reconstruction and, in turn, hinder reliable tracking. The emergence of 4D reconstruction, especially 4D Gaussian splatting, offers a promising direction for addressing these challenges, yet its potential for 4D-aware SLAM remains largely underexplored. Along this direction, we propose a robust and efficient framework, namely Reweighting Uncertainty in Gaussian Splatting SLAM (RU4D-SLAM) for 4D scene reconstruction, that introduces temporal factors into spatial 3D representation while incorporating uncertainty-aware perception of scene changes, blurred image synthesis, and dynamic scene reconstruction. We enhance dynamic scene representation by integrating motion blur rendering, and improve uncertainty-aware tracking by extending per-pixel uncertainty modeling, which is originally designed for static scenarios, to handle blurred images. Furthermore, we propose a semantic-guided reweighting mechanism for per-pixel uncertainty estimation in dynamic scenes, and introduce a learnable opacity weight to support adaptive 4D mapping. Extensive experiments on standard benchmarks demonstrate that our method substantially outperforms state-of-the-art approaches in both trajectory accuracy and 4D scene reconstruction, particularly in dynamic environments with moving objects and low-quality inputs. Code available: https://ru4d-slam.github.io