RecoverMark: Robust Watermarking for Localization and Recovery of Manipulated Faces

作者: Haonan An, Xiaohui Ye, Guang Hua, Yihang Tao, Hangcheng Cao, Xiangyu Yu, Yuguang Fang

分类: cs.CV

发布日期: 2026-02-24

备注: Accepted by CVPR 2026

💡 一句话要点

RecoverMark:用于人脸篡改定位与恢复的鲁棒水印方法

🎯 匹配领域: 支柱一:机器人控制 (Robot Control)

关键词: 人脸篡改检测 鲁棒水印 内容恢复 所有权验证 图像安全

📋 核心要点

- 现有脆弱水印方法易受水印移除攻击,且双水印策略存在干扰和容量限制,影响篡改检测效果。

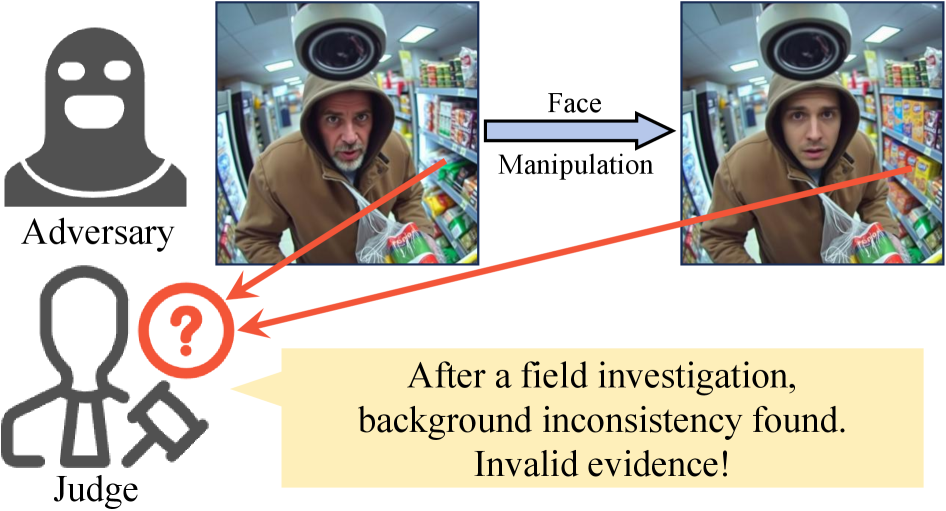

- RecoverMark将人脸内容作为水印嵌入背景,利用背景语义一致性约束,提升水印的鲁棒性。

- RecoverMark采用两阶段训练和渐进式策略,模拟攻击并增强水印鲁棒性,实现篡改定位、恢复和IP保护。

📝 摘要(中文)

人工智能生成内容的激增使得复杂的人脸篡改变得容易,严重损害了视觉完整性,并对知识产权构成了前所未有的挑战。为了应对这一问题,一种常见的积极防御措施是利用脆弱水印来检测、定位甚至恢复被篡改的区域。然而,这些方法总是假设攻击者不知道嵌入的水印,忽略了它们对水印移除攻击的固有脆弱性。此外,这种脆弱性在常用的双水印策略中更加严重,该策略添加了鲁棒水印用于图像所有权验证,其中相互干扰和有限的嵌入容量降低了脆弱水印的有效性。为了解决这一差距,我们提出了RecoverMark,一个水印框架,可以同时实现鲁棒的篡改定位、内容恢复和所有权验证。我们的关键见解是双重的。首先,我们利用了一个关键的现实约束:攻击者必须保持背景的语义一致性以避免视觉检测,即使他们应用全局的、难以察觉的水印移除攻击。其次,使用图像自身的内容(在本文中是人脸)作为水印可以增强提取的鲁棒性。基于这些见解,RecoverMark将受保护的人脸内容本身视为水印,并将其嵌入到周围的背景中。通过设计一个鲁棒的两阶段训练范式,其中包含精心设计的失真层来模拟全面的潜在攻击,以及渐进式训练策略,RecoverMark实现了鲁棒的水印嵌入,而不是脆弱的方式,从而同时实现图像篡改定位、恢复和图像IP保护。大量的实验表明,所提出的RecoverMark对已知和未知的攻击具有鲁棒性,并且对分布内和分布外数据具有泛化能力。

🔬 方法详解

问题定义:论文旨在解决人脸图像篡改的检测、定位和恢复问题,同时进行图像所有权验证。现有基于脆弱水印的方法容易受到攻击者移除水印的攻击,特别是当使用双水印策略(一个脆弱水印用于篡改检测,一个鲁棒水印用于所有权验证)时,两个水印之间会相互干扰,并且嵌入容量有限,导致脆弱水印的有效性降低。

核心思路:论文的核心思路是将人脸图像自身的内容作为水印,并将其嵌入到图像的背景中。这种方法利用了一个关键的现实约束:攻击者在篡改人脸时,通常需要保持背景的语义一致性,以避免引起注意。即使攻击者尝试移除水印,他们也必须小心,以免破坏背景的语义信息。因此,嵌入在背景中的水印更难被移除,从而提高了水印的鲁棒性。

技术框架:RecoverMark框架包含两个主要阶段:水印嵌入阶段和水印提取阶段。在水印嵌入阶段,首先将人脸图像编码成水印信息,然后将该水印信息嵌入到背景中。在水印提取阶段,首先从图像中提取水印信息,然后使用提取的水印信息来检测、定位和恢复被篡改的人脸区域,并验证图像的所有权。该框架使用一个两阶段的训练范式,包括一个水印嵌入网络和一个水印提取网络。

关键创新:该论文的关键创新在于:1) 将人脸内容本身作为水印,提高了水印的鲁棒性;2) 利用背景的语义一致性约束,使得攻击者难以移除水印;3) 提出了一个鲁棒的两阶段训练范式,可以有效地抵抗各种攻击。与现有方法相比,RecoverMark不需要脆弱水印,因此避免了脆弱水印容易被移除的问题。

关键设计:RecoverMark使用一个两阶段的训练范式。第一阶段训练水印嵌入网络,使其能够将人脸内容嵌入到背景中,同时保持图像的视觉质量。第二阶段训练水印提取网络,使其能够从图像中提取水印信息,并用于篡改检测、定位、恢复和所有权验证。在训练过程中,使用了精心设计的失真层来模拟各种可能的攻击,例如JPEG压缩、噪声添加、模糊等。此外,还使用了渐进式训练策略,逐步提高水印的鲁棒性。损失函数包括重建损失、对抗损失和水印损失,以确保图像质量、水印的不可见性和水印的鲁棒性。

🖼️ 关键图片

📊 实验亮点

实验结果表明,RecoverMark在篡改定位、内容恢复和所有权验证方面表现出色,对已知和未知的攻击具有很强的鲁棒性。该方法在分布内和分布外数据上均表现出良好的泛化能力,证明了其在实际应用中的可行性。具体性能数据未在摘要中给出,但强调了其优于现有方法的鲁棒性。

🎯 应用场景

RecoverMark可应用于数字媒体内容保护、人脸伪造检测、图像版权追踪等领域。该技术能够有效应对AI生成内容带来的安全挑战,维护视觉内容的真实性和知识产权,在新闻媒体、社交平台、安全监控等场景具有重要的应用价值和潜力。

📄 摘要(原文)

The proliferation of AI-generated content has facilitated sophisticated face manipulation, severely undermining visual integrity and posing unprecedented challenges to intellectual property. In response, a common proactive defense leverages fragile watermarks to detect, localize, or even recover manipulated regions. However, these methods always assume an adversary unaware of the embedded watermark, overlooking their inherent vulnerability to watermark removal attacks. Furthermore, this fragility is exacerbated in the commonly used dual-watermark strategy that adds a robust watermark for image ownership verification, where mutual interference and limited embedding capacity reduce the fragile watermark's effectiveness. To address the gap, we propose RecoverMark, a watermarking framework that achieves robust manipulation localization, content recovery, and ownership verification simultaneously. Our key insight is twofold. First, we exploit a critical real-world constraint: an adversary must preserve the background's semantic consistency to avoid visual detection, even if they apply global, imperceptible watermark removal attacks. Second, using the image's own content (face, in this paper) as the watermark enhances extraction robustness. Based on these insights, RecoverMark treats the protected face content itself as the watermark and embeds it into the surrounding background. By designing a robust two-stage training paradigm with carefully crafted distortion layers that simulate comprehensive potential attacks and a progressive training strategy, RecoverMark achieves a robust watermark embedding in no fragile manner for image manipulation localization, recovery, and image IP protection simultaneously. Extensive experiments demonstrate the proposed RecoverMark's robustness against both seen and unseen attacks and its generalizability to in-distribution and out-of-distribution data.