Interaction-aware Representation Modeling with Co-occurrence Consistency for Egocentric Hand-Object Parsing

作者: Yuejiao Su, Yi Wang, Lei Yao, Yawen Cui, Lap-Pui Chau

分类: cs.CV

发布日期: 2026-02-24

🔗 代码/项目: GITHUB

💡 一句话要点

提出InterFormer,通过交互感知建模和共现一致性提升自中心视角下手-物解析性能

🎯 匹配领域: 支柱六:视频提取与匹配 (Video Extraction)

关键词: 自中心视角 手-物交互 目标解析 Transformer网络 具身智能

📋 核心要点

- 现有自中心手-物解析方法在查询初始化、特征选择和物理一致性方面存在不足,限制了其性能和泛化能力。

- InterFormer通过动态查询生成、双上下文特征选择和条件共现损失,显式地建模手-物交互关系,提升解析精度和物理合理性。

- 在EgoHOS和mini-HOI4D数据集上,InterFormer取得了state-of-the-art的性能,验证了其有效性和泛化能力。

📝 摘要(中文)

本文提出了一种交互感知的Transformer网络(InterFormer),用于精确解析自中心视角下的手和活动对象,这对于开发下一代具身智能体至关重要。现有方法存在以下局限:1) 查询初始化机制对不同场景下的活动对象适应性差;2) 使用像素级语义特征迭代优化查询可能引入无关信息;3) 易产生物理上不一致的预测(交互错觉)。InterFormer集成了动态查询生成器(DQG)、双上下文特征选择器(DFS)和条件共现(CoCo)损失。DQG基于手-物接触的空间动态信息生成交互感知查询。DFS融合粗略交互线索和语义特征,抑制噪声并强调交互关系的学习。CoCo损失结合手-物关系约束,增强预测的物理一致性。在EgoHOS和mini-HOI4D数据集上的实验结果表明,InterFormer达到了SOTA性能,并具有良好的泛化能力。

🔬 方法详解

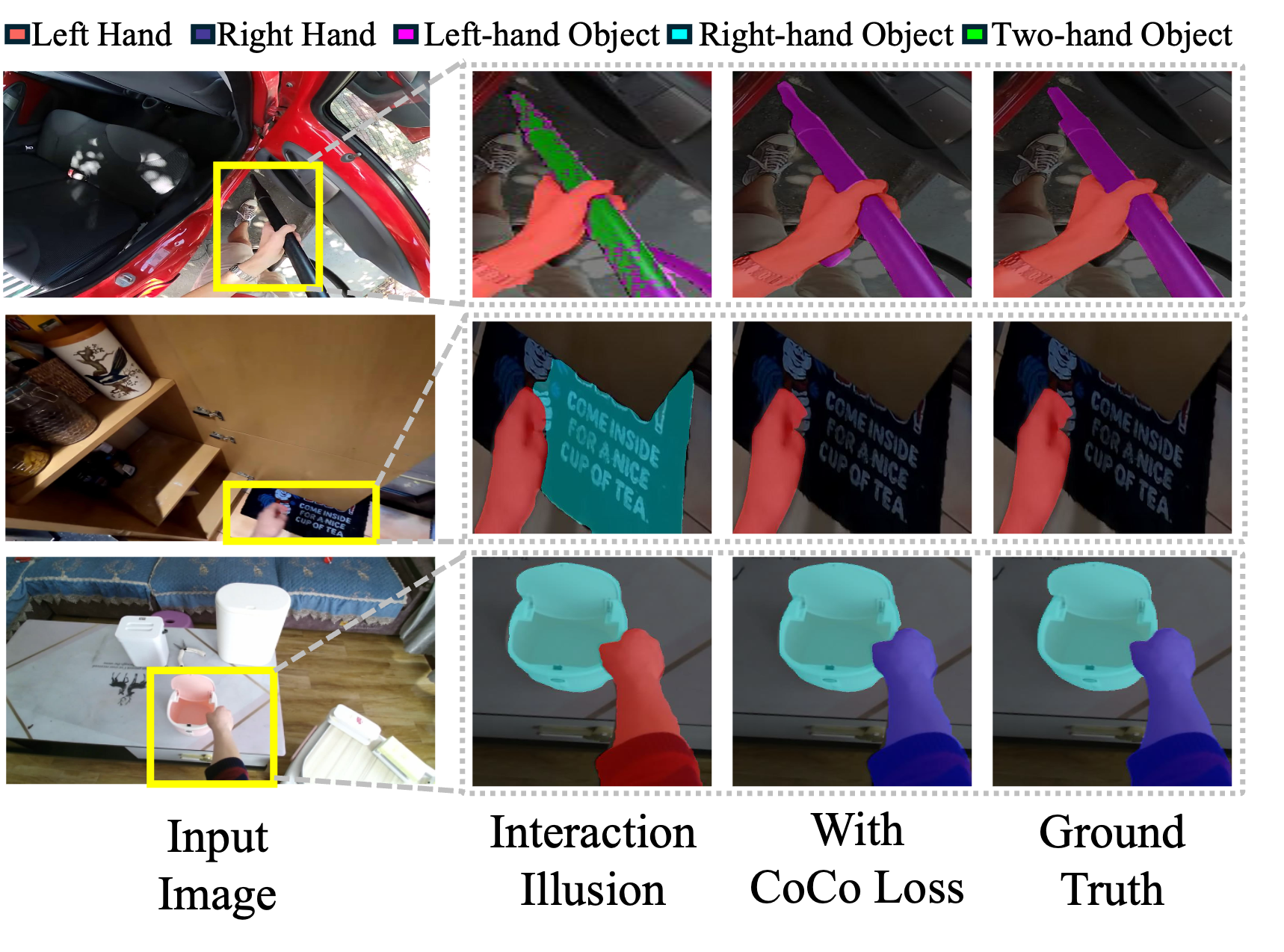

问题定义:论文旨在解决自中心视角下手和活动对象的精确解析问题。现有基于Transformer的方法在处理不同场景下的活动对象时,查询初始化缺乏适应性,容易引入与交互无关的像素级语义特征,并且容易产生物理上不一致的预测结果,即“交互错觉”。

核心思路:论文的核心思路是通过显式地建模手和物体之间的交互关系来提升解析的准确性和物理一致性。具体来说,利用手-物接触的空间动态信息来指导查询初始化,融合粗略的交互线索和语义特征来抑制噪声,并引入手-物关系约束来增强预测的物理合理性。

技术框架:InterFormer的整体架构是一个基于Transformer的端到端网络,包含三个主要模块:动态查询生成器(DQG)、双上下文特征选择器(DFS)和条件共现(CoCo)损失。DQG负责生成交互感知的查询,DFS负责选择与交互相关的特征,CoCo损失负责约束预测结果的物理一致性。整个流程是:输入图像经过特征提取后,DQG生成初始查询,然后通过Transformer进行迭代优化,DFS选择相关特征,最后通过CoCo损失进行约束,得到最终的解析结果。

关键创新:论文的关键创新在于三个方面:1) 提出了动态查询生成器(DQG),能够根据手-物接触的空间动态信息生成交互感知的查询,从而更好地适应不同的场景和活动对象;2) 提出了双上下文特征选择器(DFS),能够融合粗略的交互线索和语义特征,从而抑制噪声并强调交互关系的学习;3) 提出了条件共现(CoCo)损失,能够结合手-物关系约束,从而增强预测的物理一致性。

关键设计:DQG利用手部和物体的位置信息来生成初始查询,具体实现方式未知。DFS通过注意力机制融合粗略交互线索和语义特征,注意力权重计算方式未知。CoCo损失基于手和物体之间的共现关系进行设计,具体形式未知。Transformer的具体结构和参数设置未知。

🖼️ 关键图片

📊 实验亮点

InterFormer在EgoHOS数据集和具有挑战性的out-of-distribution mini-HOI4D数据集上均取得了state-of-the-art的性能。具体提升幅度未知,但结果表明InterFormer具有良好的泛化能力,能够有效处理不同场景下的手-物解析任务。代码和模型已公开。

🎯 应用场景

该研究成果可应用于下一代具身智能体的开发,例如机器人助手、虚拟现实/增强现实应用等。通过精确理解自中心视角下的手-物交互,可以使智能体更好地感知环境、理解人类意图,并进行更自然、更有效的交互。例如,机器人可以根据手的动作和物体状态来判断人类是否需要帮助,并提供相应的支持。

📄 摘要(原文)

A fine-grained understanding of egocentric human-environment interactions is crucial for developing next-generation embodied agents. One fundamental challenge in this area involves accurately parsing hands and active objects. While transformer-based architectures have demonstrated considerable potential for such tasks, several key limitations remain unaddressed: 1) existing query initialization mechanisms rely primarily on semantic cues or learnable parameters, demonstrating limited adaptability to changing active objects across varying input scenes; 2) previous transformer-based methods utilize pixel-level semantic features to iteratively refine queries during mask generation, which may introduce interaction-irrelevant content into the final embeddings; and 3) prevailing models are susceptible to "interaction illusion", producing physically inconsistent predictions. To address these issues, we propose an end-to-end Interaction-aware Transformer (InterFormer), which integrates three key components, i.e., a Dynamic Query Generator (DQG), a Dual-context Feature Selector (DFS), and the Conditional Co-occurrence (CoCo) loss. The DQG explicitly grounds query initialization in the spatial dynamics of hand-object contact, enabling targeted generation of interaction-aware queries for hands and various active objects. The DFS fuses coarse interactive cues with semantic features, thereby suppressing interaction-irrelevant noise and emphasizing the learning of interactive relationships. The CoCo loss incorporates hand-object relationship constraints to enhance physical consistency in prediction. Our model achieves state-of-the-art performance on both the EgoHOS and the challenging out-of-distribution mini-HOI4D datasets, demonstrating its effectiveness and strong generalization ability. Code and models are publicly available at https://github.com/yuggiehk/InterFormer.