Long-Term Multi-Session 3D Reconstruction Under Substantial Appearance Change

作者: Beverley Gorry, Tobias Fischer, Michael Milford, Alejandro Fontan

分类: cs.CV, cs.RO

发布日期: 2026-02-24

💡 一句话要点

提出联合SfM重建方法,解决长期外观变化下的三维重建问题

🎯 匹配领域: 支柱六:视频提取与匹配 (Video Extraction)

关键词: 三维重建 长期监测 运动结构恢复 视觉位置识别 跨会话对齐

📋 核心要点

- 现有SfM方法难以应对长期监测中因外观变化导致的三维重建和对齐问题。

- 提出联合SfM重建方法,直接在重建过程中强制执行跨会话的对应关系。

- 结合手工和学习特征,并在珊瑚礁数据集上验证了方法的有效性,优于现有方法。

📝 摘要(中文)

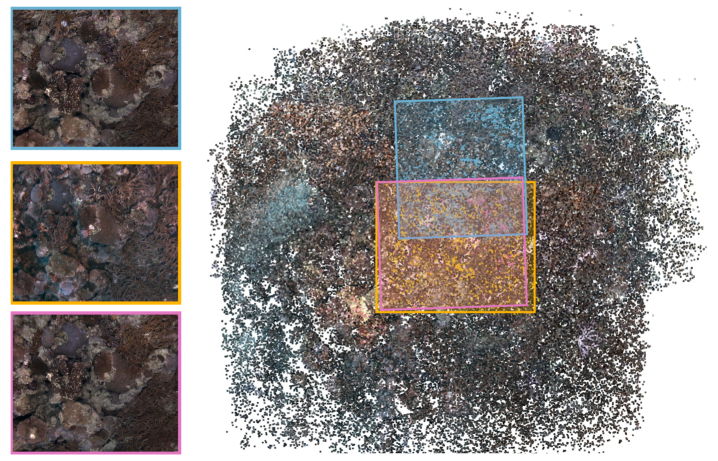

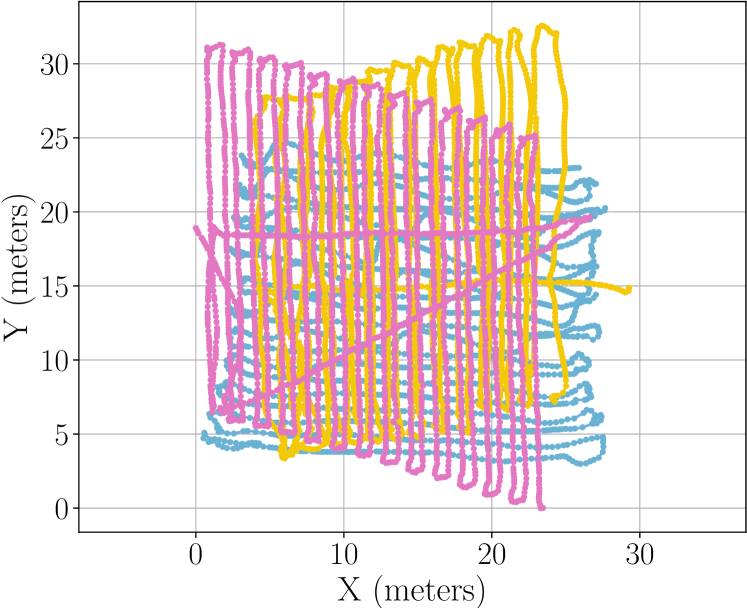

长期环境监测需要在多次现场考察中重建和对齐3D模型,这些考察可能间隔数月甚至数年。然而,现有的基于运动的结构(SfM)流程隐式地假设近乎同步的图像捕获和有限的外观变化,因此在长期监测场景中失效,例如珊瑚礁调查,其中视觉和结构变化很常见。本文表明,当前方法的主要限制在于它们依赖于独立重建会话的事后对齐,这在大的时间外观变化下是不够的。我们通过在联合SfM重建中直接强制执行跨会话对应关系来解决此限制。我们的方法结合了互补的手工和学习的视觉特征,以稳健地建立跨大时间间隔的对应关系,从而能够从相隔数年捕获的图像重建单个连贯的3D模型,而标准的独立和联合SfM流程会失效。我们在展示显著真实世界变化的长期珊瑚礁数据集上评估了我们的方法,并证明了在现有方法无法产生连贯重建的情况下,跨会话的一致联合重建。为了确保可扩展到大型数据集,我们进一步将昂贵的学习特征匹配限制为通过视觉位置识别识别的一小部分可能的跨会话图像对,这降低了计算成本并提高了对齐鲁棒性。

🔬 方法详解

问题定义:论文旨在解决长期环境监测中,由于时间间隔长、外观变化大,导致传统SfM方法无法有效重建和对齐三维模型的问题。现有方法依赖于独立重建后的对齐,在外观变化剧烈的情况下容易失效,无法生成连贯的3D模型。

核心思路:论文的核心思路是在SfM重建过程中,直接建立并强制执行跨会话的图像对应关系,从而避免独立重建带来的误差累积。通过联合优化,将不同时间段的图像数据整合到同一个三维模型中。

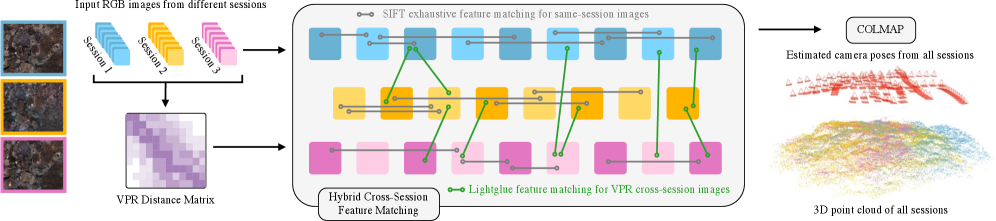

技术框架:该方法首先利用视觉位置识别(Visual Place Recognition, VPR)技术筛选出可能存在跨会话对应关系的图像对。然后,提取手工特征(如SIFT)和学习特征(未知具体网络结构,但强调了学习特征的重要性),用于建立图像间的对应关系。最后,将这些对应关系作为约束,在联合SfM框架中进行优化,得到最终的三维模型。

关键创新:该方法最重要的创新在于将跨会话的对应关系直接融入到SfM重建过程中,避免了传统方法的事后对齐。同时,结合手工特征和学习特征,提高了对应关系建立的鲁棒性。利用VPR技术减少了特征匹配的计算量,提高了算法的可扩展性。

关键设计:论文中提到使用了手工特征和学习特征,但没有详细说明具体使用的特征类型和网络结构。VPR模块的具体实现方式也未详细描述。损失函数的设计细节未知,但可以推测其目标是最小化重建误差和跨会话对应关系的误差。

🖼️ 关键图片

📊 实验亮点

论文在长期珊瑚礁数据集上进行了实验,结果表明,该方法能够成功重建跨越数年的三维模型,而传统的独立和联合SfM方法均失效。通过结合手工特征和学习特征,该方法能够更鲁棒地建立跨会话的对应关系。此外,利用VPR技术显著降低了计算成本,提高了算法的可扩展性。

🎯 应用场景

该研究成果可应用于长期环境监测、灾后重建、城市建模等领域。例如,可以用于监测珊瑚礁的生长变化、评估建筑物在地震后的损毁情况、以及构建随时间变化的城市三维模型。该方法能够有效处理外观变化带来的挑战,为相关领域提供更准确、更可靠的三维重建结果。

📄 摘要(原文)

Long-term environmental monitoring requires the ability to reconstruct and align 3D models across repeated site visits separated by months or years. However, existing Structure-from-Motion (SfM) pipelines implicitly assume near-simultaneous image capture and limited appearance change, and therefore fail when applied to long-term monitoring scenarios such as coral reef surveys, where substantial visual and structural change is common. In this paper, we show that the primary limitation of current approaches lies in their reliance on post-hoc alignment of independently reconstructed sessions, which is insufficient under large temporal appearance change. We address this limitation by enforcing cross-session correspondences directly within a joint SfM reconstruction. Our approach combines complementary handcrafted and learned visual features to robustly establish correspondences across large temporal gaps, enabling the reconstruction of a single coherent 3D model from imagery captured years apart, where standard independent and joint SfM pipelines break down. We evaluate our method on long-term coral reef datasets exhibiting significant real-world change, and demonstrate consistent joint reconstruction across sessions in cases where existing methods fail to produce coherent reconstructions. To ensure scalability to large datasets, we further restrict expensive learned feature matching to a small set of likely cross-session image pairs identified via visual place recognition, which reduces computational cost and improves alignment robustness.