WildGHand: Learning Anti-Perturbation Gaussian Hand Avatars from Monocular In-the-Wild Videos

作者: Hanhui Li, Xuan Huang, Wanquan Liu, Yuhao Cheng, Long Chen, Yiqiang Yan, Xiaodan Liang, Chenqiang Gao

分类: cs.CV

发布日期: 2026-02-24

🔗 代码/项目: GITHUB

💡 一句话要点

WildGHand:学习抗扰动高斯手部Avatar,从单目野外视频中重建

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics) 支柱六:视频提取与匹配 (Video Extraction)

关键词: 3D手部重建 高斯Splatting 单目视频 野外环境 扰动解耦 Avatar生成 计算机视觉

📋 核心要点

- 现有单目视频3D手部重建方法在受控环境中表现良好,但在野外环境中,由于手部与物体交互、极端姿势、光照变化和运动模糊等扰动,性能会显著下降。

- WildGHand通过动态扰动解耦和扰动感知优化,在优化过程中显式地建模和抑制扰动,从而实现对野外视频的鲁棒手部Avatar重建。

- 在自建数据集和公开数据集上的实验表明,WildGHand在PSNR和LPIPS等指标上显著优于现有方法,证明了其在野外环境下的有效性。

📝 摘要(中文)

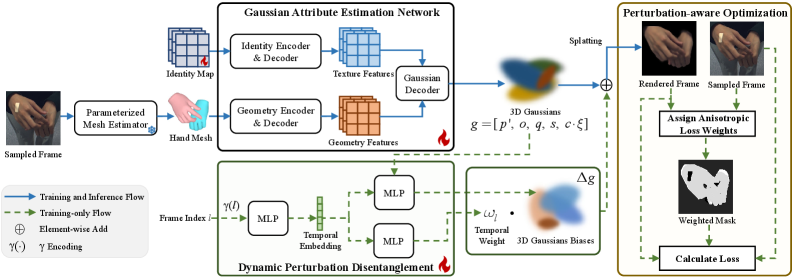

本文提出WildGHand,一个基于优化的框架,用于从野外视频中实现自适应3D高斯splatting,并生成高保真手部Avatar。WildGHand包含两个关键组件:(i) 动态扰动解耦模块,在优化过程中将扰动显式地表示为3D高斯属性上的时变偏差;(ii) 扰动感知优化策略,生成逐帧异性加权掩码来指导优化。这些组件共同作用,使得框架能够识别和抑制空间和时间维度上的扰动。此外,我们还整理了一个在各种扰动下捕获的单目手部视频数据集,用于评估野外手部Avatar重建。大量实验表明,WildGHand实现了最先进的性能,并在多个指标上显著优于其基线模型(例如,PSNR相对提升高达15.8%,LPIPS相对降低高达23.1%)。

🔬 方法详解

问题定义:现有基于单目视频的3D手部重建方法在真实场景中面临诸多挑战,例如手部与物体的交互、极端姿势、光照变化以及运动模糊等。这些扰动会导致重建精度大幅下降,难以生成高质量的手部Avatar。现有方法通常依赖于在受控环境下采集的数据进行训练,泛化能力较差。

核心思路:WildGHand的核心思路是将扰动显式地建模为3D高斯属性上的时变偏差,并在优化过程中自适应地抑制这些扰动。通过动态扰动解耦模块和扰动感知优化策略,框架能够识别并消除空间和时间维度上的扰动,从而实现对野外视频的鲁棒重建。这种显式建模扰动的方式,使得模型能够更好地适应真实场景中的复杂变化。

技术框架:WildGHand的整体框架包含两个主要模块:动态扰动解耦模块和扰动感知优化策略。首先,动态扰动解耦模块将扰动表示为3D高斯属性上的时变偏差,这些偏差在优化过程中被动态地调整。其次,扰动感知优化策略生成逐帧异性加权掩码,用于指导优化过程,抑制受扰动区域的影响。这两个模块协同工作,使得框架能够有效地处理野外视频中的各种扰动。

关键创新:WildGHand的关键创新在于其动态扰动解耦模块和扰动感知优化策略。动态扰动解耦模块能够显式地建模和分离扰动,而扰动感知优化策略能够自适应地调整优化过程,从而抑制扰动的影响。与现有方法相比,WildGHand能够更好地处理真实场景中的复杂扰动,实现更鲁棒的重建效果。

关键设计:动态扰动解耦模块通过在3D高斯属性上添加时变偏差来实现扰动建模。扰动感知优化策略通过生成逐帧异性加权掩码来指导优化,掩码的权重根据像素的扰动程度进行调整。损失函数的设计也考虑了扰动的影响,例如,对受扰动区域的损失进行降权处理。具体的网络结构和参数设置在论文中有详细描述。

🖼️ 关键图片

📊 实验亮点

WildGHand在自建的野外手部视频数据集和两个公开数据集上进行了广泛的实验。实验结果表明,WildGHand在多个指标上显著优于现有方法。例如,在自建数据集上,WildGHand的PSNR相对提升高达15.8%,LPIPS相对降低高达23.1%。这些结果证明了WildGHand在野外环境下的有效性和鲁棒性。

🎯 应用场景

WildGHand在虚拟现实、增强现实、人机交互等领域具有广泛的应用前景。它可以用于创建逼真的手部Avatar,提升用户在虚拟环境中的沉浸感和交互体验。此外,WildGHand还可以应用于手势识别、动作捕捉等任务,为这些任务提供更准确、更鲁棒的输入数据。未来,该技术有望在医疗、教育、娱乐等领域发挥重要作用。

📄 摘要(原文)

Despite recent progress in 3D hand reconstruction from monocular videos, most existing methods rely on data captured in well-controlled environments and therefore degrade in real-world settings with severe perturbations, such as hand-object interactions, extreme poses, illumination changes, and motion blur. To tackle these issues, we introduce WildGHand, an optimization-based framework that enables self-adaptive 3D Gaussian splatting on in-the-wild videos and produces high-fidelity hand avatars. WildGHand incorporates two key components: (i) a dynamic perturbation disentanglement module that explicitly represents perturbations as time-varying biases on 3D Gaussian attributes during optimization, and (ii) a perturbation-aware optimization strategy that generates per-frame anisotropic weighted masks to guide optimization. Together, these components allow the framework to identify and suppress perturbations across both spatial and temporal dimensions. We further curate a dataset of monocular hand videos captured under diverse perturbations to benchmark in-the-wild hand avatar reconstruction. Extensive experiments on this dataset and two public datasets demonstrate that WildGHand achieves state-of-the-art performance and substantially improves over its base model across multiple metrics (e.g., up to a $15.8\%$ relative gain in PSNR and a $23.1\%$ relative reduction in LPIPS). Our implementation and dataset are available at https://github.com/XuanHuang0/WildGHand.