Do Large Language Models Understand Data Visualization Principles?

作者: Martin Sinnona, Valentin Bonas, Viviana Siless, Emmanuel Iarussi

分类: cs.CV

发布日期: 2026-02-23

💡 一句话要点

评估大型语言模型理解数据可视化原则的能力,并探索其在图表验证与修复中的应用。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 数据可视化 大型语言模型 视觉-语言模型 图表验证 图表修复 可视化原则 自动化评估

📋 核心要点

- 现有方法依赖专家知识将可视化原则转化为形式化规范,过程繁琐且成本高昂,缺乏通用性和可扩展性。

- 利用大型语言模型(LLM)和视觉-语言模型(VLM)直接推理视觉设计,无需显式规则,简化了验证和修复流程。

- 通过受控数据集和真实图表,系统评估了LLM和VLM在检测和纠正可视化原则违规方面的能力,揭示了模型的优势和局限。

📝 摘要(中文)

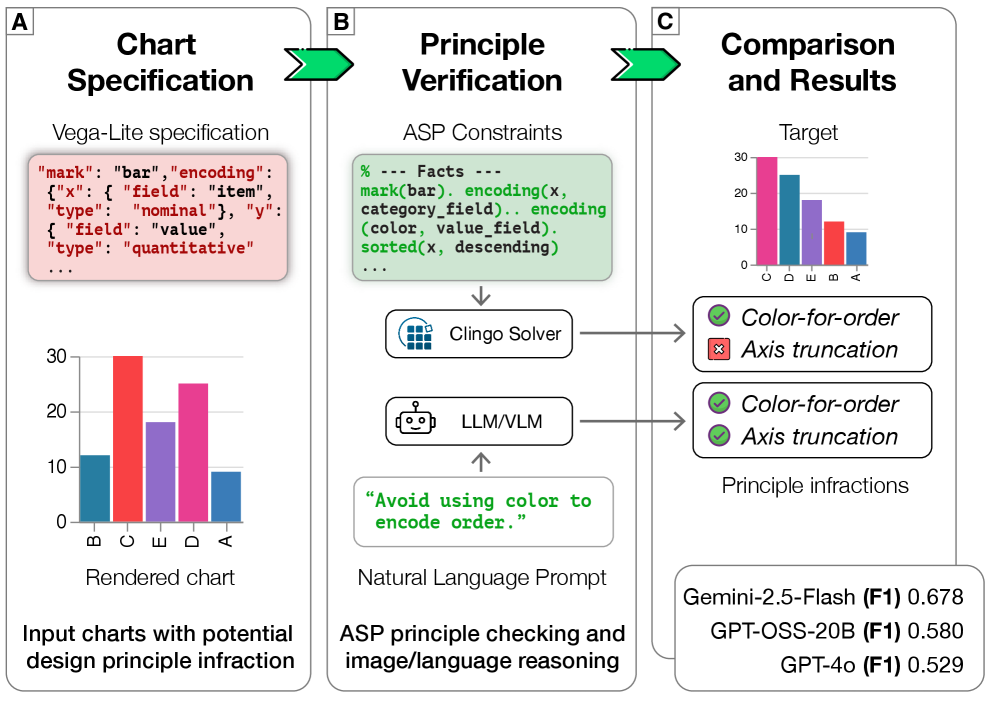

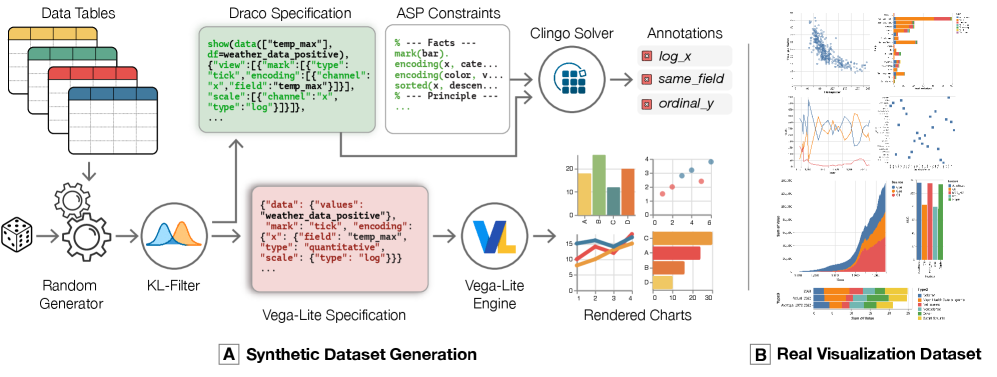

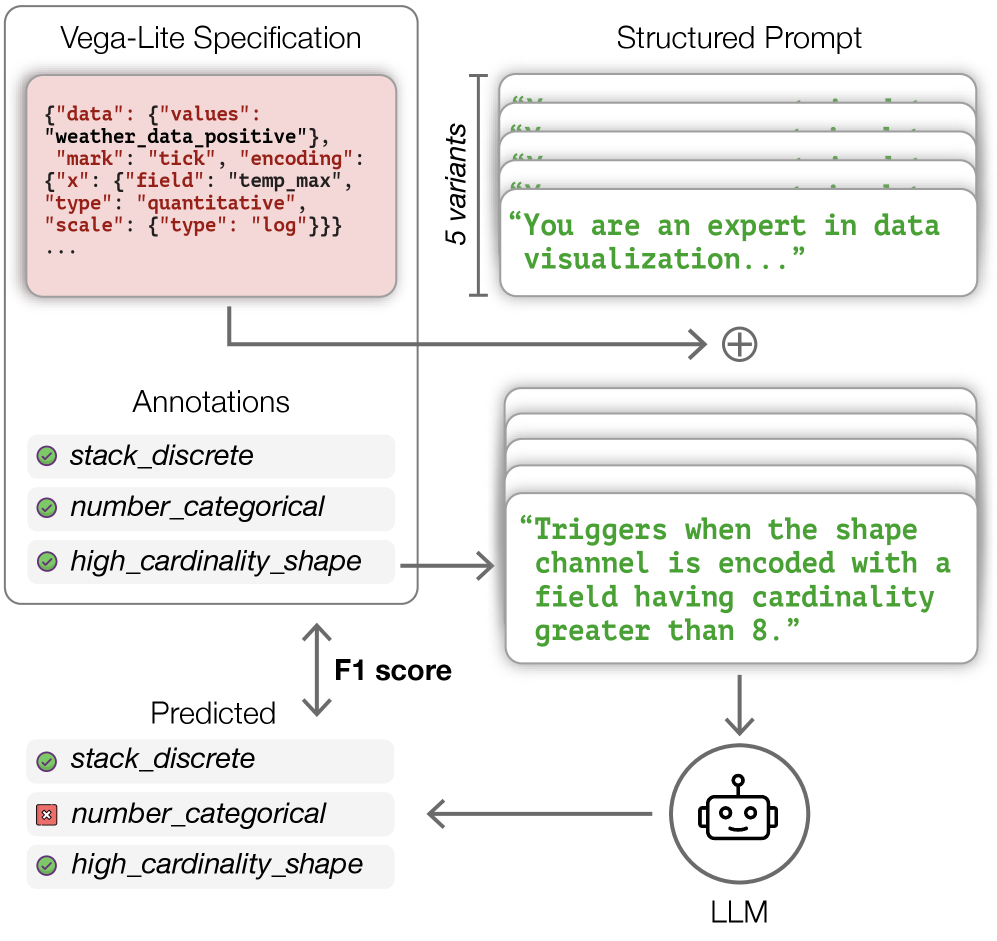

数据可视化原则源于数十年的设计和感知研究,旨在确保有效的视觉交流。虽然先前的工作表明大型语言模型(LLM)可以生成图表或标记误导性图形,但它们及其视觉-语言对应模型(VLM)是否能够直接推理和执行可视化原则仍不清楚。基于约束的系统将这些原则编码为逻辑规则以进行精确的自动检查,但将它们转化为正式规范需要专家知识。这促使我们利用LLM和VLM作为原则检查器,可以直接推理视觉设计,从而绕过符号规则规范的需要。在本文中,我们首次系统地评估了LLM和VLM在推理可视化原则方面的能力,使用来自答案集编程(ASP)的硬验证真值。我们编制了一套以自然语言陈述表达的可视化原则,并生成了一个包含约2,000个Vega-Lite规范的受控数据集,这些规范标有明确的原则违规,并辅以300多个真实世界的Vega-Lite图表。我们评估了检查和修复任务,评估了模型检测原则违规和纠正有缺陷的图表规范的能力。我们的工作突出了大型(视觉)语言模型作为可视化设计的灵活验证器和编辑器的前景,以及在视觉感知的更细微方面与符号求解器的持续差距。他们还揭示了一个有趣的非对称性:前沿模型在纠正违规行为方面往往比可靠地检测它们更有效。

🔬 方法详解

问题定义:论文旨在评估大型语言模型(LLM)和视觉-语言模型(VLM)是否能够理解并应用数据可视化原则。现有方法通常依赖于基于约束的系统,需要将可视化原则编码为逻辑规则,这需要专家知识且难以扩展。因此,如何让模型直接理解和应用可视化原则,避免人工规则定义,是本文要解决的核心问题。

核心思路:论文的核心思路是利用LLM和VLM的自然语言理解和视觉推理能力,直接对图表设计进行评估和修改。通过将可视化原则以自然语言的形式输入模型,让模型判断图表是否违反了这些原则,并进行相应的修复。这种方法避免了人工定义规则的复杂性,提高了模型的通用性和灵活性。

技术框架:论文构建了一个包含以下几个关键部分的评估框架:1) 可视化原则库:收集了一系列以自然语言描述的可视化原则。2) 数据集生成:生成包含违反和未违反可视化原则的Vega-Lite图表规范的受控数据集,并辅以真实世界的Vega-Lite图表。3) 模型评估:使用LLM和VLM对图表进行原则违规检测和修复任务的评估。4) 性能分析:分析模型的检测和修复性能,并与基于符号求解器的方法进行比较。

关键创新:该论文的关键创新在于:1) 首次系统性地评估了LLM和VLM在理解和应用数据可视化原则方面的能力。2) 提出了利用LLM和VLM直接进行图表验证和修复的方法,无需人工定义规则。3) 构建了一个包含受控数据集和真实图表的综合评估框架。

关键设计:论文的关键设计包括:1) 受控数据集的生成:通过系统性地修改Vega-Lite规范,生成包含不同类型原则违规的图表,确保数据集的多样性和可控性。2) 评估指标的选择:使用准确率、召回率等指标评估模型在检测和修复任务中的性能。3) 模型选择:选择了具有代表性的LLM和VLM进行评估,例如GPT系列模型和视觉语言模型。4) 提示工程:设计合适的提示语,引导模型进行原则违规检测和修复。

🖼️ 关键图片

📊 实验亮点

实验结果表明,大型语言模型在数据可视化原则的理解和应用方面具有潜力,但在检测细微的违规行为方面仍存在差距。值得注意的是,前沿模型在纠正违规行为方面表现优于检测,这表明模型可能更擅长理解原则的应用,而非识别原则的缺失。该研究还揭示了LLM和VLM与符号求解器在可视化推理方面的差异。

🎯 应用场景

该研究成果可应用于自动化图表生成、数据可视化质量评估、可视化教学等领域。通过利用LLM和VLM,可以帮助非专业人士创建更有效、更易于理解的数据可视化作品,提高数据交流的效率和准确性。未来,该技术有望集成到各种数据分析和可视化工具中,赋能更广泛的用户。

📄 摘要(原文)

Data visualization principles, derived from decades of research in design and perception, ensure proper visual communication. While prior work has shown that large language models (LLMs) can generate charts or flag misleading figures, it remains unclear whether they and their vision-language counterparts (VLMs) can reason about and enforce visualization principles directly. Constraint based systems encode these principles as logical rules for precise automated checks, but translating them into formal specifications demands expert knowledge. This motivates leveraging LLMs and VLMs as principle checkers that can reason about visual design directly, bypassing the need for symbolic rule specification. In this paper, we present the first systematic evaluation of both LLMs and VLMs on their ability to reason about visualization principles, using hard verification ground truth derived from Answer Set Programming (ASP). We compiled a set of visualization principles expressed as natural-language statements and generated a controlled dataset of approximately 2,000 Vega-Lite specifications annotated with explicit principle violations, complemented by over 300 real-world Vega-Lite charts. We evaluated both checking and fixing tasks, assessing how well models detect principle violations and correct flawed chart specifications. Our work highlights both the promise of large (vision-)language models as flexible validators and editors of visualization designs and the persistent gap with symbolic solvers on more nuanced aspects of visual perception. They also reveal an interesting asymmetry: frontier models tend to be more effective at correcting violations than at detecting them reliably.