SemanticNVS: Improving Semantic Scene Understanding in Generative Novel View Synthesis

作者: Xinya Chen, Christopher Wewer, Jiahao Xie, Xinting Hu, Jan Eric Lenssen

分类: cs.CV

发布日期: 2026-02-23

💡 一句话要点

SemanticNVS:通过语义信息增强生成式新视角合成的场景理解

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 新视角合成 语义理解 扩散模型 多视角学习 场景重建

📋 核心要点

- 现有NVS方法在长距离相机运动下生成图像质量退化,未能充分理解场景语义信息。

- SemanticNVS通过集成预训练语义特征提取器,将更强的场景语义作为条件,提升生成质量。

- 实验结果表明,SemanticNVS在多个数据集上显著优于现有方法,FID指标提升4.69%-15.26%。

📝 摘要(中文)

本文提出了SemanticNVS,一种相机条件的多视角扩散模型,用于新视角合成(NVS)。该模型通过集成预训练的语义特征提取器,提高了生成质量和一致性。现有的NVS方法在靠近输入视角的视角下表现良好,但在长距离相机运动下,容易生成语义上不合理和扭曲的图像,表现出严重的退化。我们推测这种退化是由于当前模型未能充分理解其条件或中间生成的场景内容。因此,我们提出集成预训练的语义特征提取器,以结合更强的场景语义作为条件,从而即使在遥远视点也能实现高质量生成。我们研究了两种不同的策略:(1)扭曲的语义特征和(2)在每个去噪步骤中理解和生成的交替方案。在多个数据集上的实验结果表明,与最先进的替代方案相比,在FID指标上取得了明显的定性和定量(4.69%-15.26%)改进。

🔬 方法详解

问题定义:论文旨在解决新视角合成(NVS)中,当相机视角与输入视角相差较远时,生成图像质量下降,出现语义不合理和图像扭曲的问题。现有方法未能充分理解场景的语义信息,导致生成图像的连贯性和真实性不足。

核心思路:论文的核心思路是将预训练的语义特征提取器集成到NVS模型中,从而为模型提供更强的场景语义信息。通过将语义信息作为条件,模型能够更好地理解场景内容,从而生成更合理、更真实的图像,即使在遥远的视角下也能保持高质量。

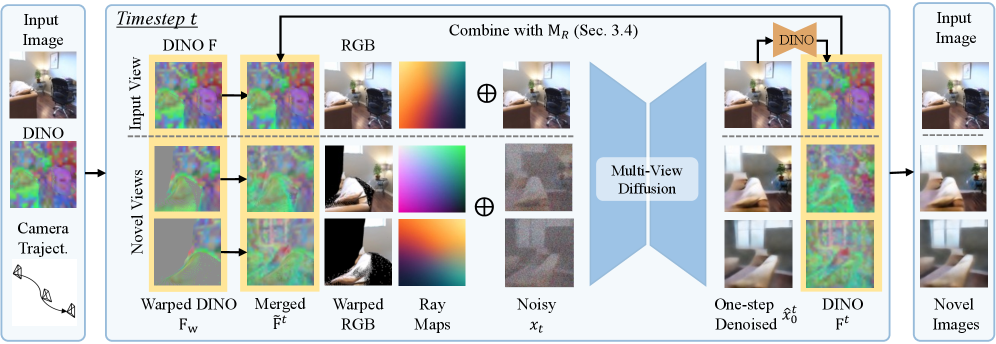

技术框架:SemanticNVS采用相机条件的多视角扩散模型作为基础框架。主要包含以下模块:1) 图像编码器:将输入图像编码为潜在特征;2) 语义特征提取器:利用预训练模型提取输入图像的语义特征;3) 扩散模型:基于图像编码和语义特征,逐步去噪生成新视角的图像。论文探索了两种集成语义特征的策略:(1) 扭曲语义特征,将语义特征扭曲到目标视角;(2) 交替理解和生成,在每个去噪步骤中交替进行语义理解和图像生成。

关键创新:论文的关键创新在于将预训练的语义特征提取器与NVS模型相结合,从而显著提升了生成图像的语义一致性和视觉质量。与现有方法相比,SemanticNVS能够更好地理解场景内容,并生成更合理、更真实的图像,尤其是在长距离相机运动的情况下。

关键设计:在扭曲语义特征策略中,使用可微的单应变换将语义特征扭曲到目标视角。在交替理解和生成策略中,在每个去噪步骤中,首先利用语义特征提取器对当前生成的图像进行语义理解,然后基于语义信息进行图像生成。损失函数包括重建损失、对抗损失和语义一致性损失,以保证生成图像的质量和语义合理性。

🖼️ 关键图片

📊 实验亮点

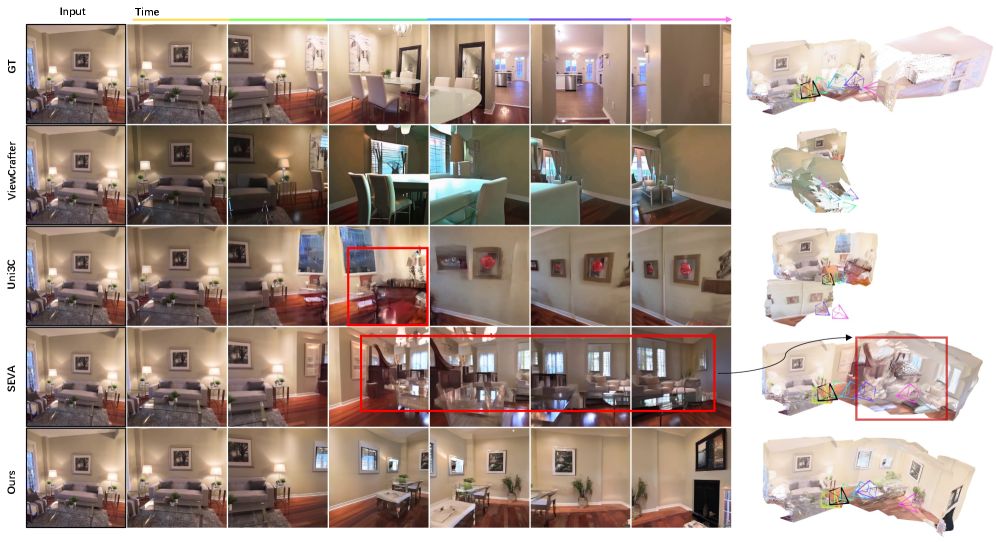

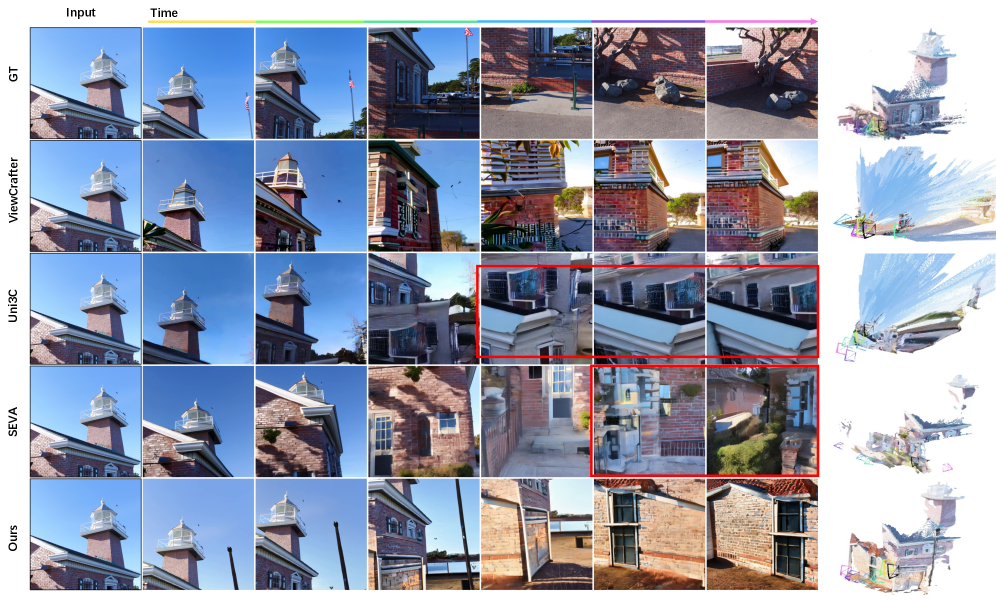

实验结果表明,SemanticNVS在多个数据集上显著优于现有方法。例如,在合成数据集上,SemanticNVS在FID指标上取得了4.69%-15.26%的提升。定性结果也表明,SemanticNVS能够生成更合理、更真实的图像,尤其是在长距离相机运动的情况下,显著减少了语义不一致和图像扭曲的现象。

🎯 应用场景

SemanticNVS具有广泛的应用前景,包括虚拟现实、增强现实、机器人导航、自动驾驶等领域。该技术可以用于生成任意视角的场景图像,从而为用户提供更沉浸式的体验,帮助机器人更好地理解周围环境,并提高自动驾驶系统的安全性。

📄 摘要(原文)

We present SemanticNVS, a camera-conditioned multi-view diffusion model for novel view synthesis (NVS), which improves generation quality and consistency by integrating pre-trained semantic feature extractors. Existing NVS methods perform well for views near the input view, however, they tend to generate semantically implausible and distorted images under long-range camera motion, revealing severe degradation. We speculate that this degradation is due to current models failing to fully understand their conditioning or intermediate generated scene content. Here, we propose to integrate pre-trained semantic feature extractors to incorporate stronger scene semantics as conditioning to achieve high-quality generation even at distant viewpoints. We investigate two different strategies, (1) warped semantic features and (2) an alternating scheme of understanding and generation at each denoising step. Experimental results on multiple datasets demonstrate the clear qualitative and quantitative (4.69%-15.26% in FID) improvement over state-of-the-art alternatives.