Brewing Stronger Features: Dual-Teacher Distillation for Multispectral Earth Observation

作者: Filip Wolf, Blaž Rolih, Luka Čehovin Zajc

分类: cs.CV

发布日期: 2026-02-23

备注: Accepted to CVPR 2026

💡 一句话要点

提出双教师蒸馏框架,提升多光谱遥感图像特征表达能力

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多光谱遥感 知识蒸馏 对比学习 跨模态学习 特征表示

📋 核心要点

- 现有遥感预训练方法侧重局部重建,缺乏对全局语义结构的有效控制,限制了跨模态知识迁移。

- 提出双教师对比蒸馏框架,利用多光谱教师和光学VFM教师,实现跨模态表征对齐和知识迁移。

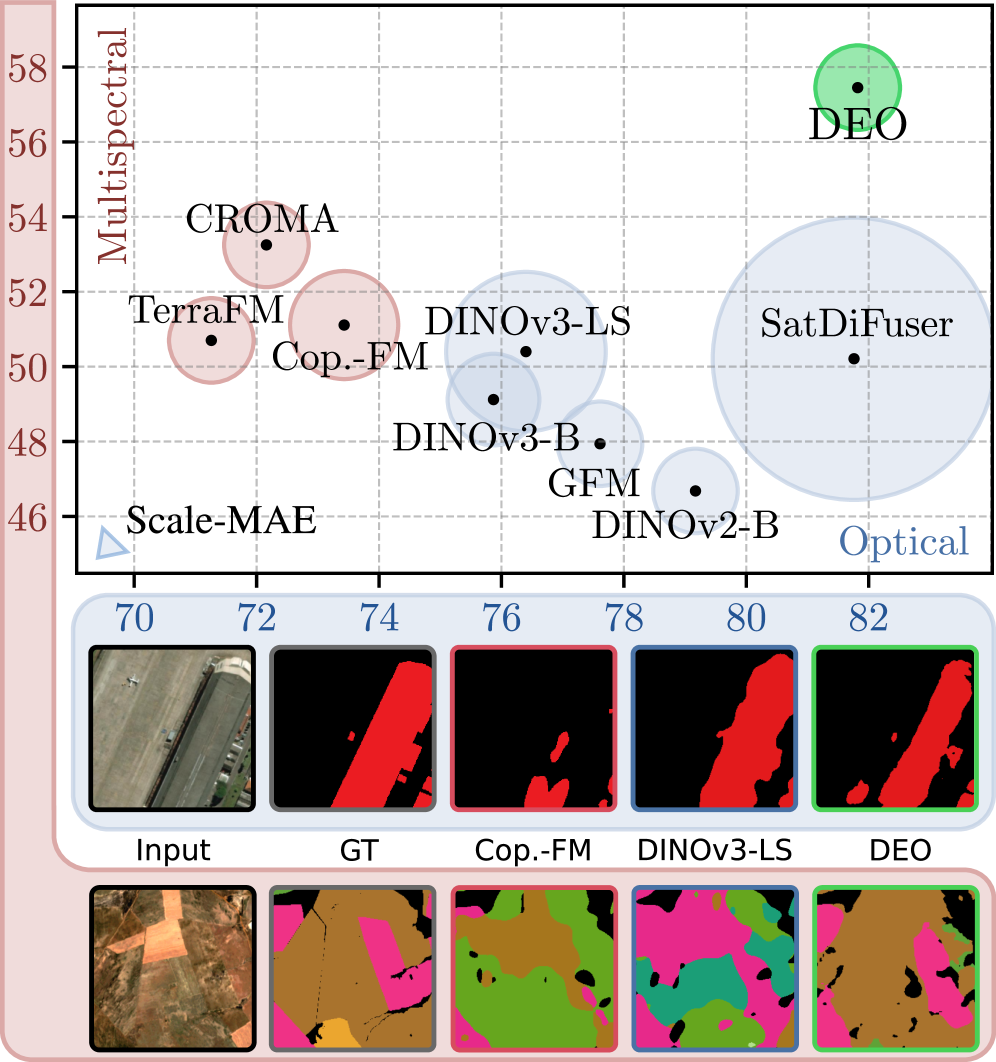

- 实验结果表明,该模型在光学和多光谱任务上均达到SOTA,验证了对比蒸馏的有效性和高效性。

📝 摘要(中文)

当前遥感领域的基础模型正在变革,但由于传感器和模态的多样性,构建单一通用模型并不现实。多种专业遥感基础模型(EOFMs)将可能共存,因此跨模态的知识高效迁移至关重要。现有遥感预训练主要依赖掩码图像建模,侧重局部重建,对全局语义结构的控制有限。为解决此问题,我们提出了一种用于多光谱图像的双教师对比蒸馏框架,使学生的预训练目标与现代光学视觉基础模型(VFMs)的对比自蒸馏范式对齐。我们的方法结合了多光谱教师和光学VFM教师,实现了连贯的跨模态表征学习。在各种光学和多光谱基准测试中,实验表明我们的模型能够适应多光谱数据,同时不影响光学输入的性能,在语义分割、变化检测和分类任务中分别平均提高了3.64、1.2和1.31个百分点,达到了最先进水平。这表明对比蒸馏为跨异构遥感数据源的可扩展表征学习提供了一种原则性和高效的方法。

🔬 方法详解

问题定义:论文旨在解决多光谱遥感图像特征表示学习问题。现有基于掩码图像建模的预训练方法虽然在局部重建方面表现良好,但缺乏对全局语义结构的有效控制,导致模型难以捕捉跨模态数据间的深层关联,限制了其在多光谱遥感领域的应用。

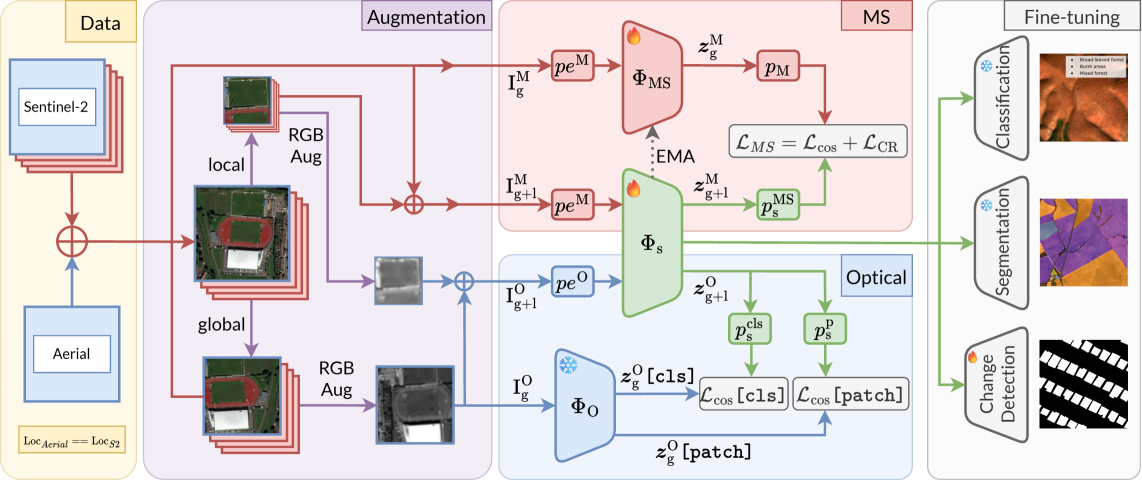

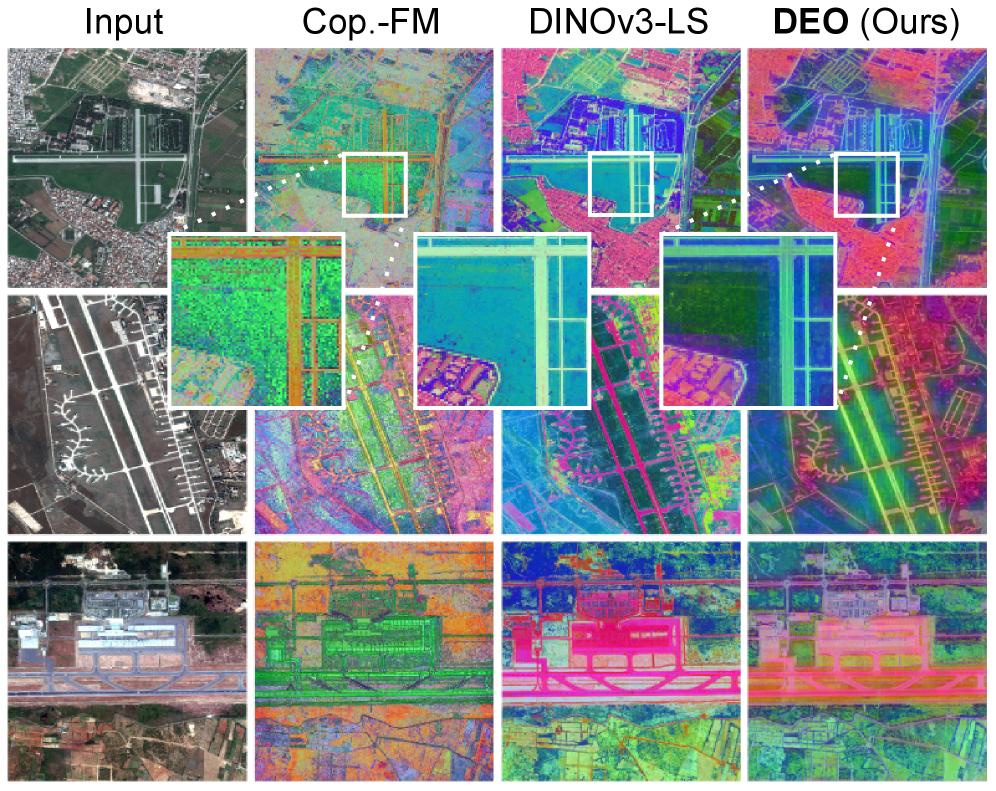

核心思路:论文的核心思路是利用对比学习和知识蒸馏,将光学视觉基础模型(VFM)的全局语义知识迁移到多光谱遥感图像模型中。通过对比学习,模型能够学习到更具区分性的特征表示,而知识蒸馏则能够将VFM的全局语义信息传递给多光谱模型,从而提升其性能。

技术框架:该方法采用双教师蒸馏框架。框架包含一个学生模型和两个教师模型:一个多光谱教师模型和一个光学VFM教师模型。学生模型接收多光谱图像作为输入,并学习预测图像的特征表示。两个教师模型分别对同一图像进行编码,生成各自的特征表示。学生模型的目标是最小化其特征表示与两个教师模型特征表示之间的差异。

关键创新:该方法最重要的创新点在于引入了双教师对比蒸馏框架,将光学VFM的知识迁移到多光谱遥感图像模型中。与传统的单教师蒸馏方法相比,双教师蒸馏能够更有效地利用不同模态的信息,从而提升模型的性能。此外,该方法还采用了对比学习,进一步增强了模型的特征表示能力。

关键设计:在具体实现上,论文采用了对比损失函数来衡量学生模型和教师模型特征表示之间的差异。此外,论文还对网络结构进行了优化,使其更适合处理多光谱遥感图像。具体的参数设置和网络结构细节在论文中进行了详细描述(具体数值未知)。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法在多个遥感图像分析任务中取得了显著的性能提升。在语义分割任务中,平均提升了3.64个百分点;在变化检测任务中,平均提升了1.2个百分点;在分类任务中,平均提升了1.31个百分点。这些结果表明,该方法能够有效地提升多光谱遥感图像的特征表达能力,并在实际应用中具有很大的潜力。

🎯 应用场景

该研究成果可广泛应用于遥感图像分析领域,例如土地覆盖分类、变化检测、农作物监测、自然灾害评估等。通过提升多光谱遥感图像的特征表达能力,可以提高这些应用场景的精度和效率,为相关决策提供更可靠的依据。未来,该方法有望推广到其他跨模态遥感数据处理任务中。

📄 摘要(原文)

Foundation models are transforming Earth Observation (EO), yet the diversity of EO sensors and modalities makes a single universal model unrealistic. Multiple specialized EO foundation models (EOFMs) will likely coexist, making efficient knowledge transfer across modalities essential. Most existing EO pretraining relies on masked image modeling, which emphasizes local reconstruction but provides limited control over global semantic structure. To address this, we propose a dual-teacher contrastive distillation framework for multispectral imagery that aligns the student's pretraining objective with the contrastive self-distillation paradigm of modern optical vision foundation models (VFMs). Our approach combines a multispectral teacher with an optical VFM teacher, enabling coherent cross-modal representation learning. Experiments across diverse optical and multispectral benchmarks show that our model adapts to multispectral data without compromising performance on optical-only inputs, achieving state-of-the-art results in both settings, with an average improvement of 3.64 percentage points in semantic segmentation, 1.2 in change detection, and 1.31 in classification tasks. This demonstrates that contrastive distillation provides a principled and efficient approach to scalable representation learning across heterogeneous EO data sources. Code: Coming soon.