Open-vocabulary 3D scene perception in industrial environments

作者: Keno Moenck, Adrian Philip Florea, Julian Koch, Thorsten Schüppstuhl

分类: cs.CV

发布日期: 2026-02-23

💡 一句话要点

提出一种免训练的开放词汇3D场景感知方法,用于工业环境

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 开放词汇3D感知 工业环境 免训练学习 超点分割 视觉-语言模型 领域自适应 机器人视觉

📋 核心要点

- 现有开放词汇方法依赖非工业数据集预训练的分割模型,在工业场景下泛化性差,难以满足需求。

- 提出一种免训练的3D感知流程,通过融合超点并利用语义特征生成掩码,无需预训练分割模型。

- 在工业车间场景中,结合领域自适应的VLFM,实验结果验证了该方法在工业对象分割上的有效性。

📝 摘要(中文)

本文针对生产、内部物流或制造环境中,超越固定类别集合的自主视觉应用需求,提出了一种免训练的开放词汇3D感知流程。现有方法依赖于在非工业数据集上预训练的类别无关分割模型,泛化能力差。本文方法通过融合预计算的超点(superpoint)并基于其语义特征生成掩码,避免了对预训练模型的依赖。该方法在代表性的3D工业车间场景中,使用领域自适应的VLFM“IndustrialCLIP”进行开放词汇查询,实验结果表明该方法能够成功分割工业对象。

🔬 方法详解

问题定义:论文旨在解决工业环境中开放词汇3D场景感知的问题。现有方法依赖于在通用数据集(如家庭场景)上预训练的2D视觉-语言基础模型(VLFMs)和类别无关的分割模型。这些模型在工业场景中表现不佳,无法有效分割常见的工业对象,限制了其在工业自动化中的应用。

核心思路:论文的核心思路是避免使用预训练的分割模型来生成实例提议(instance proposals)。相反,该方法直接基于预计算的超点(superpoints)进行操作,通过融合具有相似语义特征的超点来生成掩码。这种方法无需预训练,因此可以更好地适应工业环境的特定领域。

技术框架:该方法包含以下主要步骤:1) 预计算3D场景的超点。2) 提取每个超点的语义特征。3) 基于语义特征相似性融合超点,生成候选对象掩码。4) 使用领域自适应的视觉-语言基础模型(如IndustrialCLIP)对生成的掩码进行开放词汇查询,以识别和分割目标对象。

关键创新:该方法最重要的创新点在于其免训练的特性。通过直接操作超点并利用语义特征进行融合,避免了对大规模数据集进行预训练的需求,从而提高了模型在工业环境中的泛化能力。此外,结合领域自适应的VLFM,进一步提升了开放词汇查询的准确性。

关键设计:论文的关键设计包括:1) 超点的生成算法选择(具体算法未知)。2) 语义特征的提取方法(可能使用了点云处理技术或深度学习模型)。3) 超点融合的相似性度量标准(例如,余弦相似度)。4) IndustrialCLIP的训练或微调策略(未知)。这些细节决定了最终分割和识别的性能。

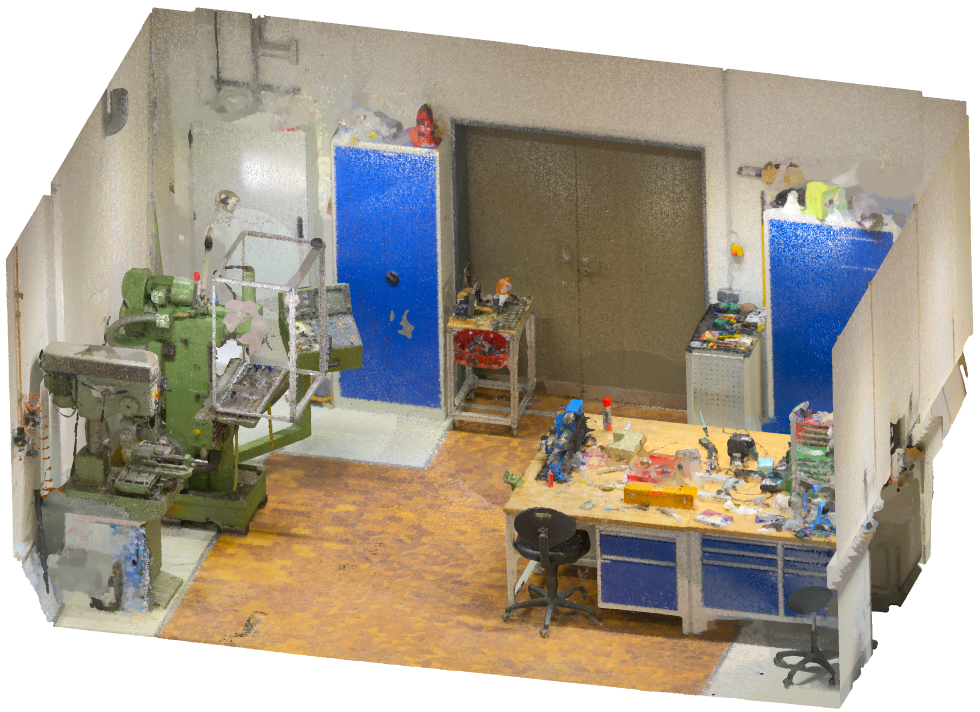

🖼️ 关键图片

📊 实验亮点

论文的主要亮点在于提出了一种免训练的开放词汇3D感知方法,避免了对预训练分割模型的依赖,从而提高了在工业环境中的泛化能力。虽然论文中没有给出具体的性能指标,但定性结果表明该方法能够成功分割工业车间场景中的各种对象,验证了其有效性。领域自适应的VLFM的使用也提升了识别的准确性。

🎯 应用场景

该研究成果可应用于工业自动化、智能制造、机器人操作等领域。例如,在生产线上,机器人可以利用该方法识别和抓取不同种类的零件,无需预先定义所有零件的类别。在内部物流中,可以用于自动识别和跟踪货物。该方法降低了对大量标注数据的依赖,加速了工业场景中3D视觉应用的部署。

📄 摘要(原文)

Autonomous vision applications in production, intralogistics, or manufacturing environments require perception capabilities beyond a small, fixed set of classes. Recent open-vocabulary methods, leveraging 2D Vision-Language Foundation Models (VLFMs), target this task but often rely on class-agnostic segmentation models pre-trained on non-industrial datasets (e.g., household scenes). In this work, we first demonstrate that such models fail to generalize, performing poorly on common industrial objects. Therefore, we propose a training-free, open-vocabulary 3D perception pipeline that overcomes this limitation. Instead of using a pre-trained model to generate instance proposals, our method simply generates masks by merging pre-computed superpoints based on their semantic features. Following, we evaluate the domain-adapted VLFM "IndustrialCLIP" on a representative 3D industrial workshop scene for open-vocabulary querying. Our qualitative results demonstrate successful segmentation of industrial objects.