One2Scene: Geometric Consistent Explorable 3D Scene Generation from a Single Image

作者: Pengfei Wang, Liyi Chen, Zhiyuan Ma, Yanjun Guo, Guowen Zhang, Lei Zhang

分类: cs.CV

发布日期: 2026-02-23

备注: ICLR 2026

💡 一句话要点

One2Scene:单图生成几何一致可探索3D场景

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 单图重建 3D场景生成 可探索场景 高斯溅射 多视图立体匹配

📋 核心要点

- 现有方法在单图生成可探索3D场景时,难以支持自由视角移动,易产生几何失真和噪声。

- One2Scene将问题分解为全景生成、3D几何支架构建和新视角生成三个子任务,实现沉浸式场景探索。

- 实验表明,One2Scene在全景深度估计、360°重建和可探索3D场景生成方面优于现有方法。

📝 摘要(中文)

从单张图像生成可探索的3D场景是3D视觉领域一个极具挑战性的问题。现有方法难以支持自由探索,当视点远离原始视角时,常常产生严重的几何失真和噪声伪影。我们提出了One2Scene,一个有效的框架,它将这个不适定问题分解为三个易于处理的子任务,从而实现沉浸式可探索场景生成。首先,我们使用全景生成器从单个输入图像生成锚视图作为初始化。然后,我们通过一个可泛化的、前馈高斯溅射网络将这些2D锚点提升到显式的3D几何支架中。我们没有将全景图视为用于重建的单个图像,而是将其投影到多个稀疏锚视图中,并将重建任务重新定义为多视图立体匹配,这使我们能够利用从大规模多视图数据集中学习到的鲁棒几何先验。使用双向特征融合模块来强制执行跨视图一致性,从而产生高效且几何可靠的支架。最后,该支架作为新视图生成器的强大先验,以在任意相机位置生成照片般逼真且几何精确的视图。通过显式地以3D一致的支架为条件执行重建,One2Scene在大的相机运动下稳定工作,支持沉浸式场景探索。大量实验表明,One2Scene在全景深度估计、前馈360°重建和可探索3D场景生成方面显着优于最先进的方法。代码和模型将会发布。

🔬 方法详解

问题定义:论文旨在解决从单张图像生成可自由探索的3D场景的问题。现有方法的主要痛点在于,当视角远离原始视角时,生成的3D场景容易出现严重的几何失真和噪声伪影,难以支持沉浸式的自由探索体验。

核心思路:论文的核心思路是将单图生成可探索3D场景这一复杂且不适定的问题,分解为三个相对独立的、更易于处理的子任务:全景生成、3D几何支架构建和新视角生成。通过分而治之的方式,降低了问题的难度,并允许每个子任务专注于解决特定的挑战。

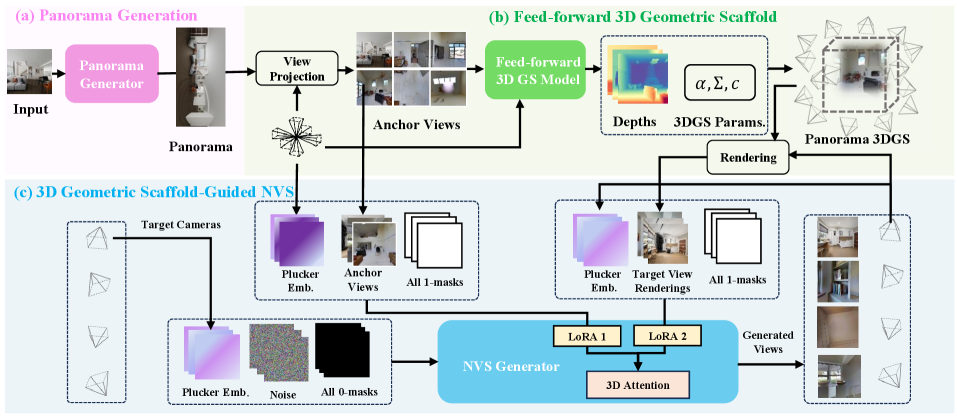

技术框架:One2Scene的整体框架包含以下三个主要模块:1) 全景生成器:从单张输入图像生成全景图,作为后续处理的初始锚视图。2) 3D几何支架构建网络:将2D锚视图提升为显式的3D几何支架,该模块利用可泛化的前馈高斯溅射网络,并采用多视图立体匹配的思想,利用大规模多视图数据集学习到的几何先验。双向特征融合模块用于增强跨视图一致性。3) 新视角生成器:以3D几何支架为先验,生成任意相机视角下的逼真图像。

关键创新:该方法最重要的创新点在于将单图3D场景生成问题分解为三个子任务,并显式地构建了一个3D几何支架作为中间表示。这种分解方式使得每个子任务可以独立优化,并且3D几何支架的引入为新视角生成提供了强大的几何约束,从而提高了生成场景的几何一致性和真实感。此外,利用多视图立体匹配的思想进行3D重建,并结合双向特征融合,增强了跨视图的一致性。

关键设计:在3D几何支架构建阶段,使用了可泛化的前馈高斯溅射网络,该网络能够直接从2D图像预测3D高斯分布参数,从而实现高效的3D重建。双向特征融合模块的设计旨在增强不同视角之间的特征交互,从而提高几何支架的质量。损失函数的设计也至关重要,可能包括几何一致性损失、光度一致性损失等,以保证生成场景的几何准确性和视觉真实感。(具体细节未知,需参考论文)

🖼️ 关键图片

📊 实验亮点

One2Scene在全景深度估计、前馈360°重建和可探索3D场景生成方面均取得了显著的性能提升,超越了现有最先进的方法。具体的性能数据和对比基线需要在论文中查找,但摘要中明确指出One2Scene在多个任务上“substantially outperforms state-of-the-art methods”,表明其具有显著的优势。

🎯 应用场景

One2Scene具有广泛的应用前景,包括虚拟现实/增强现实(VR/AR)、游戏开发、室内设计、机器人导航等领域。它可以帮助用户从单张照片快速生成可交互的3D场景,从而提升用户体验,降低内容创作成本。未来,该技术有望应用于自动驾驶、三维地图构建等更广泛的领域。

📄 摘要(原文)

Generating explorable 3D scenes from a single image is a highly challenging problem in 3D vision. Existing methods struggle to support free exploration, often producing severe geometric distortions and noisy artifacts when the viewpoint moves far from the original perspective. We introduce \textbf{One2Scene}, an effective framework that decomposes this ill-posed problem into three tractable sub-tasks to enable immersive explorable scene generation. We first use a panorama generator to produce anchor views from a single input image as initialization. Then, we lift these 2D anchors into an explicit 3D geometric scaffold via a generalizable, feed-forward Gaussian Splatting network. Instead of treating the panorama as a single image for reconstruction, we project it into multiple sparse anchor views and reformulate the reconstruction task as multi-view stereo matching, which allows us to leverage robust geometric priors learned from large-scale multi-view datasets. A bidirectional feature fusion module is used to enforce cross-view consistency, yielding an efficient and geometrically reliable scaffold. Finally, the scaffold serves as a strong prior for a novel view generator to produce photorealistic and geometrically accurate views at arbitrary cameras. By explicitly conditioning on a 3D-consistent scaffold to perform reconstruction, One2Scene works stably under large camera motions, supporting immersive scene exploration. Extensive experiments show that One2Scene substantially outperforms state-of-the-art methods in panorama depth estimation, feed-forward 360° reconstruction, and explorable 3D scene generation. Code and models will be released.