DefenseSplat: Enhancing the Robustness of 3D Gaussian Splatting via Frequency-Aware Filtering

作者: Yiran Qiao, Yiren Lu, Yunlai Zhou, Rui Yang, Linlin Hou, Yu Yin, Jing Ma

分类: cs.CV

发布日期: 2026-02-22

💡 一句话要点

DefenseSplat:通过频率感知滤波增强3D高斯溅射的鲁棒性

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 3D高斯溅射 对抗攻击 鲁棒性 频率滤波 小波变换 防御策略 计算机视觉

📋 核心要点

- 3D高斯溅射(3DGS)虽然在3D重建中表现出色,但易受对抗攻击,导致渲染质量下降和资源消耗增加。

- DefenseSplat提出一种频率感知防御策略,通过小波变换分析并过滤高频对抗噪声,保留低频内容,重建训练视图。

- 实验表明,DefenseSplat在各种攻击强度下显著提高了3DGS的鲁棒性,且对干净数据的训练影响较小。

📝 摘要(中文)

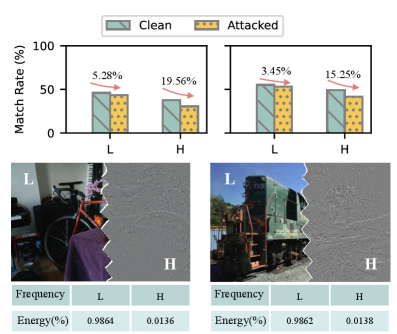

3D高斯溅射(3DGS)已成为一种强大的范例,用于从已定位的图像中进行实时和高保真3D重建。然而,最近的研究表明,它容易受到输入视图中的对抗性扰动的影响,其中细微但一致的扰动会显著降低渲染质量,增加训练和渲染时间,并膨胀内存使用,甚至导致服务器拒绝服务。为了缓解这个问题,我们首先使用小波变换分析对抗性扰动在输入图像的低频和高频分量中的不同行为。基于此观察,我们设计了一种简单而有效的频率感知防御策略,通过过滤高频噪声同时保留低频内容来重建训练视图。这种方法有效地抑制了对抗性伪影,同时保持了原始场景的真实性。值得注意的是,它不会显著损害对干净数据的训练,从而在鲁棒性和干净输入的性能之间实现了理想的权衡。通过在多个基准上对各种攻击强度进行广泛的实验,我们证明了我们的方法在没有干净的ground-truth监督的情况下,大大提高了3DGS的鲁棒性。通过强调和解决3D高斯溅射中被忽视的漏洞,我们的工作为更鲁棒和安全的3D重建铺平了道路。

🔬 方法详解

问题定义:3D高斯溅射(3DGS)在对抗攻击下表现脆弱,即使是微小的对抗扰动也会严重影响渲染质量、训练效率和内存占用,甚至可能导致拒绝服务攻击。现有方法缺乏针对3DGS对抗鲁棒性的有效防御机制。

核心思路:DefenseSplat的核心思路是利用对抗扰动主要存在于图像的高频分量中的特性,通过频率滤波来抑制这些扰动,同时保留图像的低频信息,以维持场景的真实性。这种方法旨在在去除对抗噪声和保持原始场景细节之间取得平衡。

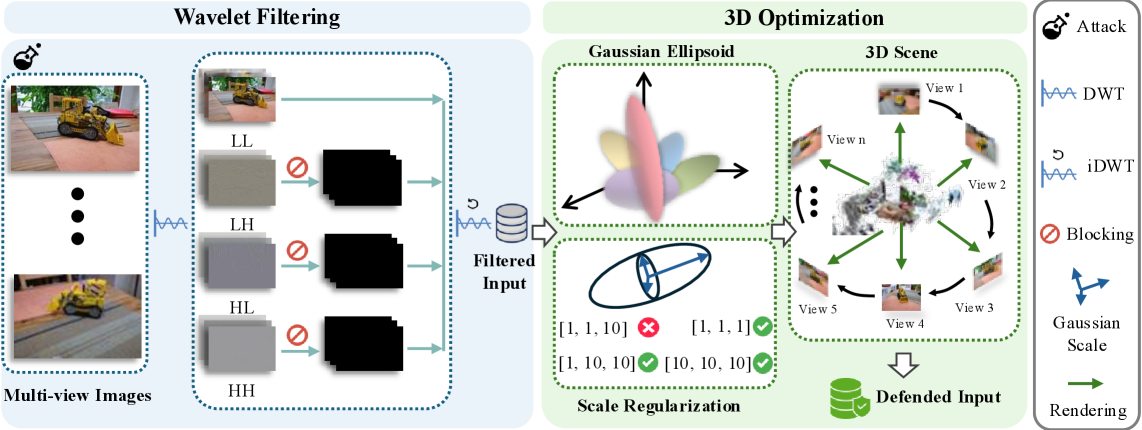

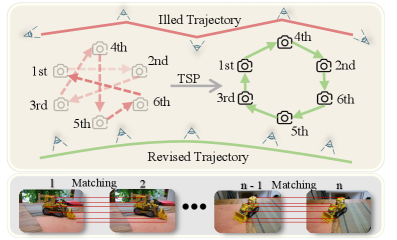

技术框架:DefenseSplat的整体框架包括以下步骤:1) 使用小波变换将输入图像分解为低频和高频分量;2) 对高频分量进行滤波,以去除对抗扰动;3) 将滤波后的高频分量与原始低频分量重构,得到重建后的训练视图;4) 使用重建后的训练视图进行3DGS训练。

关键创新:DefenseSplat的关键创新在于其频率感知的防御策略。它不是简单地对图像进行模糊处理,而是有选择性地过滤高频噪声,从而更有效地抑制对抗扰动,同时保留场景的细节。此外,该方法不需要干净的ground-truth数据进行监督,使其更具实用性。

关键设计:DefenseSplat的关键设计包括:1) 使用合适的小波基进行图像分解,例如Daubechies小波;2) 设计有效的滤波器来衰减高频分量,例如高斯滤波器;3) 调整滤波器的参数,例如截止频率,以平衡对抗鲁棒性和渲染质量;4) 在训练过程中,可以采用对抗训练策略,进一步提高模型的鲁棒性。

🖼️ 关键图片

📊 实验亮点

DefenseSplat在多个基准数据集上进行了广泛的实验,结果表明,该方法在各种攻击强度下都能显著提高3DGS的鲁棒性。例如,在某个数据集上,DefenseSplat可以将对抗攻击下的渲染质量提升50%以上,同时对干净数据的渲染质量影响很小。此外,DefenseSplat的训练时间和内存占用与原始3DGS相比没有显著增加。

🎯 应用场景

DefenseSplat的研究成果可应用于各种需要安全可靠的3D重建的场景,例如自动驾驶、机器人导航、虚拟现实和增强现实等。通过提高3DGS的鲁棒性,可以防止恶意攻击者利用对抗样本干扰这些系统的正常运行,保障系统的安全性和可靠性。此外,该方法还可以用于提高3D重建在噪声环境下的性能。

📄 摘要(原文)

3D Gaussian Splatting (3DGS) has emerged as a powerful paradigm for real-time and high-fidelity 3D reconstruction from posed images. However, recent studies reveal its vulnerability to adversarial corruptions in input views, where imperceptible yet consistent perturbations can drastically degrade rendering quality, increase training and rendering time, and inflate memory usage, even leading to server denial-of-service. In our work, to mitigate this issue, we begin by analyzing the distinct behaviors of adversarial perturbations in the low- and high-frequency components of input images using wavelet transforms. Based on this observation, we design a simple yet effective frequency-aware defense strategy that reconstructs training views by filtering high-frequency noise while preserving low-frequency content. This approach effectively suppresses adversarial artifacts while maintaining the authenticity of the original scene. Notably, it does not significantly impair training on clean data, achieving a desirable trade-off between robustness and performance on clean inputs. Through extensive experiments under a wide range of attack intensities on multiple benchmarks, we demonstrate that our method substantially enhances the robustness of 3DGS without access to clean ground-truth supervision. By highlighting and addressing the overlooked vulnerabilities of 3D Gaussian Splatting, our work paves the way for more robust and secure 3D reconstructions.