VIGiA: Instructional Video Guidance via Dialogue Reasoning and Retrieval

作者: Diogo Glória-Silva, David Semedo, João Maglhães

分类: cs.CV, cs.CL

发布日期: 2026-02-22

备注: Accepted at EACL 2026 Findings

💡 一句话要点

VIGiA:通过对话推理和检索进行教学视频指导

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多模态对话 教学视频理解 计划推理 视觉问答 对话系统

📋 核心要点

- 现有方法在教学视频指导中,要么仅依赖文本,要么割裂视觉和语言信息,缺乏对多步骤计划的整体理解。

- VIGiA通过多模态计划推理和基于计划的检索,将用户查询与视觉输入和教学计划对齐,实现计划感知的对话。

- 在包含烹饪和DIY计划的新数据集上,VIGiA在计划感知VQA等任务上显著优于现有模型,准确率超过90%。

📝 摘要(中文)

我们提出了VIGiA,一种新颖的多模态对话模型,旨在理解和推理复杂的多步骤教学视频行动计划。与先前主要关注纯文本指导或孤立处理视觉和语言的工作不同,VIGiA支持基于上下文的、计划感知的对话,需要对视觉输入、教学计划和交错的用户交互进行推理。为此,VIGiA包含两个关键能力:(1)多模态计划推理,使模型能够将单模态和多模态查询与当前任务计划对齐并准确响应;(2)基于计划的检索,使其能够检索文本或视觉表示中的相关计划步骤。我们在一个包含与烹饪和DIY计划对齐的丰富教学视频对话的新数据集上进行了实验。我们的评估表明,VIGiA在对话式计划指导的所有任务中均优于现有的最先进模型,在计划感知的VQA上达到了90%以上的准确率。

🔬 方法详解

问题定义:现有教学视频对话模型主要存在两个痛点:一是缺乏对视觉信息的有效利用,二是难以进行多步骤计划的推理。这导致模型无法准确理解用户基于视频内容的提问,也无法根据当前任务进度给出合适的指导。

核心思路:VIGiA的核心思路是将视觉信息、文本信息和任务计划进行融合,通过多模态推理和检索,实现计划感知的对话。模型能够理解用户在特定计划步骤中的提问,并根据当前步骤检索相关的文本或视觉信息,从而给出更准确和有用的回答。

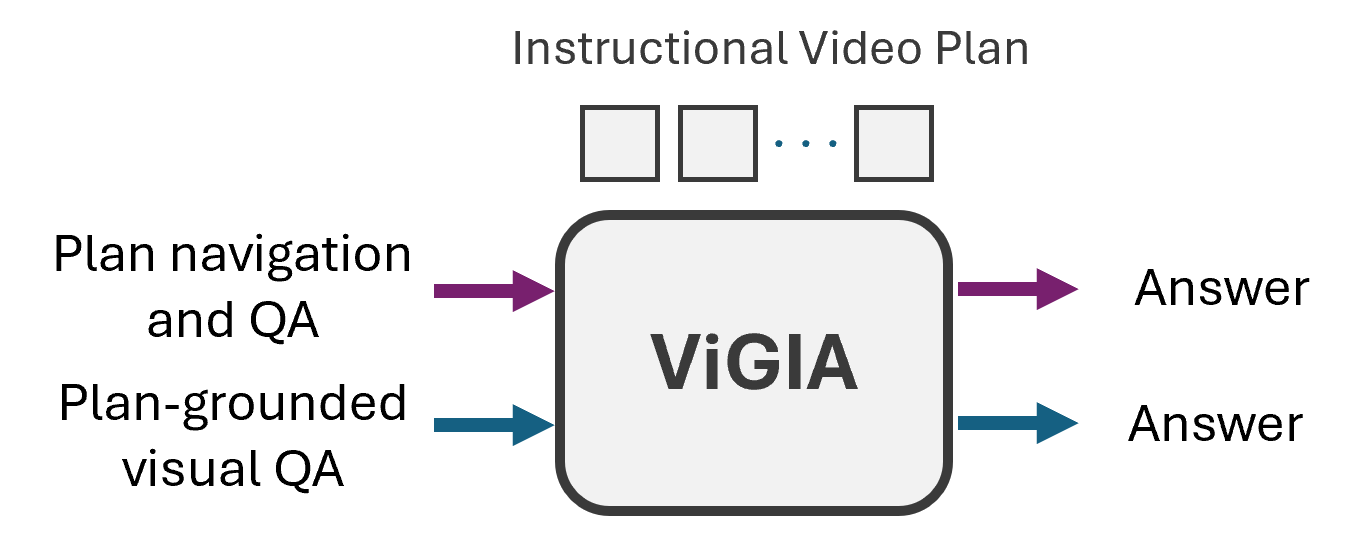

技术框架:VIGiA的整体框架包含两个主要模块:多模态计划推理模块和基于计划的检索模块。多模态计划推理模块负责将用户查询、视觉输入和任务计划进行融合,生成一个统一的表示。基于计划的检索模块则根据这个表示,从文本或视觉知识库中检索相关的计划步骤。这两个模块协同工作,共同完成对话任务。

关键创新:VIGiA的关键创新在于其多模态计划推理能力和基于计划的检索机制。前者能够有效地融合不同模态的信息,后者能够根据任务计划检索相关信息,从而实现计划感知的对话。这种结合使得VIGiA能够更好地理解用户意图,并给出更准确的回答。与现有方法相比,VIGiA不再孤立地处理视觉和语言信息,而是将它们与任务计划相结合,从而实现了更高级别的理解和推理。

关键设计:多模态计划推理模块可能采用了Transformer或类似的注意力机制,用于融合不同模态的信息。基于计划的检索模块可能采用了向量相似度搜索等技术,用于从知识库中检索相关信息。具体的损失函数可能包括交叉熵损失、对比损失等,用于优化模型的性能。具体的网络结构和参数设置未知,需要参考论文原文。

🖼️ 关键图片

📊 实验亮点

VIGiA在自建的教学视频对话数据集上进行了评估,结果表明,VIGiA在所有任务中均优于现有的最先进模型。在计划感知的VQA任务上,VIGiA的准确率超过了90%,显著提升了对话系统的性能。这些结果表明,VIGiA在教学视频指导方面具有显著的优势。

🎯 应用场景

VIGiA具有广泛的应用前景,例如智能烹饪助手、DIY指导、远程教育等。它可以帮助用户更好地理解教学视频内容,并根据用户的提问提供个性化的指导。未来,VIGiA还可以应用于机器人领域,使机器人能够更好地理解人类指令,并完成复杂的任务。

📄 摘要(原文)

We introduce VIGiA, a novel multimodal dialogue model designed to understand and reason over complex, multi-step instructional video action plans. Unlike prior work which focuses mainly on text-only guidance, or treats vision and language in isolation, VIGiA supports grounded, plan-aware dialogue that requires reasoning over visual inputs, instructional plans, and interleaved user interactions. To this end, VIGiA incorporates two key capabilities: (1) multimodal plan reasoning, enabling the model to align uni- and multimodal queries with the current task plan and respond accurately; and (2) plan-based retrieval, allowing it to retrieve relevant plan steps in either textual or visual representations. Experiments were done on a novel dataset with rich Instructional Video Dialogues aligned with Cooking and DIY plans. Our evaluation shows that VIGiA outperforms existing state-of-the-art models on all tasks in a conversational plan guidance setting, reaching over 90\% accuracy on plan-aware VQA.