CaReFlow: Cyclic Adaptive Rectified Flow for Multimodal Fusion

作者: Sijie Mai, Shiqin Han

分类: cs.CV, cs.LG

发布日期: 2026-02-22

备注: Accepted by CVPR 2026

💡 一句话要点

提出CaReFlow:循环自适应修正流,用于解决多模态融合中的模态差异问题。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多模态融合 修正流 模态差异 情感计算 自适应对齐 循环学习 分布映射

📋 核心要点

- 现有方法在多模态融合中,难以有效弥合模态差异,且缺乏对目标模态全局分布信息的利用。

- 论文提出循环自适应修正流(CaReFlow),通过一对多映射和自适应对齐策略实现更鲁棒的模态分布转换。

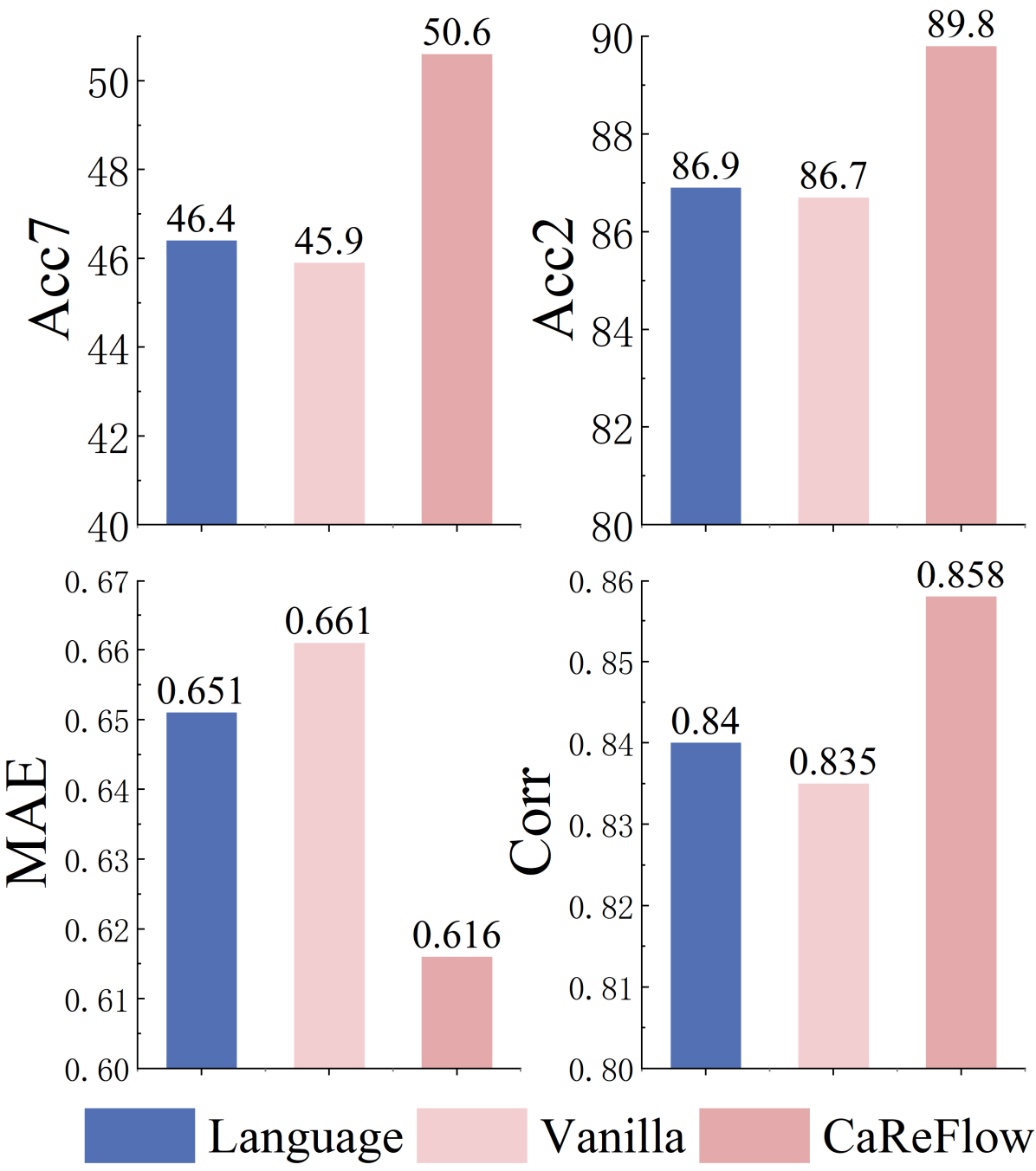

- 实验结果表明,CaReFlow在多模态情感计算任务上表现出色,有效减小了模态差异。

📝 摘要(中文)

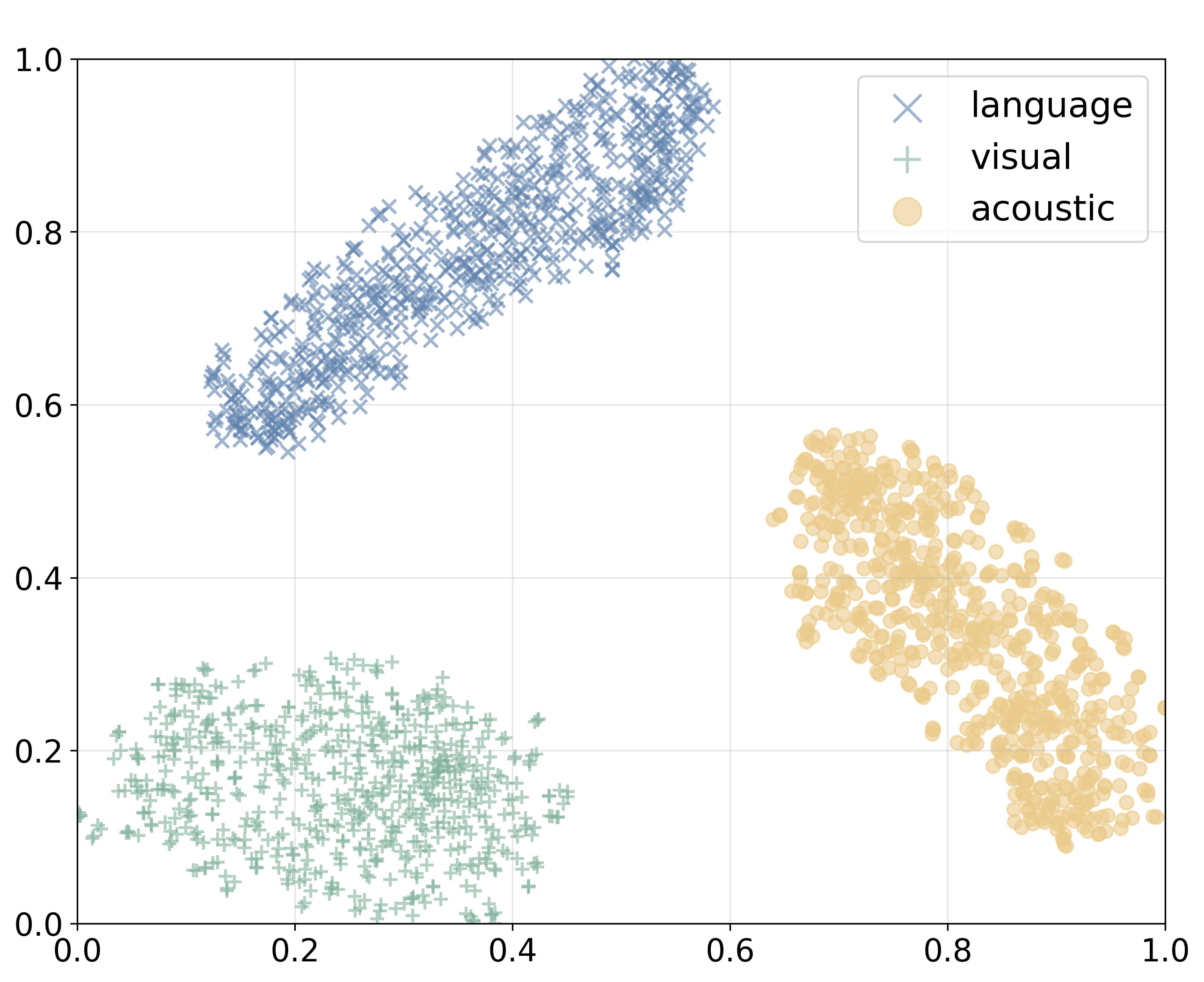

模态差异显著限制了多模态融合的有效性。以往方法通常使用扩散模型和对抗学习等技术来减小模态差异,但它们通常侧重于一对一的对齐,而没有将源模态的数据点暴露于目标模态的全局分布信息中。为此,我们利用修正流可以通过直线轨迹将一个分布映射到另一个分布的特性,扩展了修正流用于模态分布映射。具体来说,我们利用修正流中的“一对多映射”策略,允许源模态的每个数据点观察整体目标分布。这也缓解了每个样本中配对数据不足的问题,从而实现更稳健的分布转换。此外,为了实现更准确的分布映射并解决一对多映射中模糊的流方向问题,我们设计了“自适应松弛对齐”,对属于同一样本的模态对强制执行更严格的对齐,而对不属于同一样本或类别的模态对应用松弛映射。此外,为了防止分布映射过程中的信息丢失,我们引入了“循环修正流”,以确保转移的特征可以转换回原始特征,从而使多模态表示能够学习到足够的模态特定信息。在分布对齐后,我们的方法在多模态情感计算的多个任务上取得了非常有竞争力的结果,即使使用简单的融合方法,可视化也验证了它可以有效地减小模态差异。

🔬 方法详解

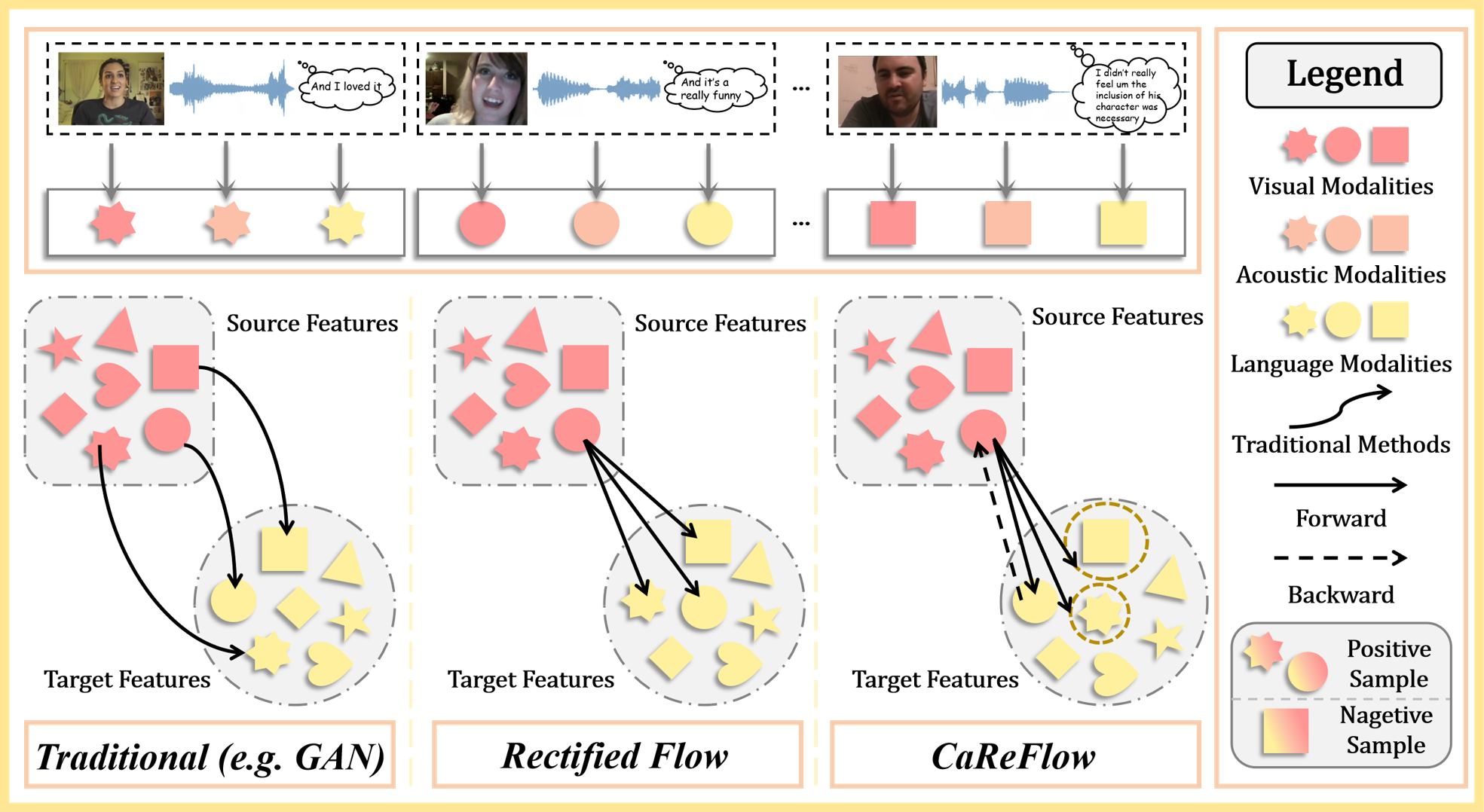

问题定义:多模态融合旨在整合来自不同模态的信息以提升性能,但模态间的差异(模态gap)阻碍了有效融合。现有方法如扩散模型和对抗学习,主要关注一对一的模态对齐,忽略了源模态数据点与目标模态全局分布的交互,且对配对数据量有较高要求。

核心思路:论文的核心在于利用修正流(Rectified Flow)将一个分布映射到另一个分布的特性,并扩展其应用到模态分布映射上。通过“一对多映射”策略,使源模态数据点能够观察到目标模态的全局分布,从而缓解配对数据不足的问题。同时,引入自适应松弛对齐和循环修正流,以提高映射精度并防止信息损失。

技术框架:CaReFlow包含以下主要阶段:1) 使用修正流进行模态分布映射,采用一对多映射策略;2) 应用自适应松弛对齐,对同一样本的模态对进行严格对齐,对不同样本或类别的模态对进行松弛映射;3) 引入循环修正流,确保特征可以转换回原始特征,保留模态特定信息;4) 使用简单的融合方法进行最终预测。

关键创新:主要创新点在于:1) 将修正流扩展到多模态融合领域,用于模态分布映射;2) 提出“一对多映射”策略,使源模态能够观察目标模态的全局分布;3) 设计“自适应松弛对齐”,根据模态对的关系调整对齐强度;4) 引入“循环修正流”,防止信息损失。与现有方法相比,CaReFlow更注重模态间的全局分布交互,并能有效处理配对数据不足的情况。

关键设计:自适应松弛对齐通过损失函数实现,对同一样本的模态对施加更强的对齐约束,例如使用更小的距离度量阈值或更大的权重系数。循环修正流通过添加一个反向的修正流映射,并使用重构损失来确保信息可以无损地转换回原始特征。具体的网络结构和参数设置在论文中未详细说明,属于未知信息。

🖼️ 关键图片

📊 实验亮点

论文在多模态情感计算的多个任务上取得了有竞争力的结果,证明了CaReFlow的有效性。虽然论文中没有提供具体的性能数据和对比基线,但可视化结果表明,CaReFlow能够有效地减小模态差异,提升融合效果。具体的性能提升幅度属于未知信息。

🎯 应用场景

CaReFlow在多模态情感计算领域具有广泛的应用前景,例如情感识别、情感分析、人机交互等。该方法能够有效减小模态差异,提升融合效果,从而提高情感识别的准确性和鲁棒性。此外,该方法还可以应用于其他多模态任务,如多模态机器翻译、多模态语音识别等,具有重要的实际价值和潜在的未来影响。

📄 摘要(原文)

Modality gap significantly restricts the effectiveness of multimodal fusion. Previous methods often use techniques such as diffusion models and adversarial learning to reduce the modality gap, but they typically focus on one-to-one alignment without exposing the data points of the source modality to the global distribution information of the target modality. To this end, leveraging the characteristic of rectified flow that can map one distribution to another via a straight trajectory, we extend rectified flow for modality distribution mapping. Specifically, we leverage the

one-to-many mapping' strategy in rectified flow that allows each data point of the source modality to observe the overall target distribution. This also alleviates the issue of insufficient paired data within each sample, enabling a more robust distribution transformation. Moreover, to achieve more accurate distribution mapping and address the ambiguous flow directions in one-to-many mapping, we designadaptive relaxed alignment', enforcing stricter alignment for modality pairs belonging to the same sample, while applying relaxed mapping for pairs not belonging to the same sample or category. Additionally, to prevent information loss during distribution mapping, we introduce `cyclic rectified flow' to ensure the transferred features can be translated back to the original features, allowing multimodal representations to learn sufficient modality-specific information. After distribution alignment, our approach achieves very competitive results on multiple tasks of multimodal affective computing even with a simple fusion method, and visualizations verify that it can effectively reduce the modality gap.