Spatial-Temporal State Propagation Autoregressive Model for 4D Object Generation

作者: Liying Yang, Jialun Liu, Jiakui Hu, Chenhao Guan, Haibin Huang, Fangqiu Yi, Chi Zhang, Yanyan Liang

分类: cs.CV

发布日期: 2026-02-21

💡 一句话要点

提出4DSTAR模型,通过时空状态传播自回归生成时空一致的4D物体

🎯 匹配领域: 支柱四:生成式动作 (Generative Motion)

关键词: 4D物体生成 时空一致性 自回归模型 状态传播 VQ-VAE 动态场景 序列预测

📋 核心要点

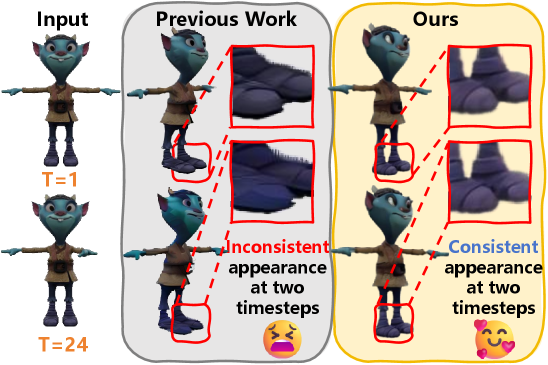

- 现有基于扩散的4D物体生成方法难以保证时空一致性,未能充分利用历史时间步的信息。

- 提出时空状态传播自回归模型(4DSTAR),通过动态传播时空状态来建模长期依赖关系,指导生成。

- 实验结果表明,4DSTAR能够生成时空一致的4D物体,性能与扩散模型相比具有竞争力。

📝 摘要(中文)

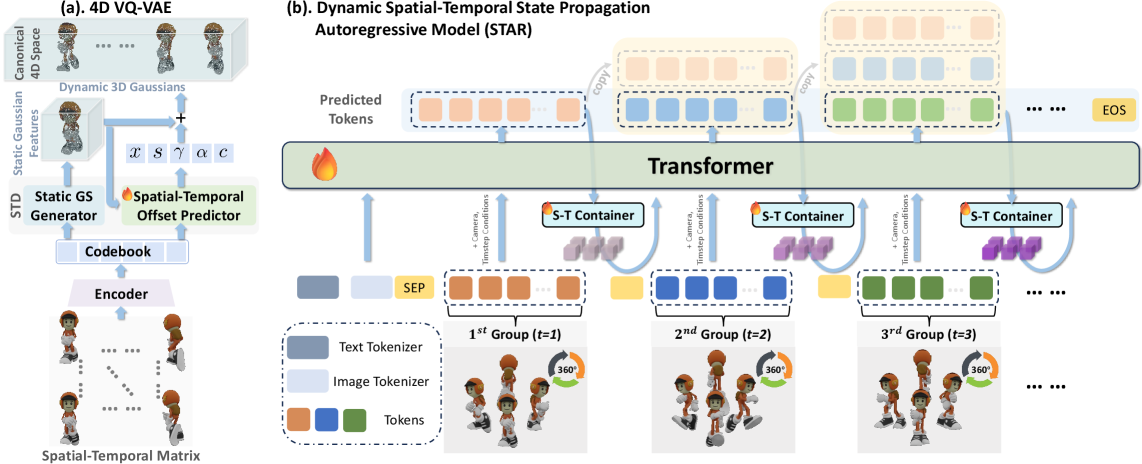

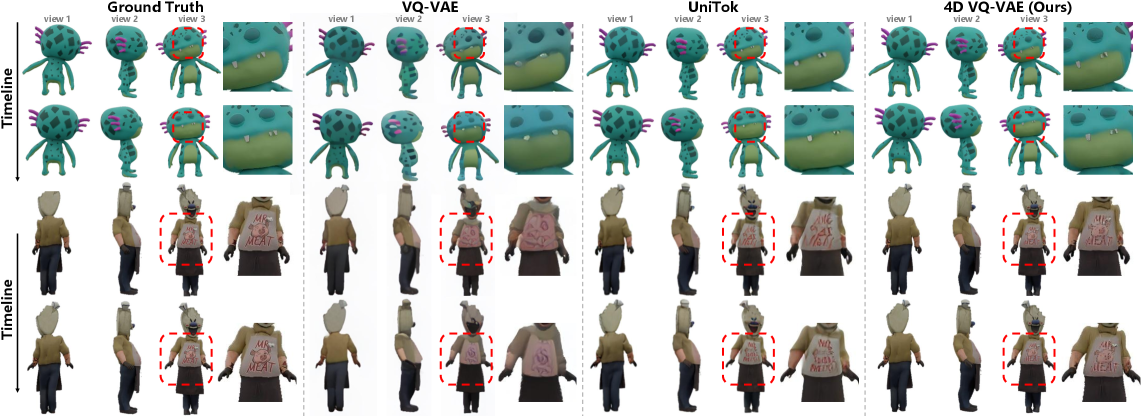

生成具有时空一致性的高质量4D物体仍然是一个巨大的挑战。现有的基于扩散的方法通常难以保证时空一致性,因为它们未能利用所有先前时间步的输出来指导当前时间步的生成。因此,我们提出了一种时空状态传播自回归模型(4DSTAR),该模型生成保持时空一致性的4D物体。4DSTAR将生成问题定义为代表4D物体的token的预测。它由两个关键组件组成:(1)提出了动态时空状态传播自回归模型(STAR),该模型实现了时空一致的生成。与标准自回归模型不同,STAR根据时间步将预测token分成组。它通过传播先前组的时空状态来建模长期依赖关系,并利用这些依赖关系来指导下一个时间步的生成。为此,提出了一个时空容器,该容器动态更新来自所有历史组的有效时空状态特征,然后更新的特征用作条件特征来指导下一个token组的预测。(2)提出了4D VQ-VAE,它将4D结构隐式编码到离散空间中,并将STAR预测的离散token解码为时间上连贯的动态3D高斯分布。实验表明,4DSTAR生成时空一致的4D物体,并实现了与扩散模型相比具有竞争力的性能。

🔬 方法详解

问题定义:论文旨在解决4D物体生成中时空一致性问题。现有方法,特别是基于扩散模型的方法,在生成动态的4D物体时,难以保证不同时间步之间的空间和时间上的连贯性,导致生成结果出现抖动或不自然的形变。

核心思路:论文的核心思路是将4D物体生成问题转化为一个序列预测问题,并利用自回归模型来建模时间上的依赖关系。通过引入时空状态传播机制,模型能够有效地利用历史信息,从而保证生成结果的时空一致性。这种方法避免了扩散模型在处理长序列时可能遇到的问题。

技术框架:4DSTAR模型主要包含两个模块:4D VQ-VAE和动态时空状态传播自回归模型(STAR)。首先,4D VQ-VAE将4D物体编码为离散的token序列。然后,STAR模型以自回归的方式预测这些token,其中每个时间步的预测都依赖于之前所有时间步的状态。STAR模型使用一个时空容器来动态更新和存储历史状态信息,并将其作为条件来指导当前时间步的预测。最后,解码器将预测的token序列转换回4D物体。

关键创新:该论文的关键创新在于提出了动态时空状态传播机制。与传统的自回归模型不同,STAR模型不是简单地将前一个时间步的输出作为下一个时间步的输入,而是维护一个动态更新的时空容器,其中包含了所有历史时间步的有效状态信息。这种机制能够更好地建模长期依赖关系,从而保证生成结果的时空一致性。

关键设计:时空容器的设计是关键。它通过某种方式(具体实现未知)聚合了所有历史时间步的状态特征,并将其作为条件信息传递给下一个时间步。此外,4D VQ-VAE的设计也至关重要,它需要能够有效地将4D物体编码为离散的token序列,同时保留足够的时空信息。损失函数的设计也需要考虑时空一致性,但具体细节未知。

🖼️ 关键图片

📊 实验亮点

实验结果表明,4DSTAR模型能够生成时空一致的4D物体,并且在性能上与现有的扩散模型相比具有竞争力。具体的性能指标和对比基线未知,但论文强调了该模型在保证时空一致性方面的优势。该模型在生成复杂动态场景方面具有潜力。

🎯 应用场景

该研究成果可应用于动画制作、游戏开发、虚拟现实、机器人运动规划等领域。例如,可以用于自动生成逼真的角色动画,创建动态的游戏场景,或为机器人生成平滑的运动轨迹。该方法能够显著提高4D内容生成的效率和质量,并为相关应用带来更丰富的可能性。

📄 摘要(原文)

Generating high-quality 4D objects with spatial-temporal consistency is still formidable. Existing diffusion-based methods often struggle with spatial-temporal inconsistency, as they fail to leverage outputs from all previous timesteps to guide the generation at the current timestep. Therefore, we propose a Spatial-Temporal State Propagation AutoRegressive Model (4DSTAR), which generates 4D objects maintaining temporal-spatial consistency. 4DSTAR formulates the generation problem as the prediction of tokens that represent the 4D object. It consists of two key components: (1) The dynamic spatial-temporal state propagation autoregressive model (STAR) is proposed, which achieves spatial-temporal consistent generation. Unlike standard autoregressive models, STAR divides prediction tokens into groups based on timesteps. It models long-term dependencies by propagating spatial-temporal states from previous groups and utilizes these dependencies to guide generation at the next timestep. To this end, a spatial-temporal container is proposed, which dynamically updating the effective spatial-temporal state features from all historical groups, then updated features serve as conditional features to guide the prediction of the next token group. (2) The 4D VQ-VAE is proposed, which implicitly encodes the 4D structure into discrete space and decodes the discrete tokens predicted by STAR into temporally coherent dynamic 3D Gaussians. Experiments demonstrate that 4DSTAR generates spatial-temporal consistent 4D objects, and achieves performance competitive with diffusion models.