Learning Multi-Modal Prototypes for Cross-Domain Few-Shot Object Detection

作者: Wanqi Wang, Jingcai Guo, Yuxiang Cai, Zhi Chen

分类: cs.CV

发布日期: 2026-02-21

备注: Accepted to CVPR 2026 Findings

💡 一句话要点

提出LMP:学习多模态原型,解决跨域小样本目标检测问题

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 跨域小样本学习 目标检测 多模态学习 视觉-语言模型 原型学习

📋 核心要点

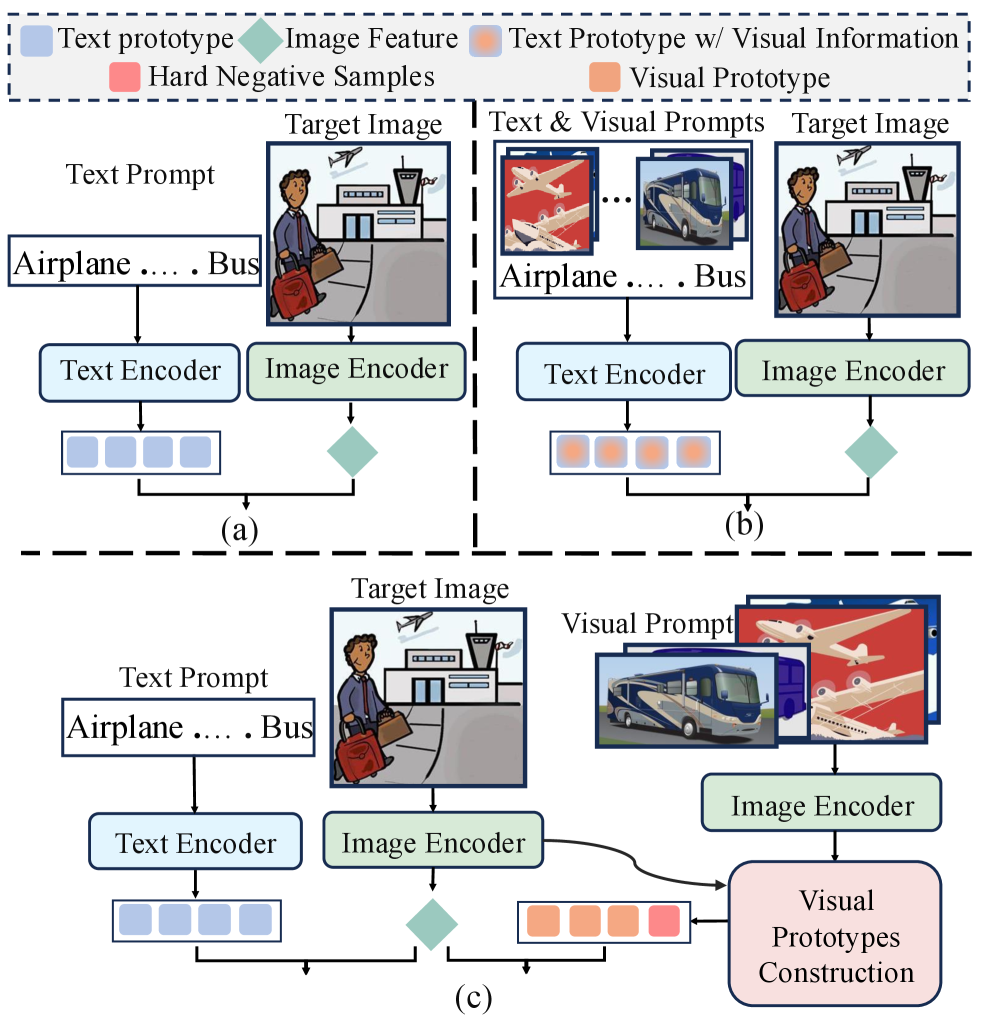

- 现有跨域小样本目标检测方法依赖文本提示,忽略了领域特定的视觉信息,导致定位精度不足。

- LMP通过结合文本指导和视觉范例,学习多模态原型,从而实现更精确的目标检测。

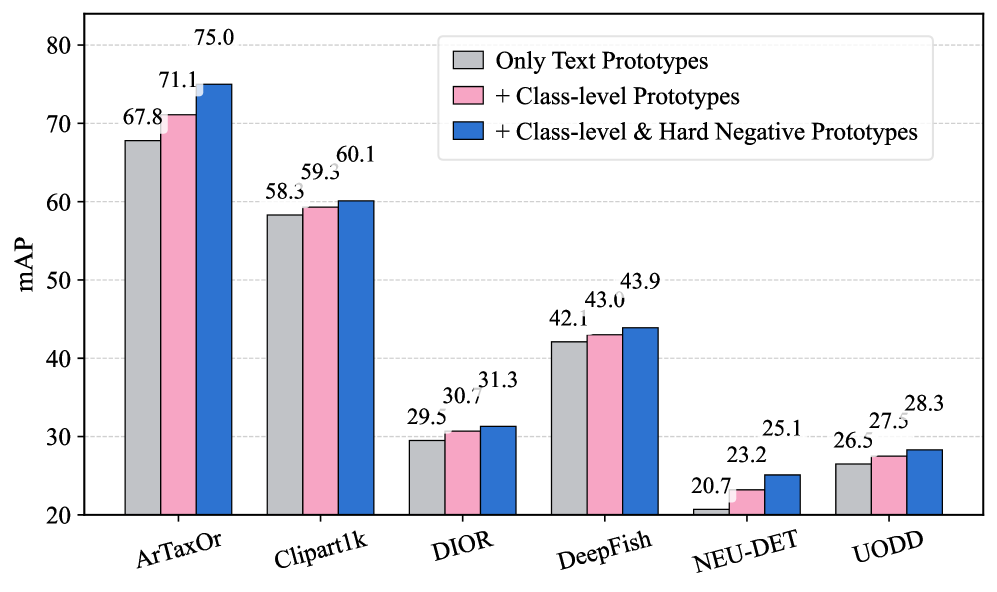

- 在多个跨域数据集上,LMP在1/5/10-shot设置下均取得了state-of-the-art或极具竞争力的mAP。

📝 摘要(中文)

跨域小样本目标检测(CD-FSOD)旨在仅给定少量带标签的样本,在未见过的目标域中检测新类别。虽然构建在视觉-语言模型(VLMs)上的开放词汇检测器具有良好的迁移性,但它们几乎完全依赖于文本提示,这些提示编码了领域不变的语义,但错过了在少量样本监督下进行精确定位所需的领域特定视觉信息。我们提出了一种双分支检测器,通过将文本指导与来自目标域的视觉范例相结合,学习多模态原型,称为LMP。视觉原型构建模块从支持RoI聚合类级别的原型,并通过抖动框动态生成查询图像中的难负例原型,捕获干扰因素和视觉上相似的背景。在视觉引导分支中,我们将这些原型注入到检测管道中,其组件与文本分支镜像,作为训练的起点,而并行文本引导分支保留开放词汇语义。这些分支联合训练,并在推理时通过结合语义抽象和领域自适应细节进行集成。在六个跨域基准数据集和标准的1/5/10-shot设置下,我们的方法实现了最先进或极具竞争力的mAP。

🔬 方法详解

问题定义:跨域小样本目标检测(CD-FSOD)旨在解决在目标域只有少量标注样本的情况下,如何检测新类别的目标。现有方法,特别是基于视觉-语言模型(VLM)的开放词汇检测器,虽然具有良好的迁移能力,但过度依赖文本提示,忽略了目标域的视觉特征,导致定位精度下降。这些方法无法充分利用目标域的少量样本信息,难以区分目标和背景干扰。

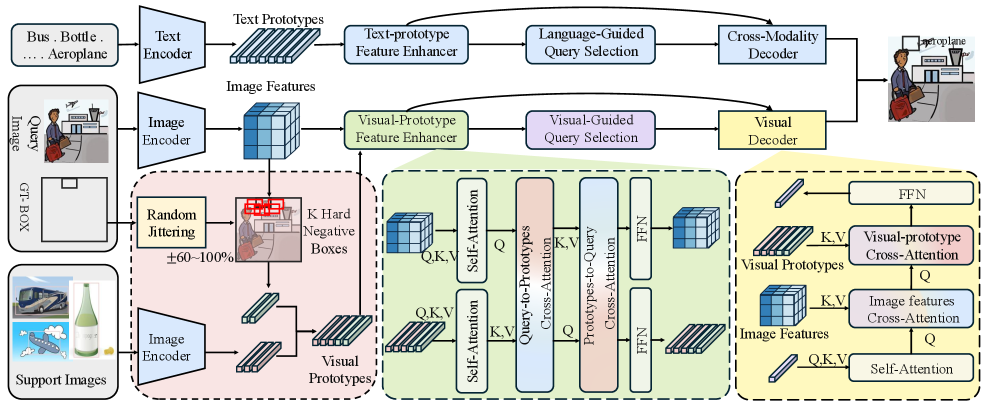

核心思路:LMP的核心思路是结合文本指导和视觉范例,学习多模态原型。文本分支负责提取领域不变的语义信息,视觉分支则负责学习领域特定的视觉特征。通过将两者结合,LMP能够更好地利用目标域的少量样本信息,提高目标检测的精度和鲁棒性。这种双分支结构允许模型同时关注语义信息和视觉细节,从而实现更准确的定位。

技术框架:LMP采用双分支检测器结构,包含文本引导分支和视觉引导分支。文本引导分支利用文本提示提取语义信息,视觉引导分支则利用目标域的视觉范例学习领域特定的视觉特征。视觉原型构建模块从支持RoI聚合类级别的原型,并通过抖动框动态生成查询图像中的难负例原型。两个分支联合训练,并在推理时进行集成,以结合语义抽象和领域自适应细节。

关键创新:LMP的关键创新在于多模态原型的学习和利用。通过结合文本和视觉信息,LMP能够学习到更具判别性的原型表示,从而提高目标检测的精度。此外,动态生成难负例原型也是一个重要的创新点,可以帮助模型更好地区分目标和背景干扰。这种多模态原型学习方法与现有方法仅依赖文本提示的方式有本质区别。

关键设计:视觉原型构建模块使用支持RoI的特征来构建类级别的原型。为了生成难负例原型,LMP使用抖动框在查询图像中随机生成一些候选框,并将这些候选框的特征作为负例原型。损失函数包括分类损失和回归损失,用于优化检测器的性能。两个分支的权重在训练过程中动态调整,以平衡文本和视觉信息的重要性。具体参数设置和网络结构细节未在摘要中详细说明,属于未知信息。

🖼️ 关键图片

📊 实验亮点

LMP在六个跨域基准数据集上进行了评估,并在标准的1/5/10-shot设置下取得了state-of-the-art或极具竞争力的mAP。实验结果表明,LMP能够有效利用目标域的视觉信息,提高目标检测的精度和鲁棒性。具体的性能提升幅度需要参考论文正文中的实验数据。

🎯 应用场景

该研究成果可应用于各种跨域小样本目标检测场景,例如:在新的工业环境中检测特定类型的缺陷产品,在新的医疗影像数据集中检测特定疾病的病灶,在新的安防监控场景中检测特定类型的可疑行为。该方法能够有效利用少量标注样本,降低数据标注成本,提高目标检测系统的泛化能力和实用性。

📄 摘要(原文)

Cross-Domain Few-Shot Object Detection (CD-FSOD) aims to detect novel classes in unseen target domains given only a few labeled examples. While open-vocabulary detectors built on vision-language models (VLMs) transfer well, they depend almost entirely on text prompts, which encode domain-invariant semantics but miss domain-specific visual information needed for precise localization under few-shot supervision. We propose a dual-branch detector that Learns Multi-modal Prototypes, dubbed LMP, by coupling textual guidance with visual exemplars drawn from the target domain. A Visual Prototype Construction module aggregates class-level prototypes from support RoIs and dynamically generates hard-negative prototypes in query images via jittered boxes, capturing distractors and visually similar backgrounds. In the visual-guided branch, we inject these prototypes into the detection pipeline with components mirrored from the text branch as the starting point for training, while a parallel text-guided branch preserves open-vocabulary semantics. The branches are trained jointly and ensembled at inference by combining semantic abstraction with domain-adaptive details. On six cross-domain benchmark datasets and standard 1/5/10-shot settings, our method achieves state-of-the-art or highly competitive mAP.