Optimizing ID Consistency in Multimodal Large Models: Facial Restoration via Alignment, Entanglement, and Disentanglement

作者: Yuran Dong, Hang Dai, Mang Ye

分类: cs.CV, cs.GR

发布日期: 2026-02-21

备注: ICLR 26

🔗 代码/项目: GITHUB

💡 一句话要点

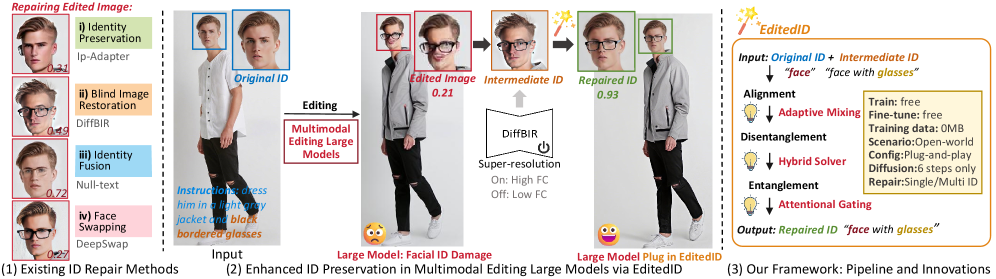

提出EditedID框架,解决多模态编辑中人脸ID一致性难题

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多模态编辑 人脸恢复 身份一致性 扩散模型 解耦表示

📋 核心要点

- 多模态编辑大模型在人脸编辑中存在身份一致性问题,限制了实际应用。

- EditedID框架通过对齐、解耦和耦合策略,实现身份保持和编辑效果的平衡。

- 实验表明,EditedID在身份保持和编辑质量上均优于现有方法,且无需训练。

📝 摘要(中文)

多模态编辑大模型在各种任务中展示了强大的编辑能力。然而,一个长期存在的限制是在真实人像编辑过程中面部身份(ID)一致性的下降。由于人眼对人脸特征的高度敏感性,这种不一致性严重阻碍了这些模型的实际部署。现有的面部ID保持方法难以实现面部身份和编辑元素IP的一致恢复,这是由于跨源分布偏差和跨源特征污染。为了解决这些问题,我们提出了EditedID,一个用于鲁棒的身份特定面部恢复的对齐-解耦-耦合框架。通过系统地分析扩散轨迹、采样器行为和注意力属性,我们引入了三个关键组件:1) 自适应混合策略,在整个扩散过程中对齐跨源潜在表示。2) 混合求解器,解耦源特定的身份属性和细节。3) 注意力门控机制,选择性地耦合视觉元素。大量实验表明,EditedID在保持原始面部ID和编辑元素IP一致性方面实现了最先进的性能。作为一个免训练和即插即用的解决方案,它为开放世界环境中实际可靠的单人/多人面部身份恢复建立了一个新的基准,为多模态编辑大模型在真人编辑场景中的部署铺平了道路。代码可在https://github.com/NDYBSNDY/EditedID获取。

🔬 方法详解

问题定义:多模态编辑大模型在人像编辑时,难以保持编辑前后人脸的身份一致性。现有方法受限于跨源分布偏差和特征污染,无法同时保证身份ID和编辑元素IP的一致性,导致编辑后的人脸与原始人脸差异较大,影响用户体验。

核心思路:EditedID的核心思路是,通过对齐跨源潜在表示、解耦身份属性和细节、以及选择性地耦合视觉元素,从而在扩散模型的框架下,实现对人脸身份的精确控制和编辑。这种设计旨在克服跨源数据带来的偏差和干扰,确保编辑过程既能保留原始身份,又能实现所需的编辑效果。

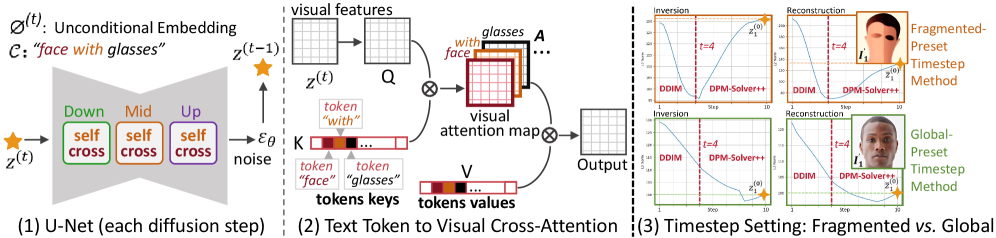

技术框架:EditedID框架包含三个主要模块:1) 自适应混合策略:用于对齐不同来源的潜在表示,减少跨源分布偏差。2) 混合求解器:用于解耦源特定的身份属性和细节,避免特征污染。3) 注意力门控机制:用于选择性地耦合视觉元素,控制编辑效果。整体流程是在扩散模型的迭代过程中,利用这三个模块对潜在表示进行精细调整,最终生成既保持身份又符合编辑要求的图像。

关键创新:EditedID的关键创新在于其对齐-解耦-耦合的整体框架,以及针对扩散模型特性设计的三个模块。与现有方法相比,EditedID更注重对潜在空间的精细操作,通过自适应混合、解耦和选择性耦合,实现了对身份和编辑效果的更精确控制。

关键设计:自适应混合策略通过动态调整混合比例,平衡不同来源的特征。混合求解器利用多个损失函数,分别约束身份属性和细节的解耦效果。注意力门控机制则通过学习注意力权重,控制哪些视觉元素需要被编辑或保留。具体的参数设置和网络结构细节在论文中有详细描述。

🖼️ 关键图片

📊 实验亮点

EditedID在人脸身份保持和编辑元素IP一致性方面取得了显著的性能提升。实验结果表明,EditedID在多个数据集上均优于现有方法,实现了最先进的性能。作为一个免训练和即插即用的解决方案,EditedID为实际可靠的单人/多人面部身份恢复建立了一个新的基准。

🎯 应用场景

EditedID具有广泛的应用前景,包括但不限于:人像美颜、虚拟形象定制、照片修复、视频编辑等。该技术可以应用于社交媒体、游戏、影视制作等领域,提升用户体验和内容创作效率。未来,EditedID有望成为多模态编辑大模型在实际人像编辑场景中的关键技术。

📄 摘要(原文)

Multimodal editing large models have demonstrated powerful editing capabilities across diverse tasks. However, a persistent and long-standing limitation is the decline in facial identity (ID) consistency during realistic portrait editing. Due to the human eye's high sensitivity to facial features, such inconsistency significantly hinders the practical deployment of these models. Current facial ID preservation methods struggle to achieve consistent restoration of both facial identity and edited element IP due to Cross-source Distribution Bias and Cross-source Feature Contamination. To address these issues, we propose EditedID, an Alignment-Disentanglement-Entanglement framework for robust identity-specific facial restoration. By systematically analyzing diffusion trajectories, sampler behaviors, and attention properties, we introduce three key components: 1) Adaptive mixing strategy that aligns cross-source latent representations throughout the diffusion process. 2) Hybrid solver that disentangles source-specific identity attributes and details. 3) Attentional gating mechanism that selectively entangles visual elements. Extensive experiments show that EditedID achieves state-of-the-art performance in preserving original facial ID and edited element IP consistency. As a training-free and plug-and-play solution, it establishes a new benchmark for practical and reliable single/multi-person facial identity restoration in open-world settings, paving the way for the deployment of multimodal editing large models in real-person editing scenarios. The code is available at https://github.com/NDYBSNDY/EditedID.