LaS-Comp: Zero-shot 3D Completion with Latent-Spatial Consistency

作者: Weilong Yan, Haipeng Li, Hao Xu, Nianjin Ye, Yihao Ai, Shuaicheng Liu, Jingyu Hu

分类: cs.CV, cs.RO

发布日期: 2026-02-21

备注: Accepted to CVPR2026

🔗 代码/项目: GITHUB

💡 一句话要点

LaS-Comp:利用潜在空间一致性的零样本3D补全方法

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 3D形状补全 零样本学习 3D基础模型 几何先验 潜在空间 类别无关 深度学习

📋 核心要点

- 现有3D形状补全方法依赖大量训练数据,泛化性差,难以处理真实世界中复杂多样的局部观测。

- LaS-Comp利用3D基础模型的几何先验,通过显式替换和隐式细化两阶段策略,实现零样本、类别无关的3D补全。

- Omni-Comp基准测试表明,LaS-Comp在真实和合成数据上均优于现有方法,展现了其强大的泛化能力。

📝 摘要(中文)

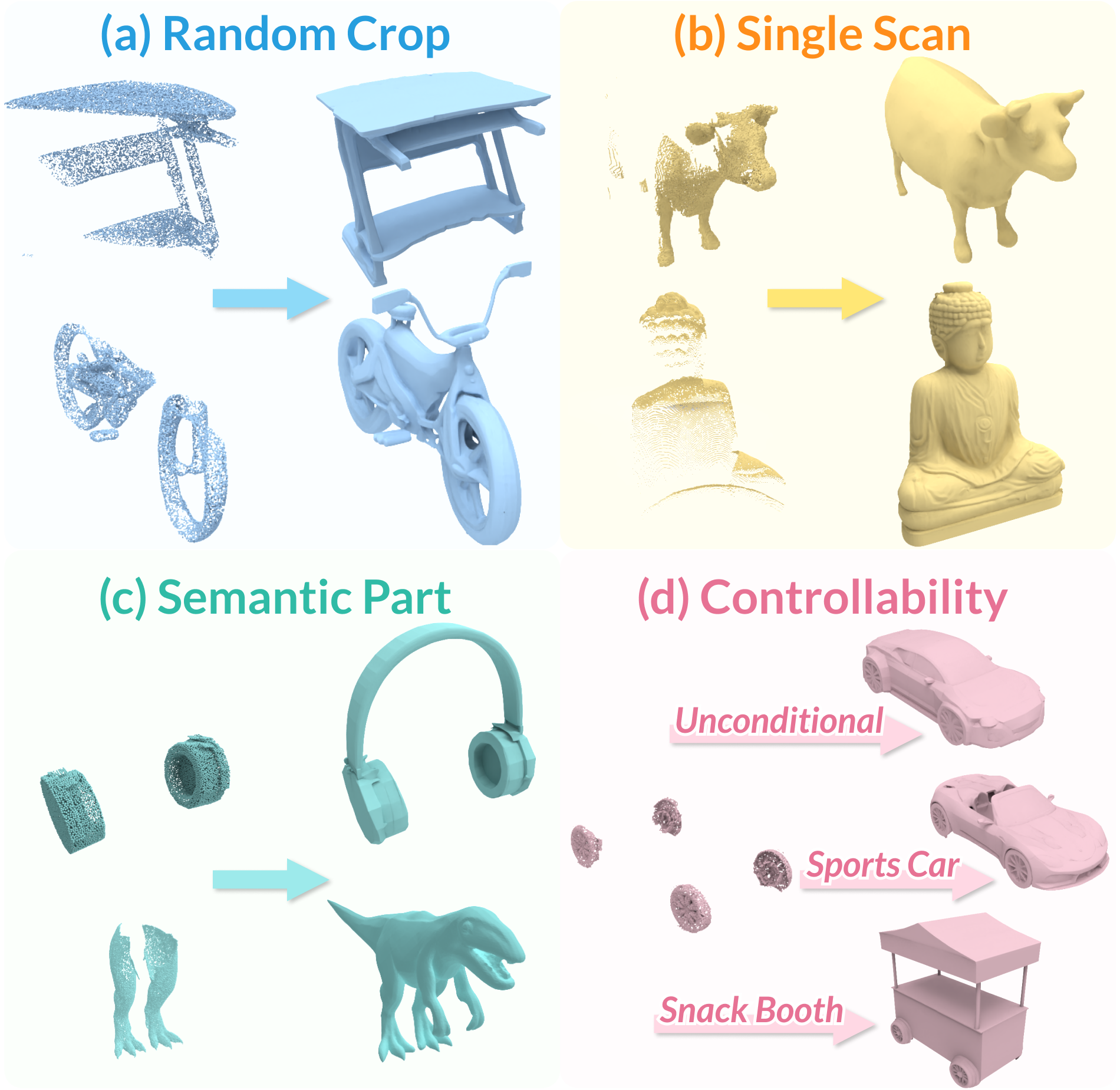

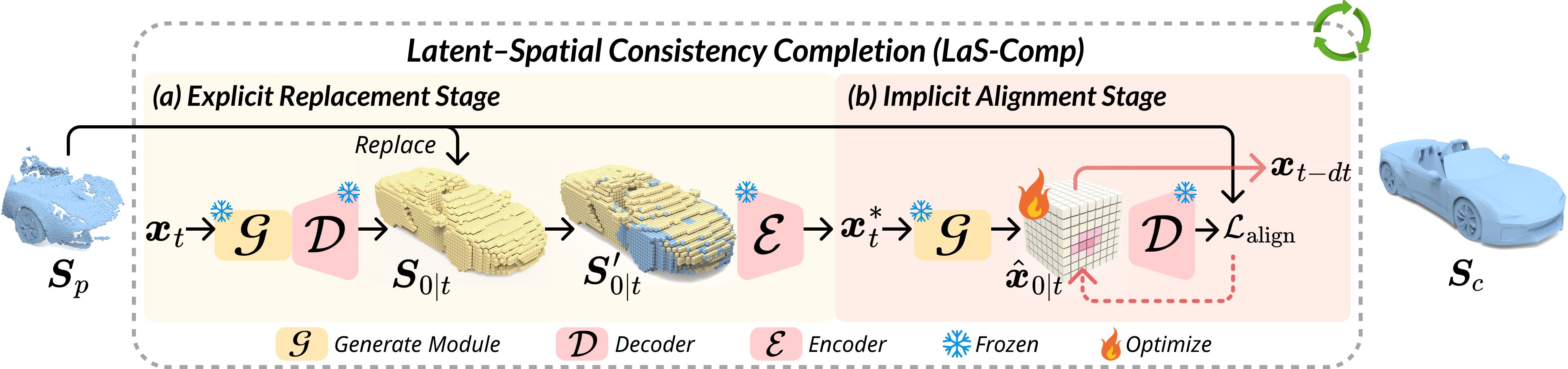

本文提出了一种名为LaS-Comp的零样本、类别无关的方法,该方法利用3D基础模型丰富的几何先验知识,实现对各种类型局部观测的3D形状补全。我们的贡献有三方面:首先,LaS-Comp通过互补的两阶段设计,利用这些强大的生成先验进行补全:(i) 显式替换阶段,保留局部观测几何形状,以确保忠实的补全;(ii) 隐式细化阶段,确保观测区域和合成区域之间的无缝边界。其次,我们的框架是免训练的,并且与不同的3D基础模型兼容。第三,我们引入了Omni-Comp,这是一个综合性的基准测试,结合了真实世界和合成数据,具有多样化和具有挑战性的局部模式,从而能够进行更彻底和真实的评估。定量和定性实验表明,我们的方法优于以前最先进的方法。我们的代码和数据将在LaS-Comp上提供。

🔬 方法详解

问题定义:现有的3D形状补全方法通常需要针对特定类别的数据进行训练,泛化能力有限,难以适应真实世界中各种各样的局部观测情况。此外,如何保证补全结果与已观测部分的几何一致性,以及如何实现观测区域和补全区域之间的平滑过渡,也是一个挑战。

核心思路:LaS-Comp的核心思路是利用预训练的3D基础模型所蕴含的丰富几何先验知识,通过一种免训练的方式实现3D形状的补全。该方法通过显式替换和隐式细化两个阶段,分别保证补全结果的几何一致性和边界平滑性。

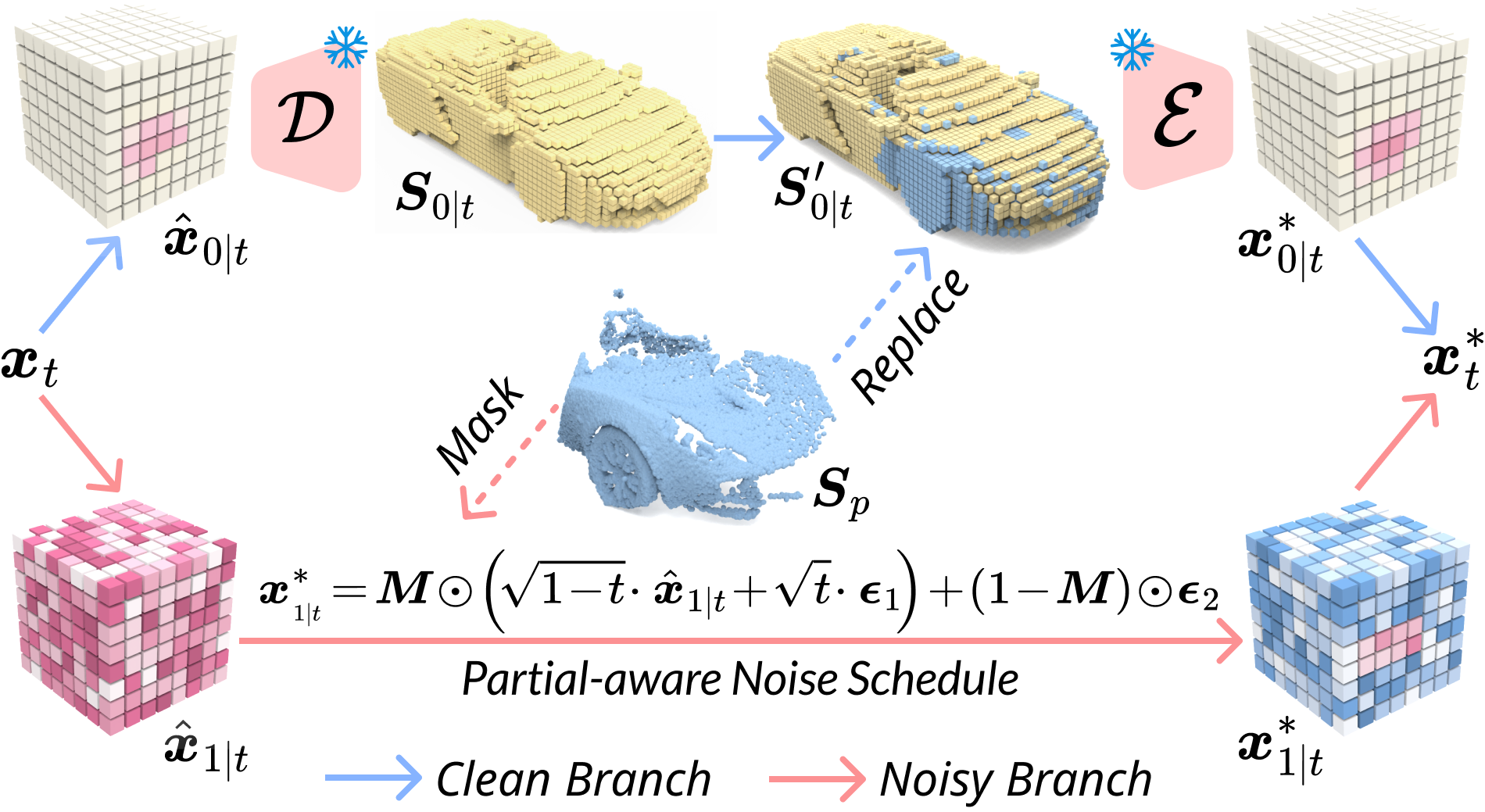

技术框架:LaS-Comp框架包含两个主要阶段:显式替换阶段和隐式细化阶段。在显式替换阶段,该方法首先将部分观测到的3D形状嵌入到3D基础模型的潜在空间中,然后利用基础模型的生成能力,在潜在空间中生成完整的3D形状。为了保证补全结果与观测部分的几何一致性,该方法会将生成结果中与观测部分对应的区域替换为原始观测数据。在隐式细化阶段,该方法利用一个隐式的细化网络,进一步优化补全结果,使得观测区域和补全区域之间的边界更加平滑。

关键创新:LaS-Comp的关键创新在于其零样本、类别无关的补全能力,以及其互补的两阶段设计。与需要大量训练数据的传统方法不同,LaS-Comp可以直接利用预训练的3D基础模型进行补全,无需额外的训练。此外,显式替换和隐式细化两个阶段的互补设计,既保证了补全结果的几何一致性,又实现了观测区域和补全区域之间的平滑过渡。

关键设计:LaS-Comp的关键设计包括:(1) 如何将部分观测到的3D形状有效地嵌入到3D基础模型的潜在空间中;(2) 如何在潜在空间中生成高质量的完整3D形状;(3) 如何在显式替换阶段保证补全结果与观测部分的几何一致性;(4) 如何设计隐式细化网络,以实现观测区域和补全区域之间的平滑过渡。具体的参数设置、损失函数和网络结构等细节在论文中有详细描述。

🖼️ 关键图片

📊 实验亮点

LaS-Comp在Omni-Comp基准测试中取得了显著的性能提升,在各种类型的局部观测模式下均优于现有方法。定量实验表明,LaS-Comp在补全精度和几何一致性方面均有明显优势。定性实验也表明,LaS-Comp能够生成更加完整、逼真且与观测部分无缝衔接的3D形状。

🎯 应用场景

LaS-Comp在机器人、自动驾驶、虚拟现实等领域具有广泛的应用前景。例如,在机器人领域,它可以帮助机器人补全不完整的环境信息,从而更好地进行导航和物体识别。在自动驾驶领域,它可以帮助车辆补全被遮挡的物体,提高驾驶安全性。在虚拟现实领域,它可以用于生成更加逼真的3D场景。

📄 摘要(原文)

This paper introduces LaS-Comp, a zero-shot and category-agnostic approach that leverages the rich geometric priors of 3D foundation models to enable 3D shape completion across diverse types of partial observations. Our contributions are threefold: First, \ourname{} harnesses these powerful generative priors for completion through a complementary two-stage design: (i) an explicit replacement stage that preserves the partial observation geometry to ensure faithful completion; and (ii) an implicit refinement stage ensures seamless boundaries between the observed and synthesized regions. Second, our framework is training-free and compatible with different 3D foundation models. Third, we introduce Omni-Comp, a comprehensive benchmark combining real-world and synthetic data with diverse and challenging partial patterns, enabling a more thorough and realistic evaluation. Both quantitative and qualitative experiments demonstrate that our approach outperforms previous state-of-the-art approaches. Our code and data will be available at \href{https://github.com/DavidYan2001/LaS-Comp}{LaS-Comp}.