Diff2DGS: Reliable Reconstruction of Occluded Surgical Scenes via 2D Gaussian Splatting

作者: Tianyi Song, Danail Stoyanov, Evangelos Mazomenos, Francisco Vasconcelos

分类: cs.CV, cs.GR, cs.RO

发布日期: 2026-02-20

备注: This work has been submitted to the IEEE for possible publication

💡 一句话要点

Diff2DGS:基于2D高斯溅射可靠重建遮挡手术场景

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 手术场景重建 高斯溅射 扩散模型 遮挡修复 深度估计 机器人手术 可学习形变模型

📋 核心要点

- 现有方法在重建被器械遮挡的手术场景时,重建质量受限,且缺乏对深度精度的充分评估。

- Diff2DGS利用扩散模型进行时序一致性修复,并结合可学习形变模型的2D高斯溅射,提升重建质量。

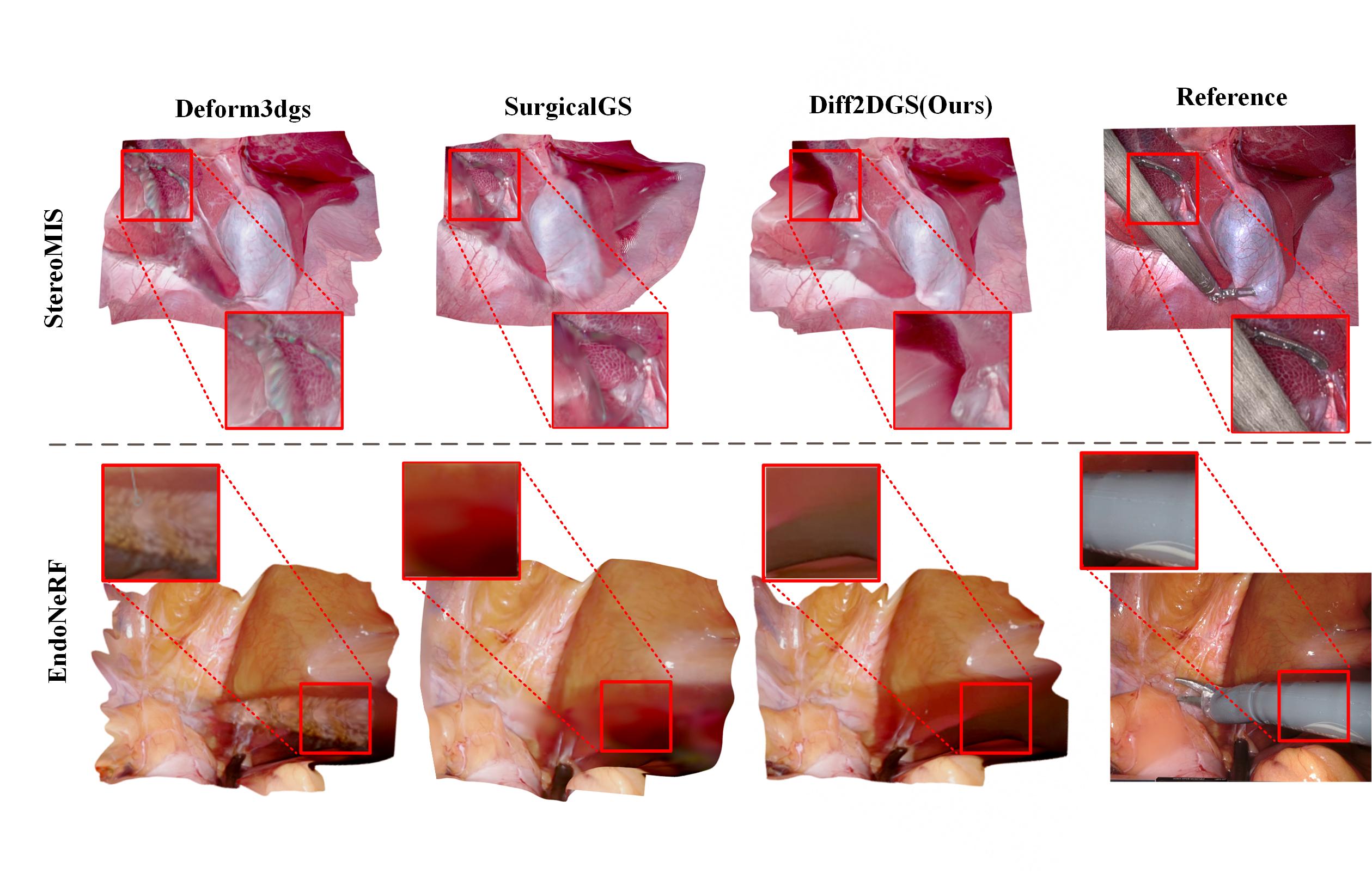

- 实验表明,Diff2DGS在外观和几何精度上均超越现有技术,并在深度质量上进行了优化。

📝 摘要(中文)

本文提出Diff2DGS,一个用于可靠重建遮挡手术场景的新型两阶段框架。针对机器人手术视频中组织遮挡问题,第一阶段采用基于扩散模型的视频模块,利用时序先验对器械遮挡的组织进行高时空一致性的修复。第二阶段,采用带有可学习形变模型(LDM)的2D高斯溅射(2DGS)来捕捉动态组织形变和解剖几何结构。通过在SCARED数据集上进行定量深度精度分析,扩展了以往仅关注图像质量的评估方法。实验结果表明,Diff2DGS在外观和几何结构上均优于现有方法,在EndoNeRF上达到38.02 dB PSNR,在StereoMIS上达到34.40 dB。此外,研究表明仅优化图像质量并不一定能获得最佳的3D重建精度,因此进一步优化了重建3D结果的深度质量,确保了高保真外观和更真实的几何结构。

🔬 方法详解

问题定义:现有基于高斯溅射(GS)的手术场景重建方法在处理器械遮挡时,重建质量下降明显,尤其是在深度精度方面。现有的评估方法主要集中在图像质量指标上,缺乏对重建几何结构的定量评估,导致优化方向可能偏离真实的3D结构。

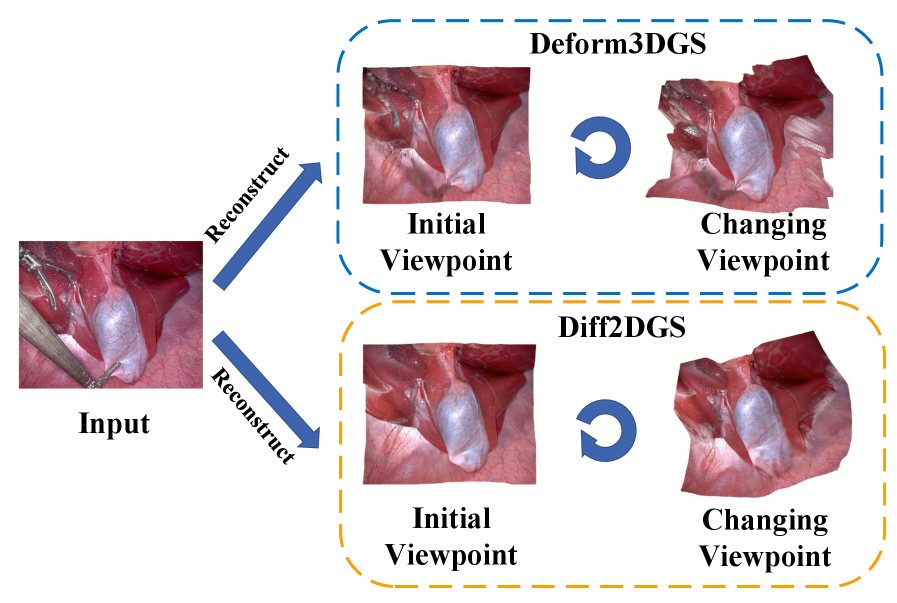

核心思路:Diff2DGS的核心思路是分阶段处理遮挡和形变问题。首先,利用扩散模型对被遮挡区域进行修复,生成具有时序一致性的图像。然后,利用2D高斯溅射结合可学习形变模型,对动态组织形变进行建模,从而实现更准确的3D重建。这种分而治之的策略能够有效提升重建质量和深度精度。

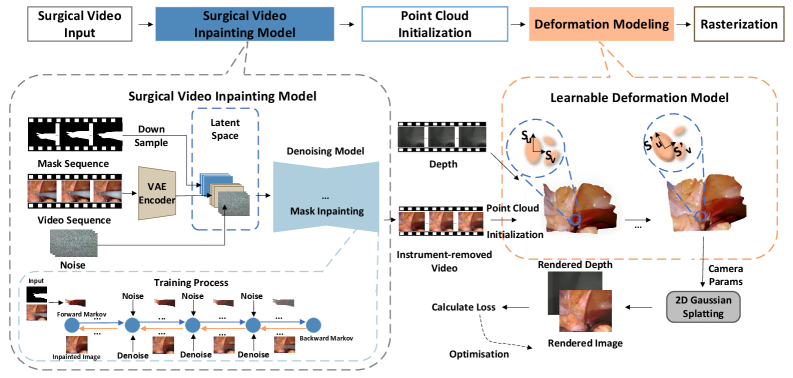

技术框架:Diff2DGS包含两个主要阶段:1) 基于扩散模型的视频修复模块:该模块利用时序信息,通过扩散过程对被器械遮挡的组织区域进行修复,生成具有时序一致性的图像序列。2) 基于2D高斯溅射的重建模块:该模块利用修复后的图像序列,采用2D高斯溅射技术,结合可学习形变模型(LDM),对动态组织形变进行建模,并优化高斯参数,最终实现3D重建。

关键创新:Diff2DGS的关键创新在于:1) 引入扩散模型进行手术视频的遮挡修复,提高了重建的鲁棒性。2) 采用2D高斯溅射结合可学习形变模型,更有效地捕捉了手术场景中的动态形变。3) 提出了基于深度精度的定量评估方法,弥补了现有方法仅关注图像质量的不足。

关键设计:扩散模型采用U-Net结构,损失函数包括L1损失和感知损失,以保证修复图像的清晰度和真实感。2D高斯溅射模块采用可学习形变模型,通过优化高斯参数和形变参数,实现对动态组织的精确建模。深度质量的优化通过引入深度损失函数来实现,该损失函数鼓励重建的深度与真实深度之间的差异最小化。

🖼️ 关键图片

📊 实验亮点

Diff2DGS在EndoNeRF和StereoMIS数据集上分别取得了38.02 dB和34.40 dB的PSNR,显著优于现有方法。更重要的是,通过在SCARED数据集上的深度精度评估,证明了Diff2DGS在几何重建方面也具有显著优势。实验结果表明,优化深度质量能够进一步提升重建的几何精度,从而获得更真实的3D模型。

🎯 应用场景

Diff2DGS在机器人手术领域具有广泛的应用前景,可用于提升手术导航的精度,辅助医生进行更精准的操作。此外,该技术还可用于手术机器人的自动化控制,实现更智能化的手术流程。未来,Diff2DGS有望应用于手术培训、远程医疗等领域,推动医疗技术的进步。

📄 摘要(原文)

Real-time reconstruction of deformable surgical scenes is vital for advancing robotic surgery, improving surgeon guidance, and enabling automation. Recent methods achieve dense reconstructions from da Vinci robotic surgery videos, with Gaussian Splatting (GS) offering real-time performance via graphics acceleration. However, reconstruction quality in occluded regions remains limited, and depth accuracy has not been fully assessed, as benchmarks like EndoNeRF and StereoMIS lack 3D ground truth. We propose Diff2DGS, a novel two-stage framework for reliable 3D reconstruction of occluded surgical scenes. In the first stage, a diffusion-based video module with temporal priors inpaints tissue occluded by instruments with high spatial-temporal consistency. In the second stage, we adapt 2D Gaussian Splatting (2DGS) with a Learnable Deformation Model (LDM) to capture dynamic tissue deformation and anatomical geometry. We also extend evaluation beyond prior image-quality metrics by performing quantitative depth accuracy analysis on the SCARED dataset. Diff2DGS outperforms state-of-the-art approaches in both appearance and geometry, reaching 38.02 dB PSNR on EndoNeRF and 34.40 dB on StereoMIS. Furthermore, our experiments demonstrate that optimizing for image quality alone does not necessarily translate into optimal 3D reconstruction accuracy. To address this, we further optimize the depth quality of the reconstructed 3D results, ensuring more faithful geometry in addition to high-fidelity appearance.