BLM-Guard: Explainable Multimodal Ad Moderation with Chain-of-Thought and Policy-Aligned Rewards

作者: Yiran Yang, Zhaowei Liu, Yuan Yuan, Yukun Song, Xiong Ma, Yinghao Song, Xiangji Zeng, Lu Sun, Yulu Wang, Hai Zhou, Shuai Cui, Zhaohan Gong, Jiefei Zhang

分类: cs.CV

发布日期: 2026-02-20 (更新: 2026-02-23)

备注: 7 pages, 3 figures. To appear in AAAI 2026

💡 一句话要点

提出BLM-Guard,利用CoT和策略对齐奖励进行可解释的多模态广告审核。

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多模态广告审核 思维链推理 策略对齐 强化学习 数据合成 短视频理解

📋 核心要点

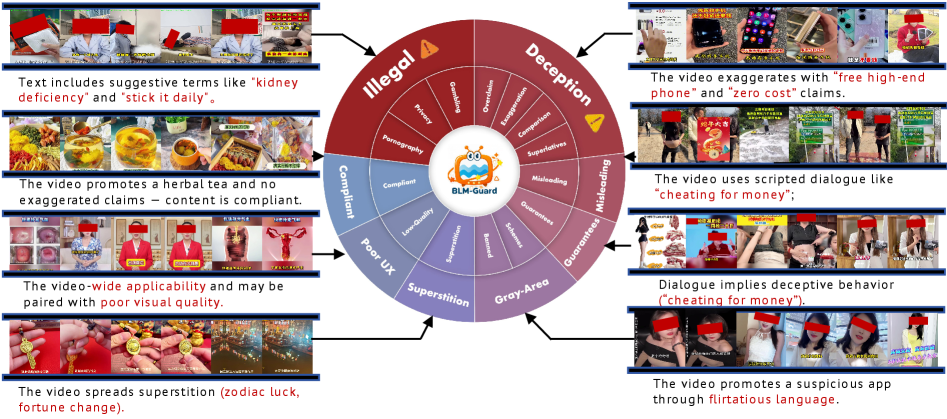

- 短视频平台上的多模态广告包含欺骗性视觉、语音和字幕,对内容审核提出了更细粒度、策略驱动的需求。

- BLM-Guard融合思维链推理、规则策略和评论器引导奖励,构建可解释的广告审核框架,降低标注成本并提升审核效果。

- 实验表明,BLM-Guard在真实短视频广告审核中,准确性、一致性和泛化性均优于现有方法。

📝 摘要(中文)

本文提出BLM-Guard,一个用于商业广告的内容审核框架,它融合了思维链(Chain-of-Thought)推理、基于规则的策略原则和评论器引导的奖励。该框架利用规则驱动的ICoT数据合成管道,通过生成结构化的场景描述、推理链和标签来快速启动训练,从而降低标注成本。然后,强化学习使用一个综合奖励来优化模型,该奖励平衡了因果一致性和策略遵循。一个多任务架构对模态内操作(例如,夸张的图像)和跨模态不匹配(例如,字幕-语音漂移)进行建模,从而提高鲁棒性。在真实短视频广告上的实验表明,BLM-Guard在准确性、一致性和泛化性方面超越了强大的基线。

🔬 方法详解

问题定义:现有短视频平台上的广告审核面临挑战,因为广告内容往往包含精心设计的欺骗性元素,例如夸张的视觉效果、误导性的字幕和语音。传统的社区安全过滤器难以胜任这种细粒度的、需要策略对齐的审核任务。人工标注成本高昂,且难以保证标注的一致性和准确性。

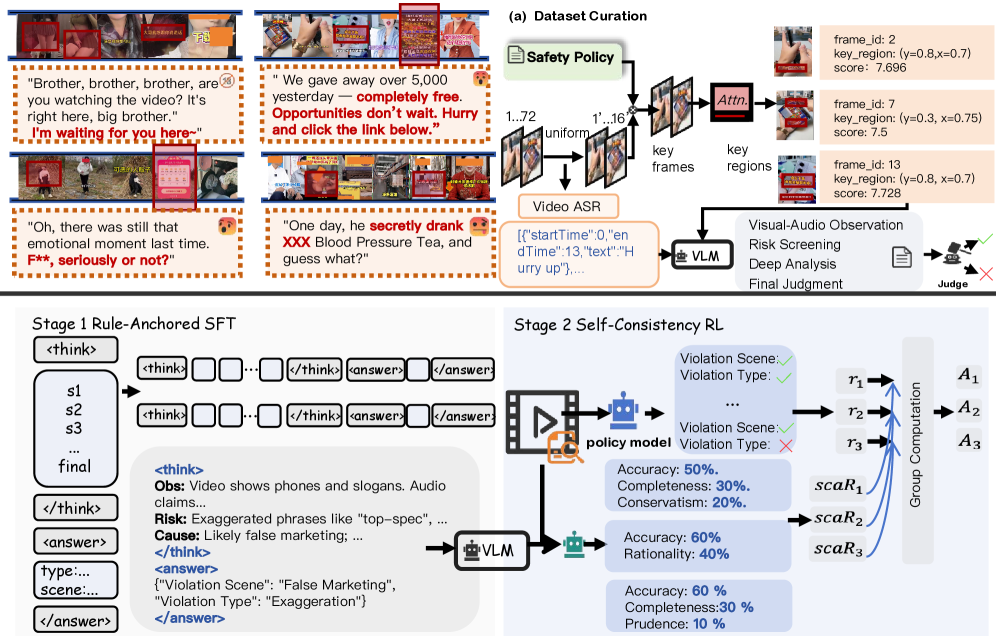

核心思路:BLM-Guard的核心思路是结合思维链(Chain-of-Thought)推理、规则驱动的策略原则和强化学习,构建一个可解释且策略对齐的多模态广告审核框架。通过思维链推理,模型可以逐步分析广告内容,并给出审核决策的理由,提高可解释性。规则驱动的策略原则确保审核结果符合预定的广告政策。强化学习则用于优化模型,使其在因果一致性和策略遵循之间取得平衡。

技术框架:BLM-Guard框架包含以下主要模块:1) ICoT数据合成管道:利用规则生成结构化的场景描述、推理链和标签,用于预训练模型。2) 多任务模型:对模态内操作(如夸张的图像)和跨模态不匹配(如字幕-语音漂移)进行建模。3) 强化学习模块:使用评论器引导的奖励来优化模型,奖励函数综合考虑了因果一致性和策略遵循。

关键创新:BLM-Guard的关键创新在于:1) 融合思维链推理和策略原则:使模型能够进行可解释的、策略对齐的审核。2) 规则驱动的ICoT数据合成:降低了标注成本,并为模型提供了结构化的训练数据。3) 评论器引导的强化学习:优化了模型,使其在因果一致性和策略遵循之间取得平衡。

关键设计:ICoT数据合成管道使用预定义的规则来生成场景描述、推理链和标签。多任务模型采用共享的特征提取层和多个特定任务的输出层。强化学习模块使用策略梯度算法,评论器网络用于评估模型生成的推理链的质量,并提供奖励信号。奖励函数的设计需要仔细平衡因果一致性和策略遵循,例如,可以设置奖励项来惩罚违反广告政策的行为,并奖励符合逻辑的推理过程。

🖼️ 关键图片

📊 实验亮点

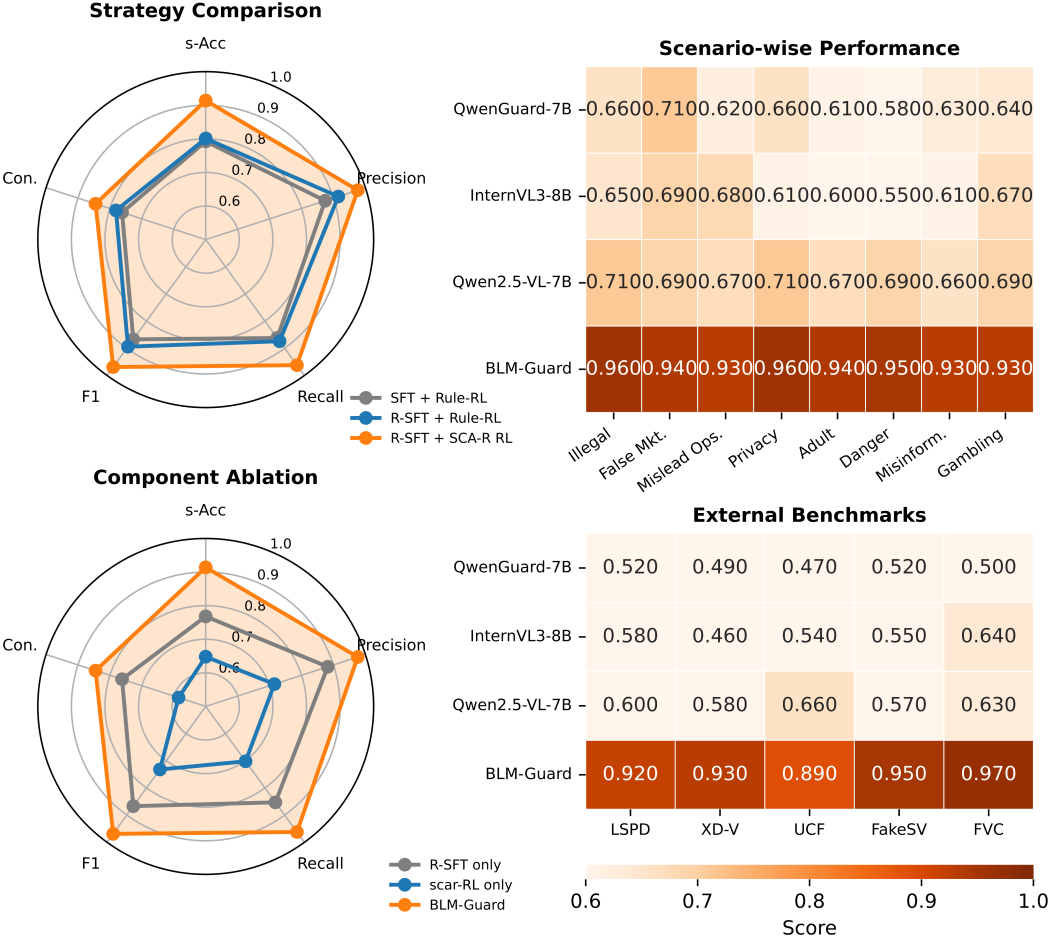

实验结果表明,BLM-Guard在真实短视频广告数据集上取得了显著的性能提升,在准确性、一致性和泛化性方面均优于现有方法。具体而言,BLM-Guard的准确率比最强的基线提高了5%-10%,并且在处理跨模态不匹配问题时表现出更强的鲁棒性。此外,ICoT数据合成管道有效地降低了标注成本,使得模型能够在有限的标注数据下进行训练。

🎯 应用场景

BLM-Guard可应用于各种短视频平台和广告审核场景,用于自动检测和过滤违反广告政策的内容,例如虚假宣传、夸大效果、误导信息等。该技术可以显著提高广告审核的效率和准确性,降低人工审核成本,并提升用户体验。未来,该技术还可以扩展到其他类型的内容审核,例如新闻审核、社交媒体内容审核等。

📄 摘要(原文)

Short-video platforms now host vast multimodal ads whose deceptive visuals, speech and subtitles demand finer-grained, policy-driven moderation than community safety filters. We present BLM-Guard, a content-audit framework for commercial ads that fuses Chain-of-Thought reasoning with rule-based policy principles and a critic-guided reward. A rule-driven ICoT data-synthesis pipeline jump-starts training by generating structured scene descriptions, reasoning chains and labels, cutting annotation costs. Reinforcement learning then refines the model using a composite reward balancing causal coherence with policy adherence. A multitask architecture models intra-modal manipulations (e.g., exaggerated imagery) and cross-modal mismatches (e.g., subtitle-speech drift), boosting robustness. Experiments on real short-video ads show BLM-Guard surpasses strong baselines in accuracy, consistency and generalization.